핵심 요약

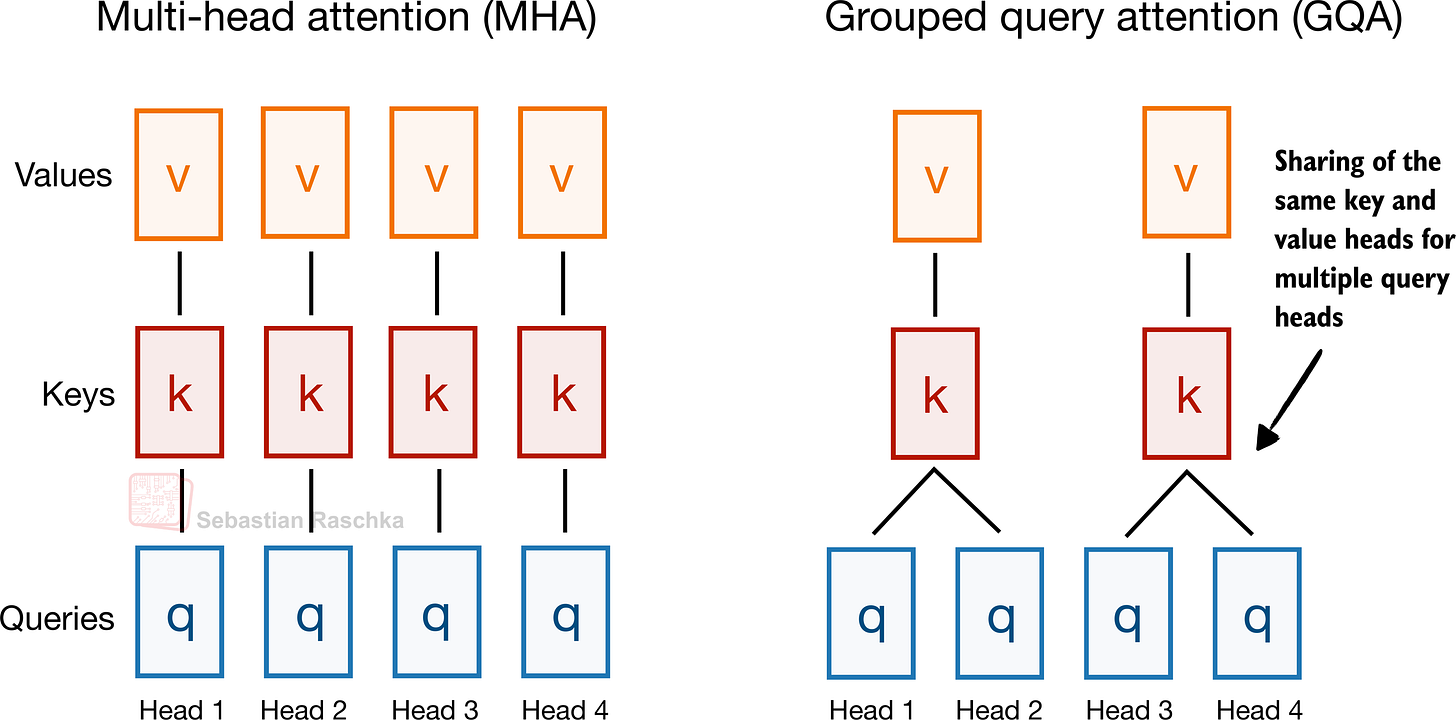

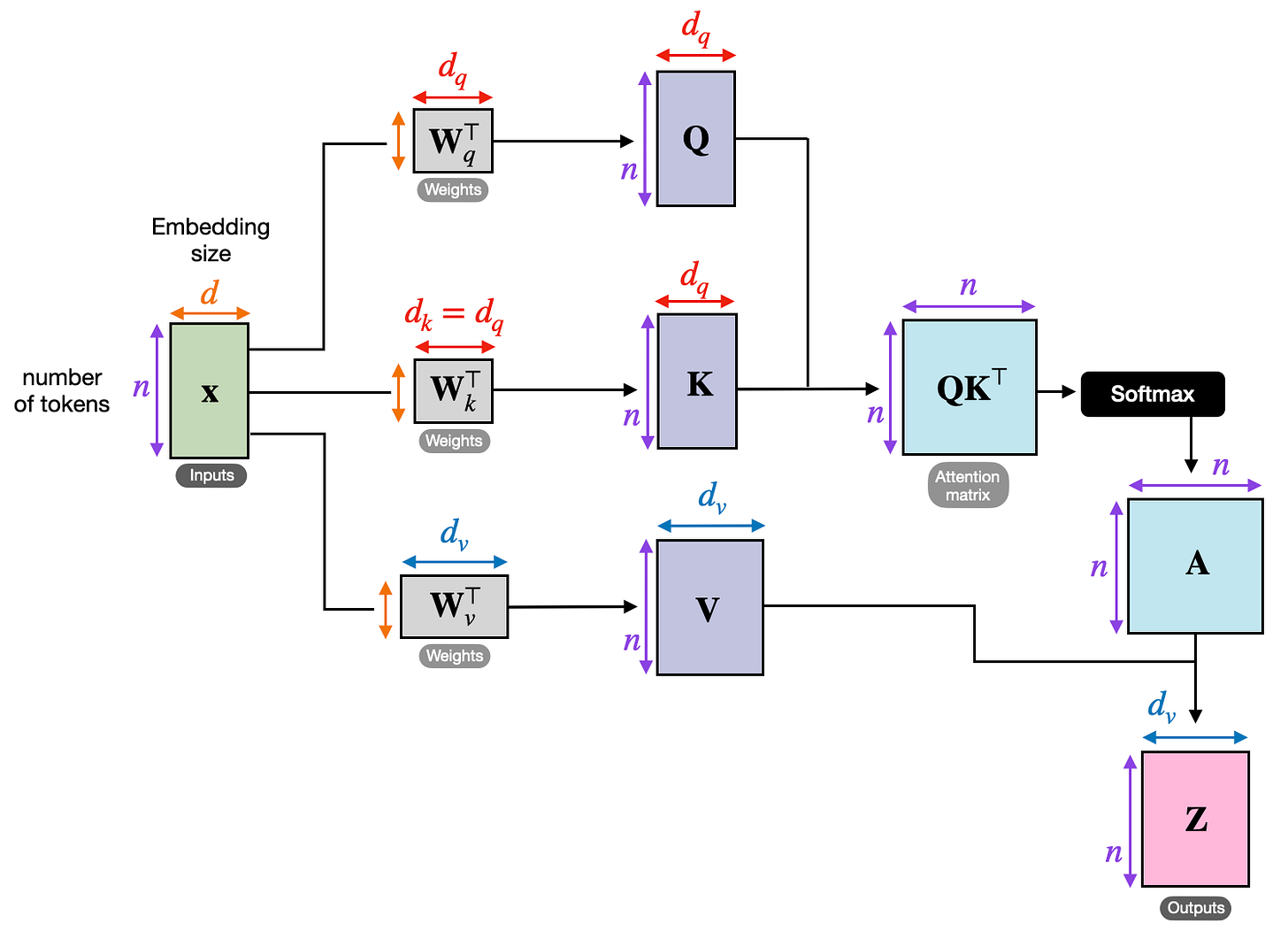

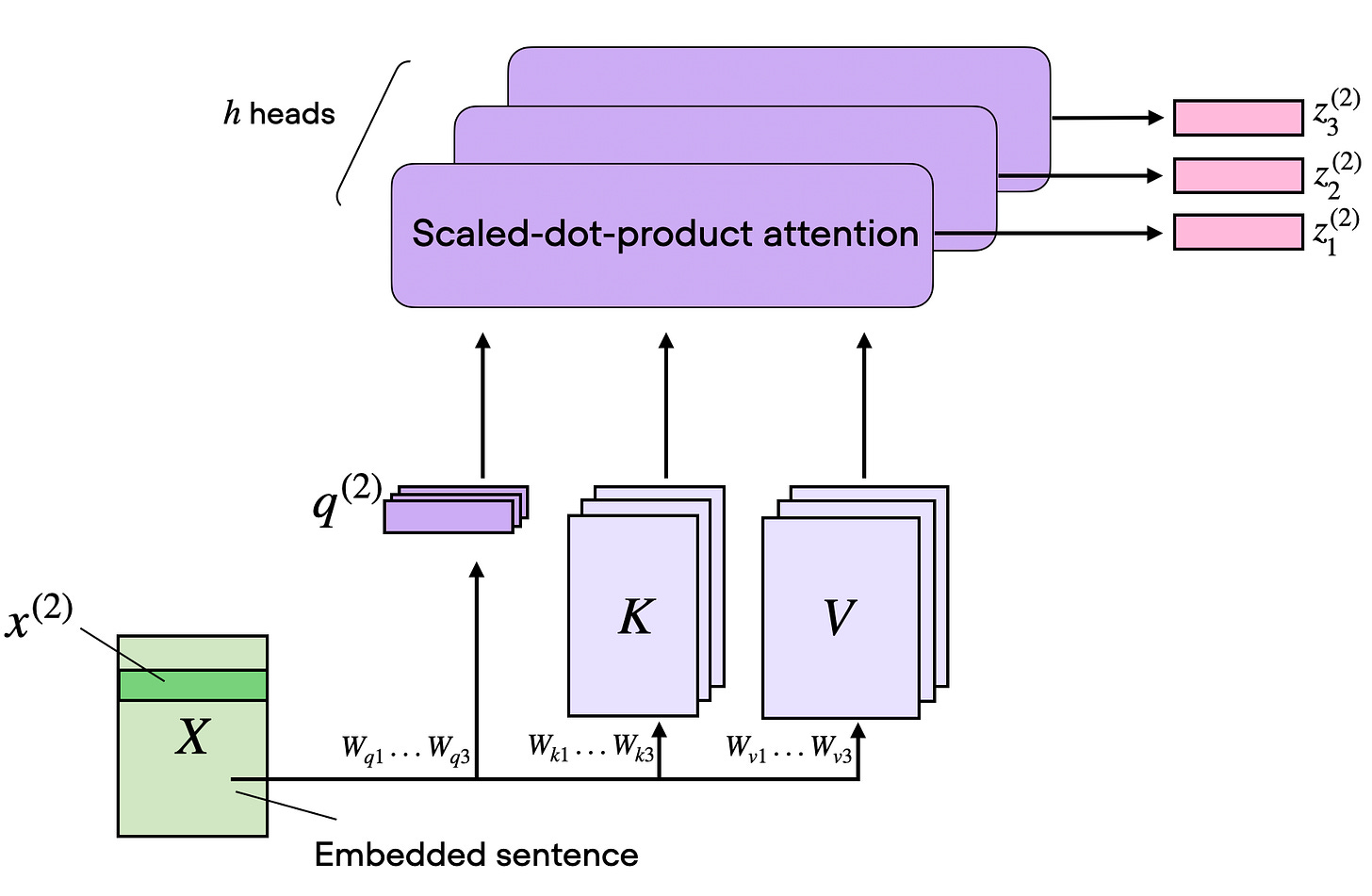

대형 언어 모델의 성능과 효율성은 어텐션 메커니즘의 설계에 따라 크게 좌우된다. 기존 Multi-Head Attention(MHA)은 강력한 성능을 제공하지만 긴 문맥 처리 시 KV 캐시 메모리 부담이 기하급수적으로 증가하는 한계가 있다. 이를 해결하기 위해 헤드를 공유하는 Grouped-Query Attention(GQA)과 잠재 표현으로 압축하는 Multi-Head Latent Attention(MLA) 등 다양한 변체가 등장했다. 최신 모델들은 이러한 효율적 어텐션 기법을 하이브리드 구조와 결합하여 성능 저하 없이 추론 비용을 획기적으로 낮추고 있다.

배경

Transformer Architecture, Self-Attention Mechanism, KV Caching Concepts

대상 독자

LLM 아키텍처 설계자 및 추론 최적화 엔지니어

의미 / 영향

어텐션 메커니즘의 진화는 LLM의 추론 비용을 낮추고 컨텍스트 길이를 획기적으로 늘리는 데 기여한다. 특히 MLA와 하이브리드 구조의 확산은 고성능 모델의 대중화를 가속화할 것이다.

섹션별 상세

이미지 분석

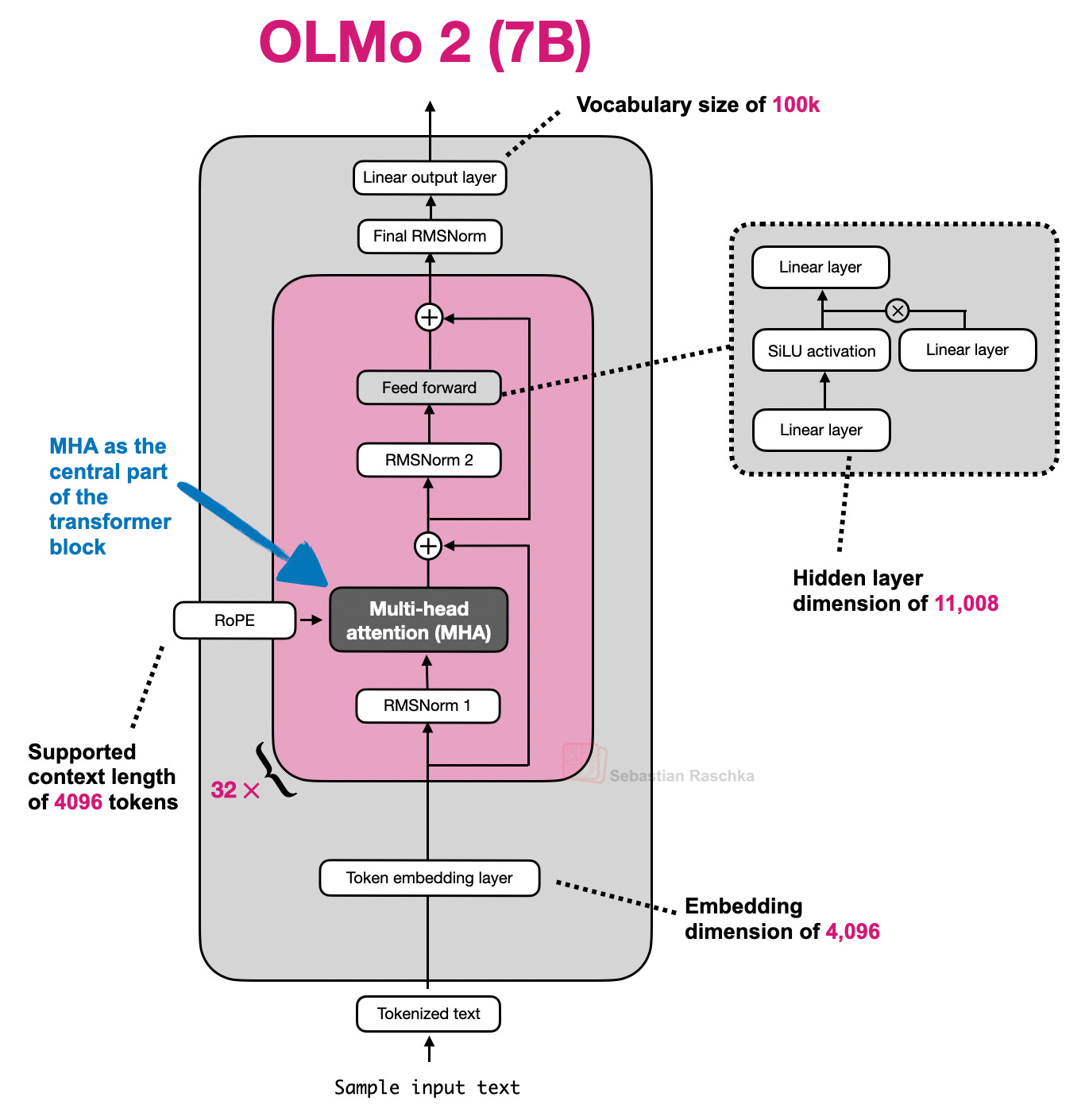

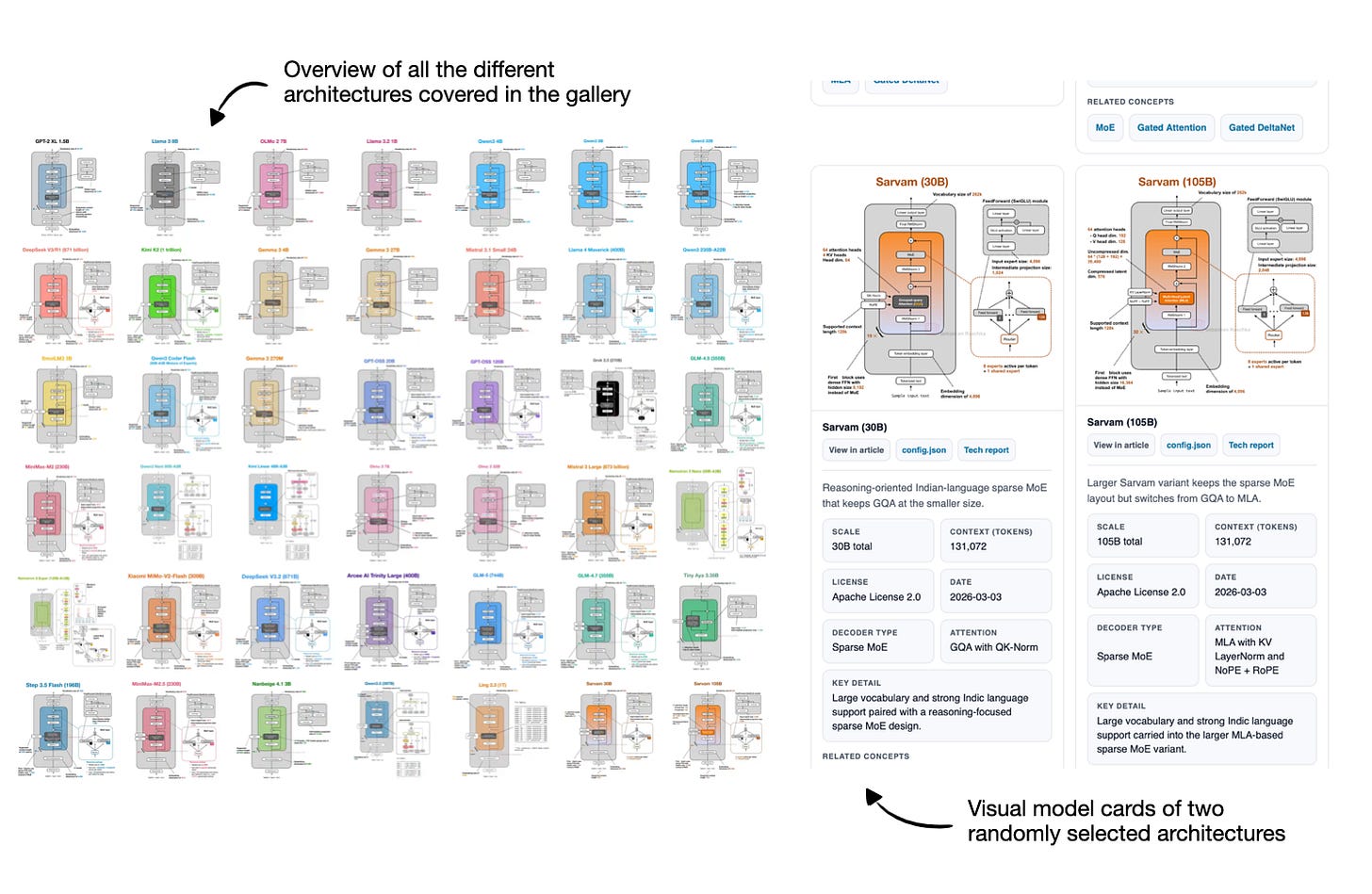

현대 LLM들에 사용된 다양한 어텐션 및 모델 구조를 한눈에 비교할 수 있는 시각적 카드 모음이다. 각 모델의 특징적인 어텐션 변체들을 분류하여 아티클의 전체 맥락을 제공한다.

45개 이상의 LLM 아키텍처를 정리한 갤러리 오버뷰

실무 Takeaway

- 모델 규모가 100B 미만인 경우 GQA는 구현 복잡도 대비 KV 캐시 효율성이 가장 뛰어난 선택지이다.

- 초대형 모델이나 긴 문맥 처리가 필수적인 서비스에서는 MLA나 DSA 같은 압축 및 희소 어텐션 기법 도입이 필수적이다.

- 하이브리드 아키텍처는 어텐션의 이차 복잡도 문제를 해결하여 소규모 스타트업도 긴 문맥 모델을 효율적으로 운영할 수 있게 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.