핵심 요약

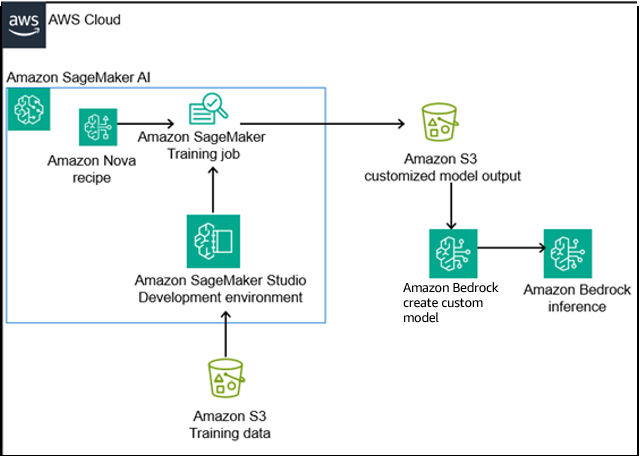

금융 및 의료와 같은 규제 산업에서는 LLM의 확률적 특성으로 인한 환각 현상이 도입의 큰 장벽이다. Artificial Genius는 Amazon Nova 모델을 기반으로 입력 컨텍스트 이해에는 생성 능력을 사용하되, 출력은 엄격히 결정론적으로 제어하는 3세대 하이브리드 접근 방식을 도입했다. SageMaker AI를 통한 LoRA 파인튜닝과 3만 개의 합성 데이터를 활용해 환각률을 0.03%까지 낮추는 성과를 거두었다. 이 방식은 RAG를 넘어 입력과 쿼리를 통합 임베딩하고 에이전트 워크플로우를 통해 실무 적용성을 높였다.

배경

Amazon SageMaker AI 사용 경험, LoRA 및 SFT 파인튜닝 개념, LLM 환각 및 RAG 아키텍처에 대한 이해

대상 독자

금융·의료 등 규제 산업에서 LLM의 신뢰성과 환각 문제를 해결하려는 AI 엔지니어 및 아키텍트

의미 / 영향

이 기술은 LLM의 고질적인 문제인 환각을 0.03% 수준으로 낮춰 금융 및 의료 분야의 미션 크리티컬 시스템에 AI를 도입할 수 있는 길을 열었다. 특히 생성 모델을 비생성적으로 활용하는 설계 패턴은 향후 신뢰할 수 있는 AI 에이전트 구축의 표준이 될 가능성이 높다.

섹션별 상세

실무 Takeaway

- 규제 산업용 LLM 구축 시 생성 모델을 비생성적(추출/검증)으로 활용하면 환각을 수학적으로 억제하고 결정론적인 출력을 얻을 수 있다.

- LoRA 파인튜닝 시 50% 드롭아웃 설정과 충분한 양의 합성 데이터를 확보하는 것이 모델의 일반화 성능을 높이고 과적합을 방지하는 핵심이다.

- 에이전트 워크플로우 설계 시 제품 요구사항 문서(PRD) 구조를 활용하면 도메인 전문가가 자연어로 쿼리를 제어하면서도 출력의 엄격함을 유지할 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.