핵심 요약

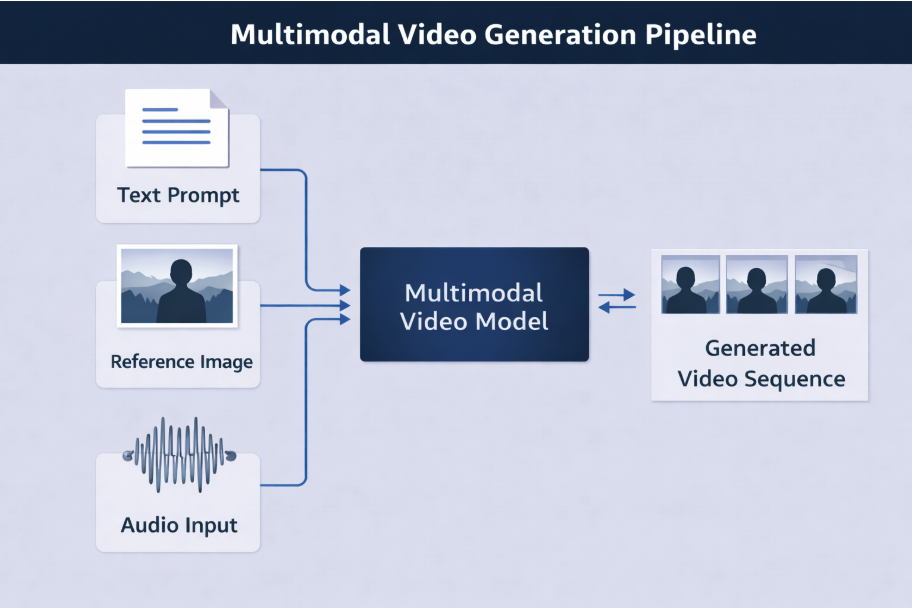

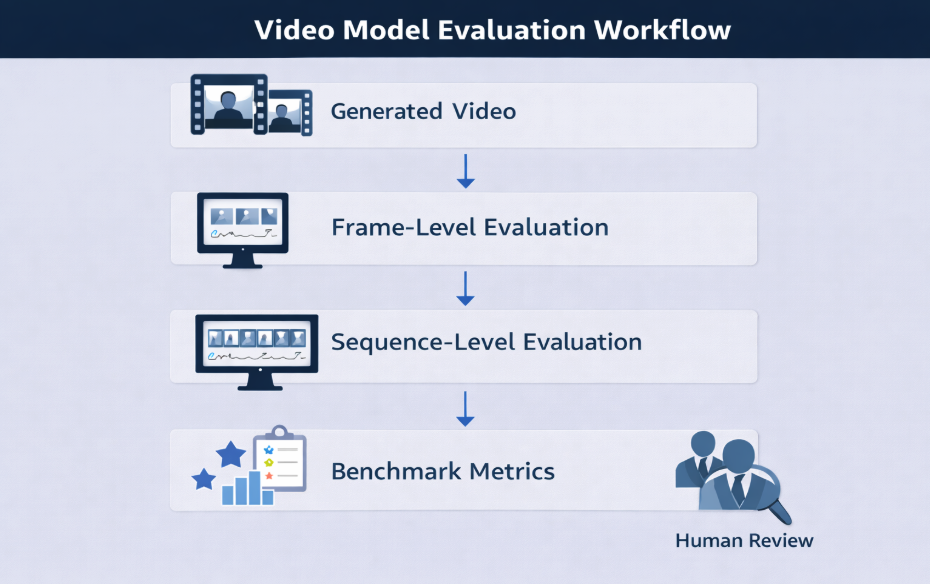

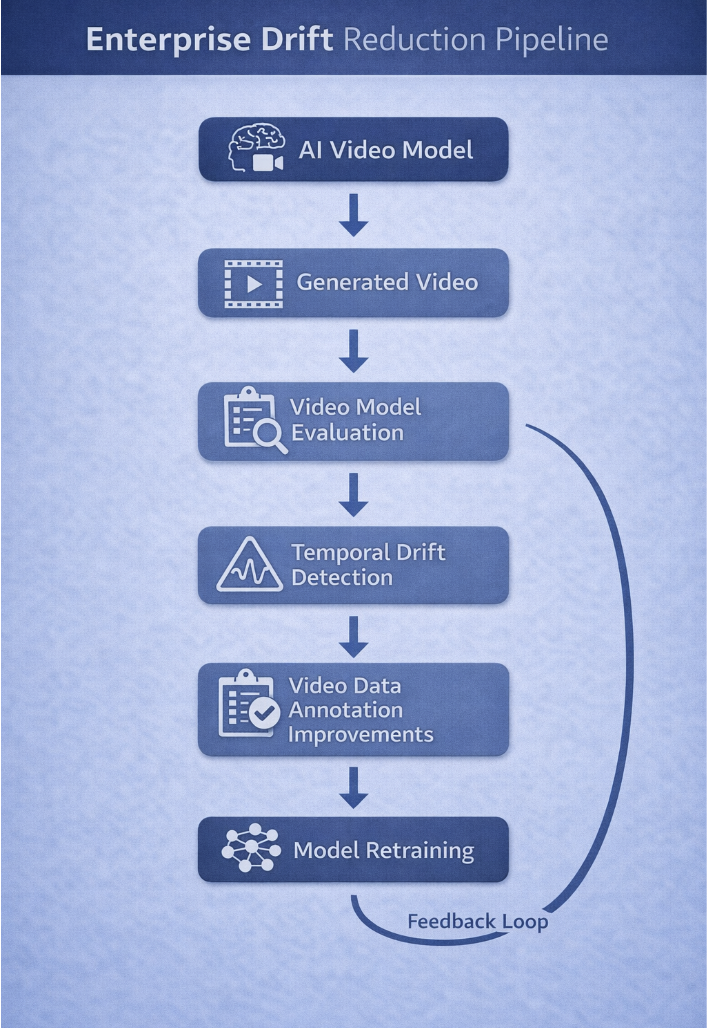

AI 비디오 생성 모델은 프레임을 순차적으로 예측하는 과정에서 캐릭터의 형태나 배경 사물이 변하는 시간적 드리프트 현상으로 인해 안정성이 저하되는 문제를 겪는다. 이 문제는 모델의 짧은 시간적 문맥 유지 능력과 프레임 간 정렬 메커니즘의 한계에서 비롯되며, 이를 해결하기 위해 TECO나 Lumiere 같은 시공간 통합 아키텍처가 도입되고 있다. FVD(Fréchet Video Distance)나 STREAM 같은 시퀀스 단위 평가 지표와 VBench 등의 벤치마크를 통해 개별 프레임이 아닌 전체 영상의 일관성을 측정하는 것이 필수적이다. 고품질 비디오 데이터 어노테이션과 인간 피드백 루프를 결합한 모니터링 체계를 구축함으로써 엔터프라이즈 환경에서도 신뢰할 수 있는 비디오 AI 시스템을 운영할 수 있다.

배경

Generative AI 및 Diffusion Model에 대한 기본 이해, 비디오 데이터의 구조(프레임, 시퀀스)에 대한 지식, ML 모델 평가 지표에 대한 기초 지식

대상 독자

비디오 생성 AI 모델을 개발하거나 프로덕션에 배포하려는 ML 엔지니어 및 데이터 전략가

의미 / 영향

이 아티클은 AI 비디오의 상용화를 가로막는 최대 난제인 일관성 문제를 체계적으로 정의하고 해결책을 제시한다. 시퀀스 단위 평가와 정교한 데이터 어노테이션의 중요성을 강조함으로써, 단순한 생성 품질을 넘어 신뢰할 수 있는 영상 제작을 위한 업계 표준 가이드라인을 제공한다.

섹션별 상세

실무 Takeaway

- 비디오 생성 모델의 성능 평가 시 단일 프레임 지표보다는 FVD나 STREAM 같은 시퀀스 단위 지표를 우선적으로 활용하여 시간적 일관성을 검증해야 한다.

- 장기적인 영상 생성이 필요한 경우 Lumiere와 같은 시공간 통합 생성 방식이나 TECO와 같은 메모리 증강 아키텍처를 채택하여 드리프트 누적을 방지해야 한다.

- 학습 데이터 구축 시 객체 추적과 지속적 ID 태깅을 포함한 고품질 어노테이션 파이프라인을 구축하여 모델이 시공간적 관계를 정확히 학습하도록 유도해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.