이 요약은 AI가 원문을 분석해 생성했습니다. 정확한 내용은 원문 기준으로 확인하세요.

핵심 요약

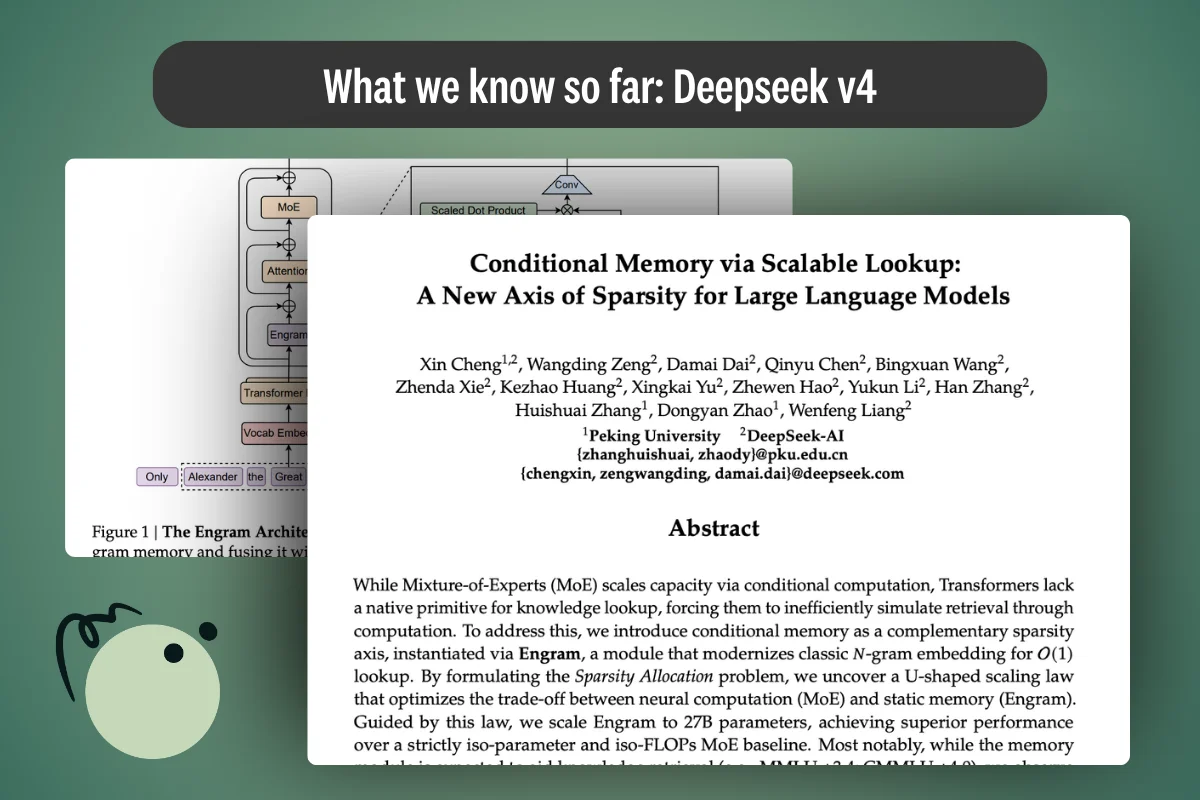

DeepSeek V4는 Engram 조건부 메모리와 DeepSeek Sparse Attention을 포함한 혁신적인 아키텍처 도입을 예고했다. Engram 모듈은 기존 Transformer가 계산을 통해 지식을 조회하던 비효율성을 개선하기 위해 N-gram 임베딩을 현대화하여 O(1) 수준의 빠른 조회를 가능하게 한다. 연구 결과에 따르면 27B 파라미터 규모의 Engram은 동일한 자원을 사용하는 MoE 베이스라인보다 우수한 성능을 기록했다. 이러한 변화는 차세대 AI 모델을 위한 데이터셋 구조화 방식과 고품질 데이터의 기준을 근본적으로 재정의할 것으로 전망된다.

배경

Transformer 아키텍처 이해, MoE(Mixture-of-Experts) 개념, N-gram 및 임베딩 기초

대상 독자

LLM 아키텍처 및 데이터 엔지니어링 전문가

의미 / 영향

DeepSeek V4의 등장은 모델 아키텍처와 데이터 구조의 결합을 가속화하며, 특히 효율적인 지식 조회를 위한 새로운 표준을 제시할 것이다.

섹션별 상세

DeepSeek V4는 Engram이라는 조건부 메모리 모듈을 통해 지식 조회 효율성을 극대화한다. 기존 모델이 연산을 통해 정보를 검색하던 방식에서 벗어나, N-gram 기반의 현대화된 임베딩 구조를 사용하여 조회 성능을 O(1)로 단축했다. 27B 파라미터 규모의 실험에서 Engram은 동일한 파라미터와 연산량을 가진 MoE 모델 대비 뛰어난 성능을 입증했다.

매니폴드 제약 하이퍼 커넥션과 DeepSeek Sparse Attention은 모델의 연산 효율과 연결성을 동시에 개선한다. 희소성(Sparsity)을 활용한 이 접근법은 대규모 모델이 방대한 데이터를 처리할 때 발생하는 계산 병목 현상을 해결하는 데 집중한다. 이는 모델의 크기 확장뿐만 아니라 자원 배분의 최적화가 성능 향상의 핵심임을 시사한다.

새로운 아키텍처의 등장은 데이터셋 구축 방법론의 패러다임 변화를 요구한다. 모델이 지식을 저장하고 불러오는 메커니즘이 변화함에 따라, 데이터 라벨링과 큐레이션 단계에서 아키텍처의 특성을 반영한 전략적 구조화가 필수적이다. 이는 데이터의 양보다 아키텍처와 정렬된 데이터의 질이 모델 성능을 결정짓는 중요한 요소가 됨을 의미한다.

실무 Takeaway

- 시스템 설계 시 Engram과 같은 조건부 메모리 모듈을 통합하여 Transformer의 지식 조회 연산 부하를 줄이고 추론 속도를 개선할 수 있다.

- 대규모 모델 개발 과정에서 MoE와 정적 메모리(Engram) 간의 최적 비율을 결정하는 U자형 스케일링 법칙을 적용하여 자원 효율성을 극대화해야 한다.

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

원문 발행 2026. 03. 24.수집 2026. 03. 25.출처 타입 RSS

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.