핵심 요약

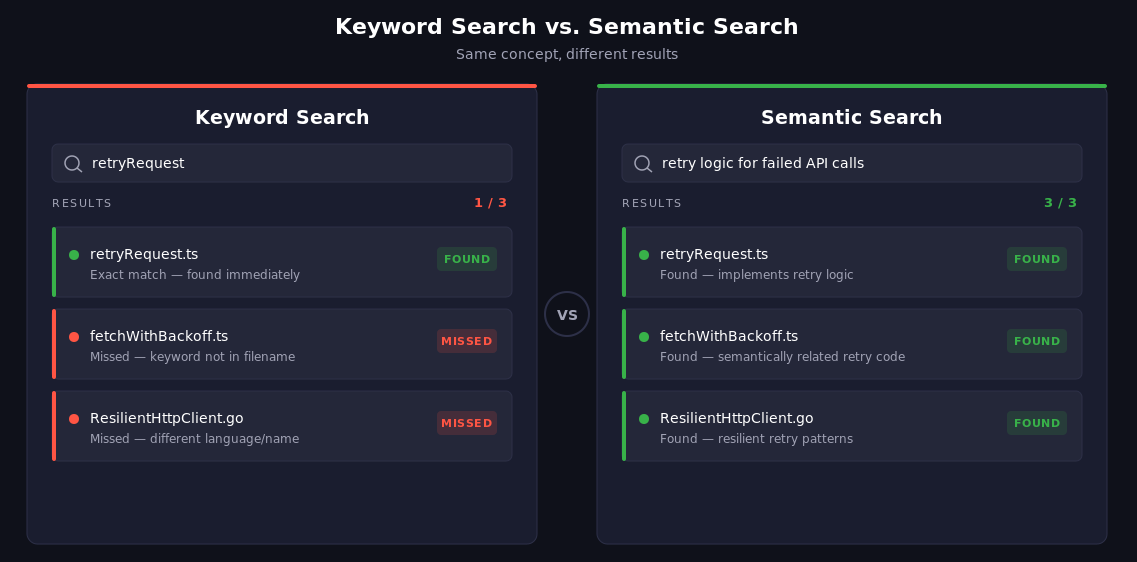

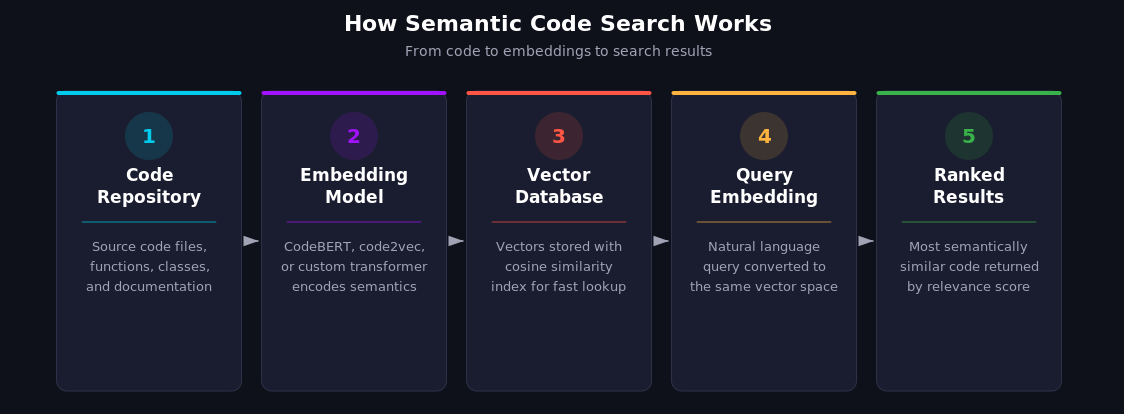

기존 키워드 기반 코드 검색은 정확한 함수명이나 문자열을 알아야 하는 한계가 존재한다. 세만틱 코드 검색은 Transformer 기반 모델을 사용하여 코드와 자연어 쿼리를 벡터 임베딩으로 변환하고, 벡터 공간에서의 유사도를 측정하여 의미적으로 연관된 코드를 찾아낸다. Sourcegraph의 Deep Search는 여기에 LLM 추론을 더해 여러 저장소에 걸친 복잡한 질문에 직접적인 답변과 근거를 제공한다. 내부 테스트 결과, 에이전트 세션 데이터를 학습에 활용한 모델은 검색 정확도가 평균 12% 향상되었으며, 이는 대규모 코드베이스의 탐색 효율을 높이고 개발자 온보딩 시간을 단축한다.

배경

벡터 임베딩(Vector Embedding)의 기본 개념, 검색 엔진(Full-text search)의 작동 방식에 대한 이해, LLM 및 AI 에이전트의 기본 원리

대상 독자

대규모 코드베이스를 관리하거나 AI 기반 개발 도구를 도입하려는 소프트웨어 엔지니어 및 아키텍트

의미 / 영향

세만틱 검색은 개발자가 코드를 찾는 방식을 '문자열 매칭'에서 '의도 기반 대화'로 변화시킵니다. 이는 특히 마이크로서비스 아키텍처에서 팀 간 코드 재사용성을 높이고, AI 에이전트가 코드베이스 전체 맥락을 정확히 파악하여 더 나은 제안을 할 수 있게 만드는 기반이 됩니다.

섹션별 상세

// CheckLuhn verifies a numeric string using the Luhn algorithm.

func CheckLuhn(number string) bool {

sum := 0

alt := false

for i := len(number) - 1; i >= 0; i-- {

n := int(number[i] - '0')

if alt {

n *= 2; if n > 9 { n -= 9 }

}

sum += n

alt = !alt

}

return sum%10 == 0

}키워드 검색으로는 'credit card'로 찾을 수 없지만, 세만틱 검색은 의미를 파악해 찾아낼 수 있는 Luhn 알고리즘 구현 예시

실무 Takeaway

- 정확한 심볼명을 모르는 코드 탐색 단계에서는 세만틱 검색을, 특정 함수 호출처를 찾는 정밀 작업에는 키워드/구조 검색을 혼합 사용해야 효율적이다.

- 도메인 특화 용어나 내부 프레임워크가 많은 조직은 범용 모델보다 에이전트 세션이나 내부 코드로 파인튜닝된 임베딩 모델을 도입하여 검색 정확도를 개선할 수 있다.

- 대규모 코드베이스에서는 전체 재인덱싱 비용을 줄이기 위해 머지 시점에 변경분만 처리하는 증분 인덱싱(Incremental Indexing) 전략이 필수적이다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.