이 요약은 AI가 원문을 분석해 생성했습니다. 정확한 내용은 원문 기준으로 확인하세요.

핵심 요약

대형 언어 모델(LLM)의 추론 효율성을 극대화하기 위해 구글 리서치에서 TurboQuant 알고리즘을 출시했다. 이 기술은 이론적으로 검증된 양자화 기법을 사용하여 LLM의 Key-Value(KV) 캐시 메모리 사용량을 6배 이상 절감하면서도 정확도 손실을 거의 발생시키지 않는다. 특히 긴 컨텍스트를 처리할 때 발생하는 메모리 병목 현상을 해결하여 최대 8배의 추론 속도 향상을 제공한다. LLM뿐만 아니라 벡터 검색 엔진의 효율성 개선에도 적용 가능한 범용적인 압축 솔루션이다.

배경

양자화(Quantization) 기본 개념, LLM 추론 아키텍처 이해, KV 캐시 메모리 구조 지식

대상 독자

LLM 인프라 및 추론 최적화 개발자

의미 / 영향

LLM의 고질적인 문제인 메모리 사용량을 획기적으로 줄여, 고가의 GPU 자원 없이도 긴 문맥을 처리하는 서비스 구현이 가능해질 것이다. 특히 초장문 컨텍스트를 다루는 RAG 시스템이나 복잡한 에이전트 워크플로우에서 비용 효율성을 크게 높일 것으로 기대된다.

섹션별 상세

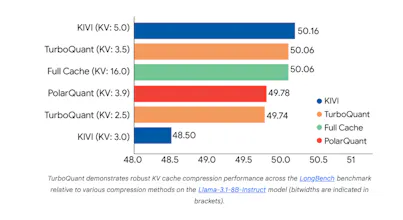

LLM 추론 시 긴 문맥을 처리할 때 발생하는 KV 캐시 메모리 부족 문제를 해결하기 위해 새로운 양자화 알고리즘인 TurboQuant가 개발됐다. TurboQuant는 데이터를 낮은 비트(1-bit, 2-bit, 4-bit 등)로 변환하여 저장 공간을 획기적으로 줄이는 방식을 취한다. 실제 벤치마크 결과 KV 캐시 메모리를 6배 이상 압축하면서도 모델의 응답 정확도를 유지하는 성능을 보였다. 이는 고비용의 GPU 메모리 자원을 효율적으로 사용하여 더 긴 문맥을 처리할 수 있게 한다.

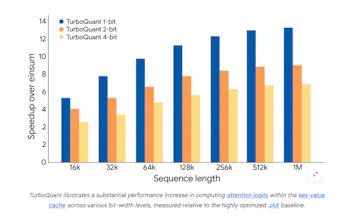

메모리 압축뿐만 아니라 연산 속도 최적화를 통해 추론 지연 시간을 대폭 단축했다. TurboQuant는 양자화된 데이터 상태에서도 효율적인 연산이 가능하도록 설계되어 기존 방식 대비 최대 8배의 속도 향상을 달성했다. 특히 시퀀스 길이가 길어질수록 속도 향상 폭이 커지는 특성을 보여 1M 이상의 초장문 컨텍스트 처리에 최적화되어 있다. 이는 실시간 대화형 AI 서비스의 응답성을 크게 개선할 수 있는 기술적 토대를 제공한다.

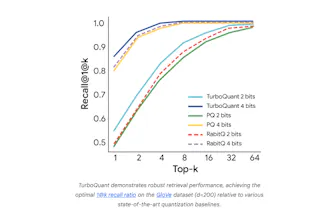

TurboQuant는 LLM의 KV 캐시뿐만 아니라 벡터 검색 엔진의 데이터 압축에도 적용 가능한 범용성을 갖추고 있다. Glove 데이터셋 등을 활용한 검색 성능 테스트에서 기존의 최신 양자화 기법(PQ, RabbitQ 등)보다 높은 재현율(Recall)을 기록하며 우수성을 입증했다. 이를 통해 대규모 벡터 데이터베이스의 운영 비용을 절감하고 검색 속도를 높이는 데 기여할 수 있다. 구글 리서치의 기술력을 바탕으로 이론적 근거와 실전 성능을 모두 확보한 도구이다.

실무 Takeaway

- TurboQuant를 적용하면 LLM의 KV 캐시 메모리를 6배 이상 압축하여 동일 하드웨어에서 더 긴 컨텍스트를 처리할 수 있다.

- 양자화 과정에서 발생하는 정확도 손실을 최소화하면서도 추론 속도를 최대 8배까지 향상시켜 서비스 운영 비용을 절감할 수 있다.

- 벡터 검색 엔진에도 적용 가능하여 대규모 데이터 검색 시스템의 효율성을 개선하는 데 활용될 수 있다.

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

원문 발행 2026. 03. 25.수집 2026. 03. 25.출처 타입 RSS

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.