핵심 요약

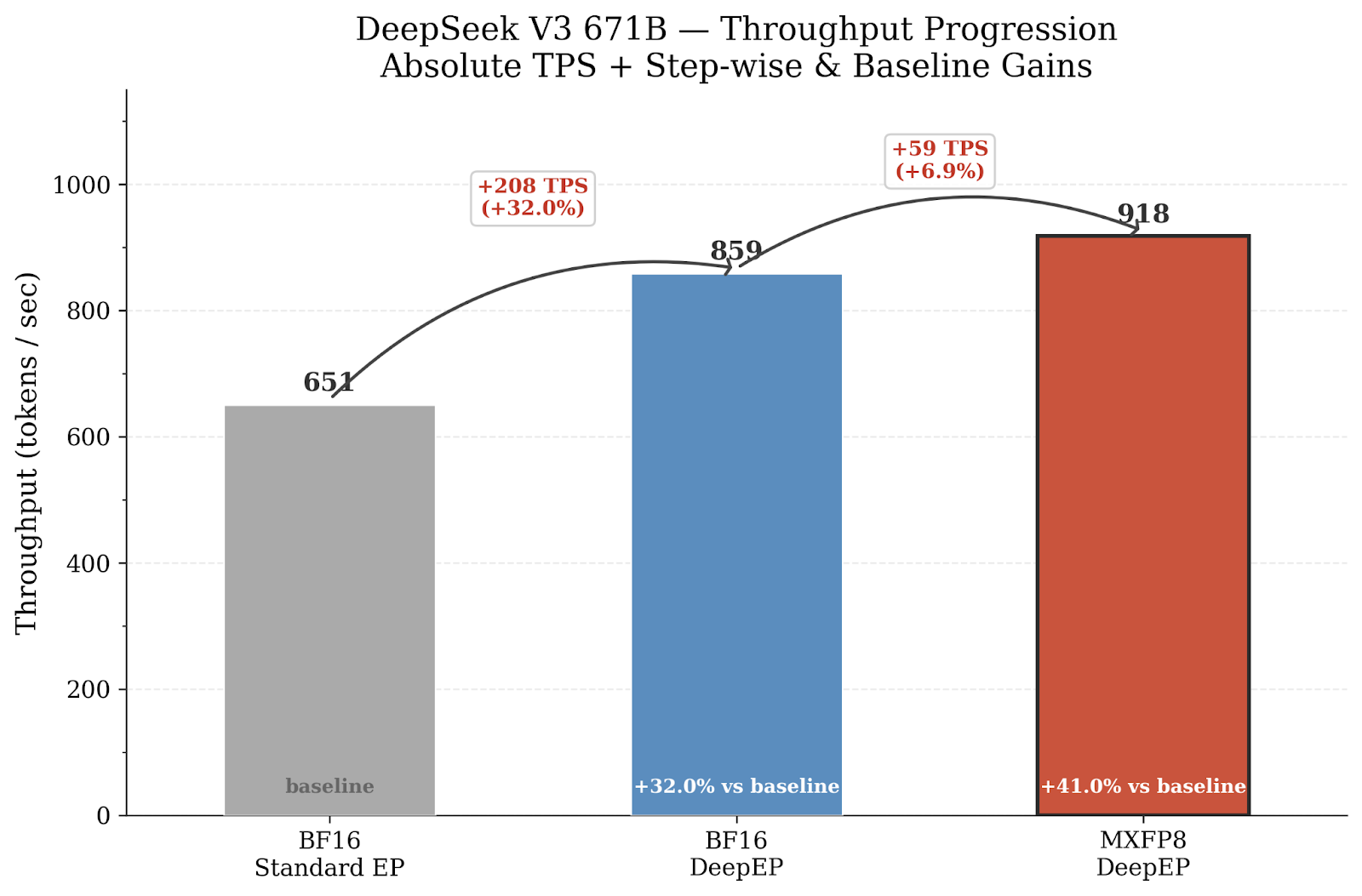

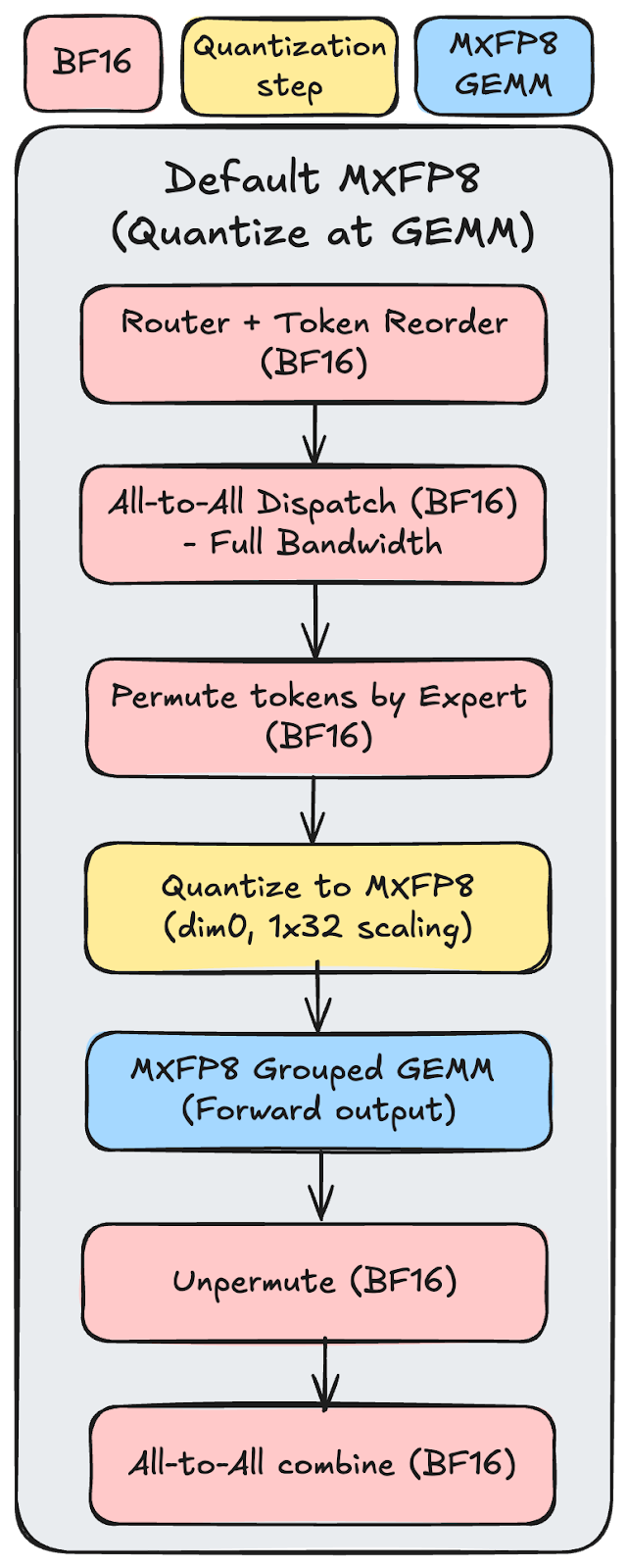

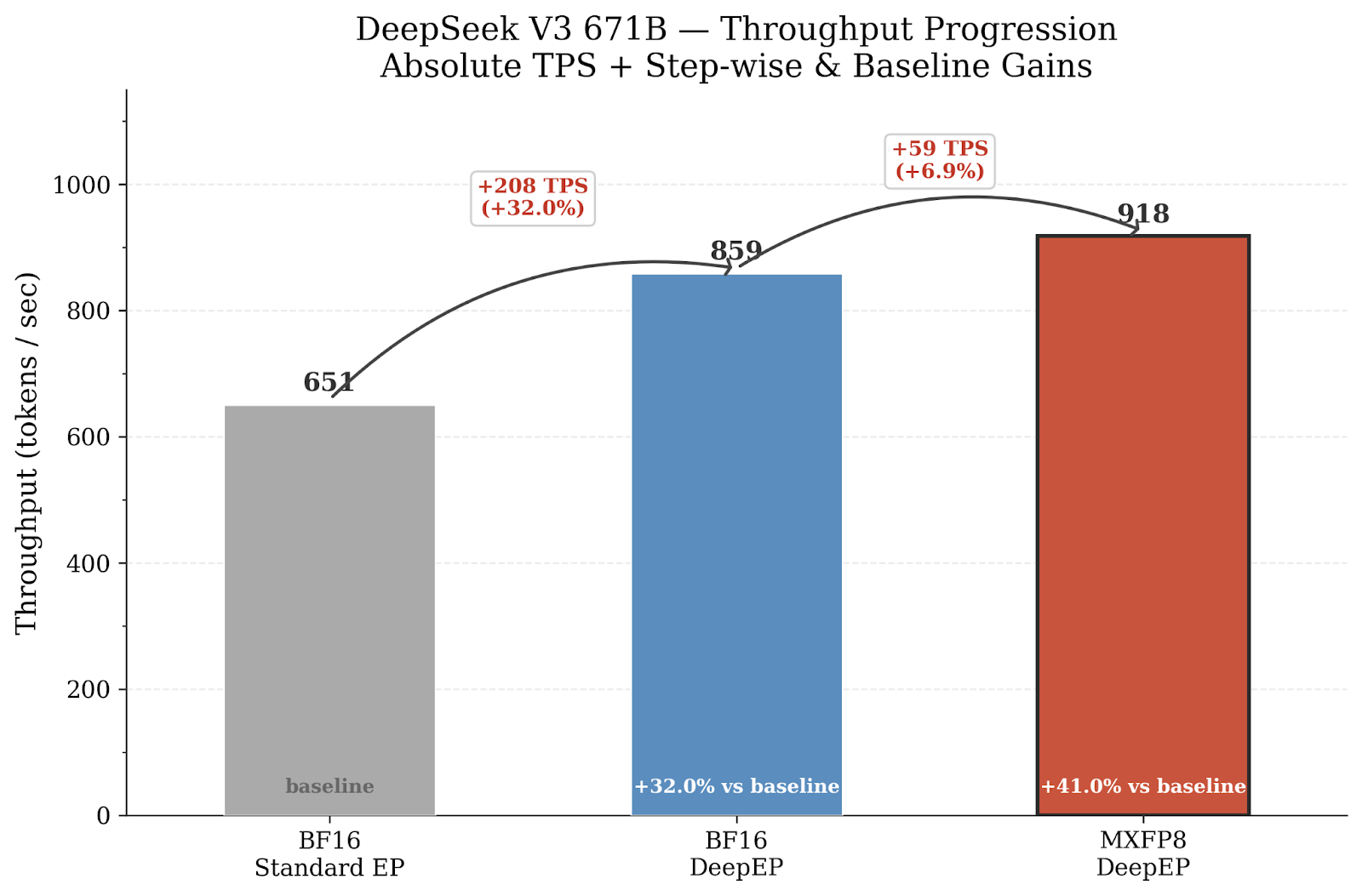

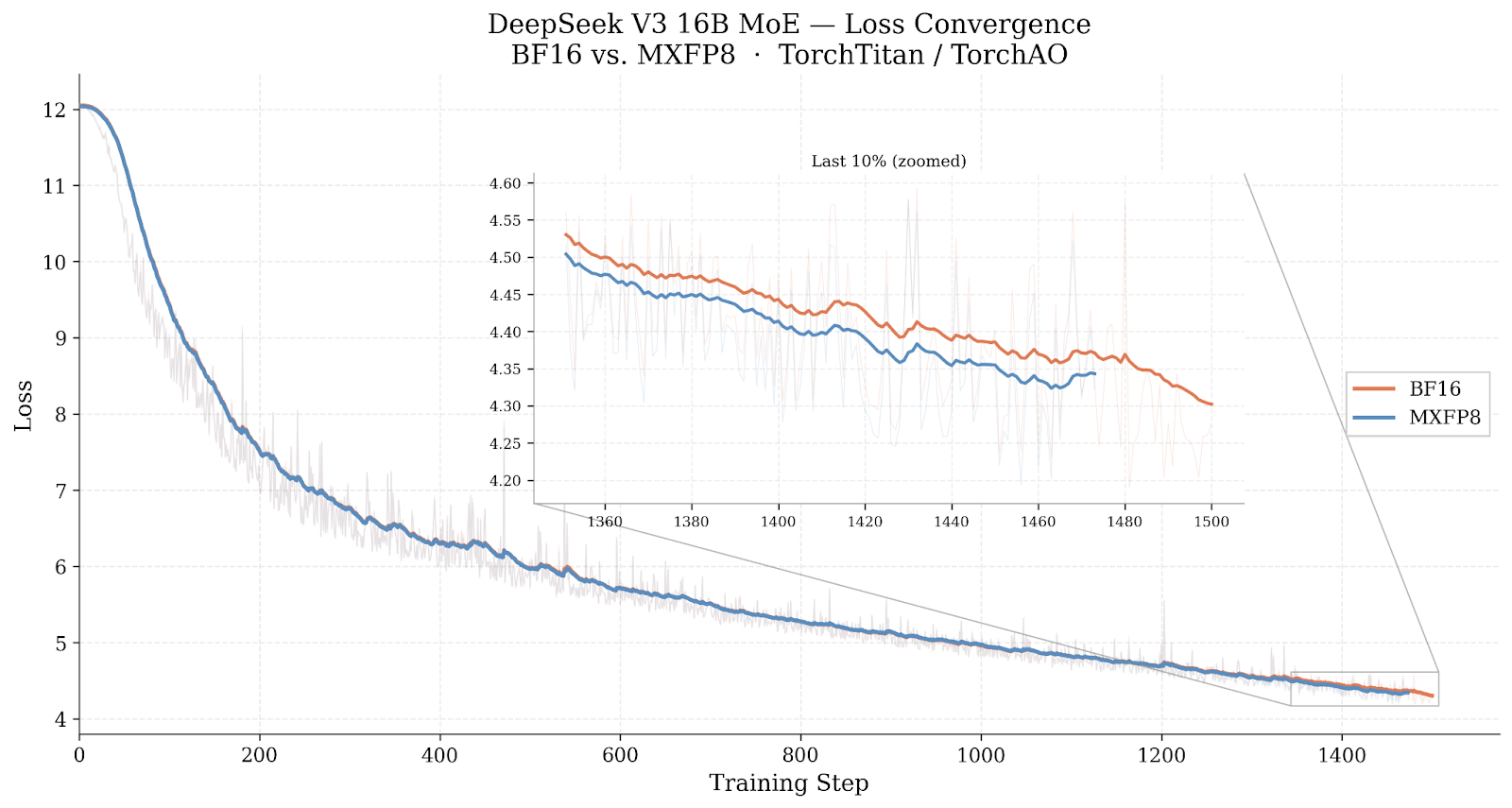

NVIDIA B200 클러스터에서 DeepSeek-V3 MoE 모델의 학습 성능을 극대화하기 위한 최적화 실험이 수행됐다. TorchAO의 MXFP8(Microscaling FP8)을 통해 연산 효율을 높이고, DeepSeek의 DeepEP 라이브러리로 전문가 병렬화(EP) 통신 지연을 단축했다. 실험 결과 DeepSeek-V3 671B 모델에서 기본 BF16 대비 최대 41%의 처리량 향상을 달성했으며, 16B 모델에서는 MXFP8이 BF16과 대등한 수렴 성능을 보임을 입증했다. 이는 Blackwell 아키텍처 기반의 차세대 AI 인프라에서 대규모 모델 학습의 비용 효율성을 크게 높일 수 있음을 시사한다.

배경

MoE 아키텍처 이해, 분산 학습(EP, TP, FSDP) 기초 지식, FP8 수치 형식 개념

대상 독자

대규모 언어 모델(LLM) 학습 및 인프라 최적화 엔지니어

의미 / 영향

Blackwell GPU와 MXFP8, 전용 통신 라이브러리의 조합이 차세대 초대형 모델 학습의 표준이 될 것임을 보여준다. 특히 MoE 구조에서 발생하는 고유한 병목을 소프트웨어 계층에서 해결함으로써 하드웨어 잠재력을 극대화할 수 있다.

섹션별 상세

실무 Takeaway

- NVIDIA B200 기반 클러스터에서 MXFP8과 DeepEP를 결합하면 DeepSeek-V3와 같은 초대형 MoE 모델의 학습 효율을 40% 이상 높일 수 있다.

- MoE 아키텍처의 All-to-All 통신 병목은 표준 NCCL보다 DeepEP와 같은 전용 라이브러리를 사용할 때 훨씬 효과적으로 해결된다.

- MXFP8은 32개 요소 단위의 미세 스케일링을 통해 수치적 안정성을 유지하므로, 대규모 모델 학습에서 BF16을 대체할 수 있는 고효율 포맷이다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.