핵심 요약

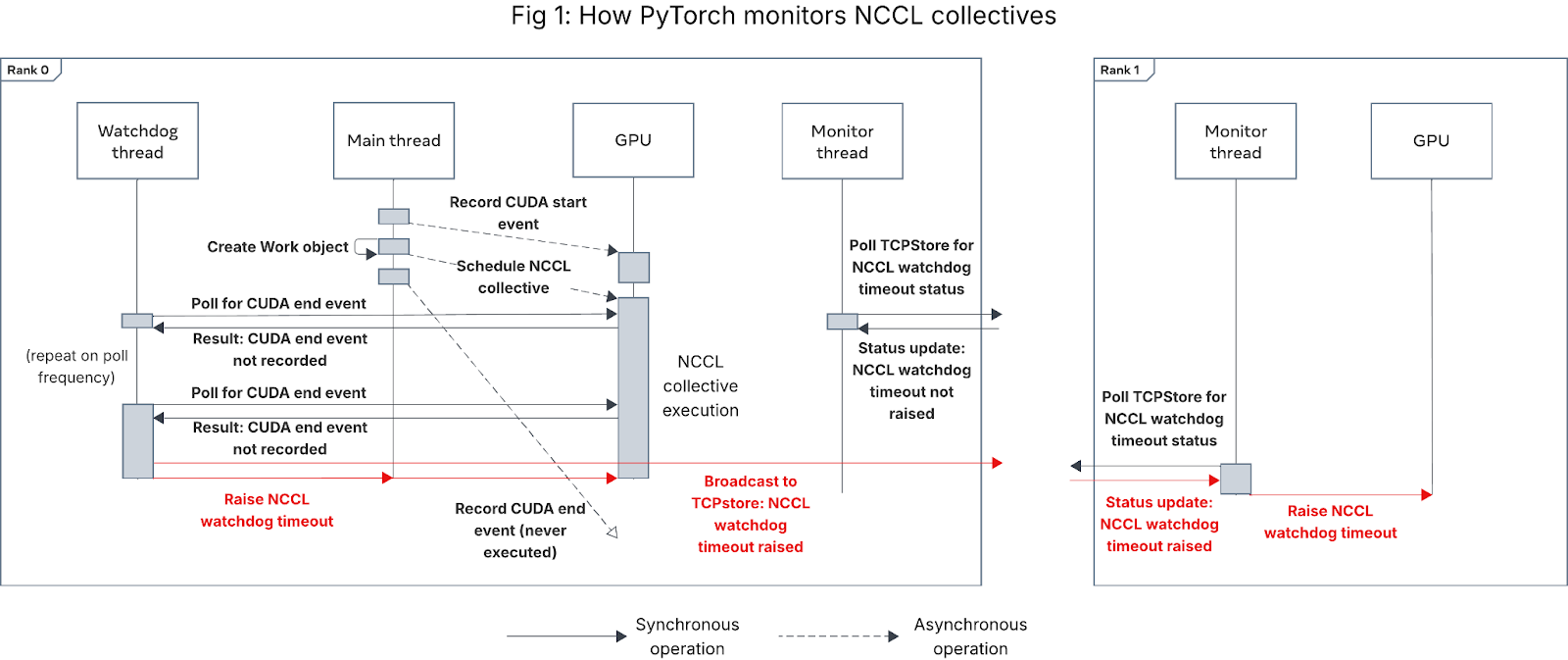

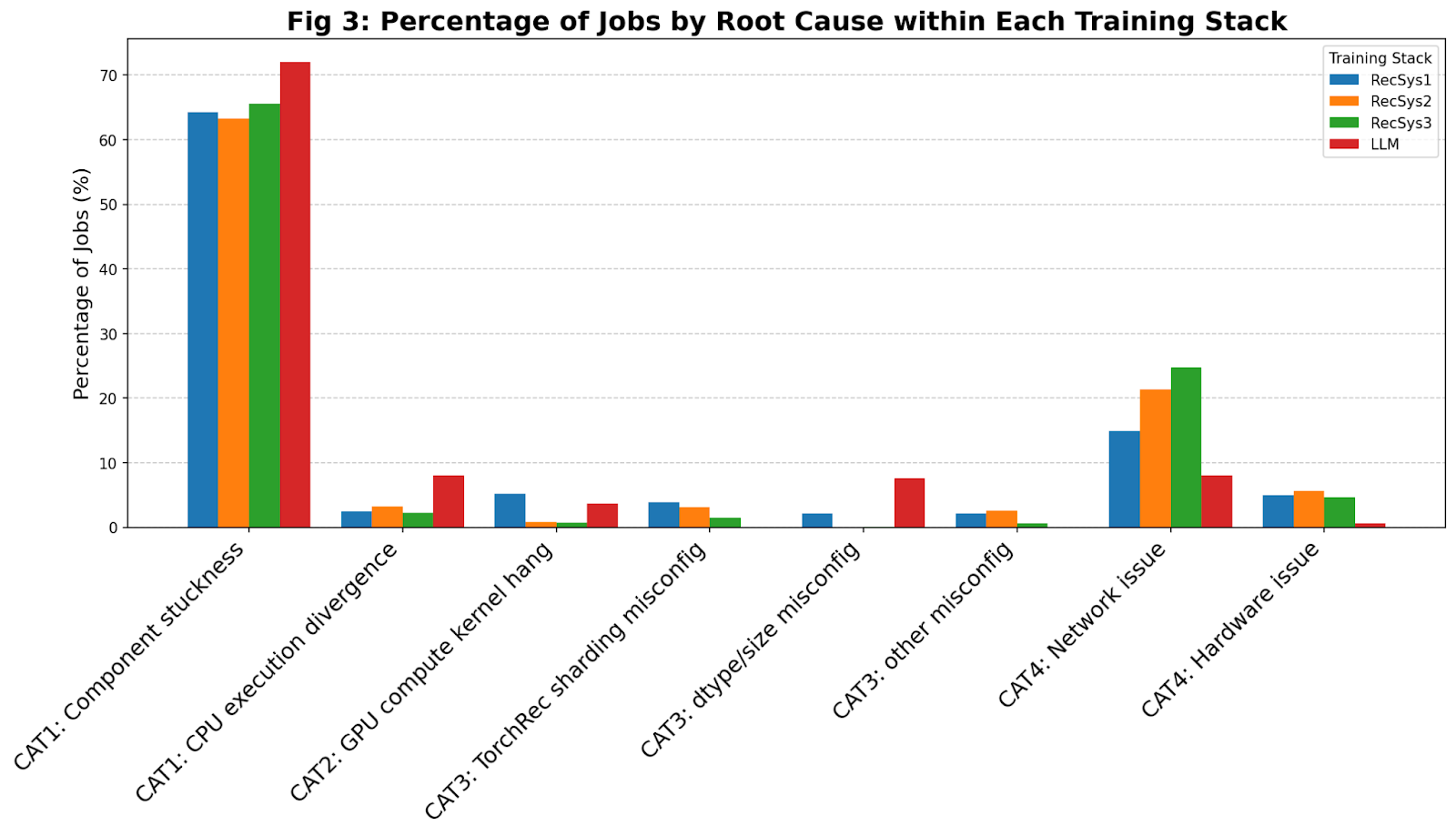

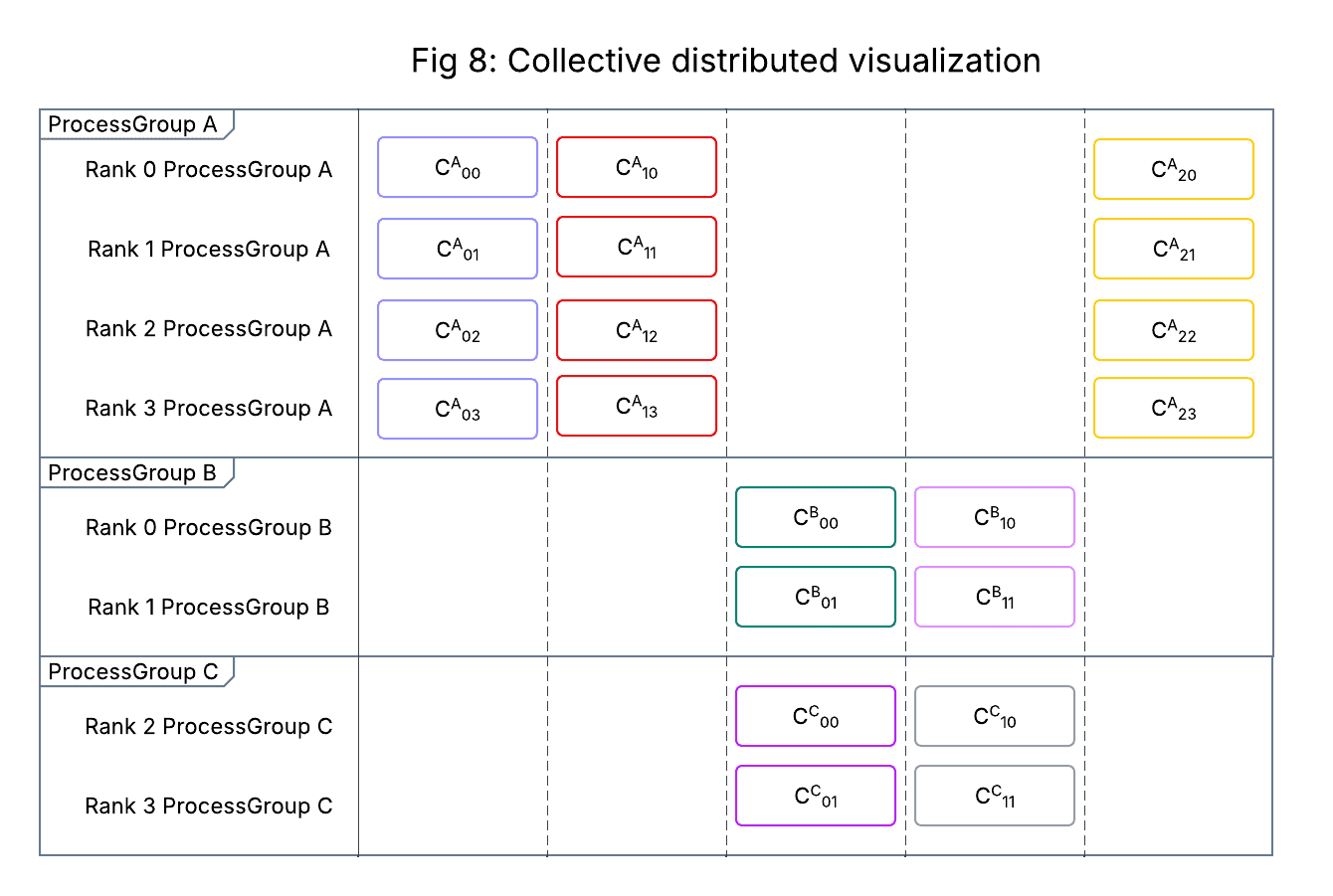

분산 학습 중 발생하는 NCCL watchdog timeout은 원인이 다양하고 에러 메시지가 불충분하여 디버깅이 매우 까다로운 문제이다. PyTorch는 이를 해결하기 위해 c10d 레이어 내부에 집합 통신(Collective)의 메타데이터와 콜 스택을 기록하는 Flight Recorder 기능을 구현했다. Meta의 조사 결과, 타임아웃의 60% 이상이 CPU 측의 작업 지연이나 실행 분기로 인한 집합 통신 불일치(Desync)에서 발생함이 확인됐다. Flight Recorder를 활용하면 각 랭크의 통신 상태를 시각화하고 정렬하여 병목 지점이나 코드의 논리적 오류를 신속하게 파악할 수 있다.

배경

PyTorch Distributed (c10d) 기초 지식, NCCL 집합 통신(All-Reduce, All-to-All 등) 개념, CUDA 프로그래밍 및 비동기 커널 실행 구조 이해

대상 독자

대규모 분산 학습 인프라를 운영하거나 PyTorch 기반 분산 학습 모델을 개발하는 엔지니어

의미 / 영향

이 기술은 분산 학습의 고질적인 문제인 통신 타임아웃 디버깅을 체계화하여 개발 생산성을 크게 향상시킨다. 특히 대규모 클러스터에서 발생하는 간헐적인 통신 오류의 원인을 데이터 기반으로 진단할 수 있게 함으로써 모델 학습의 안정성을 높이는 데 기여한다.

섹션별 상세

실무 Takeaway

- NCCL 타임아웃 발생 시 무작정 대기 시간을 늘리기보다 Flight Recorder를 활성화하여 랭크 간 집합 통신 호출 순서가 일치하는지 먼저 검증해야 한다.

- 분산 학습 코드 작성 시 데이터 의존적인 조건문이나 에러 핸들링 블록이 특정 랭크에서만 실행되어 집합 통신 호출을 건너뛰지 않도록 설계 단계에서 주의가 필요하다.

- TORCH_NCCL_DUMP_ON_TIMEOUT 환경 변수를 설정하여 타임아웃 발생 시 자동으로 진단 정보를 저장하도록 구성하면 재현 없이도 원인 파악이 가능하다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.