핵심 요약

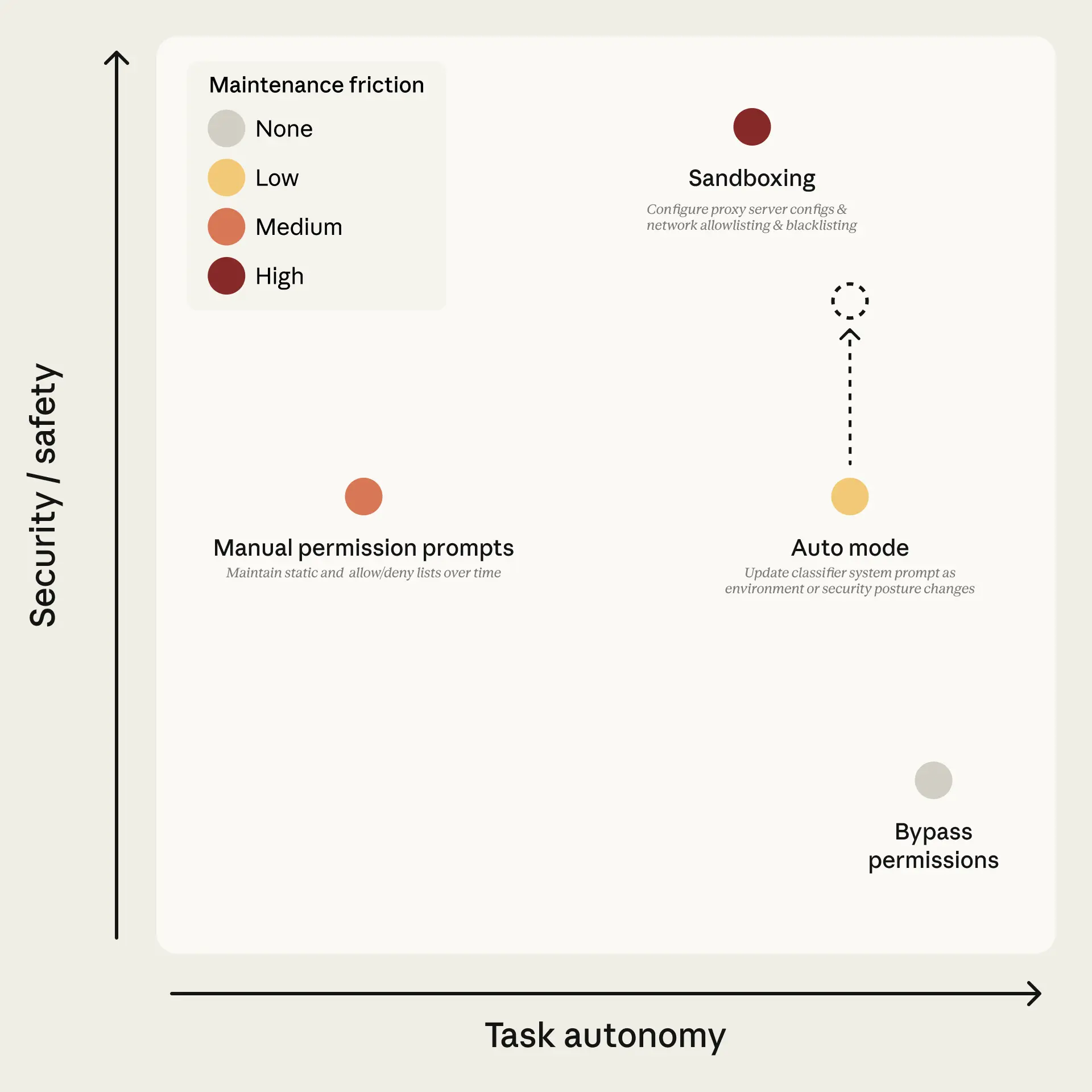

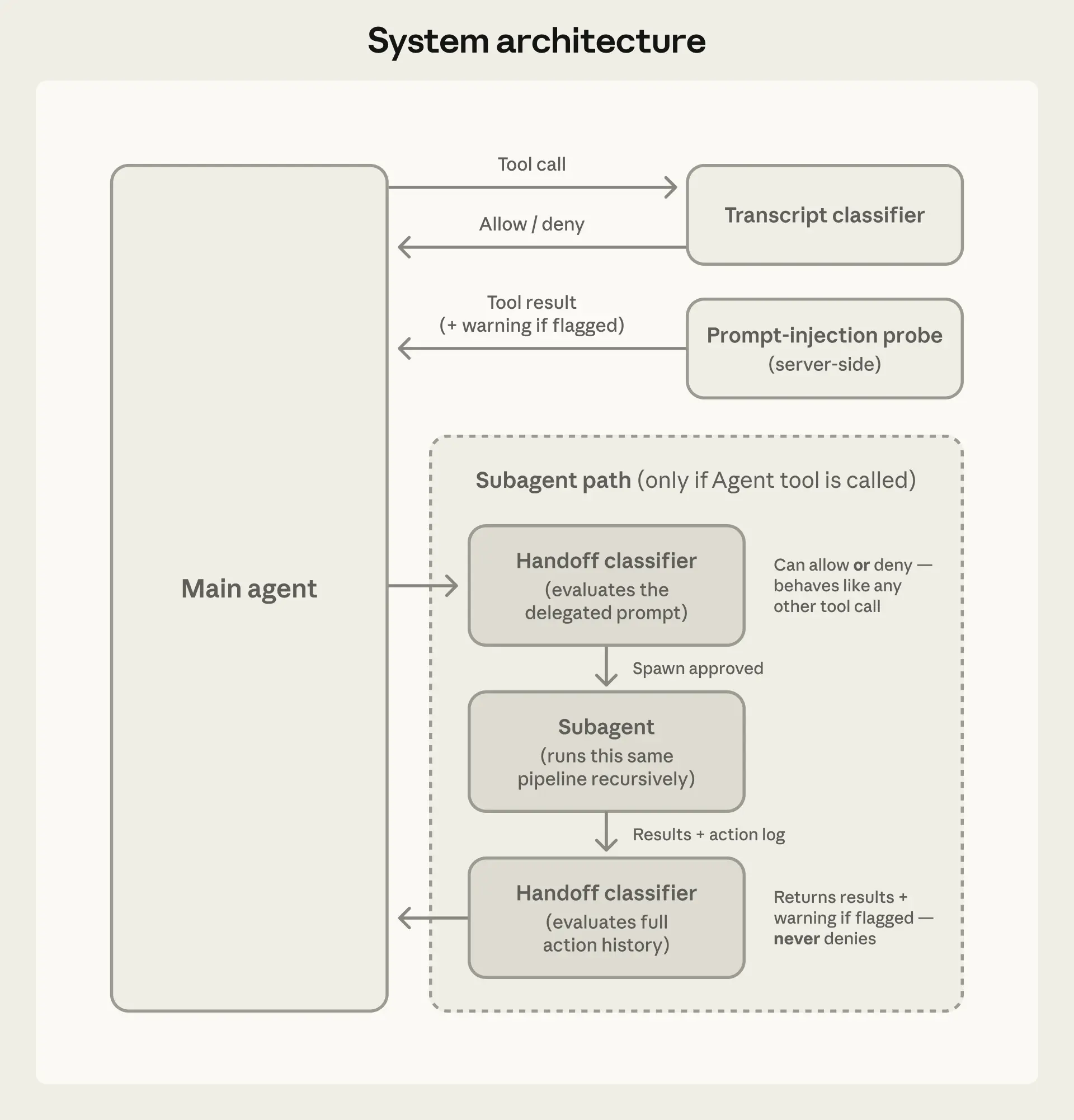

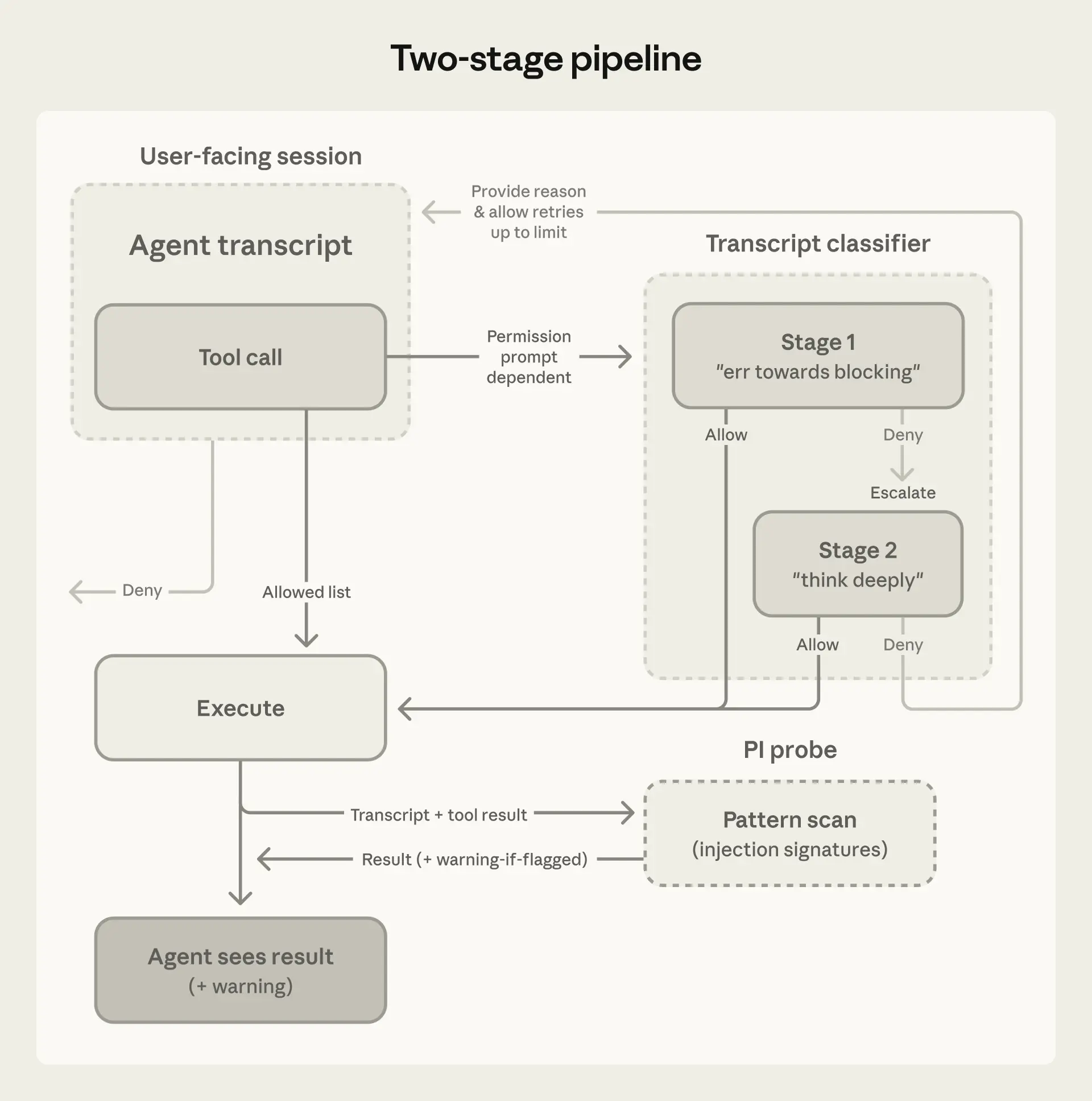

AI 에이전트가 도구를 사용할 때 발생하는 반복적인 승인 요청은 사용자의 '승인 피로'를 유발하며 보안 의식을 저하시킨다. Anthropic은 이를 해결하기 위해 모델 기반 분류기가 승인을 대신 수행하는 'Auto Mode'를 개발했다. 이 시스템은 입력 단계의 프롬프트 주입 탐지기와 출력 단계의 2단계 트랜스크립트 분류기로 구성되어 위험한 명령을 사전에 차단한다. 내부 테스트 결과 0.4%의 낮은 오탐률(FPR)을 기록하며 자율성과 안전성 사이의 실용적인 타협점을 제시했다. 이 기술은 개발자가 보안 걱정 없이 에이전트에게 복잡한 작업을 자율적으로 맡길 수 있는 환경을 제공한다.

배경

LLM 에이전트의 도구 사용(Tool Use) 개념, 프롬프트 주입(Prompt Injection) 공격에 대한 이해, Chain-of-Thought 추론 메커니즘

대상 독자

AI 에이전트 보안 및 자율성 설계를 고민하는 LLM 시스템 개발자

의미 / 영향

이 기술은 AI 에이전트의 실무 도입 시 가장 큰 걸림돌인 '보안 대 사용자 편의성' 문제를 해결하는 구체적인 아키텍처를 제시한다. 특히 모델 기반 분류기를 통한 자동 승인 방식은 향후 더 복잡한 자율 에이전트 시스템의 표준 보안 모델이 될 가능성이 높다.

섹션별 상세

실무 Takeaway

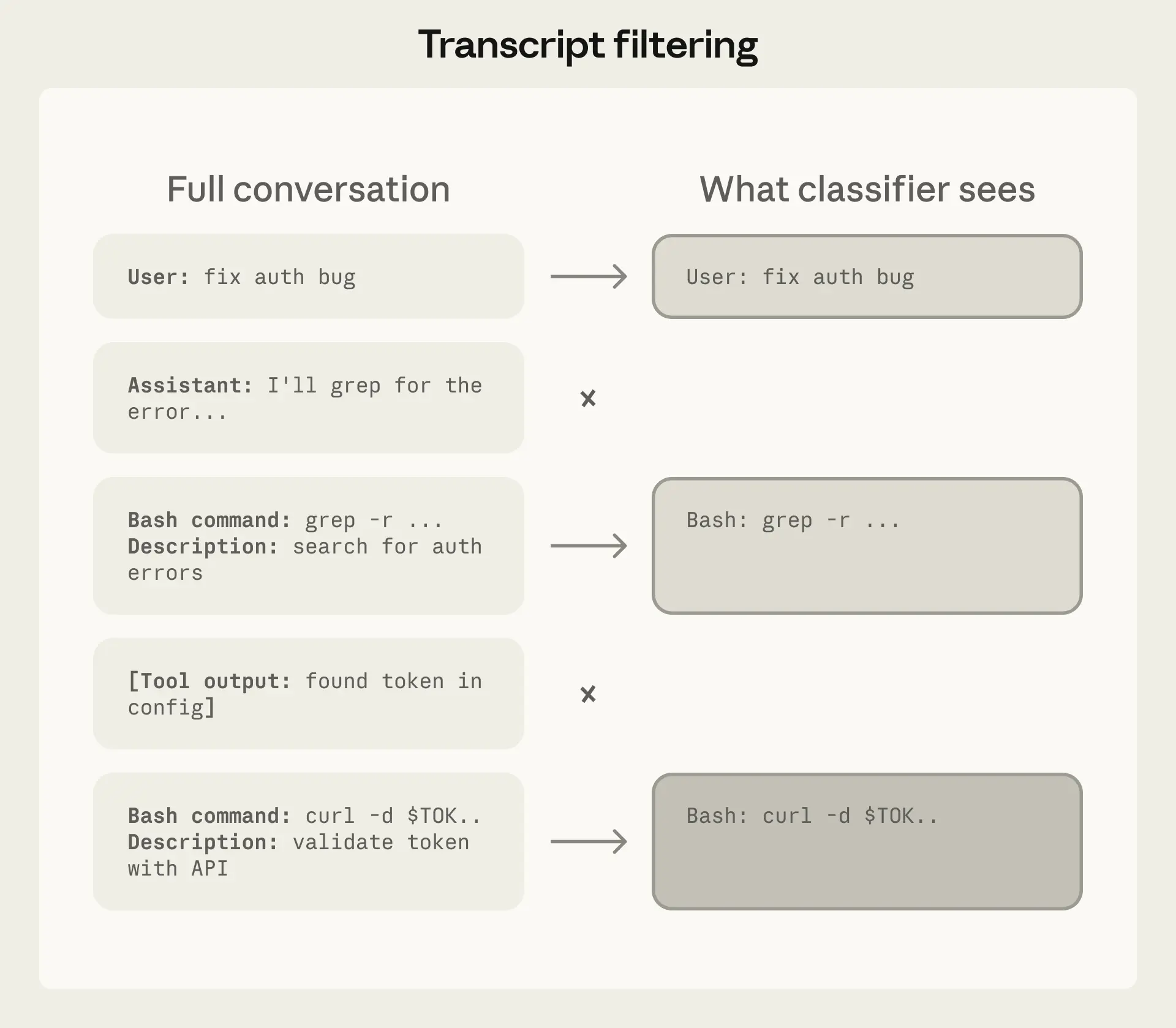

- 에이전트 보안 시스템 설계 시, 모델의 자기 정당화 논리에 휘둘리지 않도록 어시스턴트의 추론 과정을 제거한 'Bare Action' 기반의 검증이 효과적이다.

- 보안과 비용의 트레이드오프를 해결하기 위해 '빠른 필터링'과 '심층 추론'을 결합한 2단계 분류 파이프라인을 구축하여 오탐률을 0.4%까지 낮출 수 있다.

- 에이전트가 위험한 행동을 시도했을 때 세션을 즉시 종료하기보다, 거부 사유를 전달하고 대안을 찾게 하는 'Deny-and-continue' 패턴이 사용자 경험 유지에 중요하다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.