핵심 요약

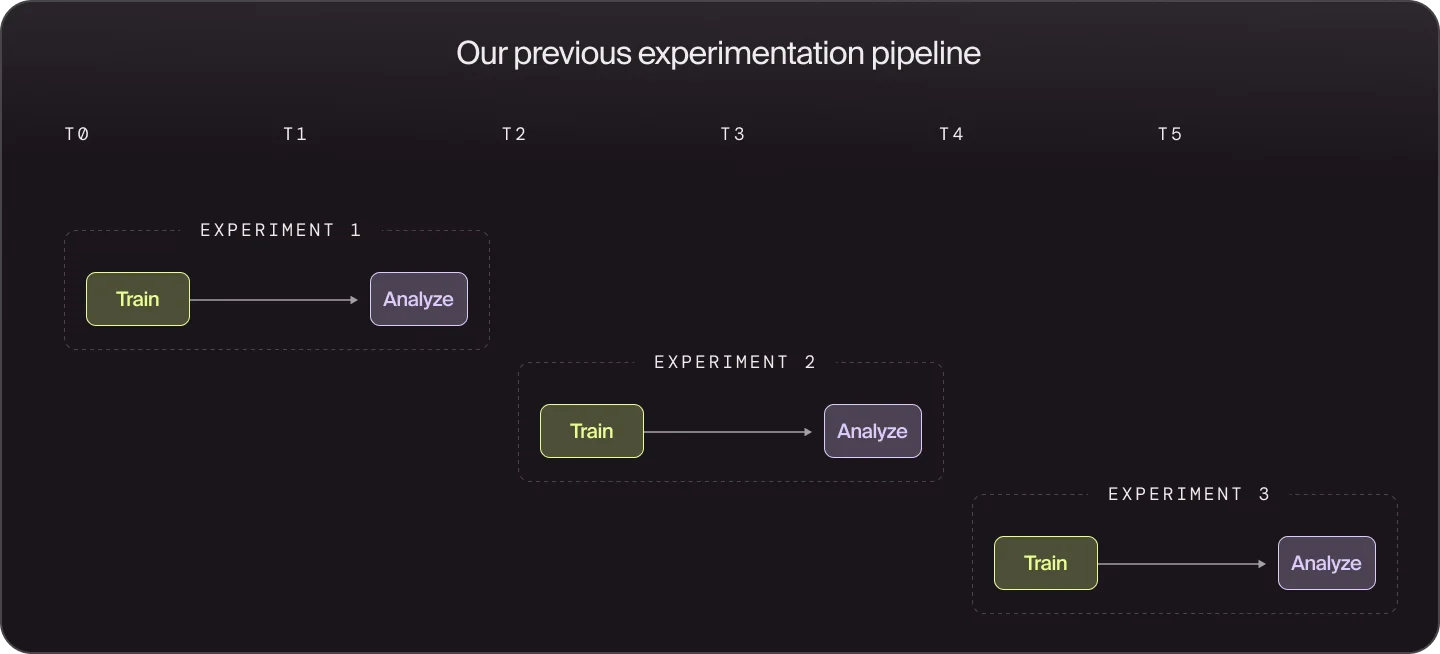

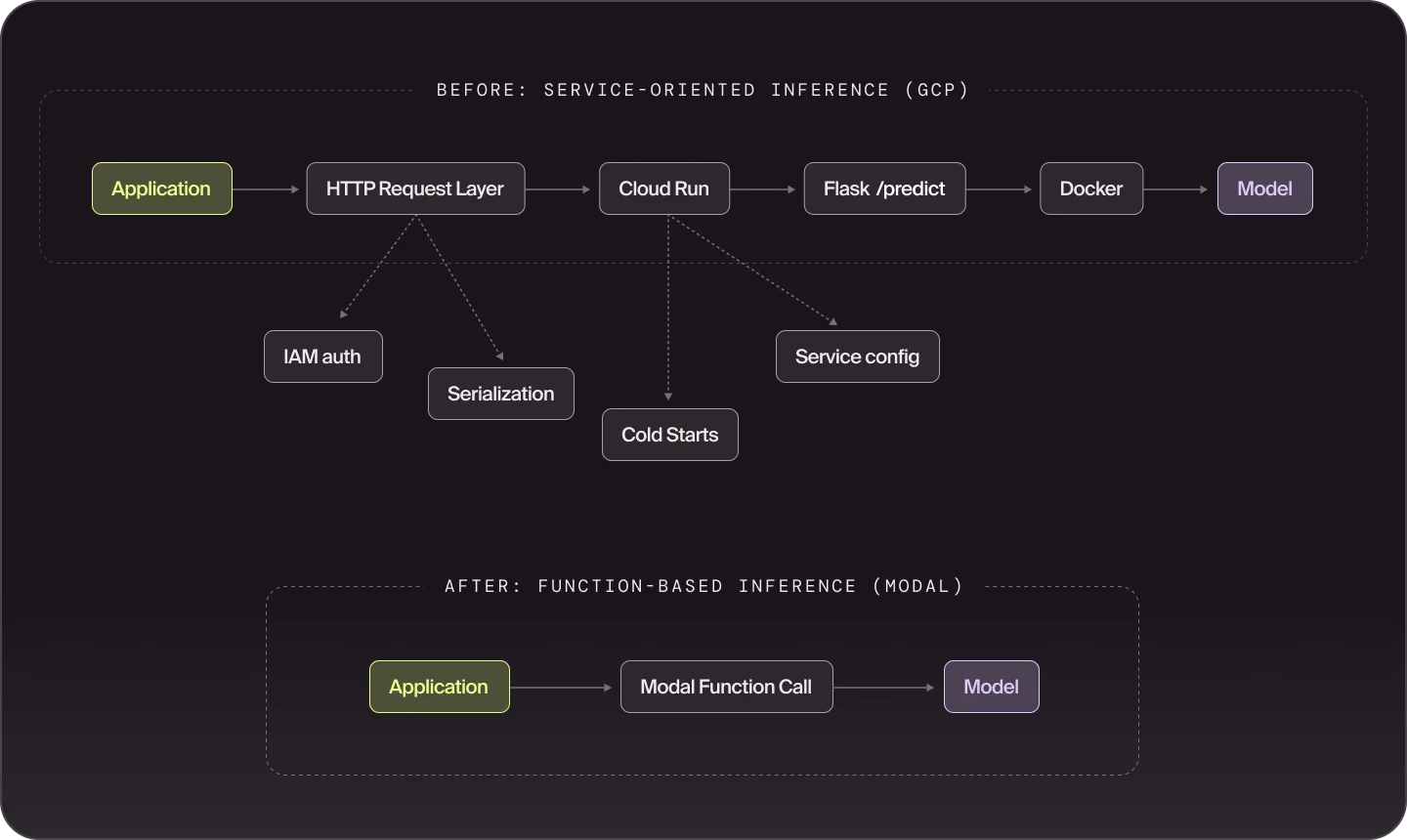

기존 Doppel의 ML 워크플로는 순차적인 실험 실행과 무거운 컨테이너 기반의 추론 배포로 인해 개발 속도가 정체되는 문제를 겪고 있었다. 이를 해결하기 위해 Modal의 서버리스 인프라로 마이그레이션하여 map() 함수 하나로 K-fold 교차 검증을 병렬화하고, 복잡한 오케스트레이션 없이 실험 루프를 가속화했다. 결과적으로 모델 빌드 시간이 최대 10배 단축되었으며, HTTP 서비스 레이어 없이 직접 함수를 호출하는 방식으로 추론 시스템을 단순화했다. 이 사례는 소규모 ML 팀이 인프라 관리 부담을 덜고 모델 개선이라는 본질적인 작업에 집중할 수 있음을 보여준다.

배경

Python, Docker/Container 기초, GCP/Cloud Run 경험, ML 학습 및 추론 파이프라인 이해

대상 독자

프로덕션 환경에서 ML 모델을 학습하고 배포하는 엔지니어 및 인프라 관리자

의미 / 영향

이 사례는 전통적인 클라우드의 컨테이너 기반 배포 방식보다 서버리스 ML 인프라가 소규모 팀의 생산성을 얼마나 높일 수 있는지 증명한다. 특히 인프라 관리 비용(Tax)을 줄이고 모델 고도화에 자원을 집중하려는 AI 네이티브 기업들에게 실질적인 아키텍처 가이드를 제공한다.

섹션별 상세

실무 Takeaway

- K-fold 교차 검증과 같은 독립적인 실험 단위를 Modal의 map() 함수로 병렬화하면 오케스트레이션 구축 비용 없이 실험 피드백 루프를 획기적으로 단축할 수 있다.

- Modal의 이미지 캐싱과 퍼시스턴트 볼륨 기능을 활용하면 대규모 모델의 빌드 및 배포 시간을 10분 이상에서 1분 미만으로 줄여 CI/CD 효율을 극대화할 수 있다.

- 서버리스 환경에서 모델 추론 함수를 직접 호출하는 방식을 채택함으로써 Flask나 HTTP 엔드포인트 관리에 필요한 불필요한 통합 코드(Boilerplate)를 제거할 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.