핵심 요약

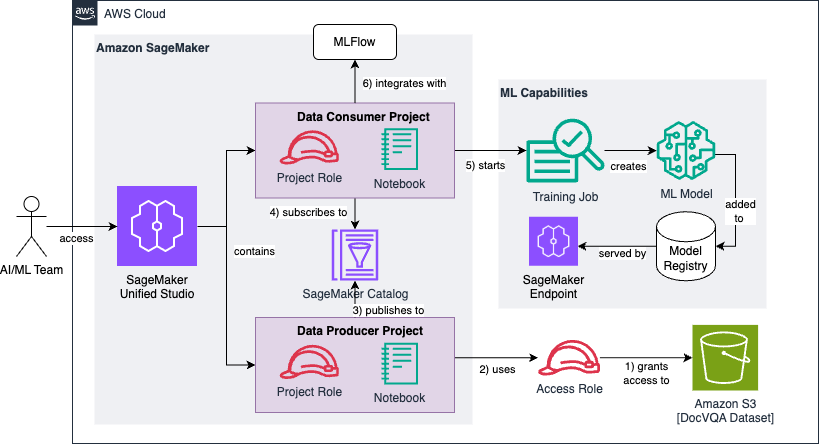

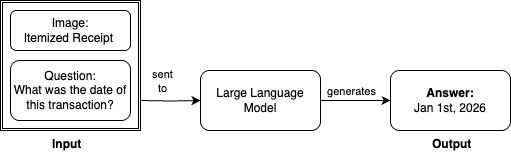

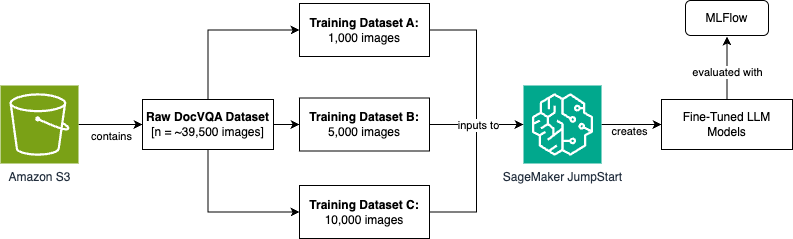

기업 내부에 산재한 비정형 데이터를 LLM 학습에 활용하려면 복잡한 데이터 이동과 권한 관리 문제를 해결해야 한다. Amazon SageMaker Unified Studio는 S3 일반 목적 버킷과의 통합을 통해 데이터 검색부터 카탈로그 게시, 프로젝트 간 구독까지의 과정을 단일 플랫폼에서 지원한다. Llama 3.2 11B Vision Instruct 모델을 DocVQA 데이터셋으로 파인튜닝한 결과, 10,000개의 이미지를 학습했을 때 ANLS 점수가 기본 모델의 85.3%에서 90.2%로 향상되었다. 이 방식은 S3 Access Grants를 통해 보안을 유지하면서도 데이터 생산자와 소비자 간의 협업 효율성을 극대화한다.

배경

AWS 계정 및 SageMaker Unified Studio 도메인 설정, 데이터 생산자 및 소비자 프로젝트 생성, DocVQA 데이터셋이 저장된 S3 버킷, p4de.24xlarge 인스턴스 사용을 위한 서비스 쿼타 확보

대상 독자

AWS 환경에서 LLM 파인튜닝과 데이터 파이프라인을 구축하는 ML 엔지니어 및 데이터 과학자

의미 / 영향

이 기술은 기업이 보유한 방대한 S3 비정형 데이터를 ML 워크플로우에 즉시 통합할 수 있게 하여 모델 개발 주기를 획기적으로 단축한다. 특히 보안이 강화된 S3 Access Grants와 통합 카탈로그를 통해 데이터 거버넌스를 유지하면서도 팀 간 협업을 원활하게 만든다.

섹션별 상세

AWS_ACCOUNT_ID = "123456789"

S3_BUCKET_NAME = "s3://MY_BUCKET_NAME/"

# Get credentials

result = !aws s3control get-data-access --account-id {AWS_ACCOUNT_ID} --target {S3_BUCKET_NAME} --permission READ

json_response = json.loads(result.s)

creds = json_response['Credentials']

# Configure profile with cell magic

!aws configure set aws_access_key_id {creds['AccessKeyId']} --profile access-grants-consumer-access-profileS3 Access Grants를 통해 임시 자격 증명을 획득하고 AWS CLI 프로필을 설정하는 과정

import os

from datasets import load_dataset

# Create data directory

os.makedirs("data", exist_ok=True)

# Load and save train split (first 10,000 rows)

train_data = load_dataset("HuggingFaceM4/DocumentVQA", split="train[:10000]", cache_dir="./data")

train_data.save_to_disk("data/train")Hugging Face에서 DocVQA 데이터셋을 로드하여 로컬 디렉토리에 저장하는 코드

def training_pipeline(training_size):

experiment_name = f"docvqa-{training_size}"

mlflow.set_experiment(experiment_name)

with mlflow.start_run(run_name="pipeline-run"):

with mlflow.start_run(run_name="TrainDeploy", nested=True) as run:

model_name = train(f"docvqa-{training_size}", "ml.p4d.24xlarge", training_data_path, experiment_name, run)MLflow를 사용하여 데이터 전처리, 학습, 배포 과정을 추적하는 파이프라인 정의

실무 Takeaway

- SageMaker Unified Studio의 통합 카탈로그를 사용하면 S3에 저장된 비정형 데이터를 복잡한 이동 없이 프로젝트 간에 안전하게 공유하고 관리할 수 있다.

- Llama 3.2 Vision 모델의 VQA 성능을 극대화하려면 DocVQA와 같은 특화 데이터셋으로 파인튜닝해야 하며, 데이터 규모가 커질수록 ANLS 점수가 유의미하게 상승한다.

- 서버리스 MLflow를 활용하면 별도의 인프라 구축 없이도 대규모 LLM 학습 실험의 지표와 아티팩트를 체계적으로 추적하고 비교 분석할 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.