핵심 요약

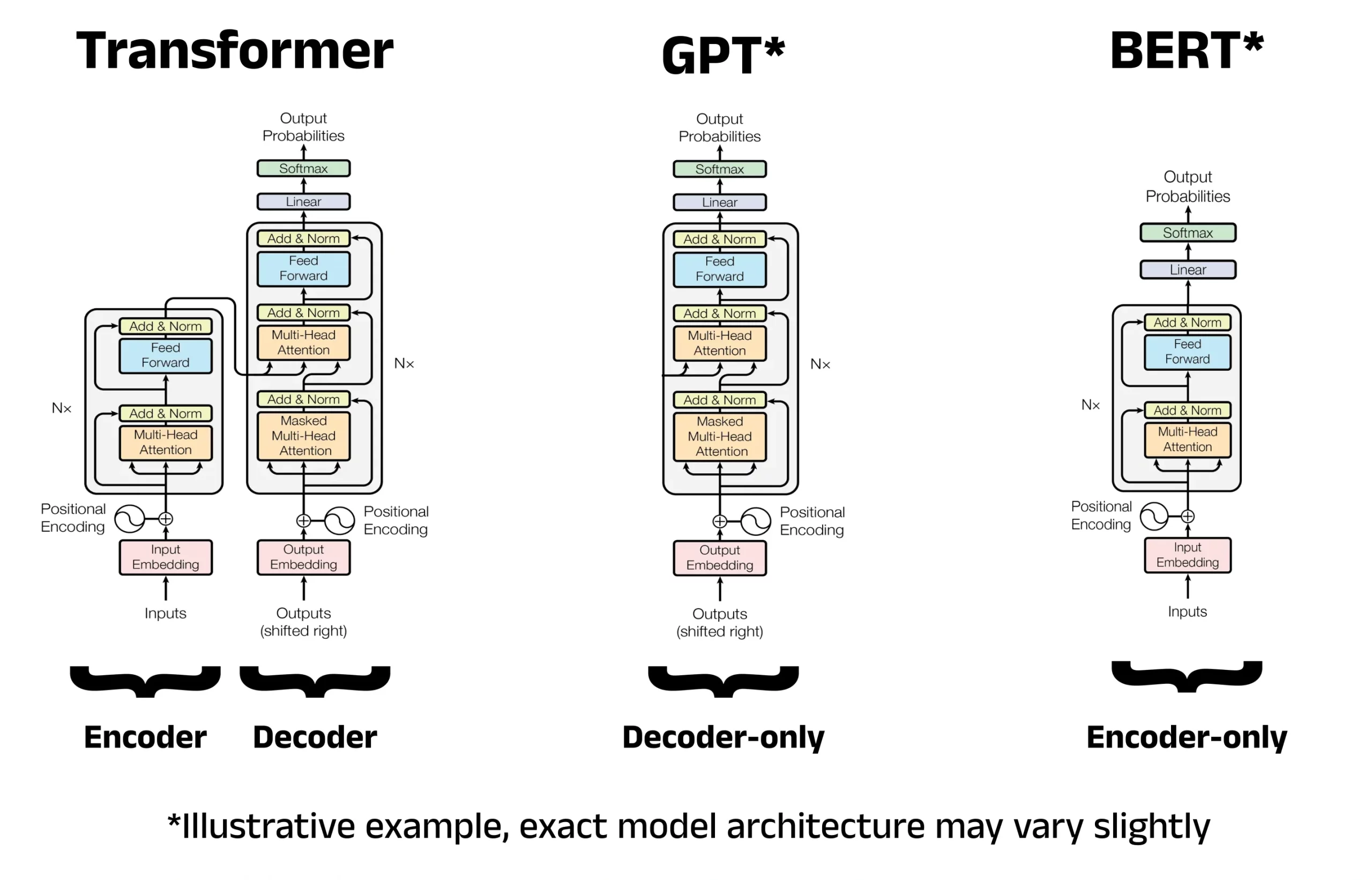

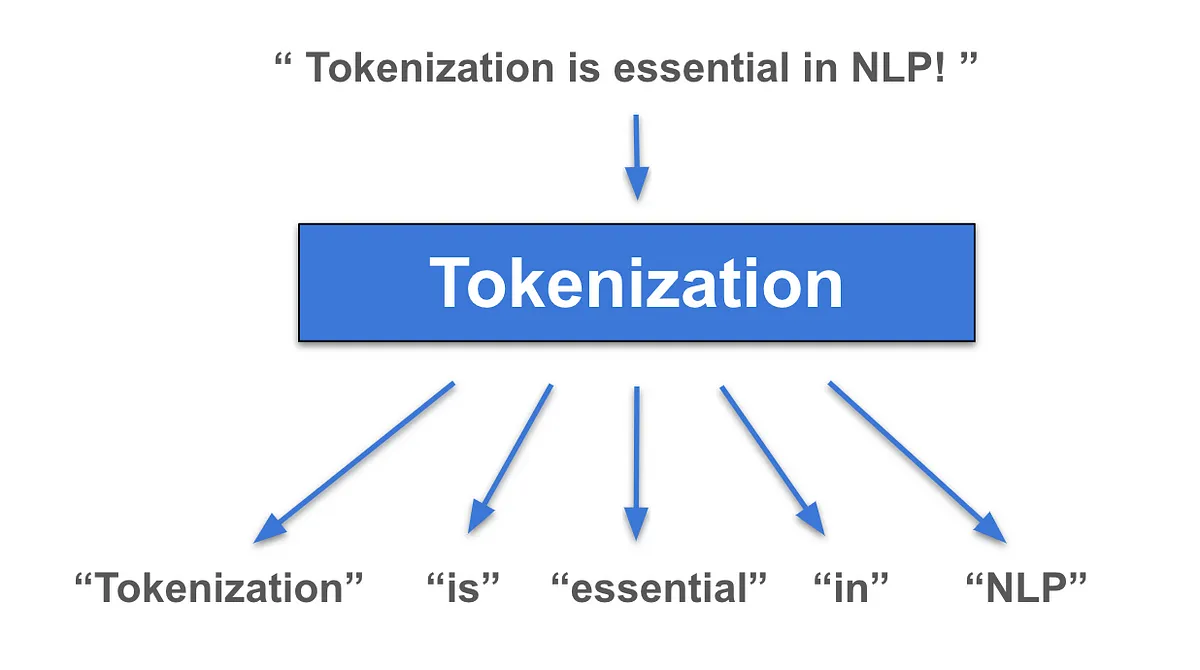

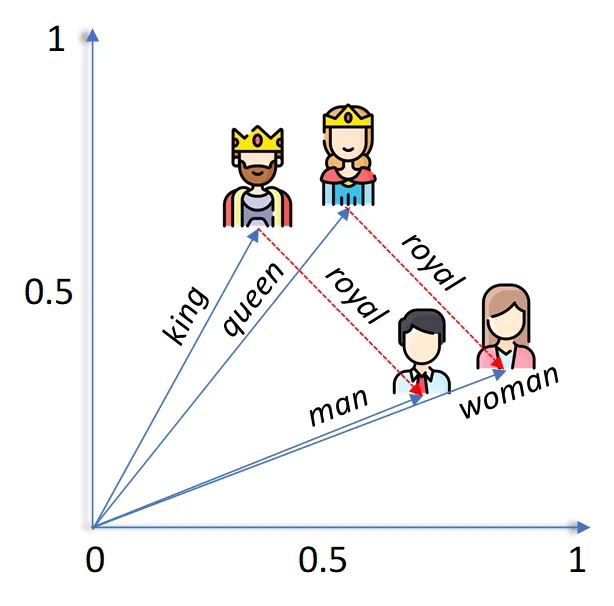

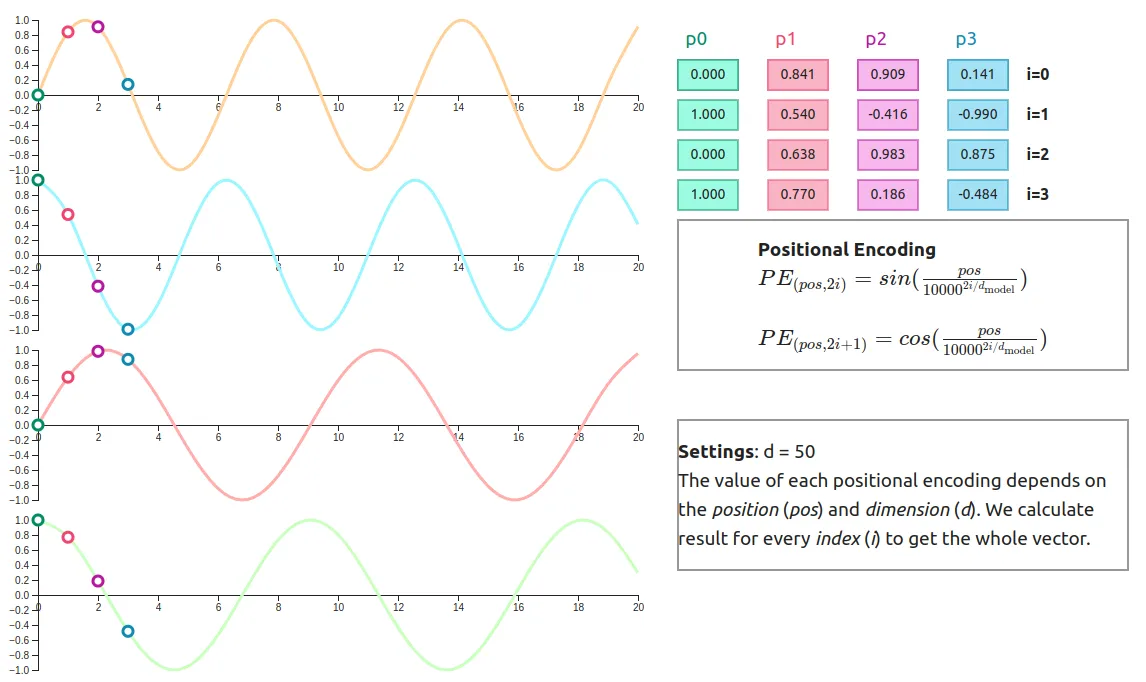

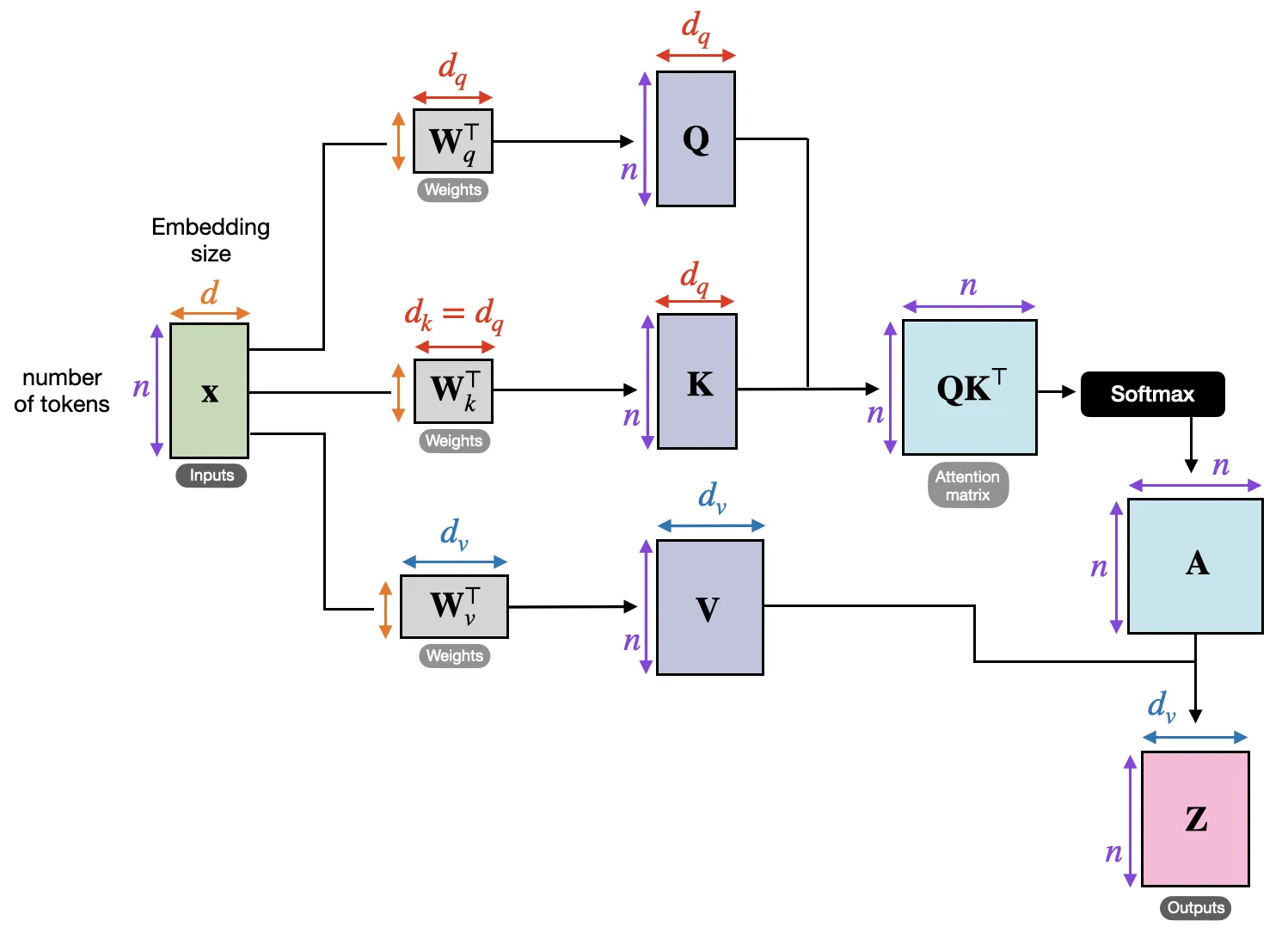

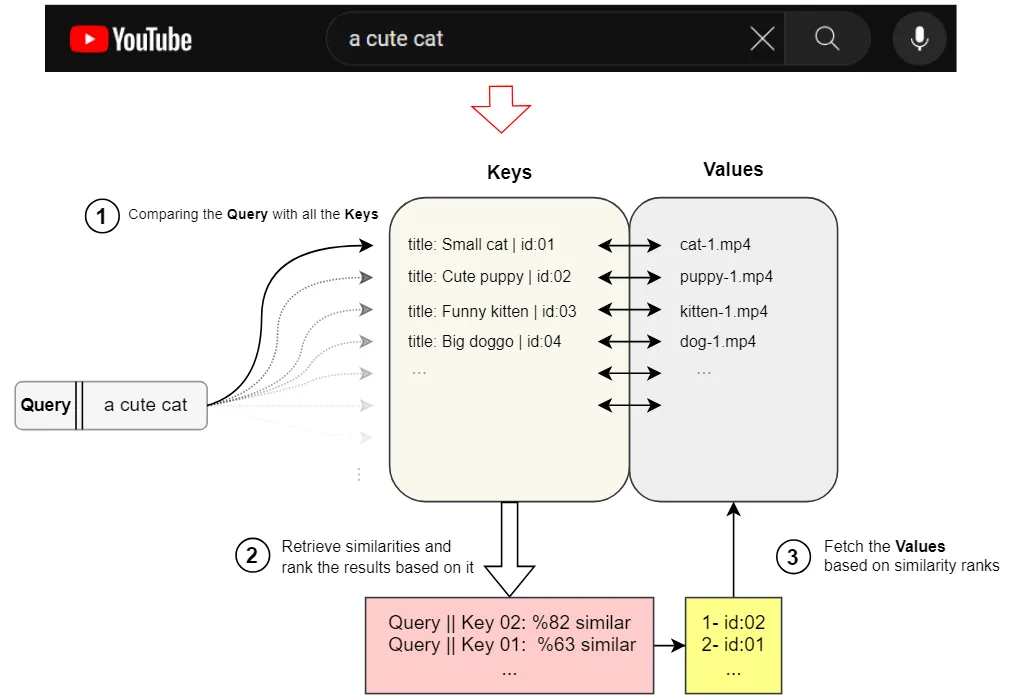

현대 자연어 처리의 표준인 트랜스포머 아키텍처는 병렬 처리를 통해 대규모 언어 모델의 효율적인 학습과 추론을 가능케 한다. 텍스트는 토큰화와 임베딩을 거쳐 고차원 벡터로 변환되며, 포지셔널 인코딩을 통해 단어의 순서 정보가 주입된다. 핵심 메커니즘인 셀프 어텐션은 Query, Key, Value 벡터를 활용해 문맥 내 단어 간 관계를 계산하고, 멀티 헤드 어텐션으로 다각적인 의미를 포착한다. 최종적으로 모델은 자기회귀 방식을 통해 다음 토큰을 확률적으로 예측하며 일관성 있는 텍스트를 생성한다. 이러한 구조적 혁신은 GPT, Claude, Gemini와 같은 최신 AI 시스템의 성능을 뒷받침하는 근간이 되었다.

배경

기초 선형대수 (벡터 및 행렬 연산), 기본적인 신경망 구조에 대한 이해, Python 프로그래밍 기초

대상 독자

트랜스포머 아키텍처의 내부 작동 원리와 LLM의 텍스트 생성 과정을 깊이 있게 이해하고자 하는 개발자 및 AI 학습자

의미 / 영향

트랜스포머는 순차적 연산의 한계를 극복하고 병렬 연산을 가능하게 함으로써 현대 AI의 폭발적인 성장을 이끌었다. 이 아키텍처의 확장성은 더 큰 모델과 더 긴 컨텍스트 처리를 가능하게 하여 GPT-4와 같은 고성능 모델 탄생의 기반이 되었다. 향후 모든 자연어 처리 및 멀티모달 AI 발전의 핵심 표준으로서 그 영향력은 지속될 전망이다.

섹션별 상세

실무 Takeaway

- 트랜스포머의 병렬 처리 구조는 GPU 자원을 극대화하여 대규모 데이터셋 학습 시간을 획기적으로 단축시킨다.

- 셀프 어텐션의 QKV 메커니즘을 이해하면 모델이 대명사 지칭이나 문맥적 중의성을 해결하는 논리적 과정을 파악할 수 있다.

- Temperature와 Top-P 같은 샘플링 파라미터 조정을 통해 실무에서 모델의 출력 품질과 창의성을 목적에 맞게 제어할 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.