핵심 요약

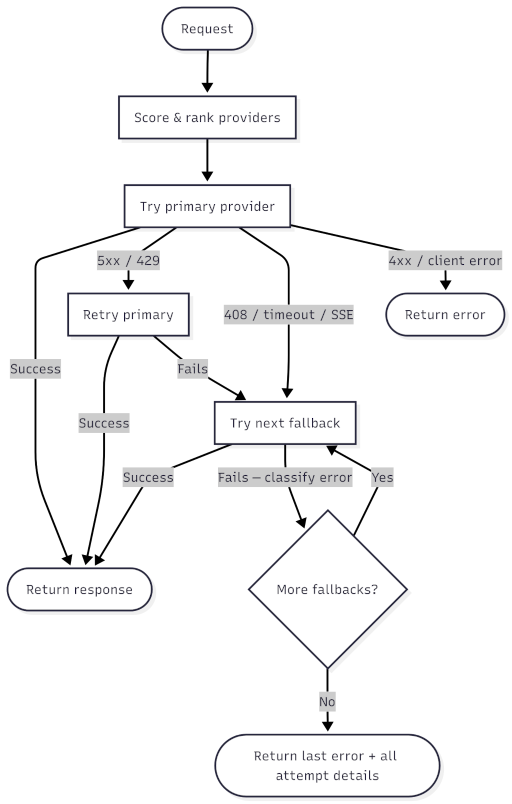

LLM 기반 서비스에서 API 제공업체의 장애는 사용자 경험에 직결되는 심각한 문제다. Edgee는 단순한 재시도를 넘어 에러를 세 가지 범주(재시도 후 폴백, 즉시 폴백, 즉시 에러 반환)로 분류하여 효율적인 복구 프로세스를 수행한다. 실시간 성공률에 기반한 프로바이더 스코어링 시스템을 통해 최적의 대체 수단을 선택하며, 특히 스트리밍 응답의 경우 데이터 일관성을 위해 첫 번째 청크 전송 전까지만 폴백을 허용하는 설계를 채택했다. 이를 통해 개발자는 별도의 코드 수정 없이도 높은 가용성과 투명한 모니터링 환경을 확보할 수 있다.

배경

LLM API 호출 및 HTTP 상태 코드에 대한 이해, 서버 전송 이벤트(SSE) 및 스트리밍 응답 개념

대상 독자

프로덕션 환경에서 LLM API를 호출하는 백엔드 개발자 및 인프라 엔지니어

의미 / 영향

이 시스템은 LLM 서비스의 가용성을 획기적으로 높여 특정 API 제공업체의 장애가 서비스 전체의 중단으로 이어지는 것을 방지한다. 특히 멀티 프로바이더 전략을 코드 수정 없이 구현할 수 있게 함으로써 운영 효율성을 극대화한다.

섹션별 상세

실무 Takeaway

- LLM API의 5xx 에러는 1회 재시도 후 즉시 다른 프로바이더로 폴백하여 사용자 지연 시간을 방지해야 한다.

- 스트리밍 API 설계 시 데이터 일관성을 위해 첫 번째 청크 전송 이후에는 폴백을 중단하고 에러를 노출하는 것이 안전하다.

- 지역별(Datacenter) 성능 편차를 고려한 프로바이더 스코어링을 적용하여 글로벌 서비스의 응답 신뢰성을 최적화할 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.