핵심 요약

대규모 데이터 큐레이션이나 합성 데이터 생성과 같은 배치 추론 작업에서는 개별 지연 시간보다 전체 처리량이 중요하다. 기존 vLLM의 오프라인 API나 동기식 Ray Data 통합 방식은 메모리 부족(OOM)이나 리소스 유휴 상태(Pipeline Bubbles) 문제를 겪는다. Ray Data LLM은 vLLM의 비동기 엔진과 Ray의 분산 스트리밍을 결합하여 이 문제를 해결한다. 이를 통해 하드웨어 활용도를 극대화하고, 추론 과정에서 발생하는 오류에 대한 복원력을 갖춘 프로덕션급 파이프라인을 구축할 수 있다.

배경

Ray 프레임워크에 대한 기본 지식, vLLM 추론 엔진의 작동 원리 이해, Python 데이터 처리 라이브러리(Pandas 등) 사용 경험

대상 독자

프로덕션 환경에서 대규모 LLM 배치 추론 및 데이터 처리를 수행하는 ML 엔지니어

의미 / 영향

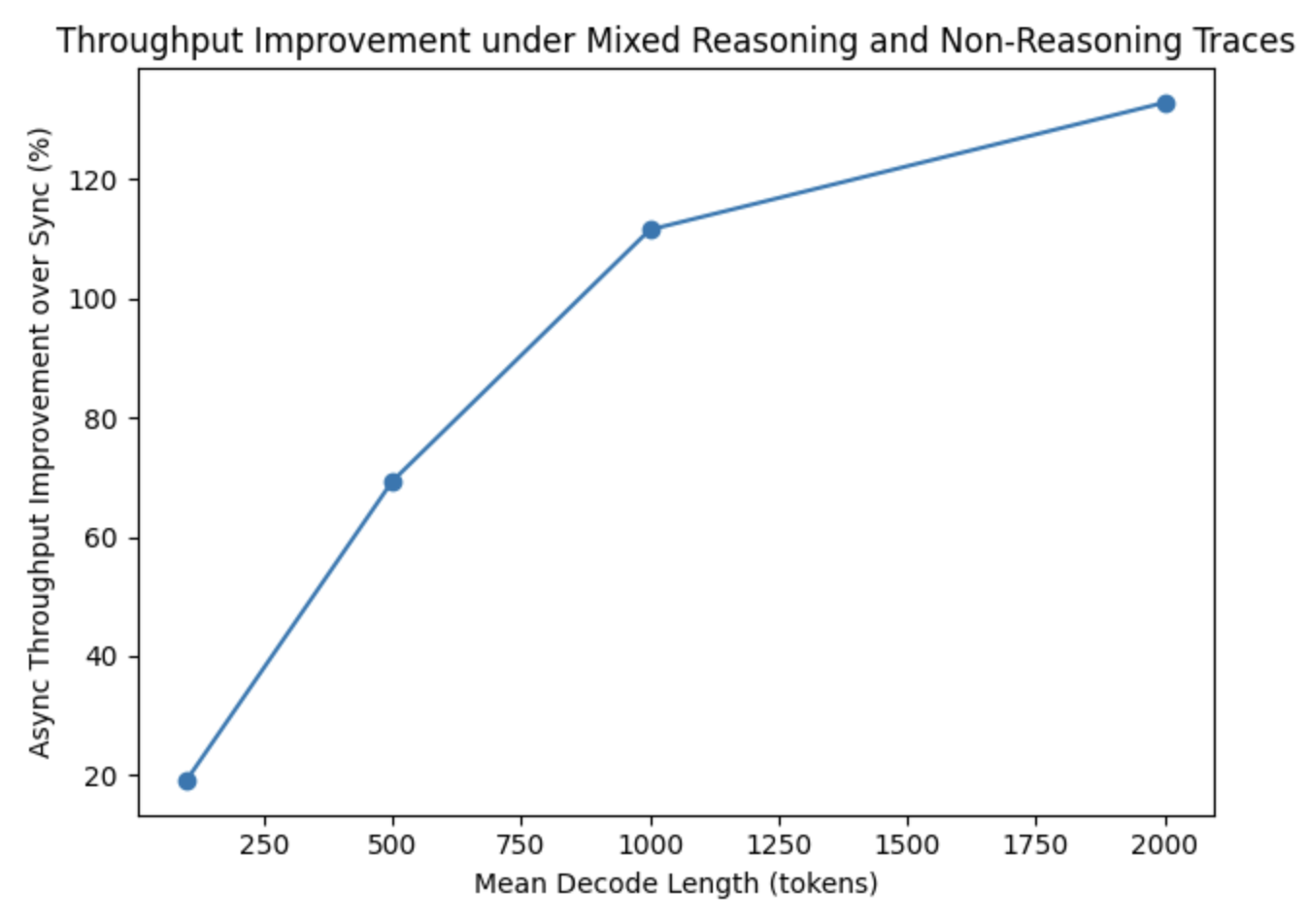

이 기술은 LLM을 활용한 데이터 라벨링, 합성 데이터 생성 비용을 획기적으로 낮출 수 있다. 특히 추론 시간이 긴 최신 추론 모델(Reasoning Models)의 배치 처리 효율을 2배 이상 높여 인프라 비용 절감에 기여한다.

섹션별 상세

기존 vLLM 오프라인 API는 전체 데이터셋을 CPU 메모리에 로드해야 하므로 대규모 데이터 처리 시 메모리 부족(OOM)이 발생하며 분산 실행 기능이 부족하다.

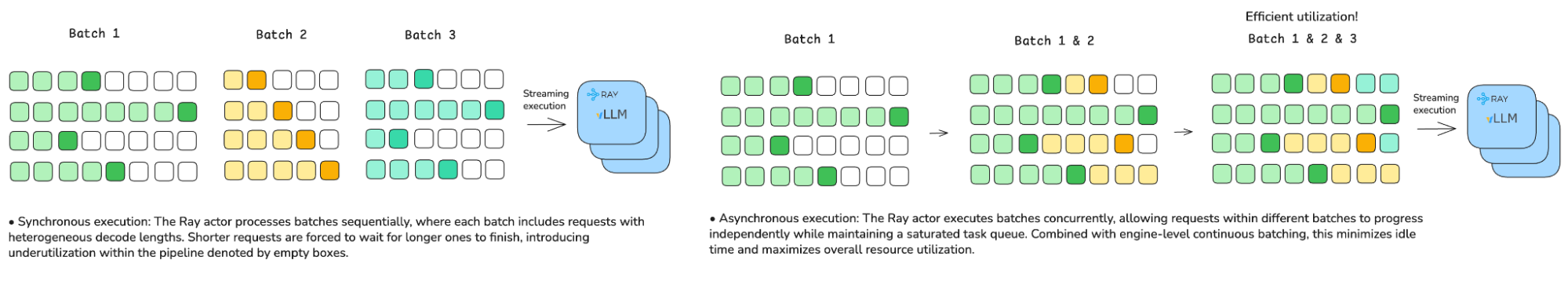

Ray Data와 동기식 vLLM을 결합한 방식은 스트리밍 처리를 통해 OOM은 해결하지만, 배치의 모든 요청이 완료될 때까지 다음 작업이 대기하는 동기적 병목 현상으로 인해 GPU 활용도가 떨어진다.

Ray Data LLM은 vLLM의 비동기 엔진을 활용하여 배치 수준과 엔진 수준 모두에서 비동기 실행을 구현함으로써 GPU를 지속적으로 포화 상태로 유지한다.

토큰화(Tokenization)와 추론 단계를 분리하여 CPU와 GPU 자원을 독립적으로 할당하며, 특정 요청 실패 시 전체 작업을 중단하지 않고 오류를 기록하는 행 단위(Row-level) 복원력을 제공한다.

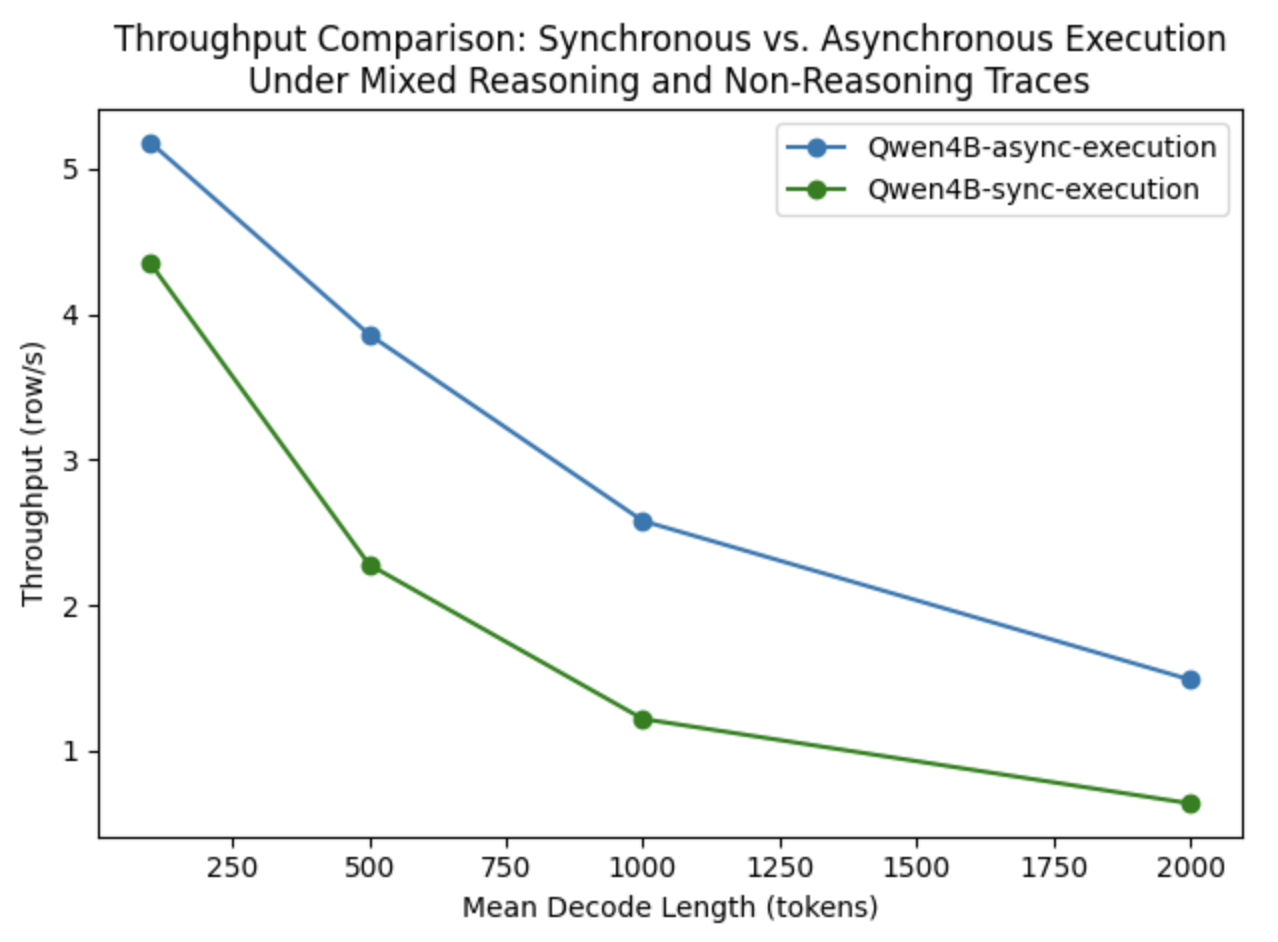

Qwen-4B 모델을 이용한 벤치마크 결과, 생성 토큰 길이가 길고 가변적인 추론(Reasoning) 작업에서 비동기 방식이 동기 방식 대비 최대 2배 이상의 처리량 향상을 기록했다.

실무 Takeaway

- 대규모 배치 추론 시 vLLM의 동기 API 대신 Ray Data LLM의 비동기 엔진을 사용하여 GPU 활용률을 극대화해야 한다.

- 추론 토큰 길이가 가변적인 '추론(Reasoning)' 모델 작업에서 비동기 실행의 처리량 이득이 가장 크게 나타나므로 해당 워크로드에 우선 적용을 권장한다.

- 프로덕션 환경에서는 행 단위 오류 처리 기능을 활용해 데이터셋 내의 일부 불량 데이터로 인해 전체 배치 작업이 실패하는 것을 방지할 수 있다.

언급된 리소스

API DocsRay Data LLM Documentation

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료