핵심 요약

기업용 AI 시스템은 단일 모델의 한계를 넘어 복잡한 추론과 도구 사용이 가능한 자율 에이전트로 진화하는 추세이다. Hugging Face의 smolagents 라이브러리를 AWS 관리형 서비스와 통합하여 의료용 AI 에이전트를 구축하는 아키텍처가 제시되었다. SageMaker AI, Amazon Bedrock, 컨테이너화된 모델 서버를 백엔드로 활용하여 상황에 맞는 최적의 모델을 선택하며, OpenSearch를 통한 벡터 검색으로 전문 지식을 보완한다. 보안과 확장성을 갖춘 도메인 특화 에이전트 솔루션 구현이 가능하다.

배경

AWS 계정 및 IAM 권한 관리 지식, Python 3.10 이상 환경, Docker 설치 및 컨테이너 기본 지식, LLM 에이전트 및 RAG(검색 증강 생성)에 대한 기본 개념

대상 독자

AWS 환경에서 보안이 강화된 LLM 에이전트를 구축하고 배포하려는 ML 엔지니어 및 솔루션 아키텍트

의미 / 영향

이 아키텍처는 기업이 오픈소스 라이브러리와 관리형 클라우드 서비스를 결합하여 보안이 강화된 맞춤형 AI 에이전트를 빠르게 프로덕션에 배포할 수 있는 표준 모델을 제시한다. 특히 의료와 같이 규제가 엄격한 분야에서 AI 도입의 기술적 장벽을 낮추는 데 기여할 것이다.

섹션별 상세

이미지 분석

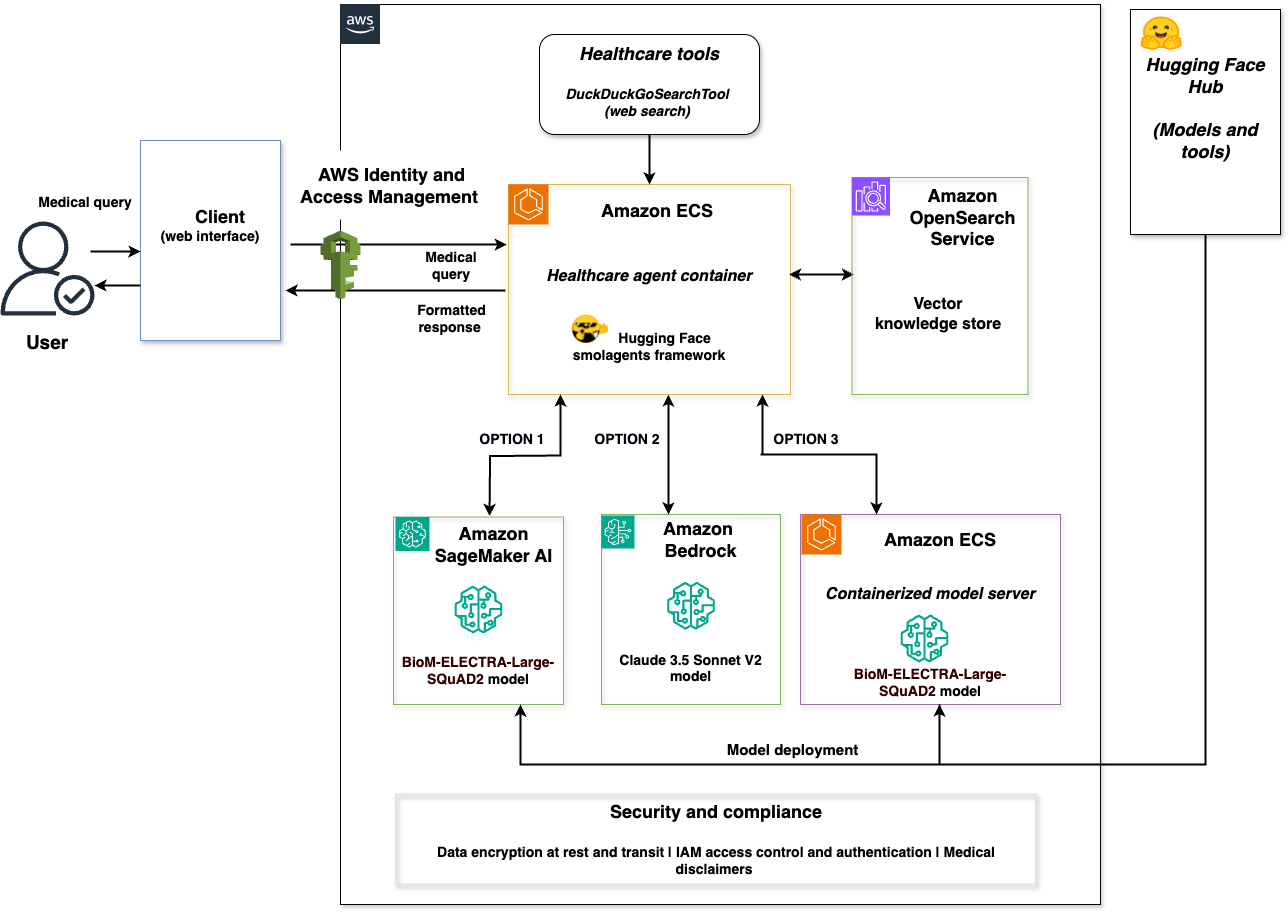

사용자 질의가 ECS 컨테이너의 에이전트로 전달된 후, OpenSearch 벡터 저장소에서 지식을 검색하고 SageMaker, Bedrock, 또는 컨테이너 모델 서버 중 하나를 선택해 추론하는 전체 흐름을 보여준다. 보안 계층(IAM)과 데이터 암호화가 시스템 전반에 적용되어 있음을 명시한다.

AWS 서비스와 smolagents 프레임워크가 통합된 의료용 AI 에이전트의 전체 아키텍처 다이어그램이다.

실무 Takeaway

- smolagents의 CodeAgent 방식을 사용하면 복잡한 JSON 파싱 없이 Python 코드로 에이전트의 행동을 정의하여 실행 효율성을 극대화할 수 있다.

- 단일 모델에 의존하지 않고 SageMaker(특화 모델)와 Bedrock(범용 고성능 모델)을 혼합 사용하는 멀티 백엔드 전략으로 비용과 성능을 최적화해야 한다.

- OpenSearch와 같은 벡터 DB를 통합하여 도메인 지식을 실시간으로 주입함으로써 에이전트 답변의 신뢰성과 전문성을 확보하는 것이 필수적이다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료