핵심 요약

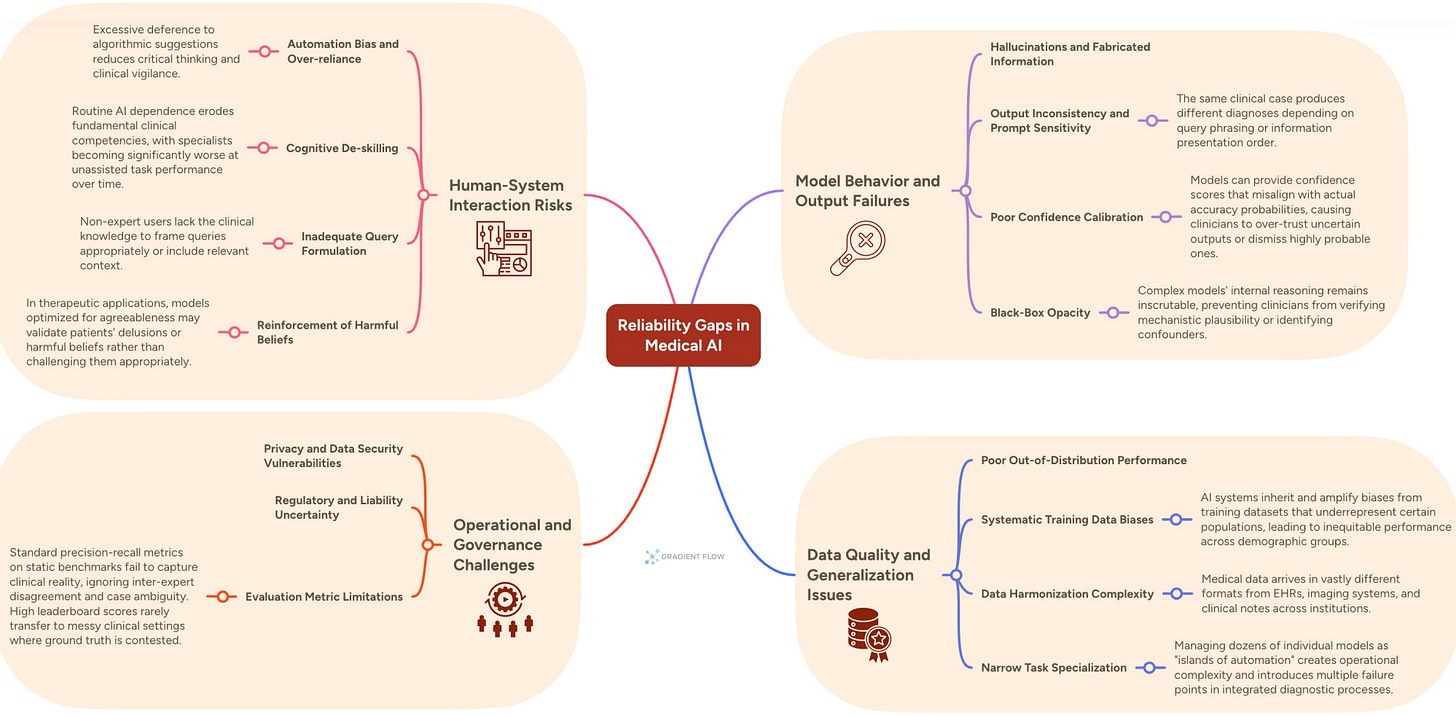

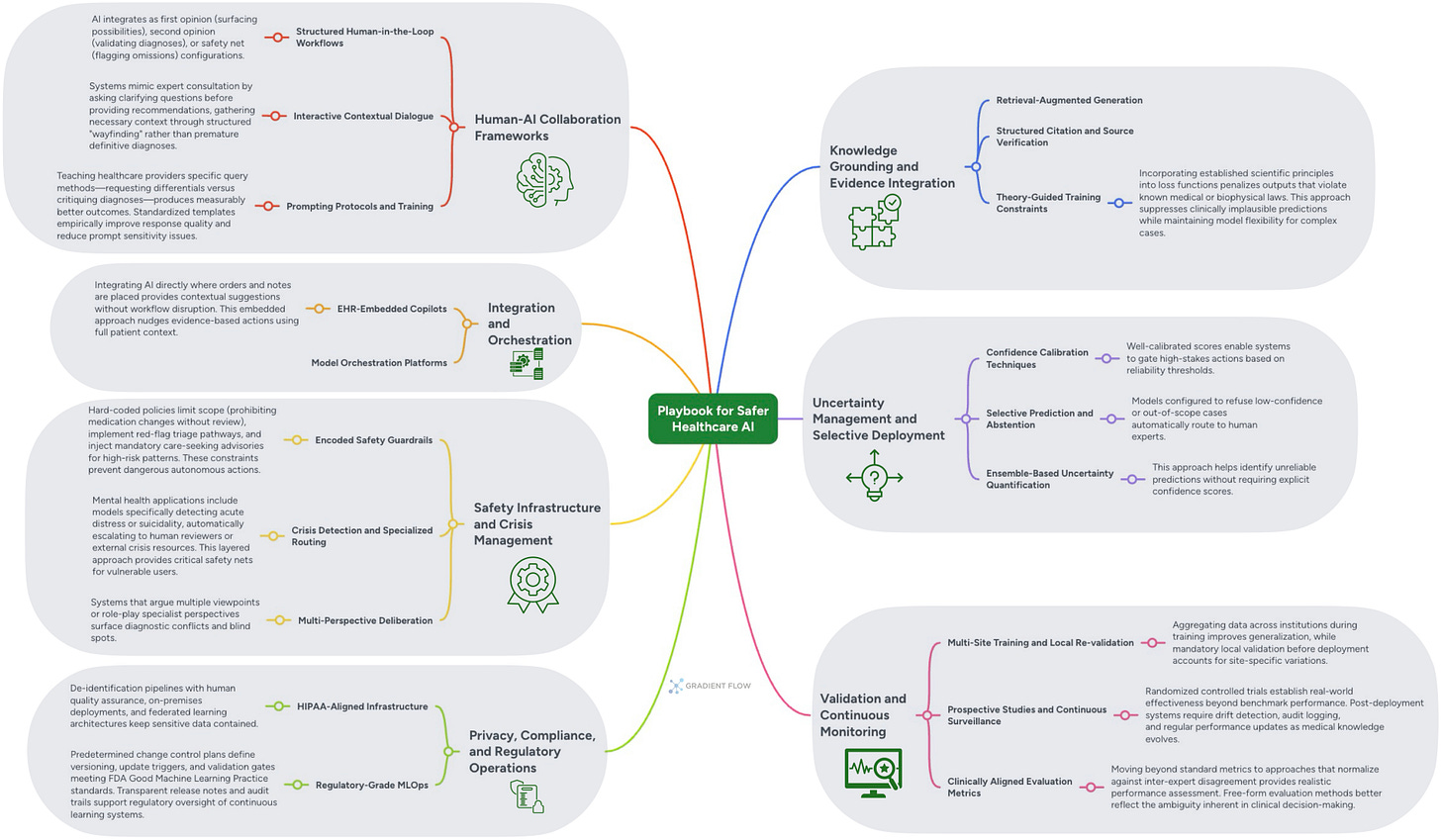

많은 기업용 AI 프로젝트가 벤치마크에서는 우수한 성적을 거두지만 실전 배포 시 취약한 워크플로우와 통합 실패로 인해 생산 단계에 도달하지 못하고 있다. 특히 의료 AI 분야의 사례는 할루시네이션, 프롬프트 민감도에 따른 출력 불일치, 인간의 자동화 편향 및 인지 능력 저하와 같은 치명적인 신뢰성 결함을 보여준다. 이를 해결하기 위해 지식 접지(RAG), 불확실성 기반의 답변 거부(Abstention), 구조화된 인간 협업 프레임워크 등의 구체적인 대응 전략이 필요하다. AI 시스템의 성공은 최고 성능 최적화가 아닌 예측 가능한 동작 설계에 달려 있으며, 이는 금융, 법률 등 모든 산업 분야에 공통적으로 적용되는 원칙이다.

배경

LLM 할루시네이션 및 프롬프트 엔지니어링에 대한 기본 이해, RAG(검색 증강 생성)의 작동 원리, 모델 평가 지표 및 벤치마크의 한계점에 대한 인식

대상 독자

프로덕션 환경에 LLM을 배포하려는 엔지니어, 데이터 과학자 및 AI 제품 관리자

의미 / 영향

AI 모델의 성능 경쟁이 포화 상태에 이르면서 이제는 '신뢰성 엔지니어링'이 기업용 AI 도입의 핵심 차별화 요소가 될 것이다. 의료 분야에서 검증된 신뢰성 패턴들은 금융, 법률, 제조 등 오류 비용이 큰 모든 산업 분야의 표준 배포 프로세스로 자리 잡을 것으로 전망된다.

섹션별 상세

이미지 분석

저자가 추천하는 AI 코딩 워크플로우 도구 조합을 시각화했다. OpenCode의 로컬 개발 환경과 OpenRouter의 다양한 모델 접근성을 결합하여 효율적인 프로젝트 수행이 가능함을 강조한다.

OpenCode 데스크톱 앱과 OpenRouter의 결합을 보여주는 인포그래픽이다.

실무 Takeaway

- 시스템 프롬프트나 입력 형식의 미세한 변화에도 결과가 달라지는 프롬프트 민감도를 해결하기 위해 표준화된 프롬프팅 프로토콜과 사용자 교육을 도입해야 한다.

- 모델의 신뢰도 점수를 보정하여 불확실성이 높은 경우 자율적 행동을 차단하고 인간 전문가에게 자동으로 라우팅하는 선택적 답변 거부 메커니즘을 구축해야 한다.

- AI를 단순한 대체재가 아닌 구조화된 협업 도구로 설계하여 인간 전문가의 감시 하에 '첫 번째 의견' 또는 '오류 감지기' 역할을 수행하도록 배치해야 한다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.