핵심 요약

Hexagon은 정밀 측정 기술을 통해 수집된 방대한 포인트 클라우드 데이터를 처리하기 위해 도메인 특화 AI 모델을 개발하고 있다. 기존 온프레미스 환경에서는 모델 학습에 80일이 소요되는 등 인프라 확장에 한계가 있었으나, Amazon SageMaker HyperPod으로 전환하며 이를 해결했다. SageMaker HyperPod의 자동 노드 복구 및 확장 가능한 인프라를 통해 학습 시간을 4일로 단축했으며, FSx for Lustre와 MLflow를 통합한 견고한 MLOps 스택을 구축했다. 결과적으로 Hexagon은 더 큰 배치 사이즈를 활용해 모델 정확도를 높이고 제품 출시 기간을 획기적으로 앞당길 수 있게 되었다.

배경

AWS 기초 지식, 분산 학습(Distributed Training) 개념, 포인트 클라우드 데이터 이해

대상 독자

대규모 AI 모델 학습 인프라를 구축하려는 MLOps 엔지니어 및 데이터 과학자

의미 / 영향

대규모 GPU 클러스터 관리의 복잡성을 SageMaker HyperPod과 같은 관리형 서비스로 해결함으로써, 기업들이 인프라 운영보다 모델 고도화에 집중할 수 있는 환경이 조성되고 있다. 특히 포인트 클라우드와 같은 대용량 데이터 처리 분야에서 클라우드 네이티브 인프라의 중요성이 더욱 커질 것으로 보인다.

섹션별 상세

이미지 분석

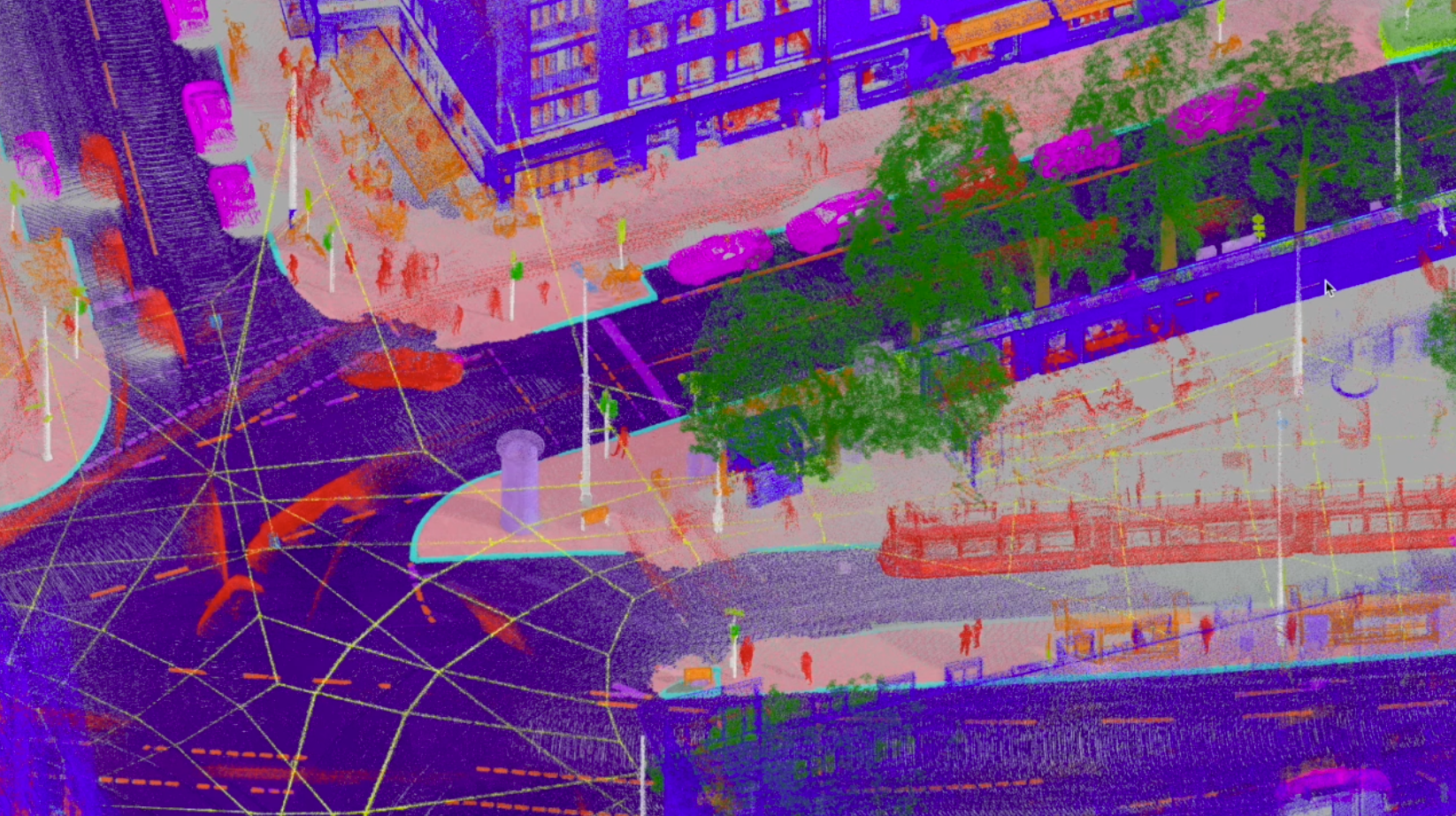

모바일 매핑을 통해 수집된 도로 데이터를 AI 모델이 분류한 모습을 보여준다. 건물, 도로, 식생 등이 서로 다른 색상으로 구분되어 디지털 트윈 제작에 활용됨을 시각화한다.

도시 환경의 포인트 클라우드 데이터 세그멘테이션 결과물이다.

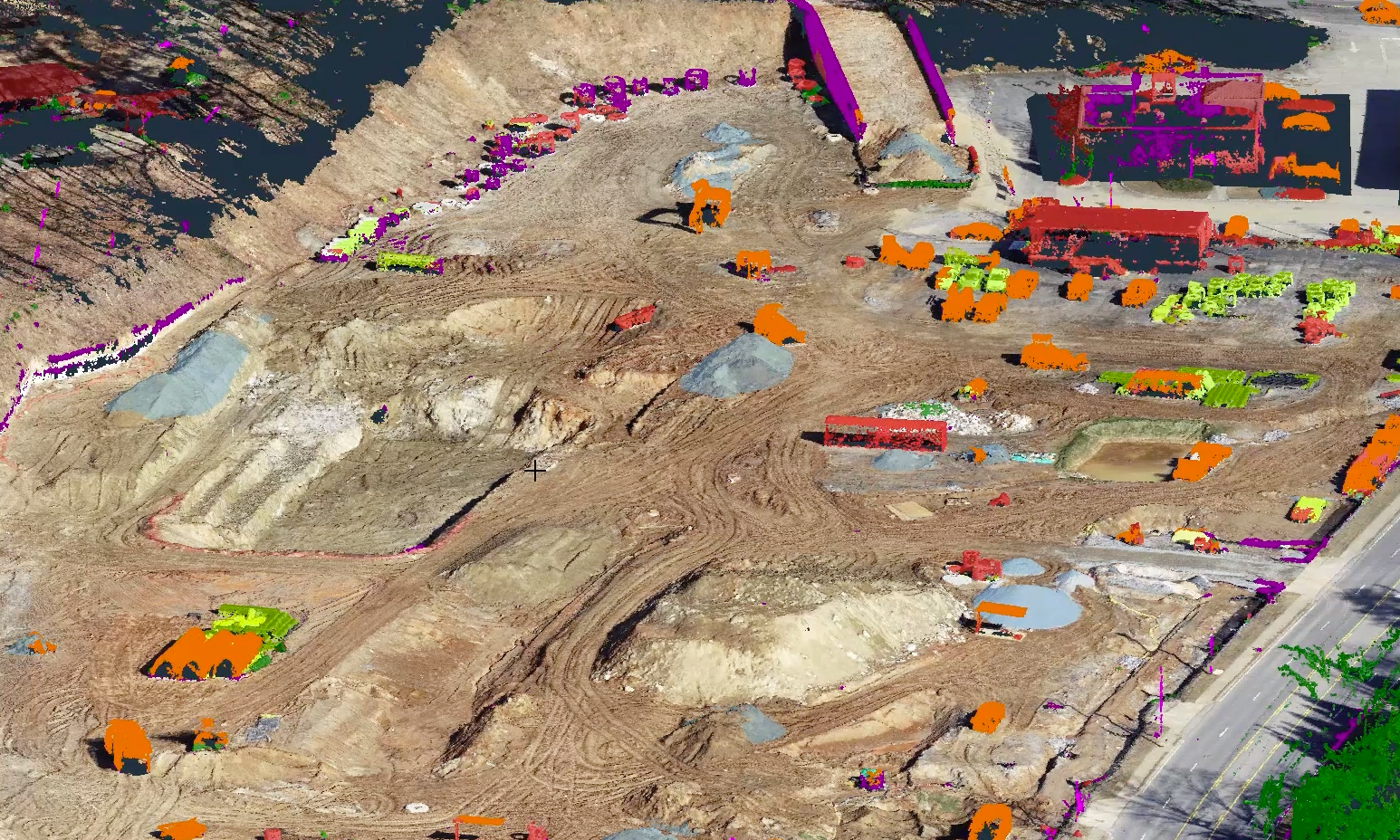

중장비와 지형이 복잡하게 얽힌 건설 현장에서 AI 모델이 객체를 정확히 식별하는 과정을 보여준다. 현장 의사결정을 지원하는 전문화된 AI 모델의 성능을 입증한다.

건설 현장의 포인트 클라우드 데이터 분석 이미지이다.

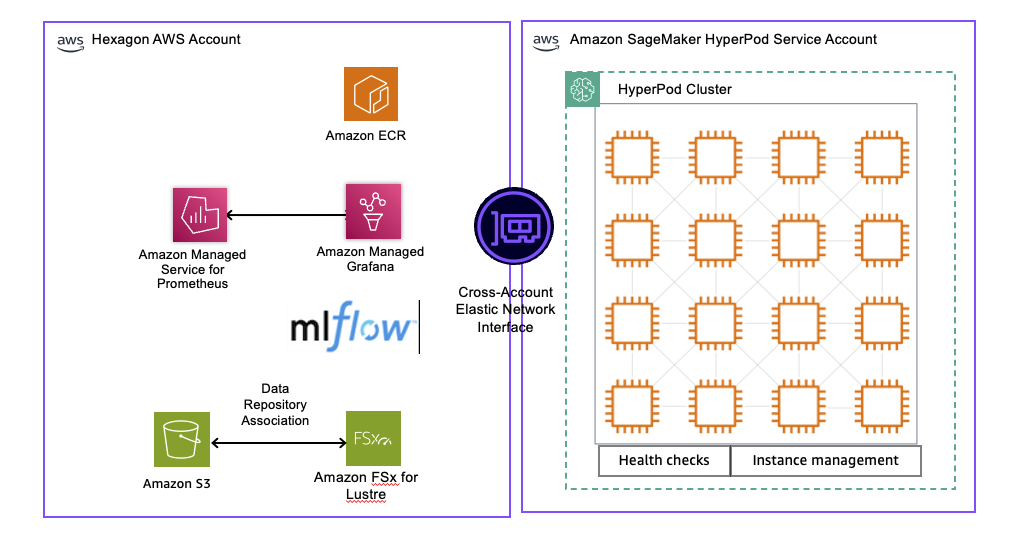

Amazon S3, FSx for Lustre, SageMaker HyperPod 클러스터 간의 데이터 흐름과 MLflow, Grafana를 통한 모니터링 체계를 도식화한다. 전체적인 MLOps 파이프라인 구성을 한눈에 파악할 수 있다.

Hexagon의 SageMaker HyperPod 기반 학습 아키텍처 다이어그램이다.

실무 Takeaway

- SageMaker HyperPod의 자동 노드 복구 기능을 활용하면 수주에서 수개월이 걸리는 장기 학습 프로젝트의 중단 위험을 최소화할 수 있다.

- Amazon FSx for Lustre와 S3의 DRA 설정을 통해 대규모 데이터셋의 로딩 병목 현상을 해결하고 GPU 활용률을 극대화할 수 있다.

- 온프레미스 대비 최신 클라우드 가속 컴퓨팅 도입 시 학습 시간을 95% 이상 단축하여 제품 출시 주기를 획기적으로 줄일 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료