핵심 요약

vLLM 프로젝트가 기존 GitHub 리다이렉트 방식에서 벗어나 독자적인 공식 웹사이트(vllm.ai)를 런칭했다. 이번 개편은 코드 개발과 커뮤니티 운영을 분리하여 개발자들의 부담을 줄이고 사용자 편의성을 높이기 위해 진행됐다. 새로운 사이트에는 환경별 설치 가이드와 이벤트 캘린더가 포함되었으며, 채용 및 협업을 위한 전용 이메일 채널도 신설됐다. 또한 일일 변경 사항을 요약해주는 vLLM Daily 도구를 통해 프로젝트의 진행 상황을 더 쉽게 추적할 수 있게 됐다.

배경

vLLM에 대한 기본 이해, GitHub 사용법

대상 독자

vLLM 사용자, 오픈소스 기여자, AI 인프라 엔지니어

의미 / 영향

vLLM이 단순한 연구 프로젝트를 넘어 성숙한 오픈소스 생태계로 진화하고 있음을 보여준다. 운영과 개발의 분리를 통해 프로젝트의 지속 가능성을 높이고, 기업 및 인재와의 연결 고리를 강화하여 생태계 확장을 가속화할 것으로 기대된다.

섹션별 상세

이미지 분석

고성능 및 메모리 효율적인 LLM 추론 엔진이라는 핵심 가치 제안과 함께 문서 확인 및 시작하기 버튼을 배치한 초기 화면 구성을 보여준다.

vLLM 공식 웹사이트의 메인 홈 화면 스크린샷이다.

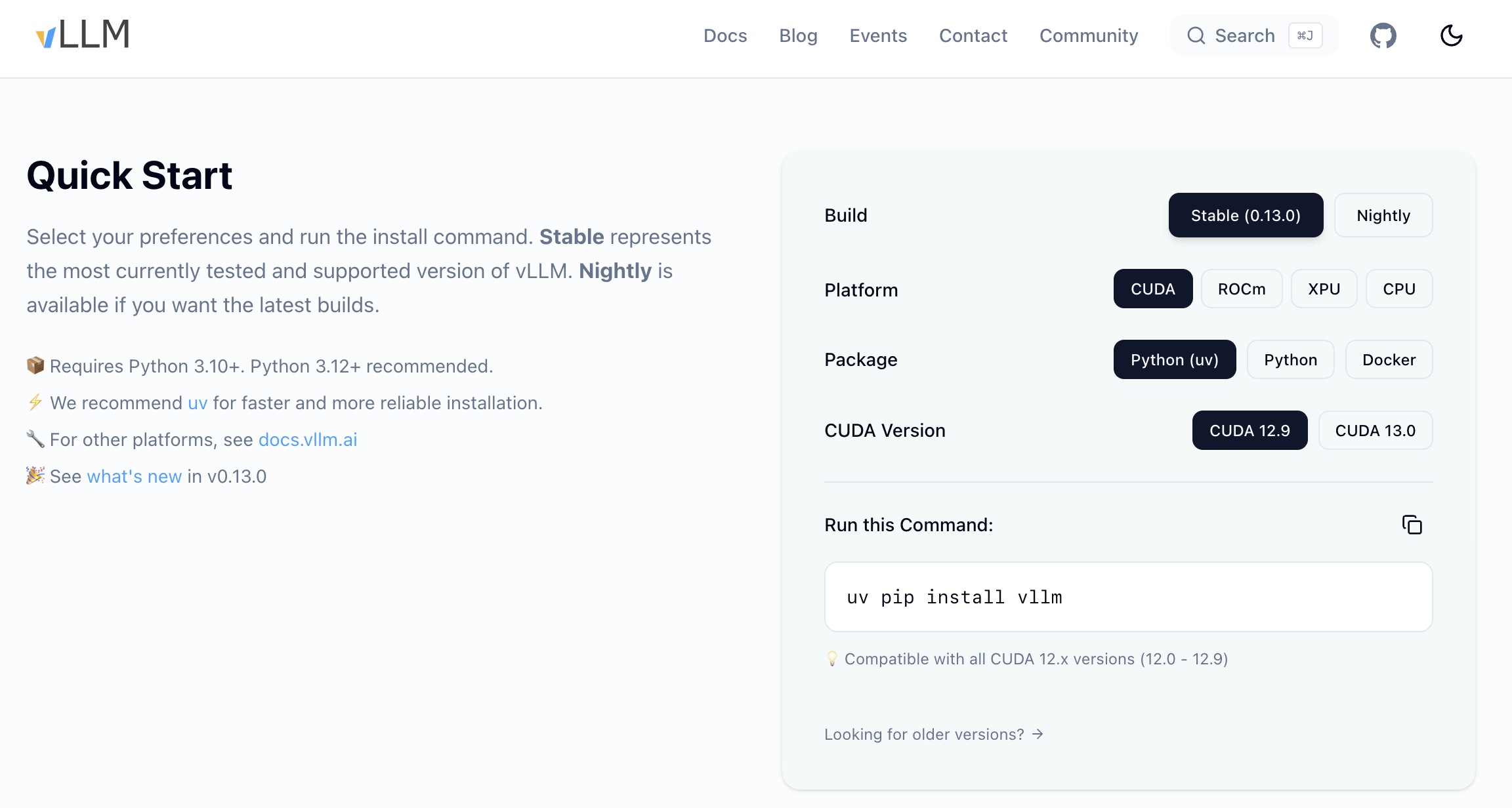

빌드 버전, 플랫폼(CUDA, ROCm 등), 패키지 매니저를 선택하면 맞춤형 설치 명령어를 제공하는 인터페이스를 시각화한다.

사용자의 환경에 맞춰 설치 명령어를 생성해주는 퀵 스타트 셀렉터 화면이다.

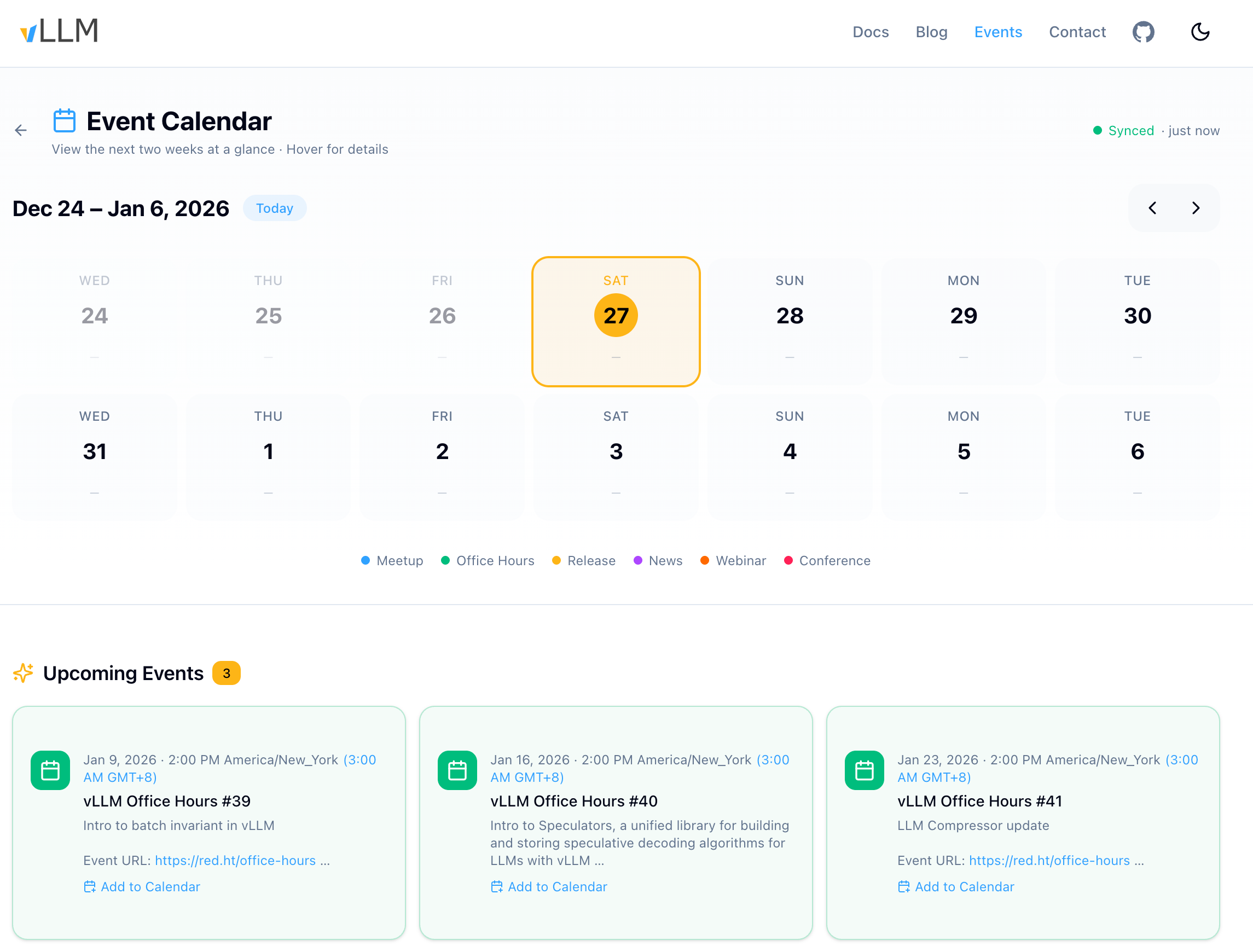

미트업, 릴리스, 웨비나 등 다양한 커뮤니티 활동 일정을 달력 형태로 제공하여 사용자의 참여를 독려하는 기능을 설명한다.

vLLM 커뮤니티의 주요 일정과 오피스 아워를 확인할 수 있는 이벤트 캘린더 페이지이다.

실무 Takeaway

- vllm.ai 웹사이트의 설치 셀렉터를 활용하여 자신의 하드웨어 환경(CUDA, ROCm 등)에 맞는 최적의 설치 명령어를 즉시 확인할 수 있다.

- vLLM Daily 저장소의 RSS 피드를 구독하여 매일 발생하는 코드 변경 사항과 업데이트 내용을 효율적으로 모니터링할 수 있다.

- vLLM 관련 채용 기회를 찾거나 기술 협업을 원하는 경우, 새롭게 개설된 전용 이메일 채널을 통해 직접 소통할 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료