핵심 요약

대형 언어 모델은 광범위한 지식을 갖추었으나 정밀한 계산과 논리적 추론에는 한계가 있다. 울프람은 이를 보완하기 위해 울프람 언어의 정밀 계산 능력을 LLM에 실시간으로 주입하는 계산 증강 생성(CAG) 기술을 도입했다. CAG는 기존 RAG의 한계를 넘어 실시간 계산으로 정확한 정보를 생성하여 모델의 신뢰성을 높인다. 이를 위해 MCP 서비스와 에이전트 원 API 등 개발자가 즉시 적용 가능한 세 가지 통합 솔루션을 출시했다.

배경

LLM API 사용 경험, RAG(Retrieval-Augmented Generation) 개념, MCP(Model Context Protocol)에 대한 이해

대상 독자

LLM 애플리케이션 개발자 및 AI 시스템 아키텍트

의미 / 영향

LLM이 단순한 텍스트 생성을 넘어 복잡한 과학적 계산과 정밀한 데이터 분석을 수행할 수 있게 되어, 금융, 과학 연구, 엔지니어링 분야의 AI 도입이 가속화될 것이다.

섹션별 상세

이미지 분석

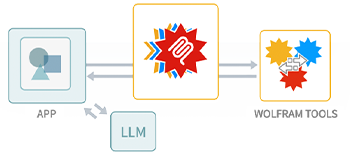

앱과 울프람 도구 사이에서 MCP 서비스가 중개 역할을 수행하는 구조이다. 화살표를 통해 데이터가 양방향으로 흐르는 과정을 시각화하여 통합 방식을 나타낸다.

MCP 서비스의 아키텍처 다이어그램

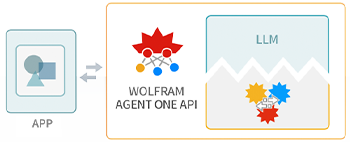

앱이 단일 API 호출로 LLM과 울프람 도구 통합 환경에 접근하는 방식이다. 복잡한 내부 로직을 추상화하여 개발자가 쉽게 사용할 수 있는 구조임을 나타낸다.

에이전트 원 API의 통합 구조도

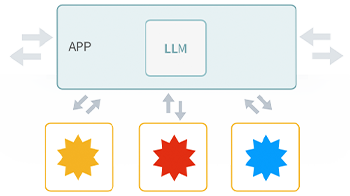

앱 내부의 LLM이 여러 울프람 계산 컴포넌트와 개별적으로 통신하는 세밀한 제어 구조이다. 시스템 규모에 따른 최적화된 통합이 가능함을 시각적으로 표현한다.

CAG 컴포넌트 API의 세부 제어 구조

실무 Takeaway

- LLM의 환각 문제를 해결하기 위해 정적인 문서 검색(RAG) 대신 실시간 계산 엔진(CAG)을 결합하여 데이터의 정확성을 확보해야 한다.

- MCP 표준 프로토콜을 활용하면 복잡한 설정 없이도 울프람의 방대한 계산 함수를 기존 AI 시스템에 즉시 통합할 수 있다.

- 범용 에이전트 구축 시 에이전트 원 API를 사용하면 모델과 도구의 정렬 문제를 최소화하고 개발 속도를 높일 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료