핵심 요약

와튼 스쿨 연구진은 대니얼 카너먼의 이중 프로세스 이론을 확장하여 AI를 통한 인지 과정인 '시스템 3(인공 인지)'를 제안하고, 인간이 AI의 답변을 무비판적으로 수용하는 '인지적 굴복(Cognitive Surrender)' 현상을 분석했다. 실험 결과, 참가자들은 AI가 틀린 답을 제시할 때도 80%의 확률로 이를 따랐으며, AI 사용 시 실제 정확도와 상관없이 주관적 자신감이 상승하는 양상을 보였다. 연구는 AI를 도구로서 전략적으로 활용하는 '인지적 외주화'와 달리, 사고 과정을 완전히 포기하는 '인지적 굴복'이 인간의 비판적 사고 능력을 퇴화시킬 수 있다고 경고한다.

배경

이중 프로세스 이론(System 1 & 2), 자동화 편향(Automation Bias)

대상 독자

AI 도구를 일상적으로 사용하는 지식 노동자 및 교육자

의미 / 영향

AI가 인간의 생산성을 높여주는 것처럼 보이지만, 비판적 사고 과정이 생략된 인지적 굴복은 장기적으로 인적 자본의 질적 저하와 의사결정 오류를 초래할 수 있다.

섹션별 상세

이미지 분석

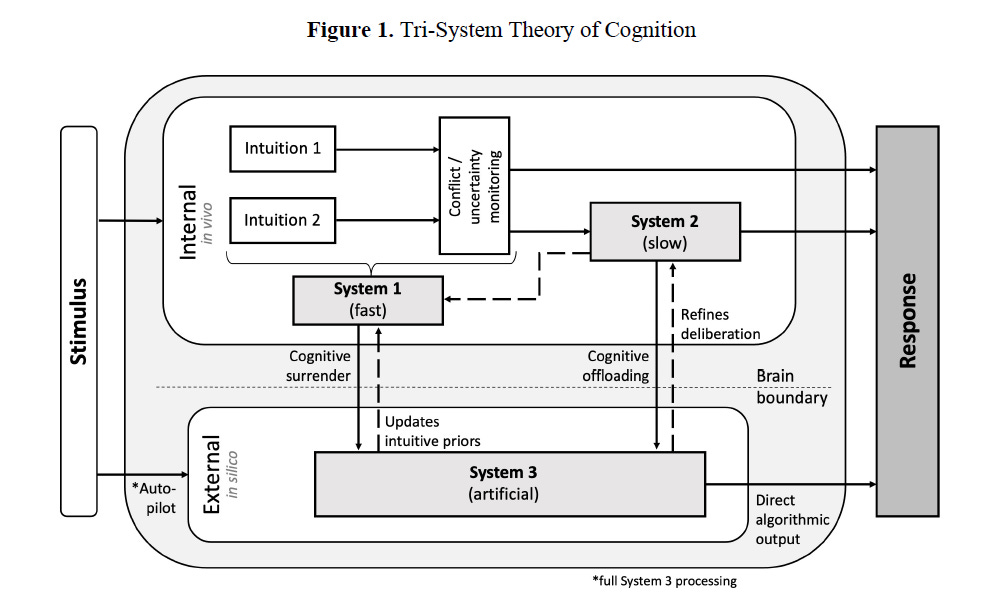

기존의 시스템 1(직관) 및 시스템 2(숙고)와 외부 AI 시스템인 시스템 3가 어떻게 연결되는지 보여준다. 인지적 굴복과 인지적 외주화가 뇌의 경계를 넘어 어떻게 발생하는지 시각적으로 정의한다.

인간의 인지 체계와 AI(시스템 3)의 상호작용을 나타내는 인지 삼중 시스템 이론 다이어그램이다.

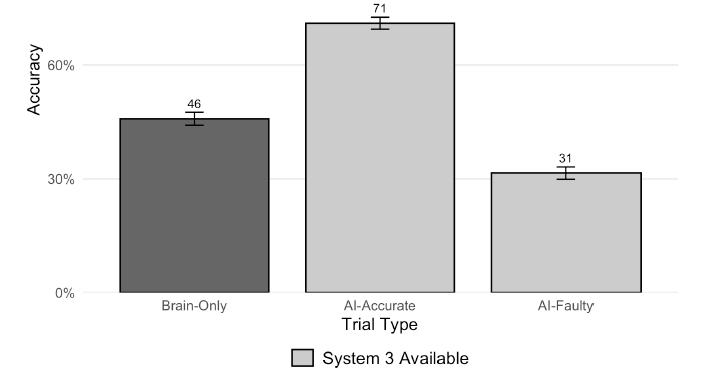

AI가 정확할 때(71%)와 틀릴 때(31%)의 정확도 차이를 뇌만 사용했을 때(46%)와 비교하여 보여준다. AI가 오답을 제시할 경우 인간의 판단력이 기준치 이하로 떨어진다는 핵심 실험 결과를 증명한다.

AI 지원 여부와 AI 답변의 정확도에 따른 참가자들의 문제 해결 정확도 비교 차트이다.

실무 Takeaway

- AI 답변을 수용하기 전 반드시 자신의 직관과 숙고 과정을 먼저 가동하여 독립적인 판단 기준을 세워야 한다.

- AI를 계산기처럼 방법만 외주화하는 도구로 사용해야 하며, 결과의 타당성에 대한 최종 책임은 항상 인간에게 두어야 한다.

- AI에 대한 과도한 신뢰는 비판적 사고 능력을 마비시키므로, AI가 틀릴 수 있다는 전제하에 교차 검증하는 습관을 유지해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료