핵심 요약

Z.ai가 새로운 오픈 웨이트 모델 GLM-5를 출시하며 인공지능 업계의 주목을 받고 있다. GLM-5는 744B 파라미터 규모에 DeepSeek의 Sparse Attention 기술을 통합하여 효율성을 극대화했으며, 주요 벤치마크에서 기존 폐쇄형 모델들에 필적하는 성능을 보여주었다. 이와 함께 DeepSeek의 100만 토큰 컨텍스트 지원 소식과 MiniMax, Qwen 등 중국 기반 AI 랩들의 공격적인 릴리스가 이어지며 글로벌 AI 경쟁 구도가 재편되는 양상이다. 다만 급격한 수요 증가로 인한 GPU 자원 부족과 추론 비용 문제는 여전히 해결해야 할 과제로 남아 있다.

배경

MoE(Mixture of Experts), Sparse Attention, Quantization, RAG

대상 독자

LLM 배포 및 최적화 엔지니어, AI 전략 기획자, 오픈 소스 모델 활용 개발자

의미 / 영향

오픈 소스 모델이 독점적 모델의 성능을 빠르게 추격함에 따라 AI 시장의 진입 장벽이 낮아지고 있으며, 특히 중국 랩들의 기술 혁신이 전체 생태계의 표준을 주도하기 시작했다.

섹션별 상세

이미지 분석

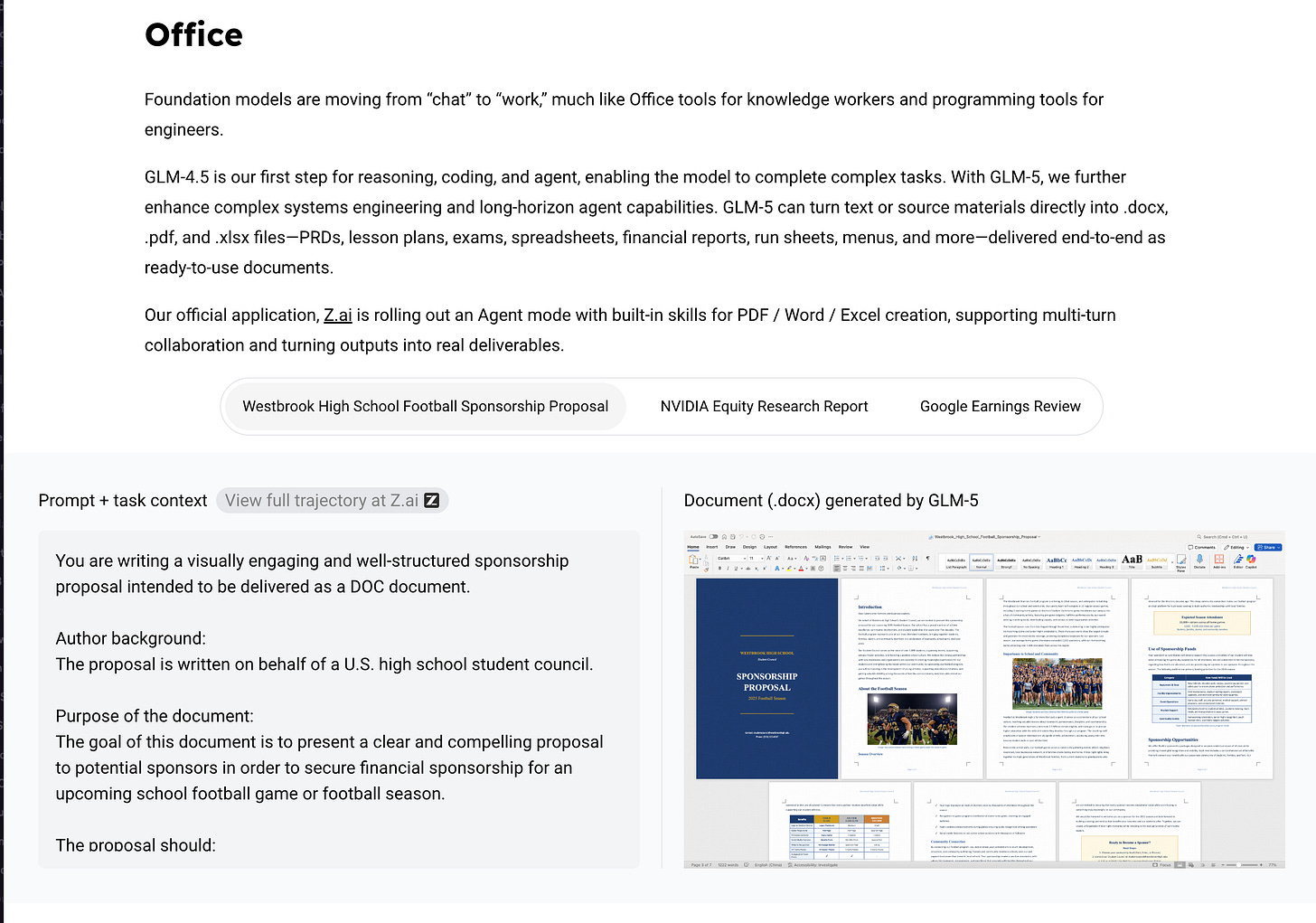

GLM-5 모델이 텍스트 프롬프트를 바탕으로 구조화된 .docx 제안서를 생성하는 과정을 보여준다. 이는 모델이 단순 채팅을 넘어 실제 업무용 결과물을 생성하는 에이전트 능력을 갖추었음을 입증한다.

Z.ai의 Office 애플리케이션에서 GLM-5가 문서를 생성하는 데모 화면이다.

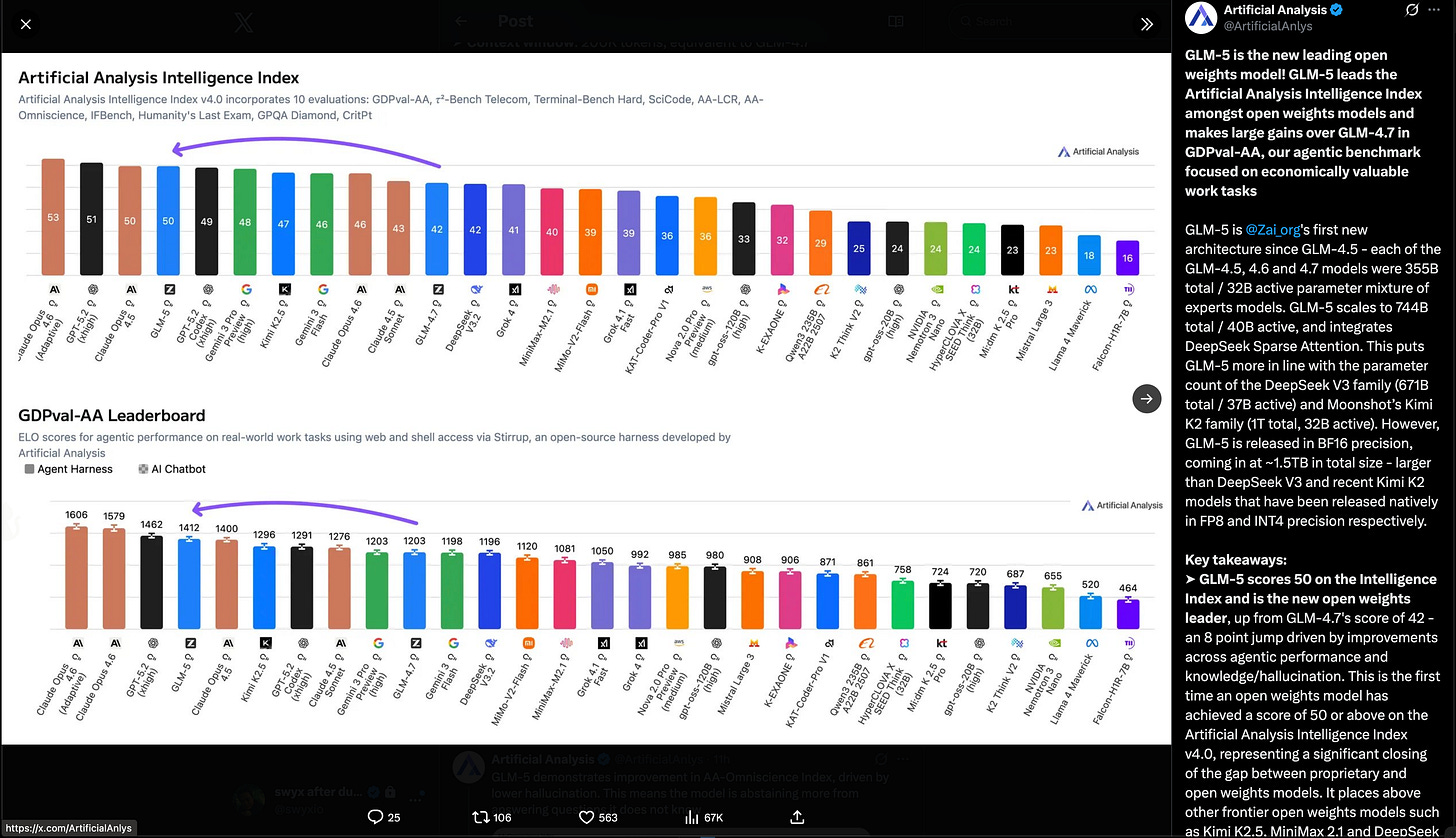

GLM-5가 지능 지수 50점을 기록하며 오픈 웨이트 모델 중 1위에 올랐음을 보여준다. 또한 에이전트 성능을 측정하는 GDPval-AA 벤치마크에서도 최상위권에 위치하여 실무 능력을 수치로 증명한다.

Artificial Analysis의 지능 지수 및 GDPval-AA 리더보드 차트이다.

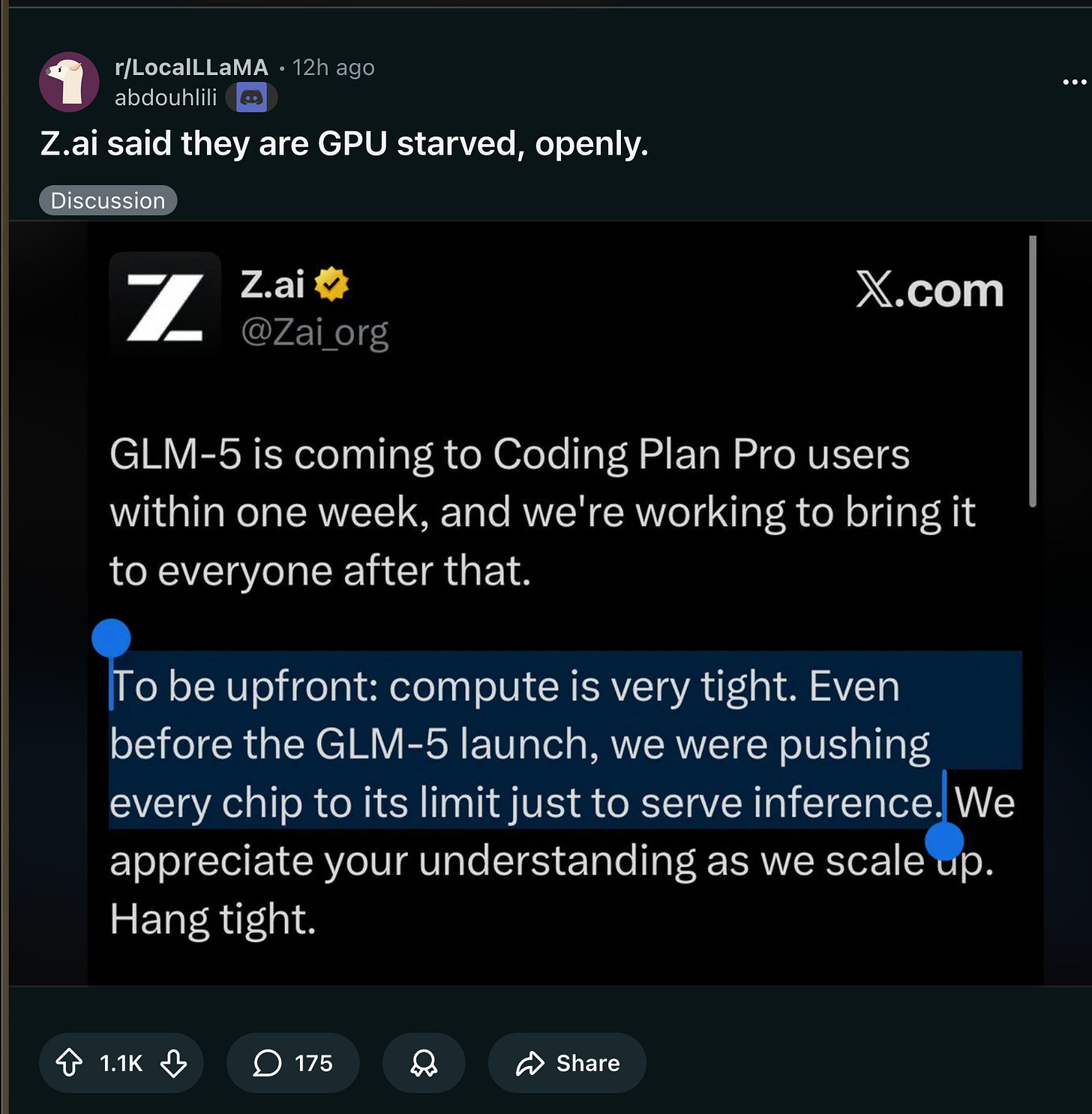

GLM-5 출시 이후 급증한 수요로 인해 컴퓨팅 자원이 한계에 도달했음을 공식적으로 시인하는 내용이다. 고성능 모델 운영에 있어 하드웨어 인프라 확보가 핵심적인 병목 지점임을 시사한다.

Z.ai가 GPU 자원 부족 상황을 알리는 트윗 캡처본이다.

실무 Takeaway

- GLM-5와 같은 대규모 오픈 웨이트 모델의 등장으로 기업들은 폐쇄형 API 의존도를 낮추고 자체 인프라에서 고성능 AI를 운영할 수 있는 선택지가 넓어졌다.

- DeepSeek의 DSA 및 MLA 기술은 긴 컨텍스트 모델의 운영 비용을 획기적으로 절감할 수 있는 핵심 아키텍처로 자리 잡고 있다.

- 중국 AI 모델들은 성능 대비 가격 경쟁력이 서구권 모델의 1/5 수준까지 낮아지고 있어 비용 효율적인 AI 도입을 고려하는 개발자들에게 강력한 대안이 되고 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료