핵심 요약

AI 에이전트의 성능 지표인 평균 성공률은 급격히 상승하고 있지만, 실제 산업 현장 도입에 필수적인 신뢰성은 그 속도를 따라가지 못하고 있다. 프린스턴 대학교 연구진은 신뢰성을 일관성, 강건성, 예측 가능성, 안전성의 4가지 차원과 12개 세부 지표로 정의하고 14개 주요 모델을 18개월간 추적 조사했다. 연구 결과, 모델의 크기가 커져도 신뢰성 지표는 완만하게 개선되거나 오히려 일부 저하되는 양상을 보였으며, 이는 AI 에이전트의 경제적 파급 효과가 예상보다 더딘 주요 원인으로 지목된다. 연구진은 단순 정확도 측정을 넘어 다각도의 신뢰성 프로필을 구축하고, 자동화와 증강을 명확히 구분하여 도입할 것을 제안한다.

배경

LLM 벤치마크 개념, AI 에이전트 기본 구조, 통계적 신뢰성 개념

대상 독자

AI 에이전트 프로덕션 배포를 고민하는 개발자 및 제품 관리자

의미 / 영향

이 연구는 AI 에이전트의 성능 수치에 가려진 실질적 배포 장벽을 수치화하여 보여준다. 향후 AI 벤치마크의 패러다임이 단순 정확도에서 다차원 신뢰성 프로필로 전환될 것이며, 기업들은 자체적인 신뢰성 검증 프로세스를 구축해야 할 것이다.

섹션별 상세

이미지 분석

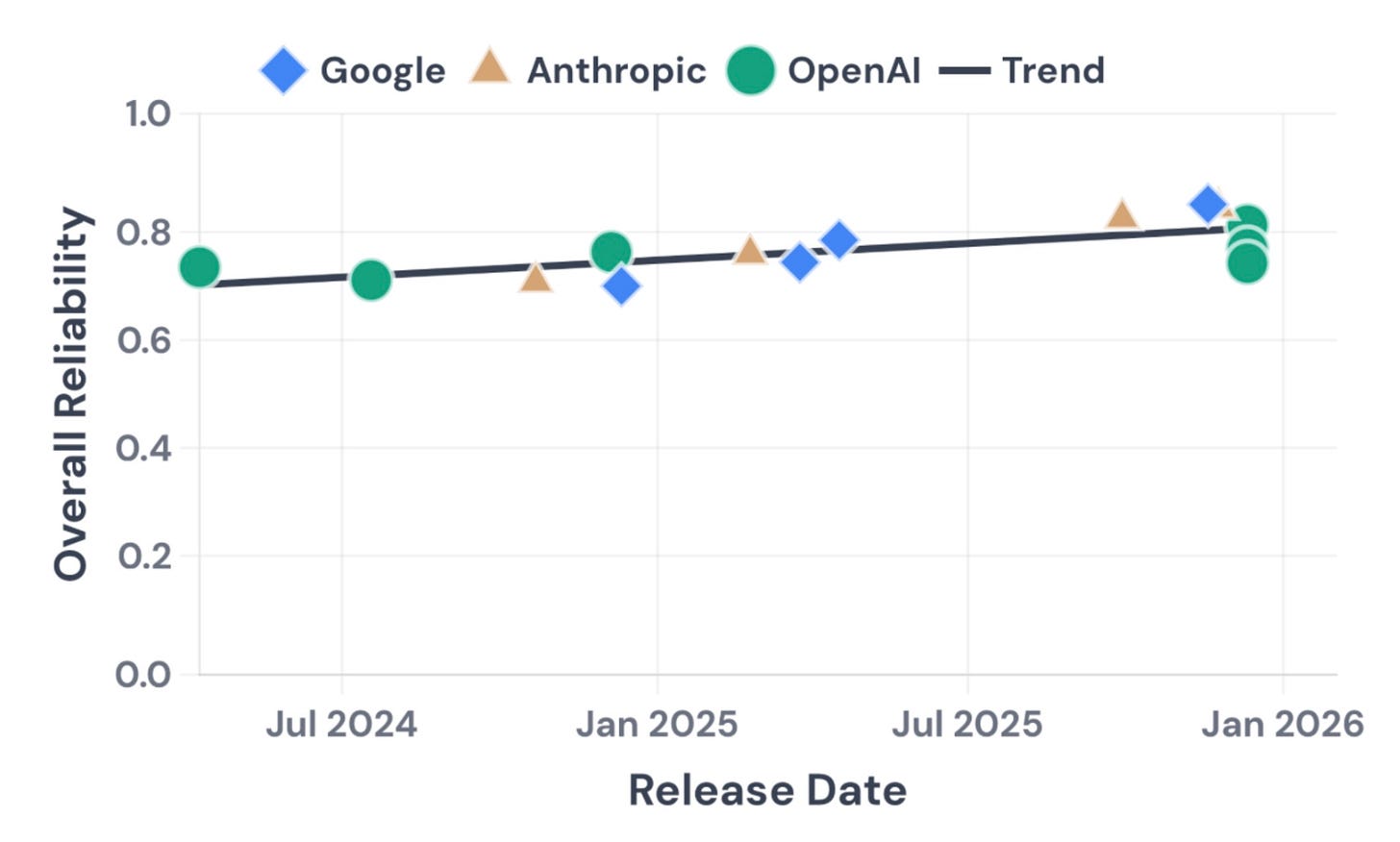

Google, Anthropic, OpenAI 모델들의 출시 시점별 종합 신뢰성 점수를 나타낸다. 시간이 지남에 따라 성능은 급격히 상승하는 반면, 신뢰성 점수는 0.7에서 0.8 사이에서 매우 완만하게 상승하고 있음을 시각적으로 증명한다.

2024년 7월부터 2026년 1월까지 주요 AI 기업 모델들의 신뢰성 추이를 보여주는 그래프.

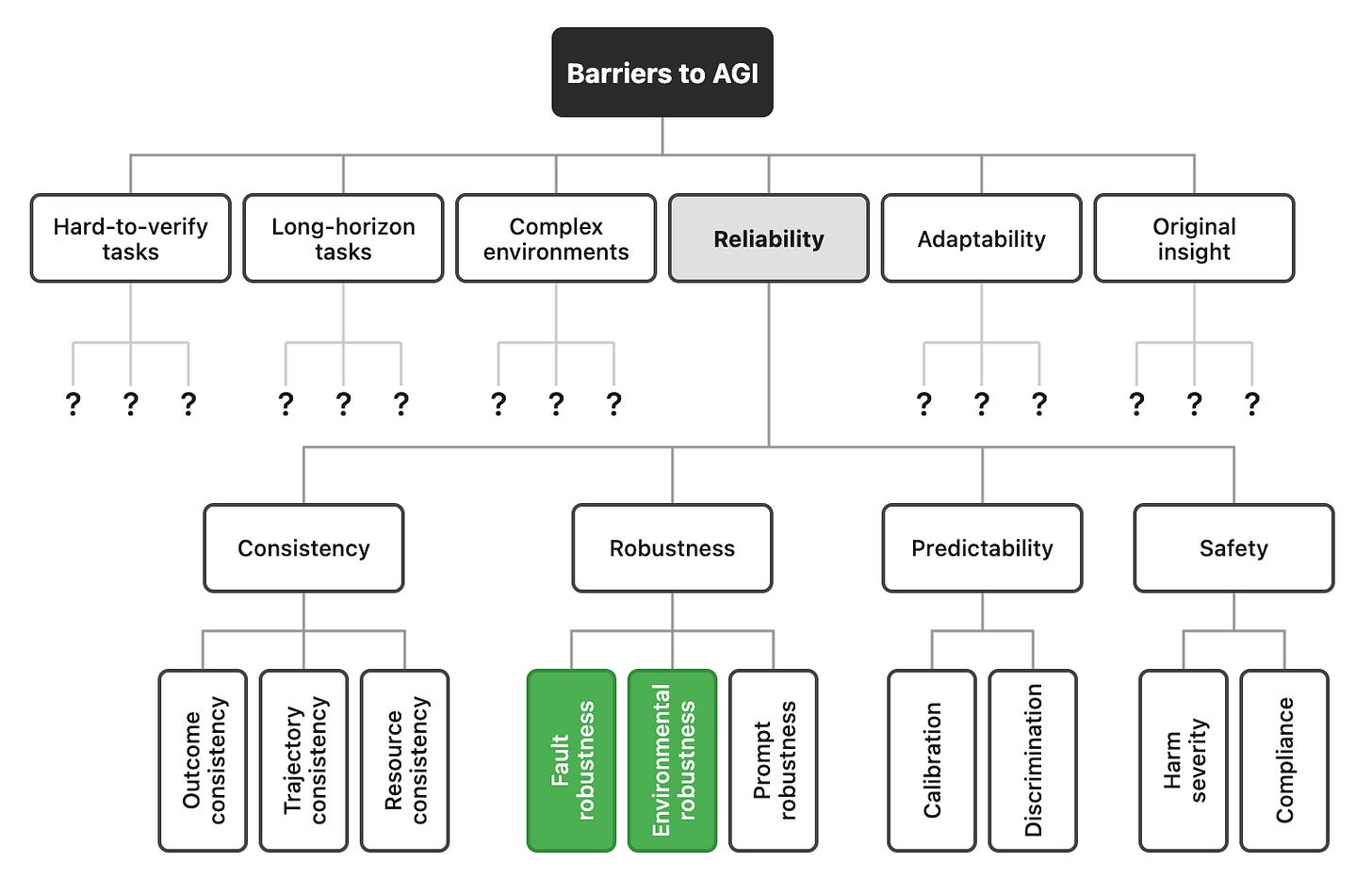

신뢰성을 일관성, 강건성, 예측 가능성, 안전성의 4개 대분류와 그 아래 12개 세부 지표로 구조화하여 보여준다. 현재 기술 수준에서 해결된 지표(초록색)와 여전히 미해결 상태인 지표를 구분하여 연구의 분석 틀을 제시한다.

AGI로 가는 장벽 중 하나인 신뢰성의 세부 계층 구조도.

실무 Takeaway

- AI 에이전트 도입 시 평균 성공률만 보지 말고, 동일 프롬프트에 대한 결과의 일관성과 오류 발생 시의 심각도를 반드시 측정해야 한다.

- 현재 모델들은 자신의 오류를 판단하는 능력이 매우 낮으므로, 에이전트가 확신이 없을 때 사람에게 개입을 요청하도록 하는 예측 가능성 개선 로직을 별도로 설계해야 한다.

- 성능이 99%에 도달하더라도 나머지 1%의 오류가 예측 불가능하다면 고위험 환경 배포는 위험하며, 99.9% 이상의 신뢰성을 확보하기 위한 별도의 최적화가 필요하다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료