핵심 요약

전통적인 합성 데이터는 부족한 데이터셋을 보완하는 보조적 수단이었으나, 자율형 AI 에이전트의 등장으로 그 역할과 규모가 완전히 변했다. 현대의 합성 데이터는 단순한 문답 쌍이 아니라 복잡한 계획, 추론 트레이스, 외부 도구 사용 과정을 포함하는 긴 시퀀스로 구성된다. 이러한 고품질 데이터를 생산하기 위해서는 다중 에이전트 오케스트레이션, 실시간 코드 실행 검증, 대규모 중복 제거 파이프라인이 필수적이다. 결과적으로 합성 데이터 생성은 GPU 중심의 추론을 넘어 CPU와 샌드박스 환경이 통합된 산업적 규모의 엔지니어링 문제로 전환되었다.

배경

LLM 추론 및 파인튜닝 기본 개념, 분산 컴퓨팅 프레임워크(Ray, SLURM)에 대한 이해, 에이전트 워크플로우 및 도구 사용(Tool Use) 메커니즘

대상 독자

AI 인프라 엔지니어, LLM 학습 데이터 전략가, 자율형 에이전트 개발자

의미 / 영향

합성 데이터 생성이 '데이터 공장' 모델로 전환됨에 따라 기업의 경쟁력은 모델 자체보다 고품질 데이터를 지속적으로 생산하고 검증하는 인프라 역량에서 결정될 것이다. 이는 GPU 중심의 투자에서 벗어나 컴퓨팅, 스토리지, 오케스트레이션이 통합된 현대적 AI 스택(PARK stack)으로의 전환을 가속화할 전망이다.

섹션별 상세

이미지 분석

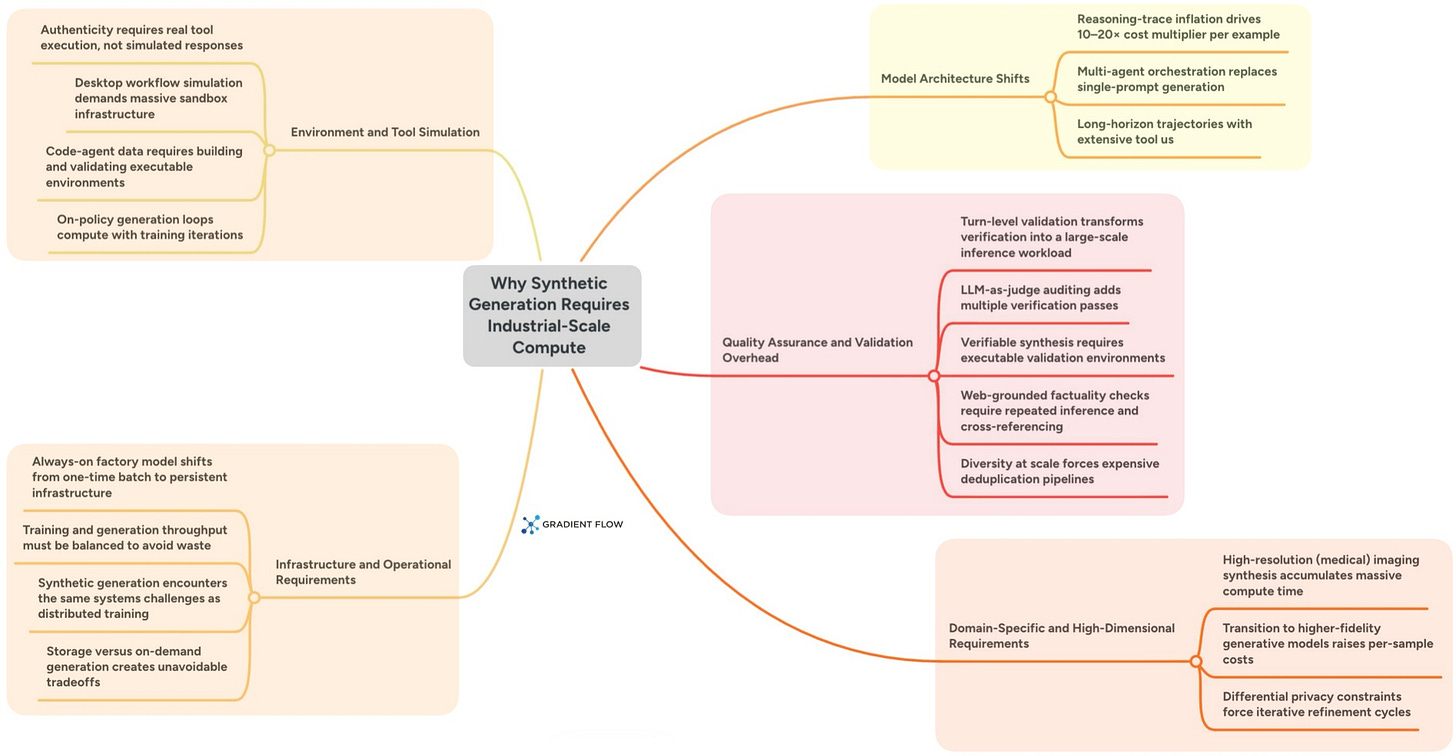

모델 아키텍처 변화, 품질 보증 부하, 환경 및 도구 시뮬레이션 등 합성 데이터 생성이 단순한 작업을 넘어 거대 인프라가 필요한 이유를 체계적으로 보여준다. 각 영역별 세부 요구사항(예: 10-20배 비용 증가, 대규모 샌드박스 등)을 시각화하여 기사의 핵심 주장을 뒷받침한다.

합성 데이터 생성이 산업적 규모의 컴퓨팅을 요구하는 이유를 5가지 핵심 영역으로 정리한 마인드맵이다.

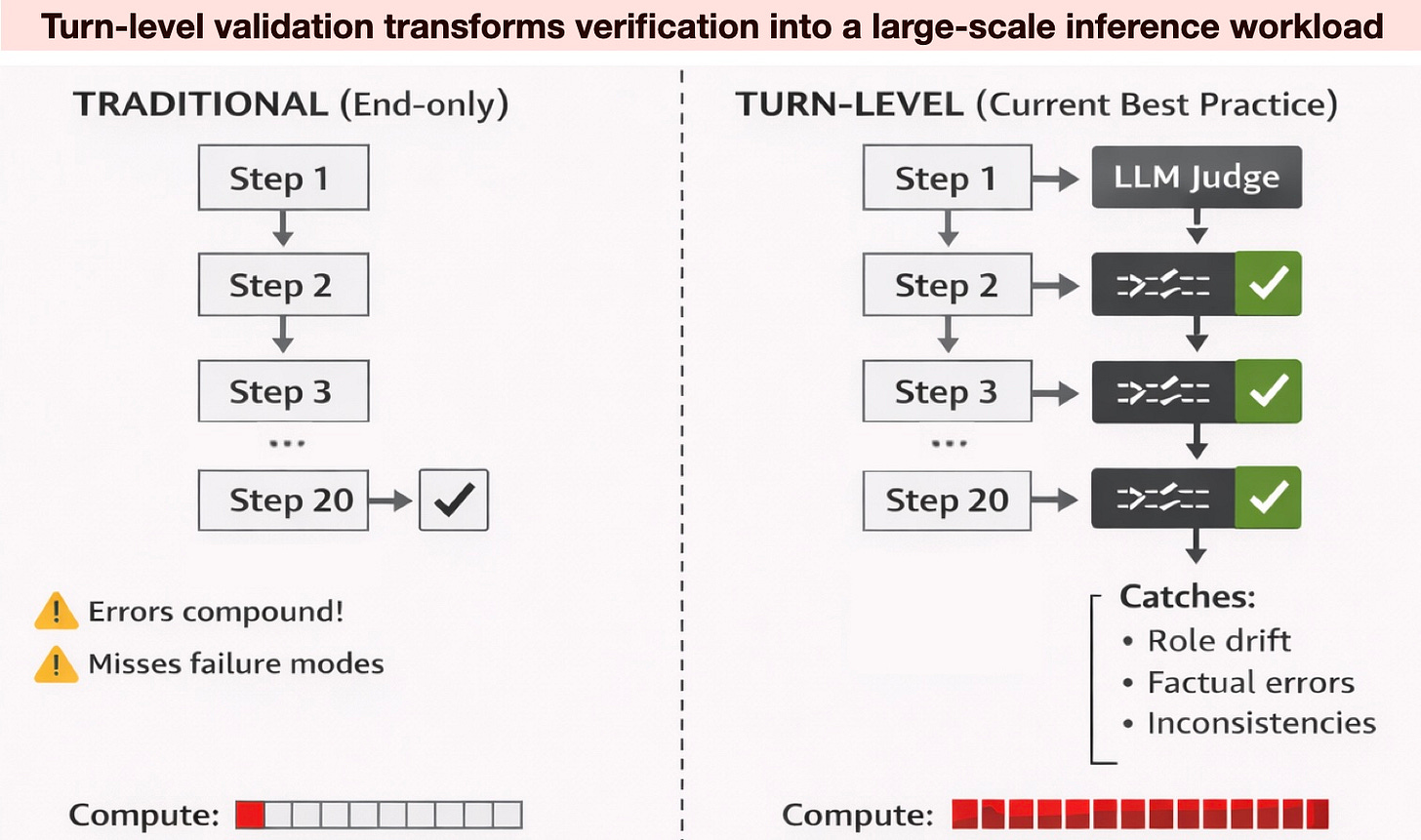

전통적인 방식은 마지막에만 확인하여 오류가 누적되지만, 단계별 검증은 매 단계 LLM 판사를 동원해 오류를 잡아낸다. 이 과정에서 발생하는 컴퓨팅 부하가 훨씬 크다는 점을 하단의 붉은색 게이지로 명확히 대조하여 보여준다.

전통적인 최종 단계 검증 방식과 현대적인 단계별(Turn-level) 검증 방식의 컴퓨팅 요구량을 비교한 도표이다.

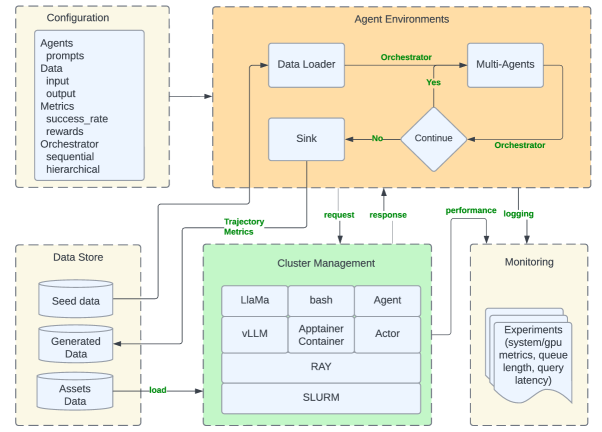

에이전트 환경, 클러스터 관리(SLURM, Ray), 데이터 저장소, 모니터링 섹션으로 구성된 시스템 구조를 보여준다. 중앙 컨트롤러 없이 각 태스크가 독립적으로 진행되는 분산형 아키텍처의 실체를 기술적으로 설명한다.

메타의 Matrix 에이전트 데이터 생성 시스템의 아키텍처 다이어그램이다.

실무 Takeaway

- 합성 데이터는 이제 단순한 데이터 증강 도구가 아니라 모델의 추론 능력을 결정짓는 핵심적인 산업적 자산이다.

- 고품질 에이전트 데이터를 생산하려면 GPU 추론 성능뿐만 아니라 대규모 컨테이너 실행과 분산 처리가 가능한 통합 인프라가 필요하다.

- Ray와 같은 분산 컴퓨팅 프레임워크를 활용하면 전담 ML 인프라 팀 없이도 대규모 합성 데이터 파이프라인을 효율적으로 구축할 수 있다.

- 데이터의 다양성을 유지하기 위해 생성 후 대규모 임베딩 및 클러스터링을 통한 중복 제거 프로세스를 반드시 포함해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료