핵심 요약

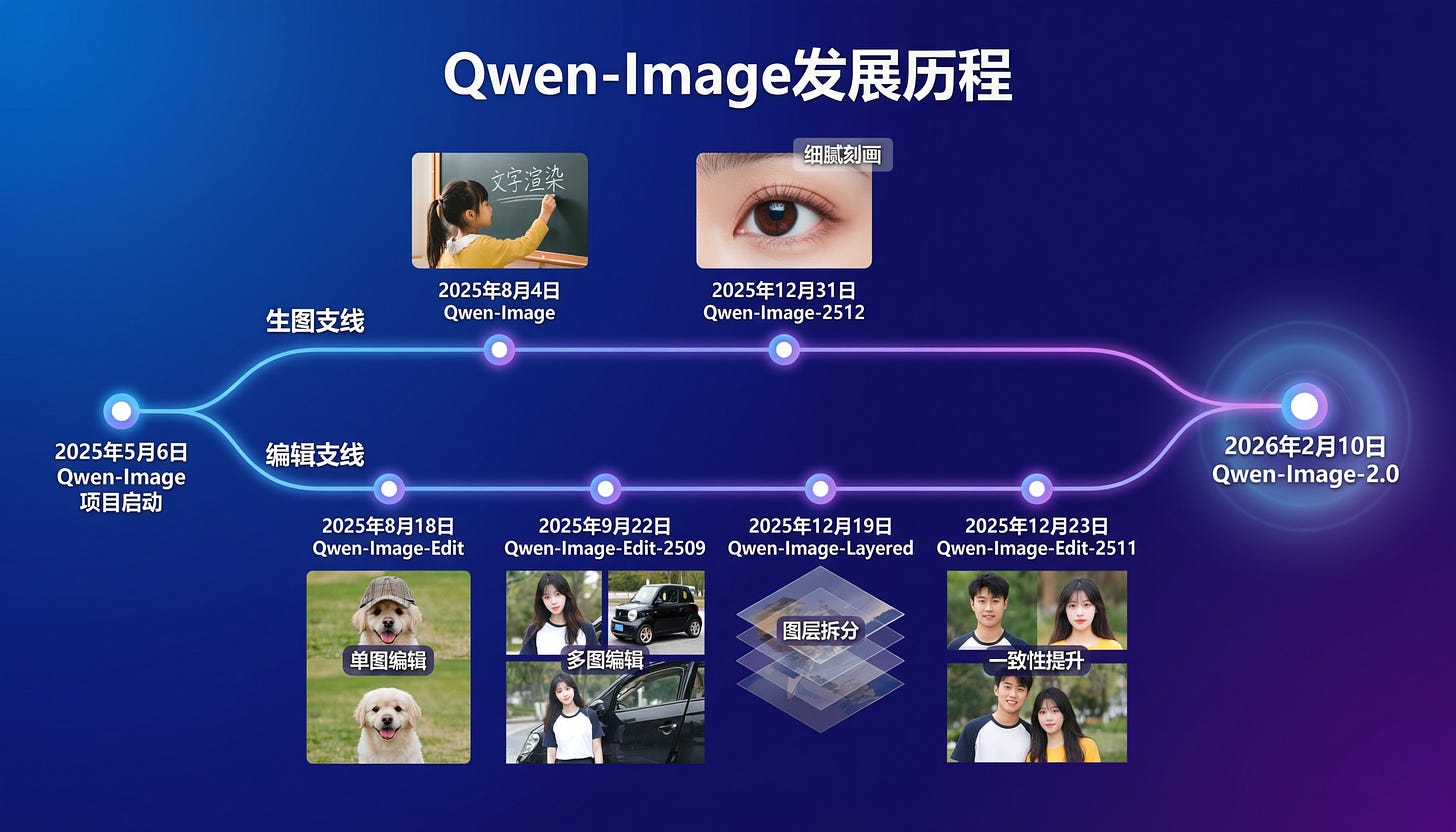

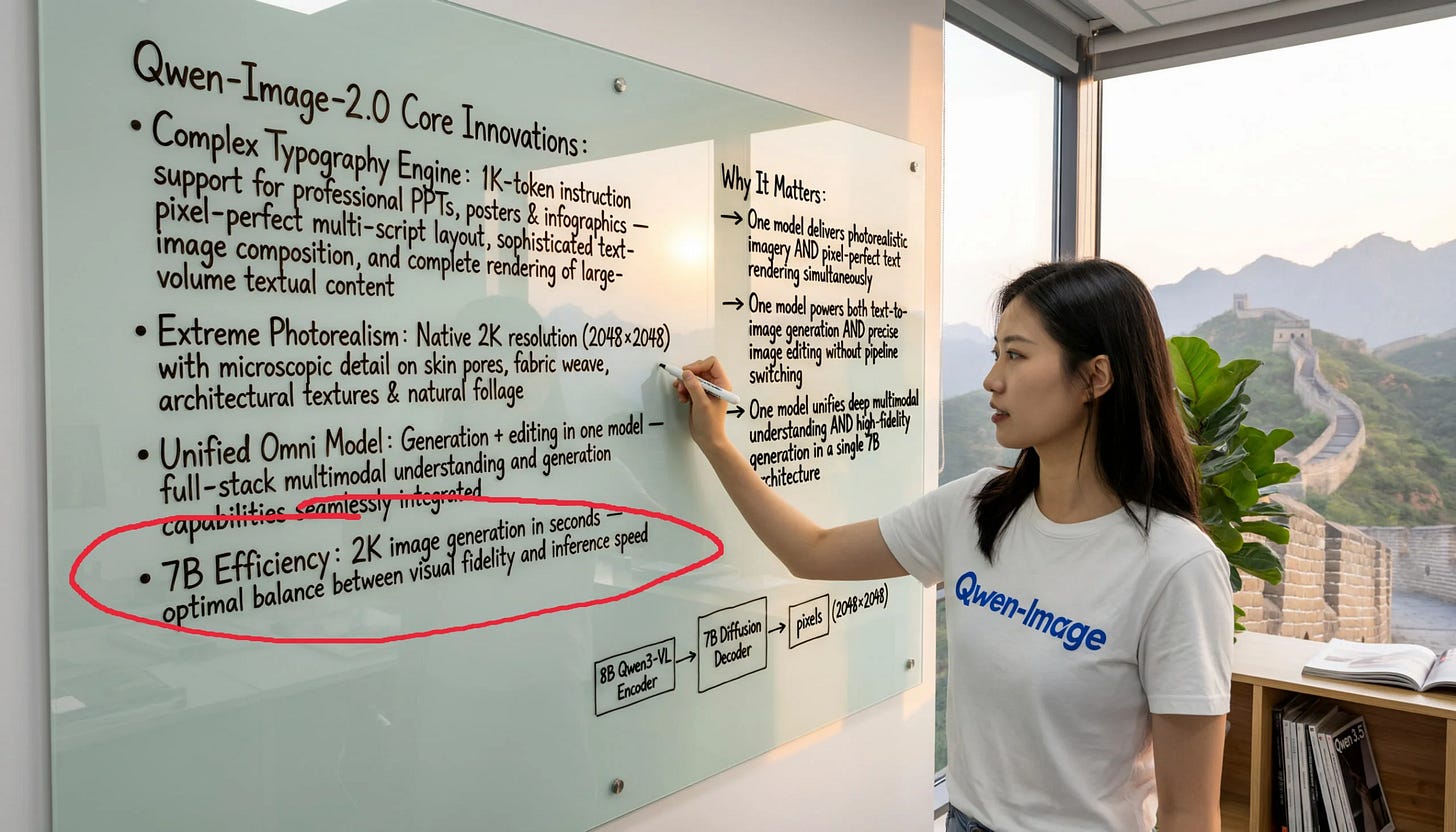

알리바바가 이미지 생성과 편집을 통합한 7B 규모의 Qwen-Image 2.0을 발표하며 중국 AI 모델의 기술력을 입증했다. 이 모델은 2K 고해상도와 정교한 텍스트 렌더링을 지원하며, 바이트댄스의 Seedance 2.0 역시 비디오 생성 분야에서 물리 법칙을 정교하게 구현하는 등 괄목할 만한 성능 향상을 보여주었다. 동시에 OpenAI는 에이전트 실행을 위한 Responses API와 GPT-5.2 기반의 Deep Research를 선보이며 에이전트 생태계를 확장하고 있다. 또한, Unsloth의 MoE 학습 가속화와 Isomorphic Labs의 단백질 구조 예측 모델 등 인프라와 과학 분야에서도 중요한 기술적 진전이 보고되었다.

배경

Diffusion 모델의 기본 작동 원리, LLM 에이전트 및 도구 호출(Tool Calling) 개념, GPU 메모리 관리 및 커널 최적화에 대한 기초 지식

대상 독자

멀티모달 AI 모델 개발자 및 에이전트 기반 워크플로우를 설계하는 엔지니어

의미 / 영향

중국 기업들이 경량화된 고성능 멀티모달 모델을 잇달아 출시하며 글로벌 AI 시장에서의 영향력을 확대하고 있다. 특히 생성과 편집을 통합하거나 학습 효율을 극대화하는 기술적 접근은 AI 상용화 단계에서 비용 대비 성능을 중시하는 흐름을 가속화할 것이다.

섹션별 상세

실무 Takeaway

- Qwen-Image 2.0처럼 생성과 편집이 통합된 경량 모델(7B)을 활용하면 고해상도 이미지 작업의 파이프라인을 단순화하고 추론 비용을 최적화할 수 있다.

- OpenAI의 Responses API와 서버 측 컨텍스트 압축 기능을 RAG 시스템에 적용하면 장기 대화 시 발생하는 토큰 비용과 지연 시간을 획기적으로 줄일 수 있다.

- Unsloth의 최적화된 Triton 커널을 도입하여 제한된 하드웨어 자원에서도 MoE 기반 모델을 효율적으로 파인튜닝하거나 학습할 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.