핵심 요약

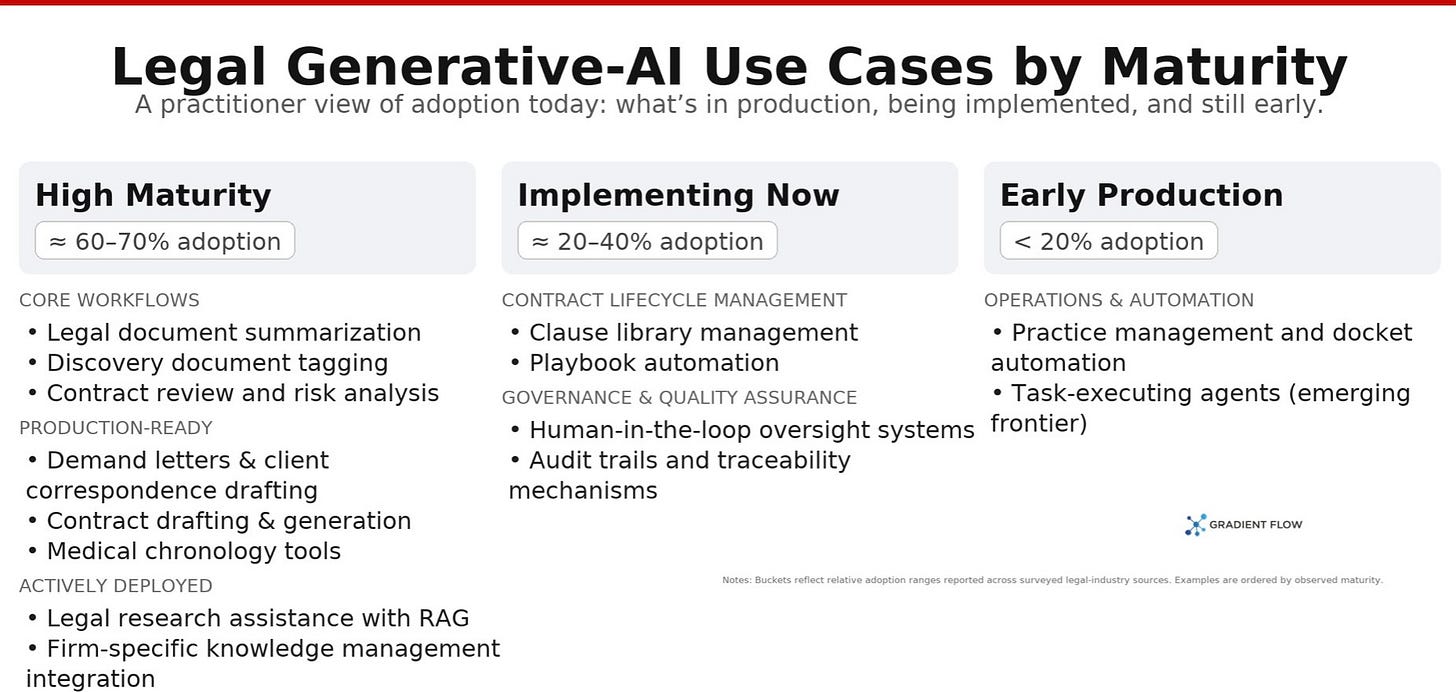

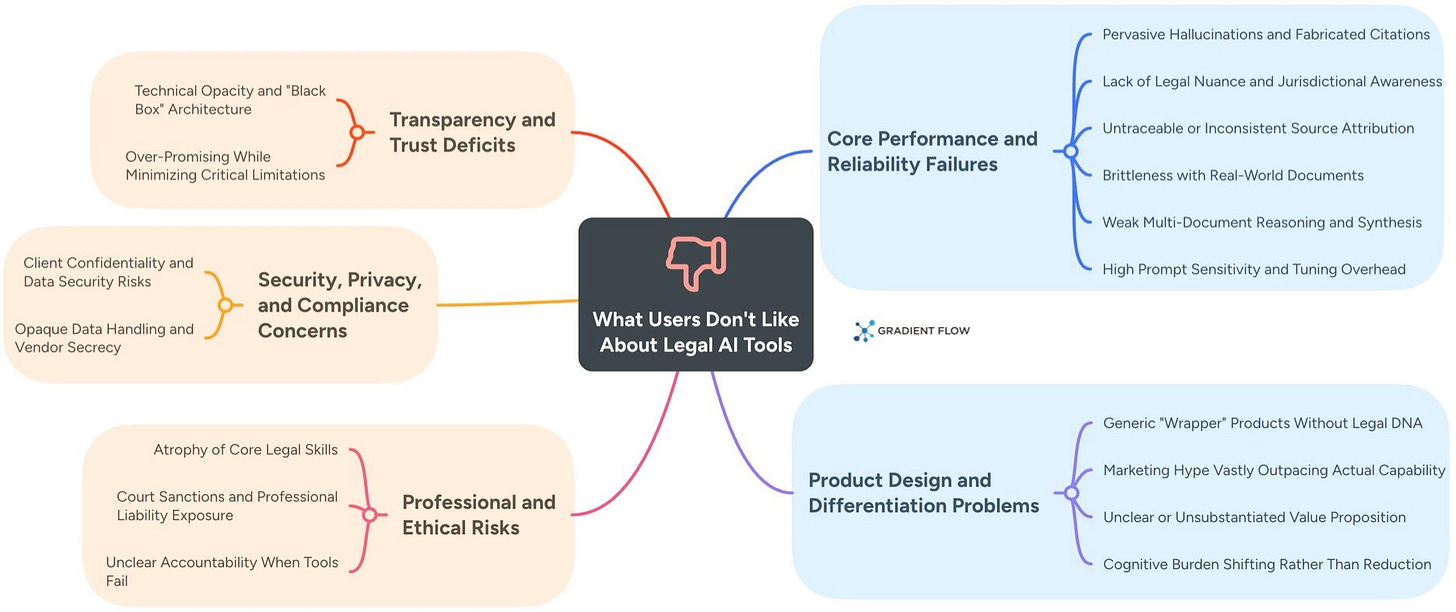

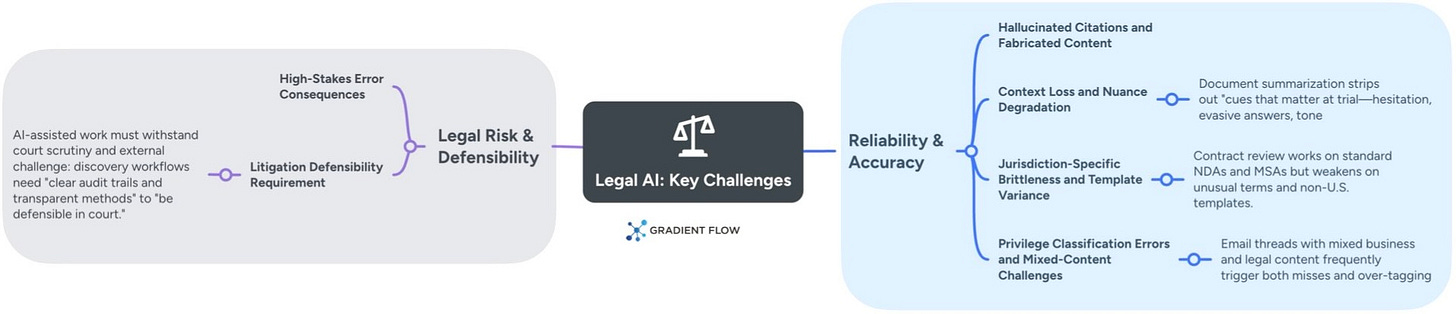

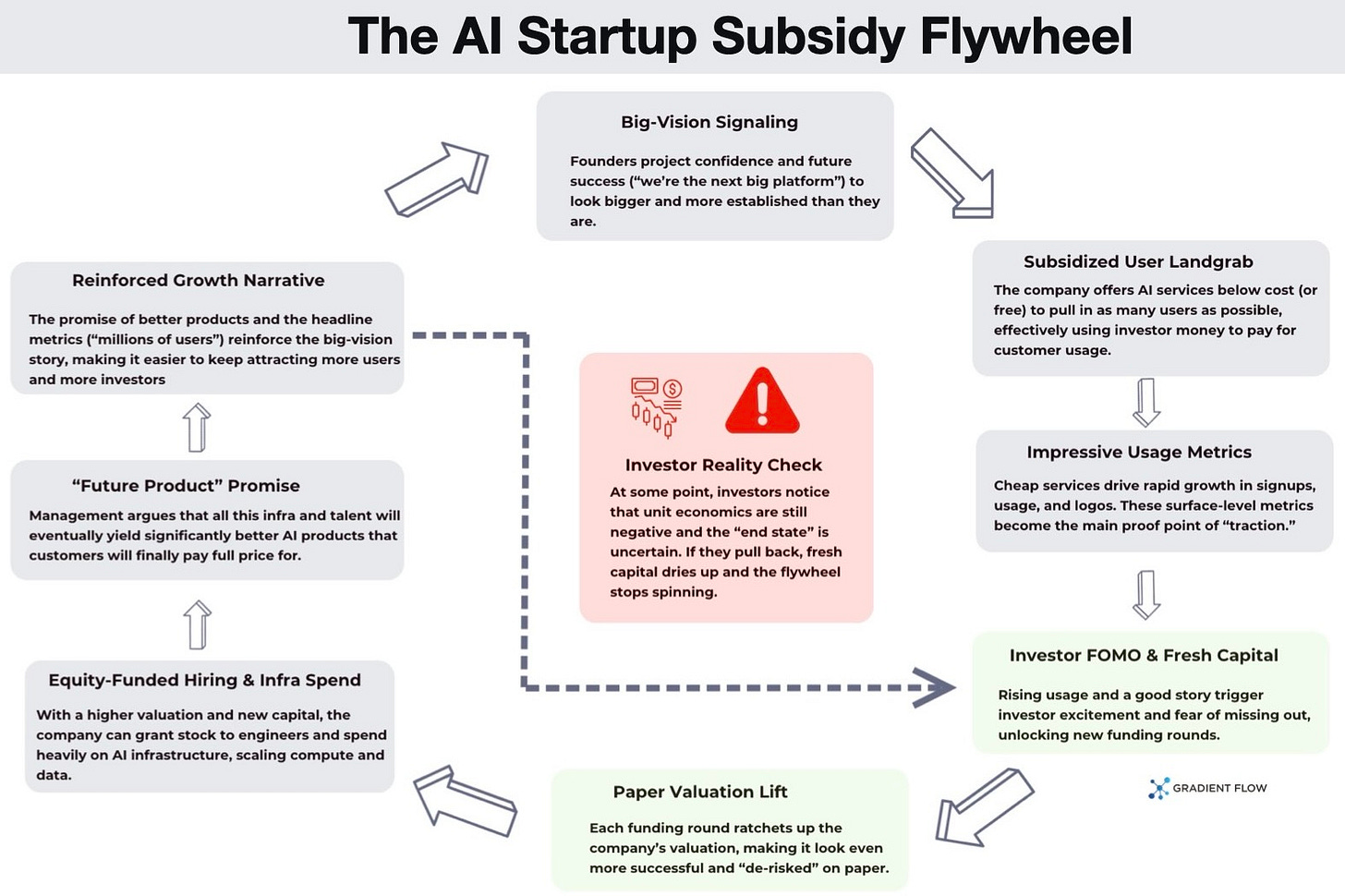

법률 산업은 텍스트 중심의 업무 특성상 생성형 AI 도입의 최전선에 있으나, 환각 현상과 신뢰성 문제로 인해 큰 도전에 직면해 있다. 현재 문서 요약 및 계약서 검토 등 일부 분야에서는 높은 채택률을 보이지만, 고위험 업무에서는 여전히 인간의 검증이 필수적이다. 향후 법률 AI는 단순한 래퍼 모델을 넘어 RAG 고도화, 감사 추적, 에이전트 워크플로우 도입을 통해 전문성을 강화할 것으로 전망된다. 또한 AI 스타트업들의 지속 가능성에 대한 투자자들의 냉정한 평가가 시작되고 있다.

배경

LLM 및 RAG의 기본 작동 원리, 법률 문서의 구조 및 계약서 검토 프로세스 이해, 데이터 보안 및 개인정보 보호 규정에 대한 기초 지식

대상 독자

법률 기술 도입을 검토 중인 로펌 파트너 및 리걸테크 개발자

의미 / 영향

법률 산업은 AI의 신뢰성을 테스트하는 가장 가혹한 시험대이며, 여기서 검증된 감사 추적과 권한 관리 기술은 향후 다른 고위험 전문직 분야의 표준이 될 것이다. 기술적 완성도뿐만 아니라 법적 책임과 거버넌스 체계가 동반되어야 실질적인 생산성 혁신이 가능하다.

섹션별 상세

실무 Takeaway

- 법률 RAG 시스템 구축 시 단순 검색을 넘어 인라인 인용과 추론 체인을 시각화하여 신뢰성과 투명성을 확보해야 한다.

- 고위험 법률 업무에 AI를 도입할 때는 인간 개입 시스템과 모든 프롬프트/출력을 기록하는 감사 추적 기능을 반드시 통합하여 법적 방어력을 갖춰야 한다.

- 단순한 범용 모델 기반 제품보다는 법률 특화 지식 그래프나 관할권별 튜닝이 적용된 전문 도구를 선택하는 것이 리스크 관리에 유리하다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.