핵심 요약

경쟁 프로그래밍과 같은 복잡한 알고리즘 추론 능력을 갖춘 모델을 개발하기 위해 강화학습(RL)의 중요성이 커지고 있다. 본 아티클은 Amazon SageMaker의 관리형 인프라 위에서 Ray 프레임워크와 veRL 라이브러리를 결합하여 70억 파라미터 규모의 CodeFu-7B 모델을 학습시키는 방법을 다룬다. 특히 GRPO(Group Relative Policy Optimization) 알고리즘을 적용하여 코드 실행 결과에 기반한 보상을 모델에 피드백함으로써 단순 패턴 암기가 아닌 실제 문제 해결 능력을 배양하는 과정을 상세히 설명한다. 분산 환경 구축부터 데이터 준비, 실시간 모니터링 및 지표 분석까지 아우르는 포괄적인 실무 가이드를 제공한다.

배경

AWS SageMaker 기초 지식, Ray 프레임워크 이해, 강화학습(PPO/GRPO) 개념, Docker 및 Python 숙련도

대상 독자

분산 강화학습을 통해 특화된 LLM을 개발하려는 ML 엔지니어 및 인프라 아키텍트

의미 / 영향

이 접근법은 경쟁 프로그래밍뿐만 아니라 수학적 증명, 논리적 추론 등 정답의 검증이 명확한 다양한 도메인에서 고성능 특화 모델을 효율적으로 학습시키는 표준 아키텍처가 될 수 있다.

섹션별 상세

이미지 분석

프롬프트 입력부터 vLLM의 응답 생성, Ray 기반의 분산 코드 실행 및 보상 계산, 그리고 최종적인 Actor 모델 업데이트까지의 전체 RL 루프를 6단계로 시각화한다.

veRL과 Ray를 이용한 CodeFu-7B 강화학습 아키텍처 다이어그램

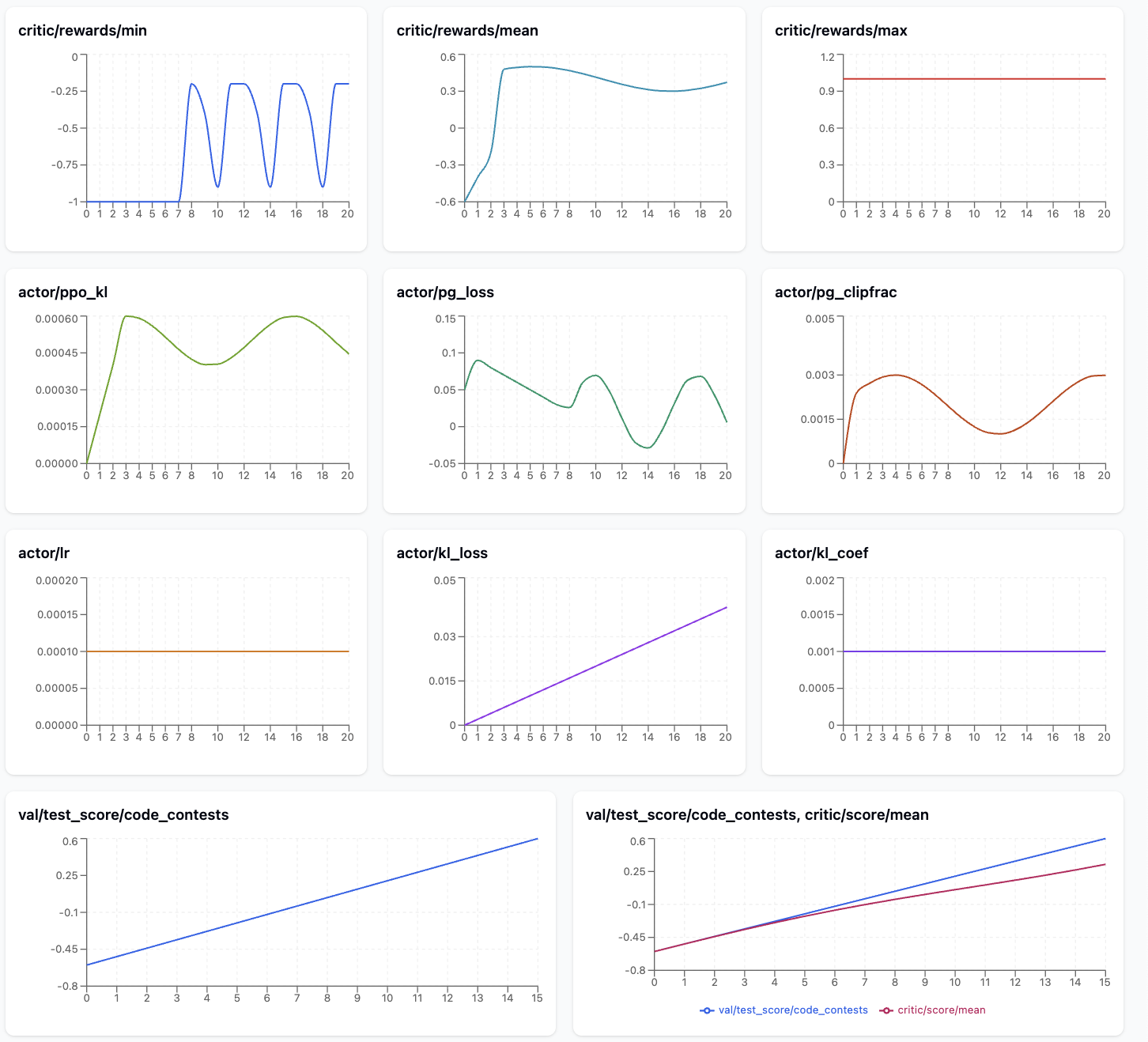

보상(Reward)의 증가 추세, PPO KL 발산의 안정성, 그리고 검증 데이터셋 점수의 향상을 보여주며 학습이 정상적으로 진행되고 있음을 증명한다.

GRPO 학습 과정에서의 주요 지표 그래프

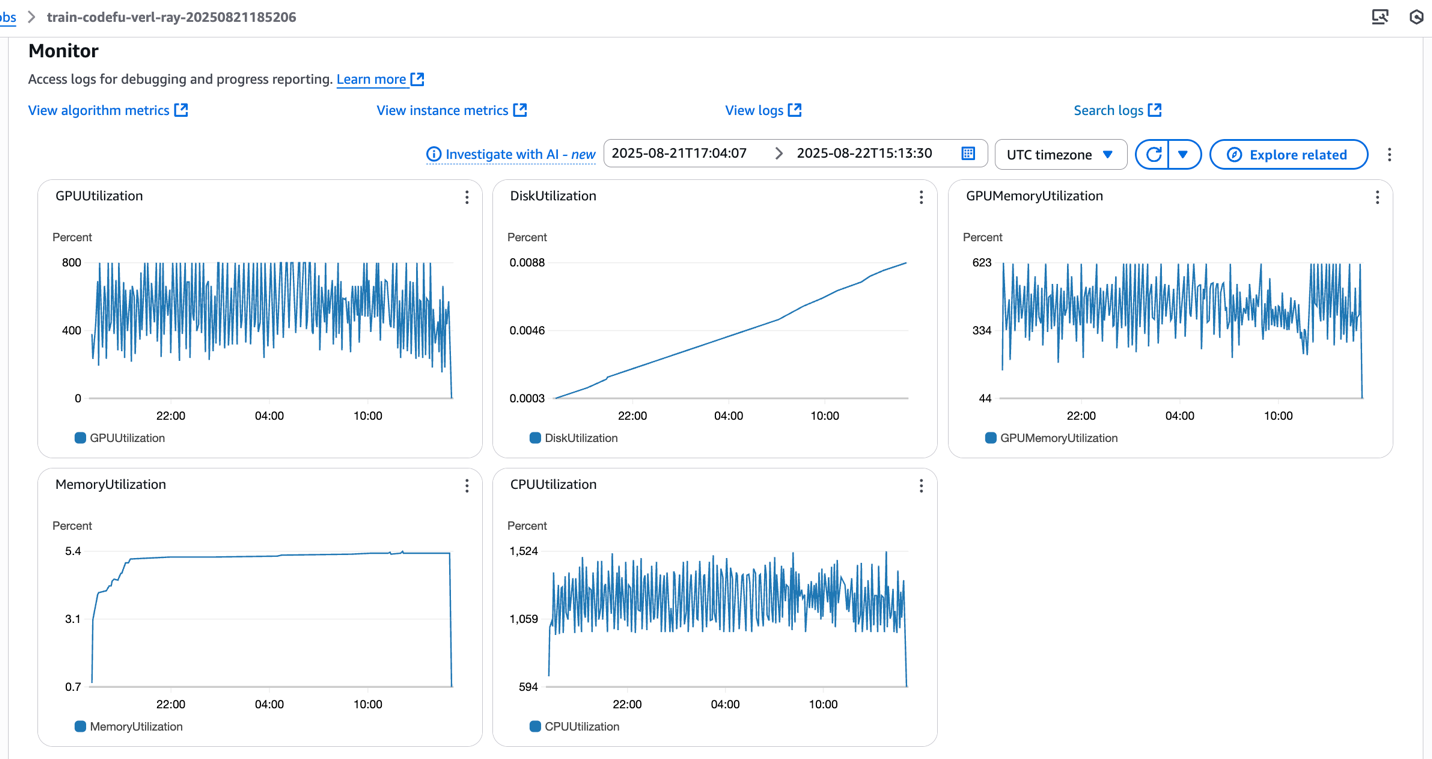

SageMaker에서 실행 중인 여러 노드(algo-1~4)의 CPU, 메모리, GPU 사용량 및 객체 저장소 상태를 실시간으로 모니터링하는 모습을 보여준다.

Ray Dashboard의 클러스터 노드 상태 화면

실무 Takeaway

- GRPO 알고리즘을 활용하면 별도의 비평가(Critic) 모델 없이도 그룹 내 상대적 비교를 통해 효율적이고 안정적인 강화학습이 가능하다.

- SageMaker의 ModelTrainer API와 Ray를 결합하면 수십 대의 GPU 노드를 사용하는 대규모 분산 학습 환경을 코드 몇 줄로 자동 구성할 수 있다.

- 코드 생성 모델 학습 시 실제 컴파일러와 런타임을 보상 함수에 통합하여 실행 가능한 코드 생성 능력을 직접적으로 최적화해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료