핵심 요약

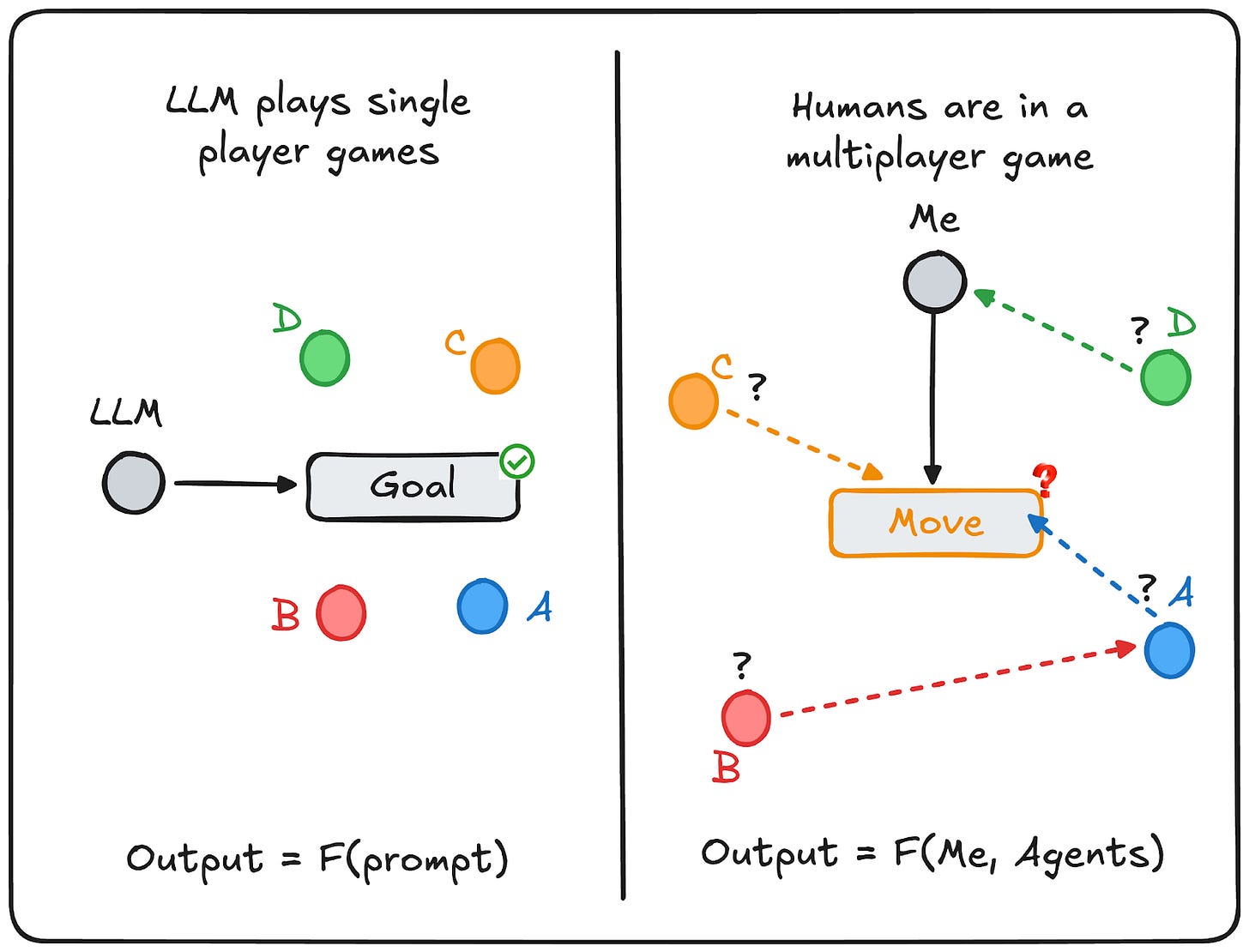

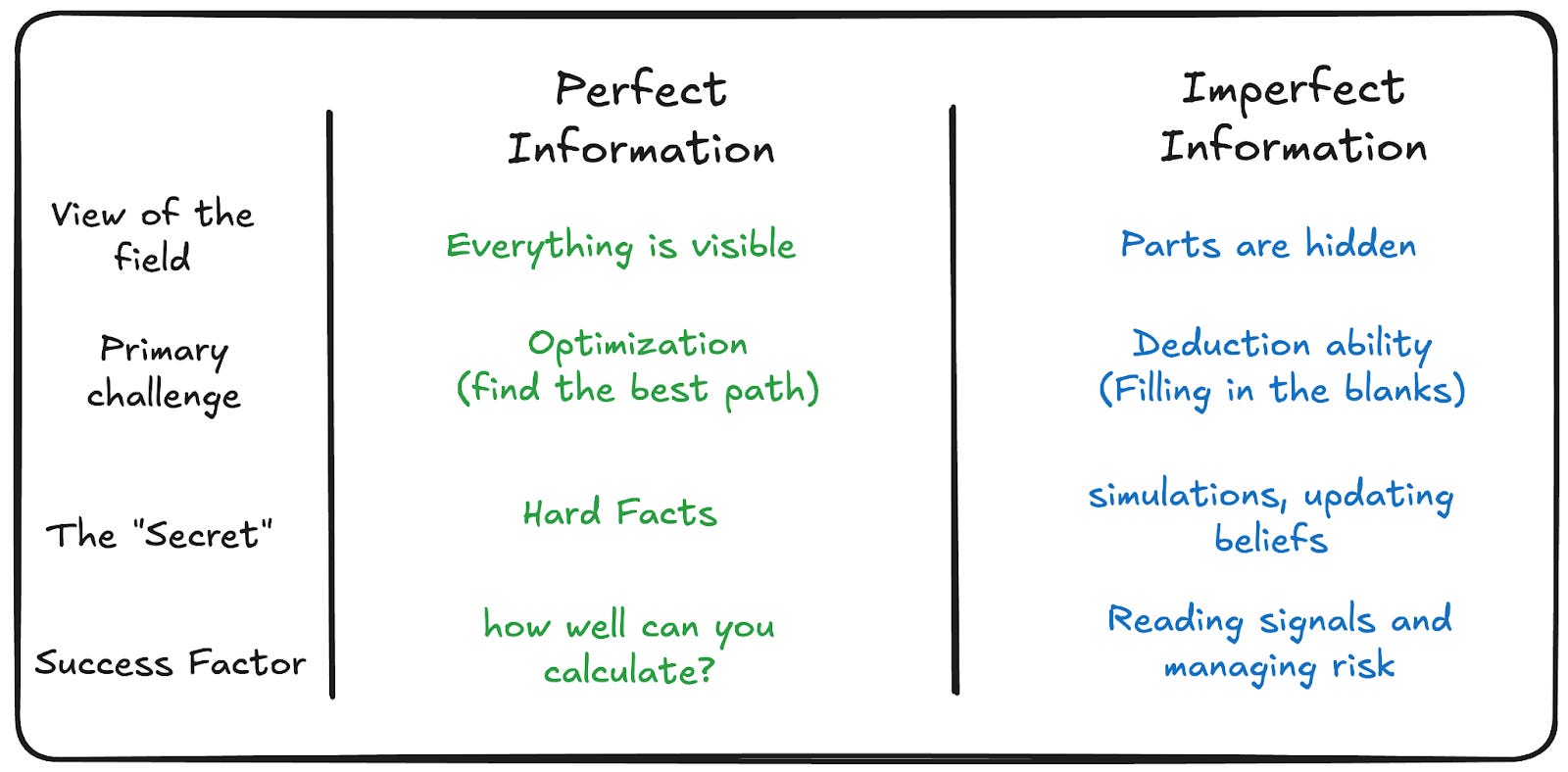

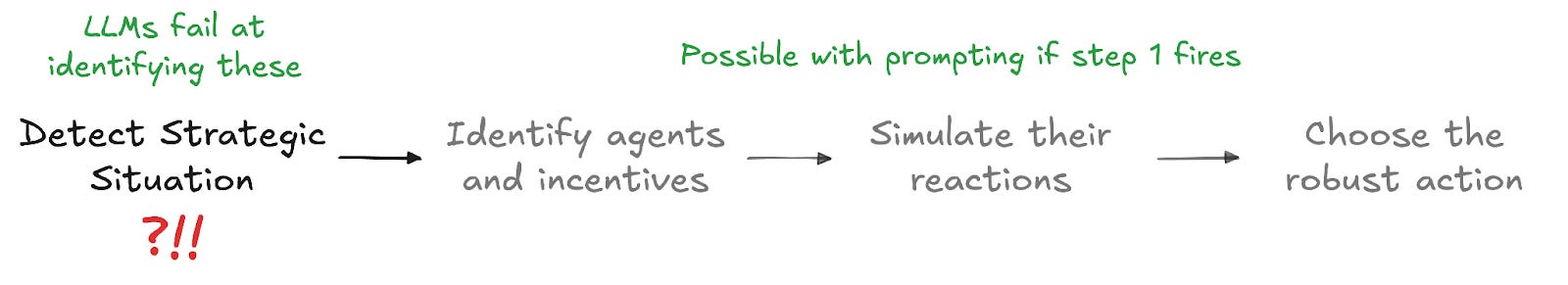

현재의 LLM은 다음 토큰을 예측하는 '단어 모델'에 기반하여 겉보기에 완벽한 결과물을 만들어내지만, 실제 환경에서 타인과 상호작용하는 '세계 모델'은 부족하다. 체스처럼 모든 정보가 공개된 영역에서는 LLM이 우수하지만, 포커처럼 숨겨진 정보와 상대의 의도를 읽어야 하는 영역에서는 한계를 보인다. 전문가들은 결과물 자체보다 그 결과물이 환경 내 다른 에이전트들에게 어떤 반응을 이끌어낼지를 시뮬레이션하며, AI가 이를 극복하기 위해서는 결과 중심의 강화학습과 멀티 에이전트 훈련이 필요하다.

배경

LLM 추론 메커니즘에 대한 기본 이해, RLHF 및 강화학습의 기본 개념, 게임 이론의 기초 지식

대상 독자

LLM 에이전트를 개발하거나 프로덕션에 배포하는 엔지니어 및 AI 전략가

의미 / 영향

이 아티클은 LLM의 추론 능력이 텍스트 생성 수준을 넘어 타인의 심리와 사회적 역학을 시뮬레이션하는 방향으로 진화해야 함을 시사한다. 이는 향후 AI 훈련 방식이 정적인 데이터셋 학습에서 동적인 멀티 에이전트 환경에서의 강화학습으로 이동할 것임을 예고한다.

섹션별 상세

실무 Takeaway

- LLM을 비즈니스 협상이나 보안 에이전트로 활용할 때, 모델의 '협력적 편향'이 전략적 약점이 될 수 있음을 인지하고 적대적 시뮬레이션을 통한 검증을 수행해야 한다.

- 코드 작성이나 데이터 변환처럼 '세계 모델'이 필요 없는 결정론적 작업은 현재의 LLM으로 충분히 자동화 가능하지만, 이해관계자 조율이 필요한 영역은 여전히 전문가의 시뮬레이션 능력이 필요하다.

- 미래의 AI 에이전트 성능은 단순한 추론 능력(IQ)의 향상보다, 상대방의 의도를 읽고 자신의 행동이 미칠 2차 효과를 계산하는 '전략적 견고성' 확보에 달려 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.