핵심 요약

고위험 모니터링 분야에서 AI의 단독 자동화는 예외 상황이나 데이터 부재로 인한 위험을 초래할 수 있다. 이를 해결하기 위해 인간과 AI가 협력하는 '인간 참여형(Human-In-The-Loop, HITL)' 디자인 패턴이 필수적이다. 본 아티클은 신뢰도가 낮은 예측을 인간 전문가에게 라우팅하고, 그 수정을 다시 학습에 반영하는 액티브 러닝 구조를 설명한다. Roboflow Workflows를 활용해 항공 차량 탐지 모델의 성능을 체계적으로 개선하는 실전 사례를 통해 신뢰할 수 있는 AI 배포 방법을 제시한다.

배경

컴퓨터 비전 기초 지식, 객체 탐지(Object Detection) 모델 개념, 데이터 라벨링 및 학습 프로세스 이해

대상 독자

고위험 환경(보안, 의료, 교통 등)에서 컴퓨터 비전 모델을 배포하려는 ML 엔지니어 및 프로덕트 매니저

의미 / 영향

AI의 불완전함을 인정하고 인간의 판단을 시스템 아키텍처에 내재화함으로써, 기술적 한계로 도입이 지연되던 고위험 분야의 AI 상용화를 가속화할 것이다. 이는 단순한 모델 성능 향상을 넘어 책임감 있는 AI 배포를 위한 표준 프레임워크를 제공한다.

섹션별 상세

이미지 분석

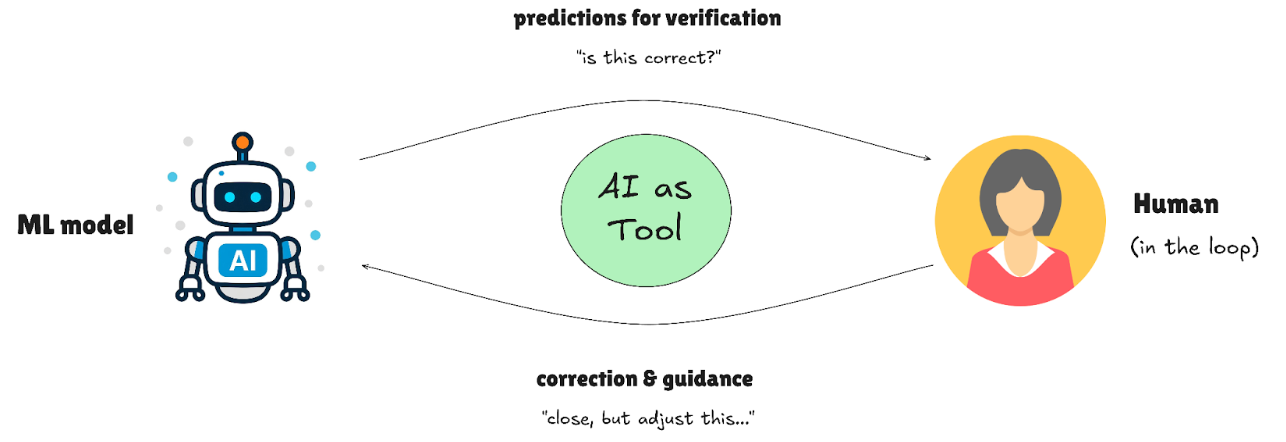

ML 모델이 예측 결과를 인간에게 전달하면 인간이 이를 검증하고 수정 사항을 다시 모델에 피드백하는 순환 구조를 시각화한다. AI를 단순한 자동화 도구가 아닌 인간과 협력하는 파트너로 정의하는 핵심 개념을 전달한다.

인간과 ML 모델 간의 상호작용을 보여주는 HITL 개념도

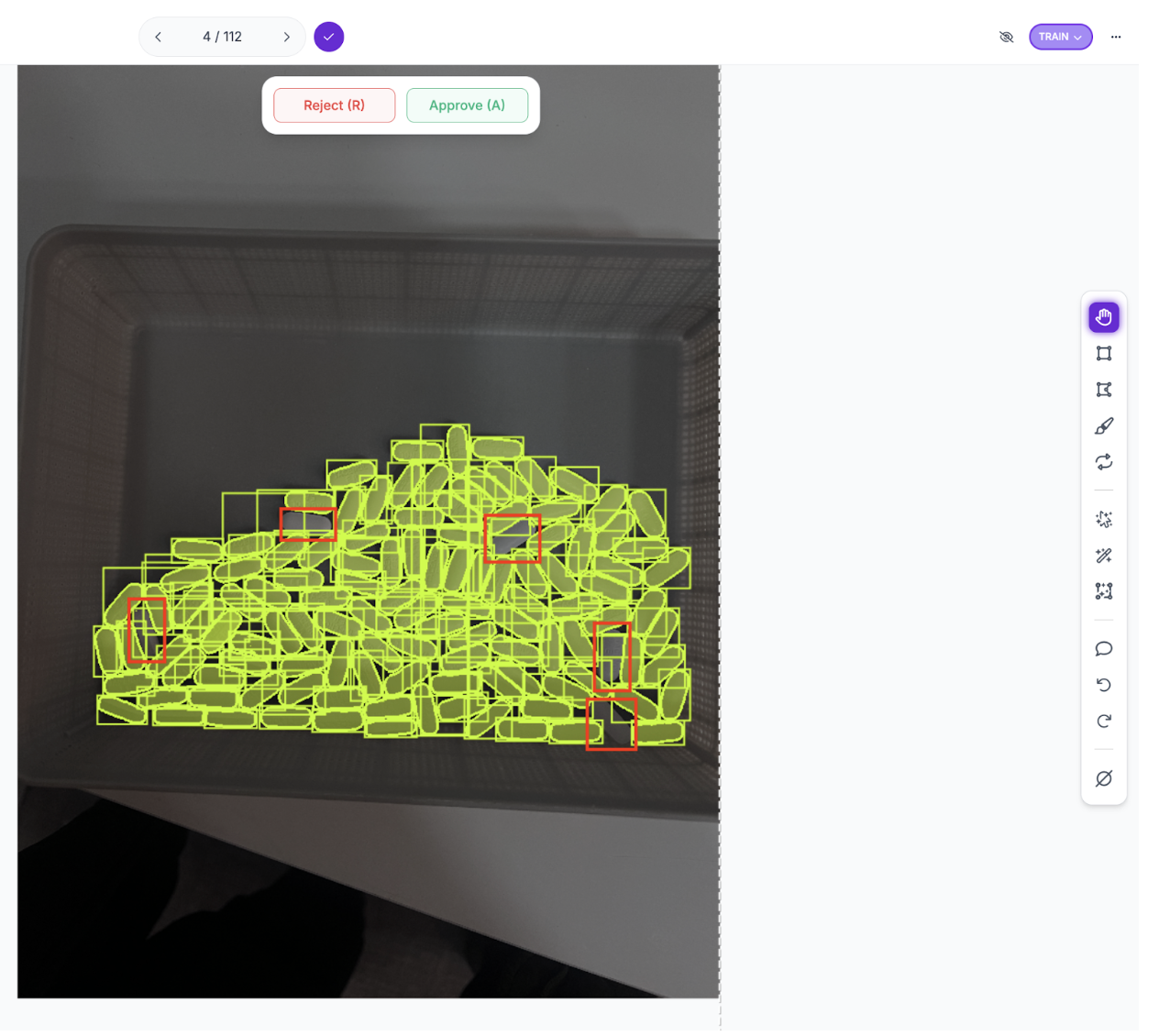

100개 이상의 알약 중 5개를 놓친 실제 사례를 통해 AI 자동 라벨링의 한계와 인간의 수정이 필요한 이유를 구체적으로 보여준다. 고위험 분야에서 이러한 미검출이 치명적일 수 있음을 시사한다.

SAM 3 자동 라벨링 도구가 알약 탐지 중 일부를 놓친 사례

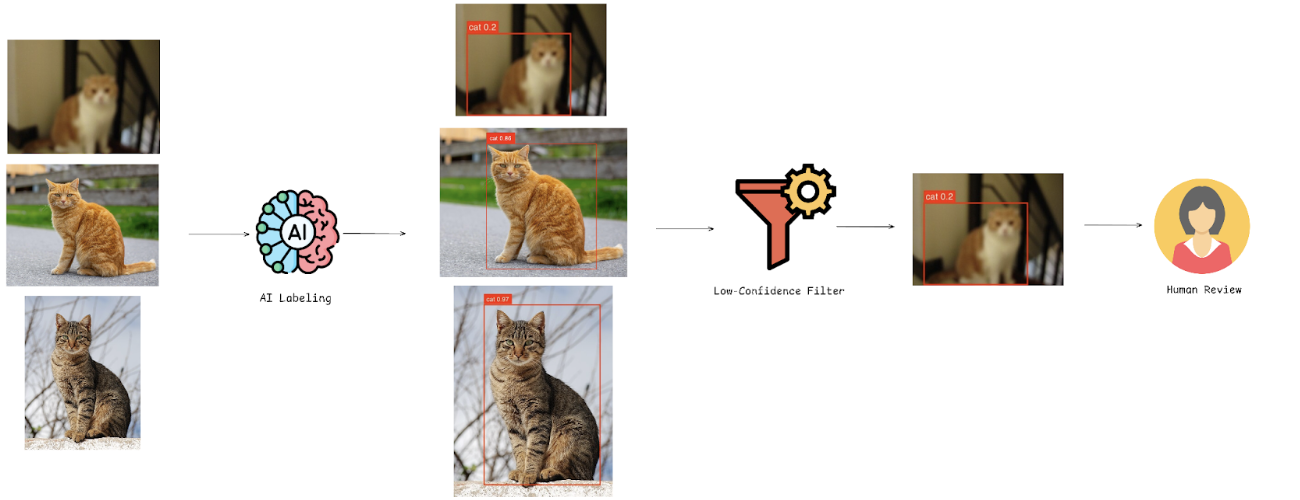

AI 라벨링 후 저신뢰도 필터를 거쳐 인간 리뷰로 이어지는 데이터 흐름을 설명한다. 모든 데이터를 검토하는 대신 모델이 확신하지 못하는 데이터만 선별하여 효율성을 높이는 과정을 보여준다.

저신뢰도 필터를 포함한 액티브 러닝 워크플로우 다이어그램

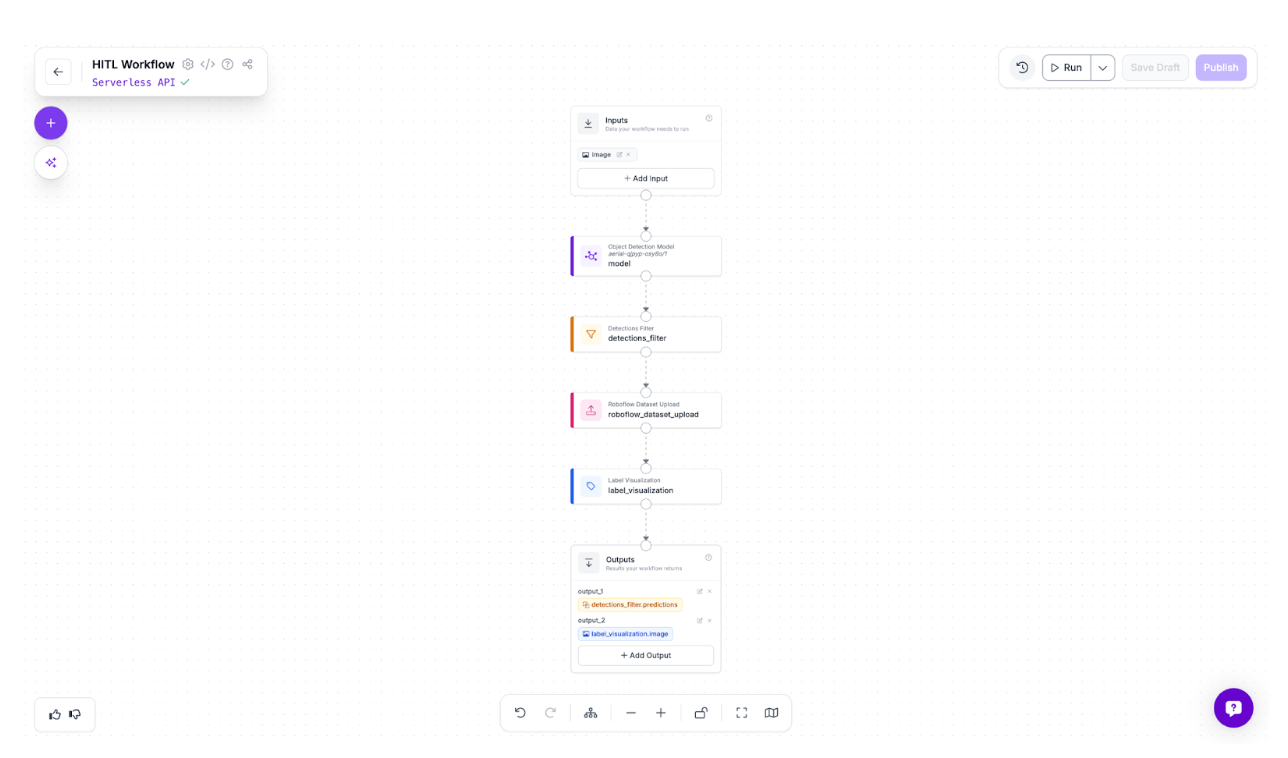

입력, 객체 탐지 모델, 탐지 필터, 데이터셋 업로드, 시각화 블록이 연결된 실제 구현 화면이다. 튜토리얼에서 설명하는 HITL 시스템의 기술적 아키텍처를 한눈에 파악할 수 있게 한다.

Roboflow Workflows에서 구현된 HITL 노드 구성

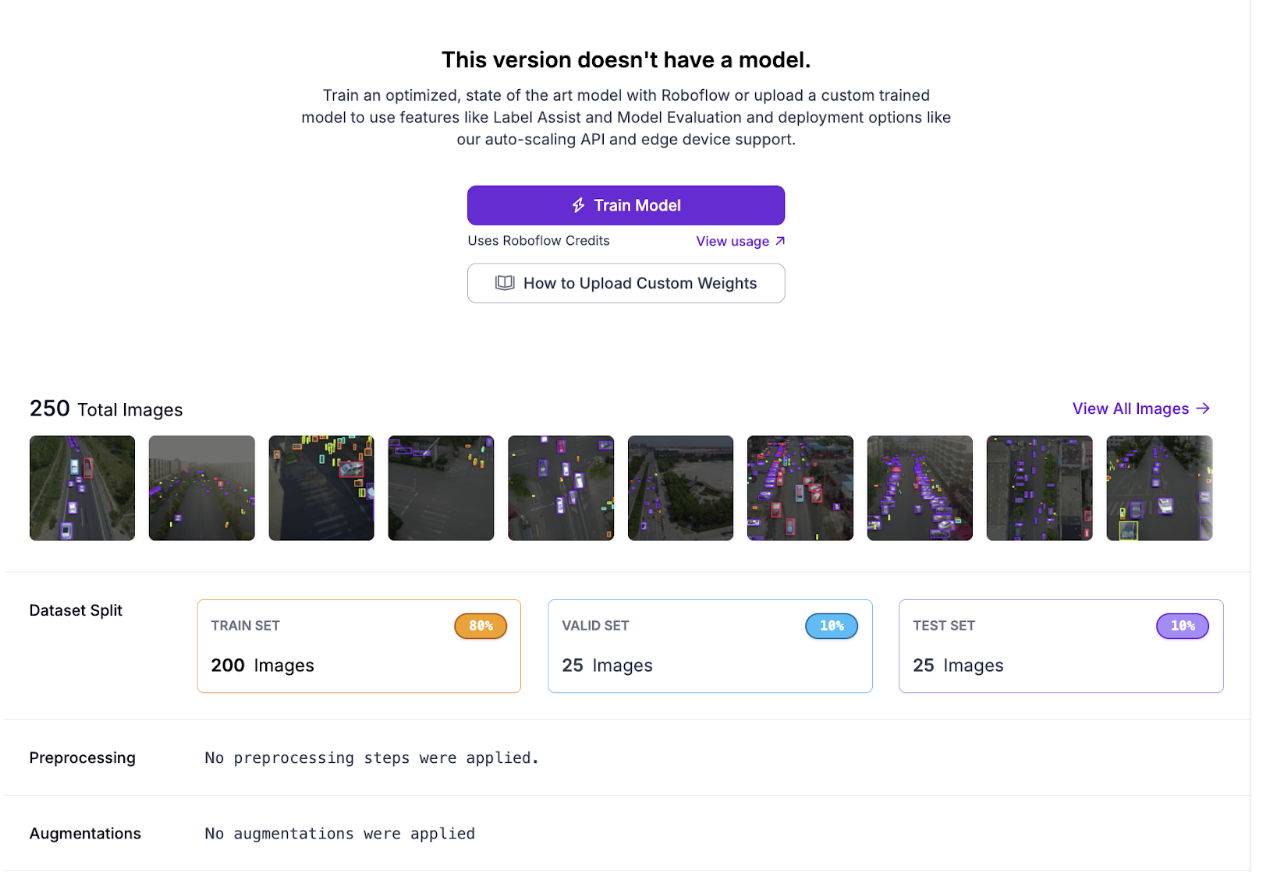

수정된 엣지 케이스가 포함된 250장의 이미지를 훈련, 검증, 테스트 세트로 나누어 관리하는 화면이다. HITL 루프를 통해 수집된 데이터가 실제 학습 파이프라인에 어떻게 통합되는지 보여준다.

데이터셋 버전 관리 및 학습 데이터 분할 화면

실무 Takeaway

- 신뢰도 임계값(예: 50% 이하)을 설정하여 불확실한 예측만 인간에게 라우팅함으로써 검토 병목 현상을 최소화한다.

- SAM 3와 같은 자동 라벨링 도구를 활용해 초기 데이터 구축 시간을 80%까지 절감하고 인간은 엣지 케이스 수정에 집중한다.

- 수정된 엣지 케이스를 학습 데이터셋에 즉시 통합하는 자동화된 파이프라인을 구축하여 모델의 약점을 체계적으로 보완한다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료