핵심 요약

커스텀 객체 탐지 모델인 RF-DETR XL을 활용하여 주요 클라우드 제공업체의 서버리스 GPU 추론 비용을 세 가지 트래픽 시나리오에 따라 비교했습니다. Roboflow는 공유 인프라를 통해 낮은 빈도의 요청에서 가장 경제적인 비용 구조를 보였으며, 대형 클라우드사들은 스케일 투 제로(Scale-to-Zero) 정책과 긴 콜드 스타트 시간으로 인해 간헐적 트래픽에서 비용 효율성이 달라졌습니다. 특히 10~30초 간격의 지속적 요청 시에는 대부분의 클라우드에서 인스턴스를 항상 켜두어야 하므로 고정 비용이 발생함을 확인했습니다. 결론적으로 트래픽의 빈도와 콜드 스타트에 대한 허용 범위에 따라 최적의 플랫폼 선택이 달라집니다.

배경

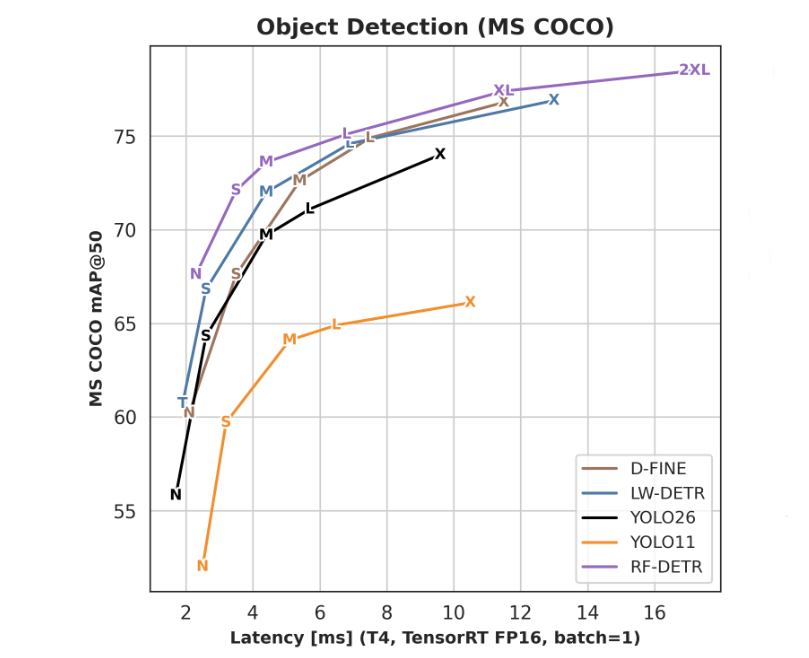

객체 탐지(Object Detection) 모델에 대한 기본 이해, GPU 인스턴스 유형(T4, L4 등) 및 클라우드 과금 체계 지식, TensorRT 등 모델 최적화 기법에 대한 이해

대상 독자

비전 AI 모델을 프로덕션에 배포하려는 ML 엔지니어 및 비용 최적화가 필요한 클라우드 아키텍트

의미 / 영향

이 분석은 서버리스 GPU가 단순히 '사용한 만큼 지불'하는 것을 넘어, 각 벤더의 스케일 투 제로 정책과 콜드 스타트 시간에 따라 실질 비용이 크게 달라짐을 시사합니다. 특히 비전 모델처럼 즉각적인 응답이 중요한 분야에서는 비용뿐만 아니라 지연 시간과의 트레이드오프를 정밀하게 계산해야 합니다.

섹션별 상세

실무 Takeaway

- 요청 빈도가 낮거나 불규칙한 초기 서비스라면 인스턴스 관리 부담이 없고 요청당 과금 효율이 높은 Roboflow Serverless API가 가장 경제적입니다.

- 30분 단위의 대량 배치(Burst) 작업에는 Azure Container Apps나 AWS SageMaker의 비동기 추론을 활용하는 것이 시간당 비용을 0.2달러 미만으로 낮추는 최적의 선택입니다.

- 모든 주요 클라우드에서 30초 이내 간격의 지속적 요청이 발생할 경우 서버리스의 비용 이점보다는 상시 가동 인스턴스 비용이 발생하므로 콜드 스타트가 없는 일반 배포 방식을 고려해야 합니다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.