핵심 요약

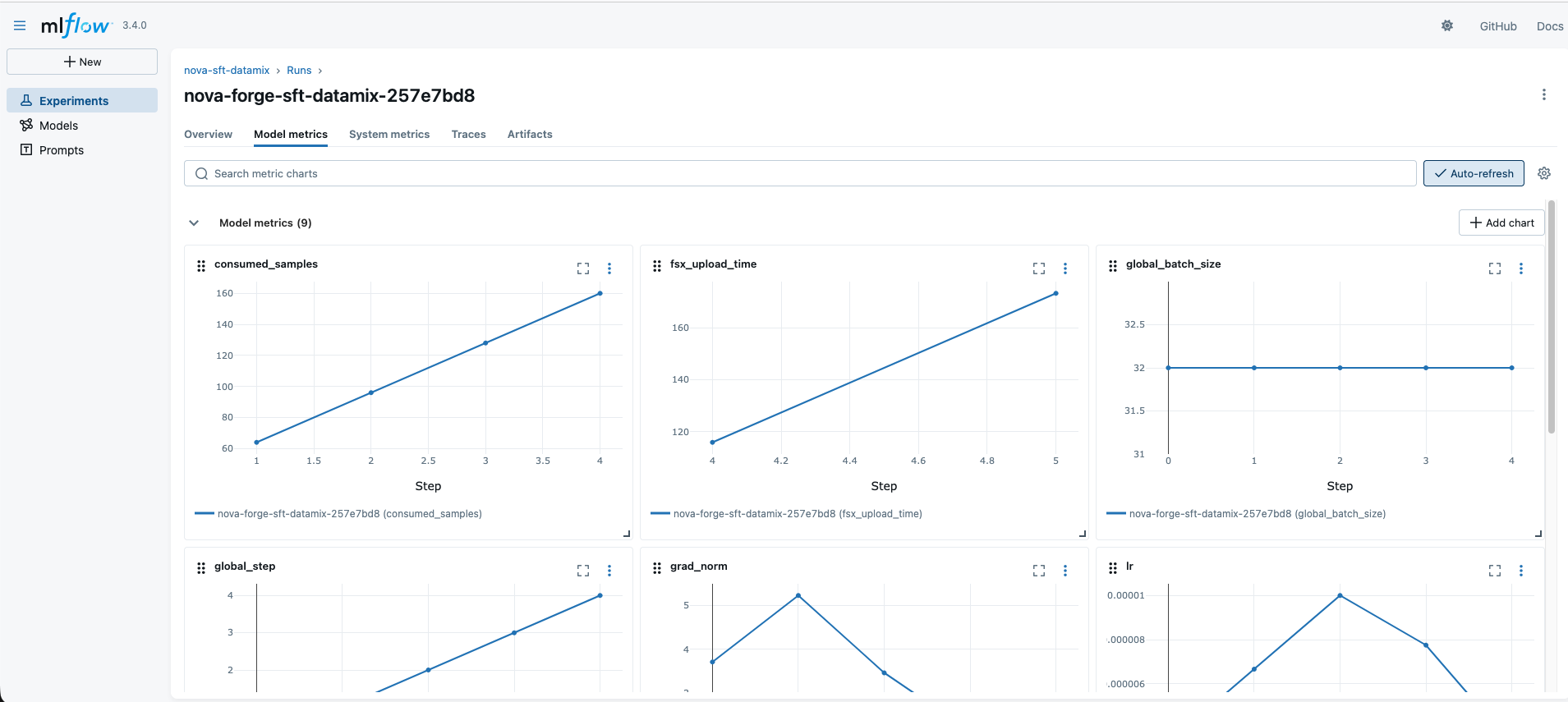

Amazon Nova 모델의 일반적인 추론 능력을 손상시키지 않으면서 특정 도메인에 최적화하는 파인튜닝 기법인 데이터 믹싱의 실무 적용 방법을 다룬다. Nova Forge SDK를 사용하여 데이터 준비, LoRA 기반 학습 설정, 그리고 데이터 혼합 비율 조정 과정을 단계별로 제시한다. 실제 테스트 결과, 고객 데이터만 학습했을 때 MMLU 점수가 0.75에서 0.47로 급락한 반면, 데이터 믹싱을 적용하면 0.74 수준을 유지하면서도 도메인 F1 점수를 12포인트 향상시켰다. 이 가이드는 SageMaker HyperPod 인프라를 활용한 효율적인 학습과 MLflow를 통한 실험 관리 및 다차원 평가 체계를 포함한다.

배경

AWS 계정 및 Amazon Nova Forge 접근 권한, SageMaker HyperPod 클러스터 (GPU 인스턴스), Python 및 Jupyter Notebook 환경 지식, 기본적인 LLM 파인튜닝 및 LoRA 개념 이해

대상 독자

AWS 환경에서 Amazon Nova 모델을 사용하여 도메인 특화 LLM을 구축하려는 머신러닝 엔지니어 및 솔루션 아키텍트

의미 / 영향

이 가이드는 기업들이 자체 데이터를 학습시킬 때 겪는 가장 큰 문제인 '모델의 바보화(지능 저하)'를 해결할 수 있는 구체적인 방법론을 제시합니다. Nova Forge SDK의 데이터 믹싱 기능을 통해 고성능 도메인 모델을 안전하게 구축할 수 있게 됨으로써, 금융, 의료 등 전문 지식이 필요한 산업군에서 LLM 도입 장벽이 크게 낮아질 것으로 예상됩니다.

섹션별 상세

customizer = NovaModelCustomizer(

model=Model.NOVA_LITE_2,

method=TrainingMethod.SFT_LORA,

infra=runtime,

data_s3_path=f"{S3_DATA_PATH}/train.jsonl",

output_s3_path=f"{S3_OUTPUT_PATH}/",

mlflow_monitor=mlflow_monitor,

data_mixing_enabled=True,

)데이터 믹싱 기능을 활성화하여 Nova 모델 커스터마이저 객체를 생성하는 예시

customizer.set_data_mixing_config({

"customer_data_percent": 50,

"nova_instruction-following_percent": 13,

"nova_reasoning-instruction-following_percent": 45,

"nova_baseline_percent": 10,

})사용자 데이터와 Amazon 큐레이션 데이터 간의 혼합 비율을 설정하는 예시

실무 Takeaway

- 도메인 특화 파인튜닝 시 customer_data_percent를 50%로 시작하여 MMLU 점수 하락 폭이 0.02 이내가 되도록 데이터 믹싱 비율을 조정해야 한다.

- 학습 전 데이터 정제 단계에서 'System:', 'Assistant:'와 같은 예약어 토큰을 제거하거나 변형하여 모델의 챗 템플릿 구조가 깨지지 않도록 관리해야 한다.

- 초기 학습은 비용 효율적인 LoRA 방식을 우선 적용하고, 도메인 적응도가 충분하지 않을 경우에만 전체 파라미터를 학습시키는 Full-rank SFT로 전환한다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.