이 요약은 AI가 원문을 분석해 생성했습니다. 정확한 내용은 원문 기준으로 확인하세요.

핵심 요약

163M 파라미터 규모의 GPT-2 스타일 모델을 Hugging Face FineWeb 데이터셋으로 학습하며 57개 체크포인트별 생성 텍스트의 변화를 분석했다. 초기 토큰 나열 수준에서 시작해 학습이 진행됨에 따라 문법적 구조와 의미를 갖춘 문장으로 발전하는 과정을 추적했다. 학습 데이터의 1/3 지점에서 이미 문맥적으로 타당한 텍스트 생성이 가능해짐을 확인했다. 모델의 최종 성능은 단순한 문장 생성을 넘어 정보의 정확성과 논리적 일관성을 확보하는 방향으로 수렴한다.

대상 독자

LLM 학습 메커니즘과 모델 성능 변화에 관심 있는 개발자

의미 / 영향

소규모 모델 학습 과정을 통해 LLM의 언어 습득 단계를 시각화함으로써, 모델의 크기와 학습 데이터량이 생성 품질에 미치는 영향을 직관적으로 이해할 수 있게 한다. 이는 효율적인 모델 학습 전략 수립을 위한 기초 자료로 활용 가능하다.

섹션별 상세

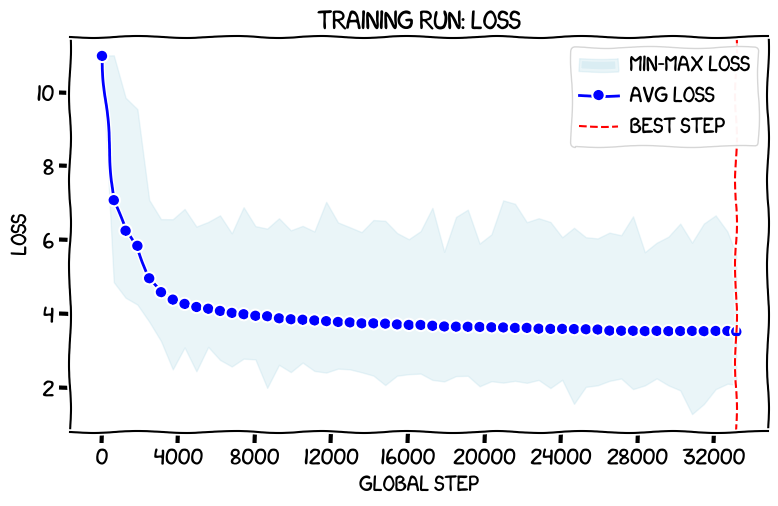

163M 파라미터 모델을 3.2B 토큰으로 학습하며 57개 체크포인트를 저장해 생성 품질 변화를 기록했다. 학습 루프는 1,024 토큰 시퀀스 96개를 한 단계로 처리하며, 단계마다 손실값을 기반으로 가중치를 갱신했다.

초기 단계에서는 의미 없는 토큰이 나열되지만, 학습 데이터의 1/3 지점인 약 10억 토큰 학습 시점에서 이미 문법적으로 그럴듯한 문장을 생성하기 시작했다. 이는 캐릭터 단위 모델과 달리 토큰 단위로 처리하는 Transformer 구조의 특성에서 기인한다.

학습 중반 이후에는 문장 구조가 안정화되나, 작은 모델 특유의 반복적인 문구 생성이나 문맥 이탈 현상이 관찰됐다. 후반부 학습은 생성된 텍스트의 논리적 일관성과 정확성을 높이는 정제 과정으로 작용한다.

실무 Takeaway

- 소규모 LLM도 학습 데이터의 1/3 수준에서 이미 문법적으로 타당한 텍스트를 생성할 수 있다.

- 학습 후반부의 손실값 감소는 단순한 문장 생성 능력이 아닌, 정보의 정확성과 논리적 일관성을 개선하는 데 기여한다.

언급된 리소스

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

원문 발행 2026. 04. 18.수집 2026. 04. 18.출처 타입 RSS

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.