핵심 요약

대형 언어 모델(LLM)의 로컬 추론은 막대한 VRAM 요구량으로 인해 개인용 하드웨어에서 한계가 존재했다. AMD는 Ryzen™ AI Max+ 플랫폼과 llama.cpp의 RPC 기능을 활용하여 4대의 AI PC를 하나의 가상 가속기로 통합하는 분산 추론 환경 구축 방법을 공개했다. 이를 통해 1조 파라미터급 모델인 Kimi K2.5를 로컬에서 실행하며, 커널 수준의 VRAM 확장과 Flash Attention 최적화를 통해 실용적인 추론 속도를 확보할 수 있음을 입증했다. 분산 로컬 추론은 클라우드 비용 부담 없이 데이터 프라이버시를 유지하며 초거대 모델을 연구하고 프로토타이핑하는 데 효과적이다.

배경

Linux (Ubuntu 24.04) 운영 체제 숙련도, AMD ROCm 드라이버 및 SDK 설치 지식, llama.cpp 빌드 및 CLI 파라미터 이해, 기본적인 네트워크 네트워킹 및 RPC 개념

대상 독자

로컬 환경에서 초거대 LLM을 구동하려는 연구자 및 시스템 엔지니어

의미 / 영향

고가의 서버용 GPU 없이도 소비자용 하드웨어 클러스터링을 통해 1조 파라미터급 모델을 연구 및 프로토타이핑에 활용할 수 있는 실질적인 경로를 제시한다. 이는 데이터 보안이 중요한 기업 환경에서 클라우드 의존도를 낮추는 대안이 된다.

섹션별 상세

이미지 분석

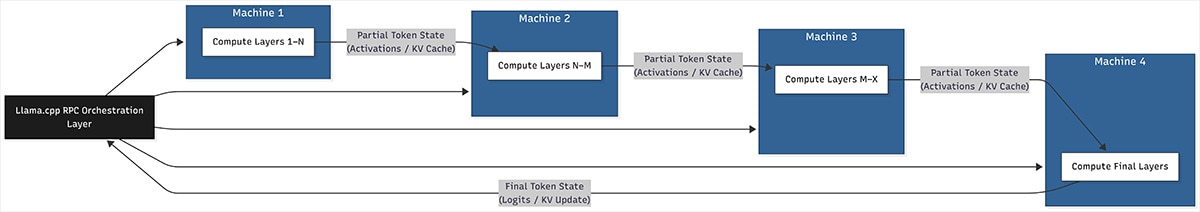

하나의 호스트 머신이 컨트롤러 역할을 수행하며 나머지 3개의 원격 호스트에 추론 작업을 분산하는 구조를 보여준다. 각 노드는 5Gbps 이더넷으로 연결되어 단일 논리적 가속기처럼 작동함을 시각화한다.

4개 노드로 구성된 llama.cpp RPC 네트워크 토폴로지 다이어그램이다.

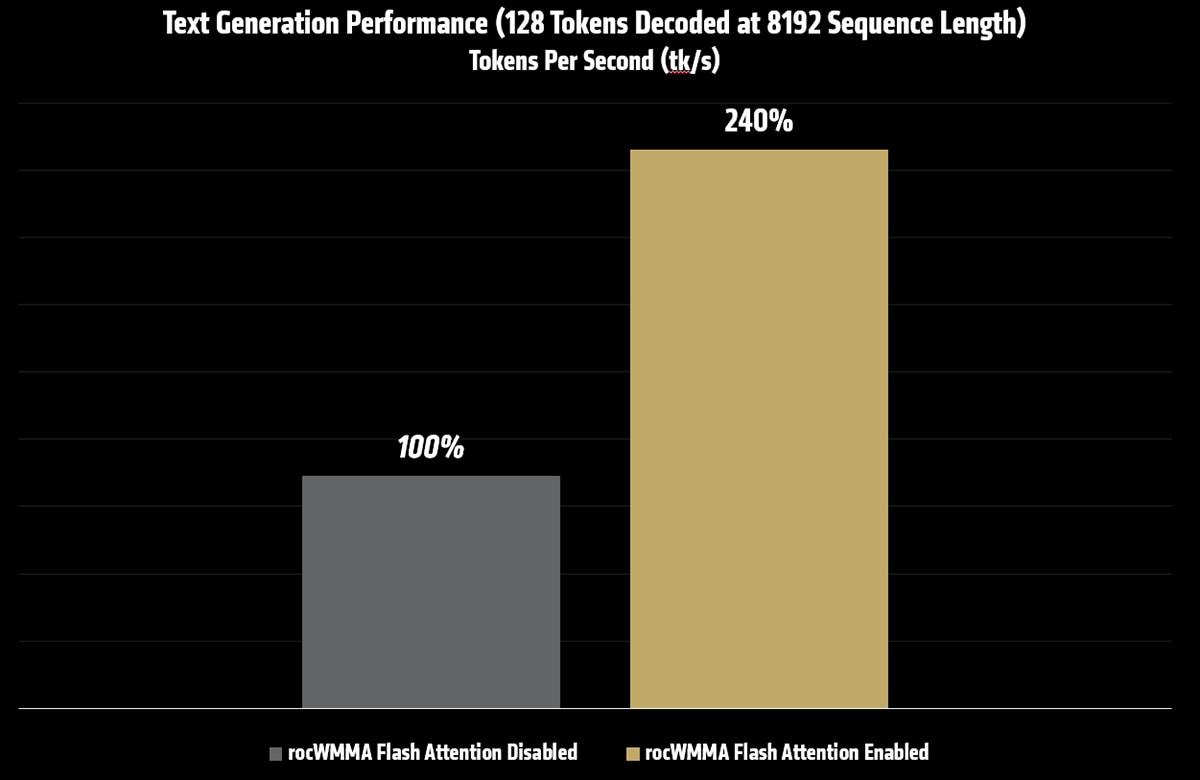

시퀀스 길이가 8192일 때 Flash Attention을 사용하면 초당 토큰 생성량이 3.46tk/s에서 8.30tk/s로 대폭 향상됨을 수치로 증명한다. 긴 문맥에서 최적화 알고리즘의 중요성을 나타낸다.

Flash Attention 활성화 여부에 따른 텍스트 생성 성능 비교 차트이다.

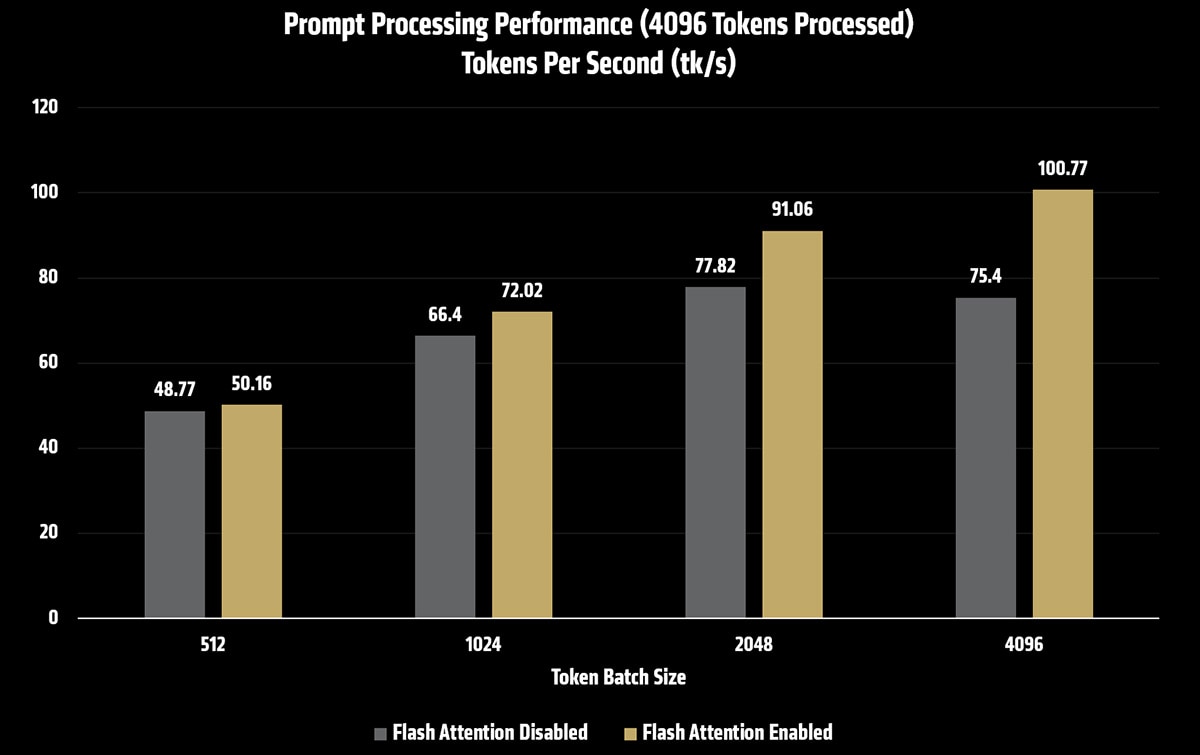

배치 사이즈가 커질수록 처리량이 증가하며, 특히 Flash Attention과 결합했을 때 4096 배치 사이즈에서 최대 성능인 100.77tk/s에 도달함을 보여준다. 이는 첫 번째 토큰 생성 시간(TTFT) 단축 효과를 뒷받침한다.

배치 사이즈 및 Flash Attention 설정에 따른 프롬프트 처리 성능 차트이다.

실무 Takeaway

- 리눅스 커널의 ttm.pages_limit와 amdgpu.gttsize 파라미터를 조정하여 iGPU가 사용할 수 있는 시스템 메모리 공유 한도를 노드당 120GB까지 극대화한다.

- llama.cpp RPC 기능을 활용하면 고가의 서버급 GPU 없이도 소비자용 AI PC 여러 대를 묶어 1조 파라미터 모델용 통합 VRAM 환경을 구축할 수 있다.

- 긴 문맥 추론 시에는 반드시 -fa on 옵션으로 Flash Attention을 활성화하여 메모리 부족(OOM)을 방지하고 처리 속도를 2배 이상 높여야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료