핵심 요약

AI 모델의 성능이 급격히 향상됨에 따라 모델이 자율적으로 작업을 수행할 수 있는 시간을 측정하는 시간 지평(Time Horizon) 지표가 주목받고 있다. METR의 Joel Becker는 최근 화제가 된 지수적 성장 그래프의 배경과 그 측정 방식에 포함된 통계적 노이즈를 상세히 서술한다. 특히 벤치마크 데이터셋의 포화 상태와 샘플 수의 부족으로 인해 발생하는 해석의 오류를 경고하며 단순한 수치 이상의 맥락 파악이 중요함을 강조한다. 또한 AI가 개발자 생산성에 미치는 실제 영향과 미래의 위협 모델 평가 로드맵을 함께 제시한다.

배경

LLM 벤치마크 기본 지식, 통계적 오차 범위(Confidence Interval) 이해, AI 에이전트 개념

대상 독자

AI 모델 평가 및 안전성 연구자, LLM 에이전트 개발자, 기술 전략가

의미 / 영향

AI 성능 측정 방식이 고도화됨에 따라 단순 벤치마크 점수보다 자율 수행 시간이 실질적인 지표가 될 것이나 측정의 정밀도 개선이 시급한 과제이다. 이는 향후 AI 에이전트의 상용화와 안전성 가이드라인 수립에 중요한 기준이 될 것이다.

섹션별 상세

이미지 분석

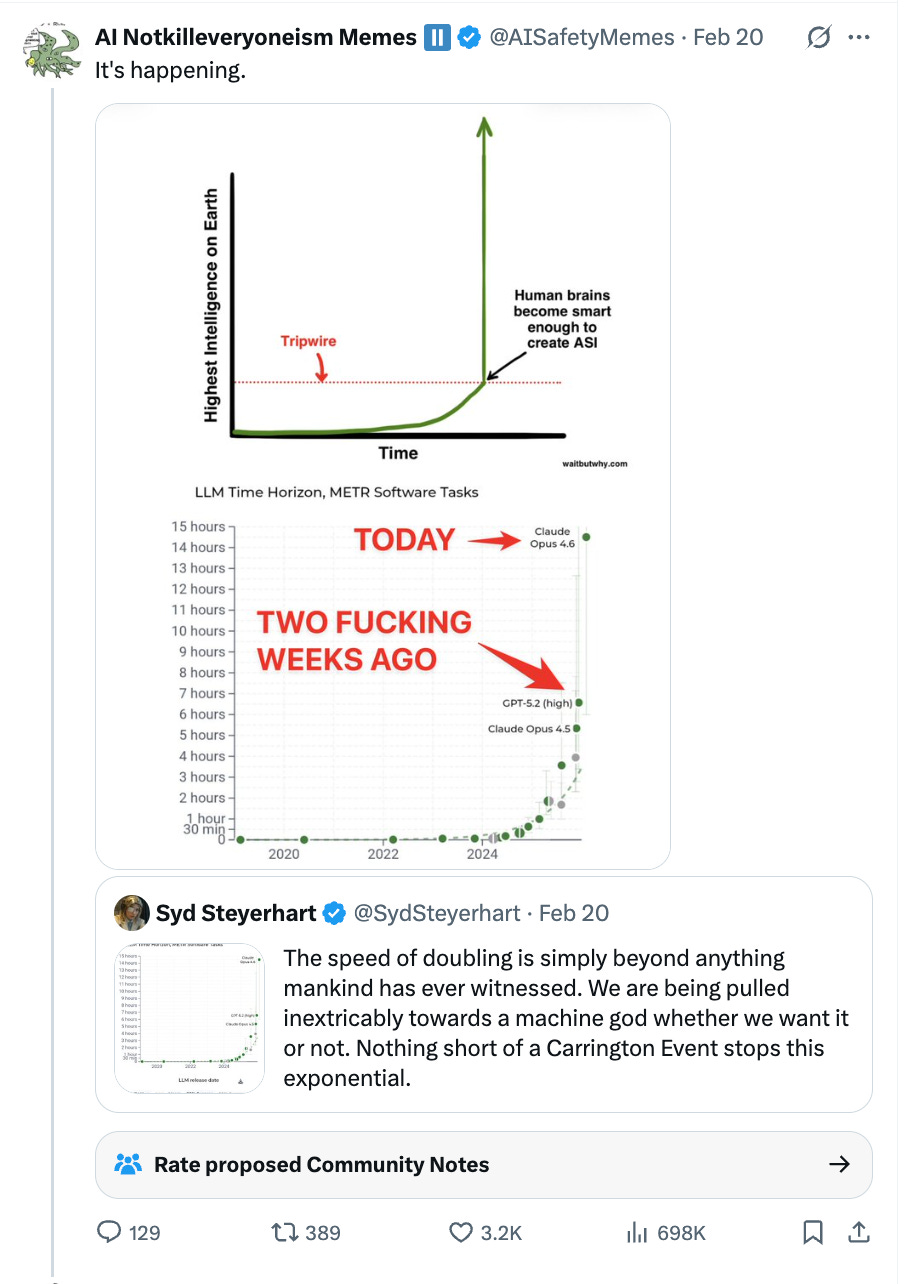

인간이 인공 일반 지능(ASI)을 창조할 수 있는 지능 수준에 도달한 시점을 기점으로 AI의 지능이 급격히 상승하는 지수적 곡선을 보여준다. 하단의 실제 데이터 플롯은 최근 2주 사이에 발생한 모델 성능의 급격한 도약을 시각화하여 위기감을 조성한다.

인간 지능과 AI 지능의 발전 궤적을 비교한 개념도와 METR의 시간 지평 데이터 플롯이다.

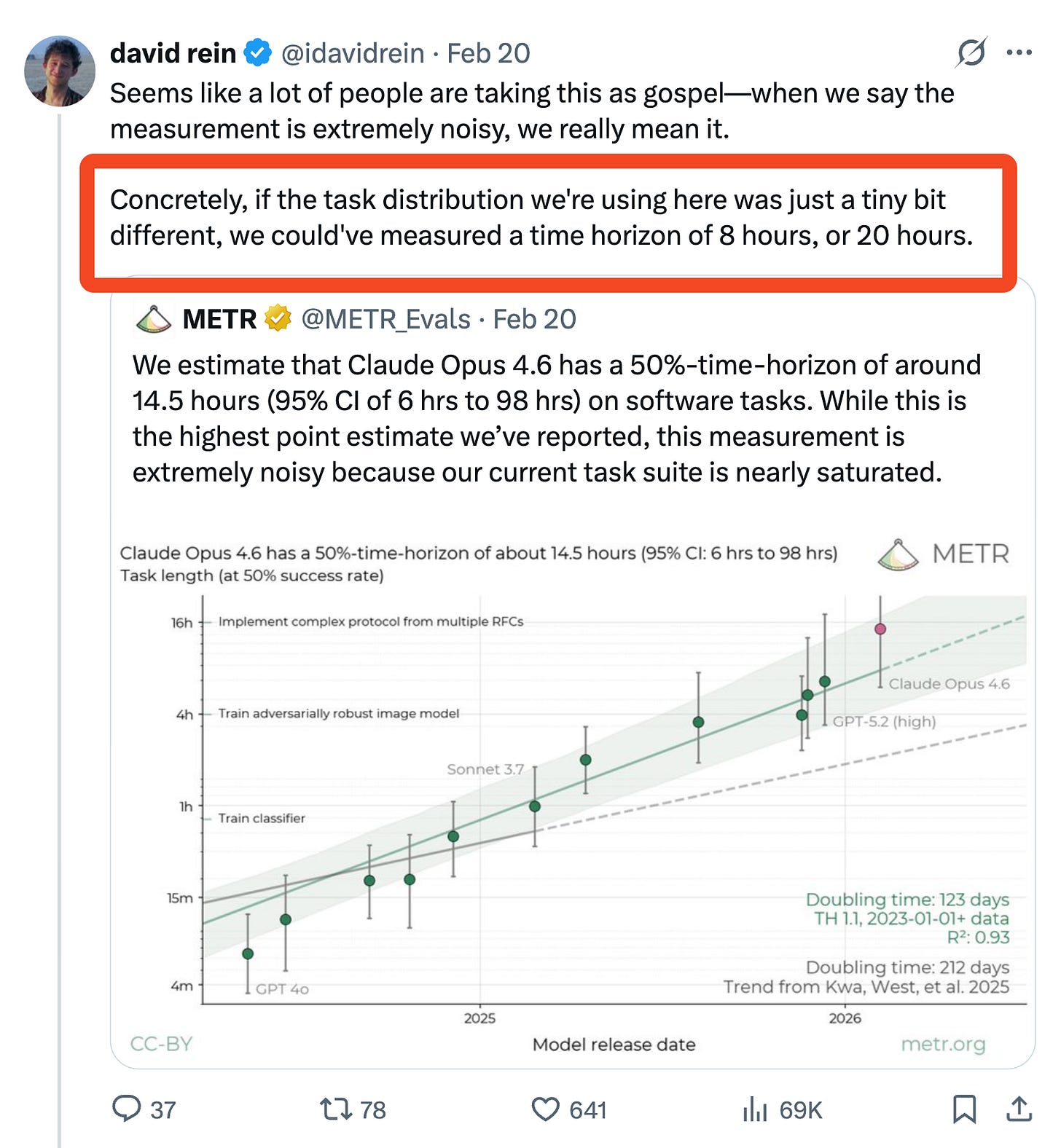

Claude 4.6이 약 14.5시간의 시간 지평을 기록했으나 95% 신뢰 구간이 6시간에서 98시간에 달할 정도로 노이즈가 심함을 보여준다. 이는 현재의 테스트 세트가 포화 상태에 이르러 측정의 불확실성이 매우 높다는 점을 증명한다.

Claude 4.6 및 GPT-5.2 모델의 시간 지평 측정값과 신뢰 구간을 나타내는 상세 그래프이다.

단 14개의 샘플이 2025년 AI 담론을 형성했다는 비판과 함께 특정 모델의 성공 확률 분포가 불규칙함을 지적한다. 데이터의 이면에 숨겨진 취약성을 밈과 그래프를 통해 풍자적으로 전달한다.

METR 그래프의 데이터 해석 오류와 샘플 부족 문제를 지적하는 분석 자료 모음이다.

실무 Takeaway

- AI 성능 지표인 시간 지평은 모델의 자율성을 평가하는 유용한 도구이나 현재 데이터의 통계적 유의성과 노이즈를 반드시 고려해야 한다.

- 벤치마크 결과의 지수적 추세선에만 매몰되지 말고 평가에 사용된 작업의 난이도 분포와 샘플링 편향을 확인하는 비판적 시각이 필요하다.

- AI 에이전트의 발전은 단순 코딩 보조를 넘어 장시간 자율 수행 능력으로 진화하고 있으며 이에 따른 보안 위협 평가의 중요성이 커지고 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료