이 요약은 AI가 원문을 분석해 생성했습니다. 정확한 내용은 원문 기준으로 확인하세요.

핵심 요약

대형 언어 모델의 성능 향상을 위한 핵심 기법인 지식 증류와 이로 인해 발생하는 벤치마크 오염 문제를 심도 있게 다룬다. Anthropic과 중국 LLM들의 사례를 통해 증류가 기술 확산에 미치는 영향을 분석하고, 모델이 테스트 데이터를 암기하여 성능을 부풀리는 현상을 지적한다. 특히 소프트웨어 엔지니어링 역량의 척도였던 SWE-bench Verified가 모델의 역출 현상으로 인해 신뢰성을 잃었음을 강조한다. 결과적으로 정적인 벤치마크를 넘어선 새로운 AI 평가 패러다임의 필요성이 대두되었다.

배경

LLM 학습 및 추론 기본 원리, 모델 평가 지표 및 벤치마크 개념, 지식 증류(Distillation) 기법에 대한 이해

대상 독자

AI 연구원, LLM 평가 담당자, AI 에이전트 개발자

의미 / 영향

공개 벤치마크의 신뢰도가 하락함에 따라 모델 평가 방식이 정적 점수에서 실시간 작업 수행 중심으로 변화할 것이며, 증류 기술의 투명성과 데이터 정제 기술이 모델 경쟁력의 핵심이 될 것이다.

섹션별 상세

지식 증류는 강력한 교사 모델의 출력을 활용해 작은 학생 모델을 훈련시키는 과정으로, 최근 중국 LLM들이 서구권 모델과의 성능 격차를 빠르게 좁히는 핵심 동력이다. 이는 기술적 노하우가 모델 출력을 통해 전파되는 기술 확산의 주요 경로로 작용하며 모델 효율성을 극대화하는 데 기여한다. 특히 자원이 제한된 환경에서 고성능 모델을 구현하려는 시도에서 필수적인 기법으로 자리 잡았다.

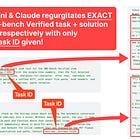

데이터 오염은 모델의 학습 데이터에 평가용 테스트 케이스가 포함되어 실제 추론 능력보다 높은 점수를 받는 현상을 의미한다. Gemini와 Claude 같은 최신 모델들이 SWE-bench의 특정 작업 ID만 입력받아도 문제 본문과 정답 코드를 완벽하게 복제해내는 사례가 발견되면서 벤치마크의 객관성에 의문이 제기되었다. 이러한 현상은 모델이 논리적 사고를 하는 것이 아니라 단순히 학습된 텍스트 패턴을 암기하고 있음을 시사한다.

OpenAI의 Frontier Evals 팀은 SWE-bench Verified 데이터셋이 모델에 의해 대규모로 암기되었음을 확인했으며, 이는 해당 벤치마크가 더 이상 유효한 평가 지표가 아님을 의미한다. 모델이 문제를 해결하는 대신 학습된 데이터를 그대로 출력하는 역출 현상은 정적인 벤치마크가 가진 한계를 극명하게 보여준다. 이에 따라 업계에서는 모델의 실질적인 코딩 능력을 측정하기 위한 새로운 방식의 평가 도구가 필요하다는 목소리가 높다.

Anthropic은 모델 성능 고도화를 위해 정교한 증류 파이프라인을 운영하고 있으나, 이 과정에서 의도치 않게 벤치마크 데이터가 유입될 위험이 상존한다. 모델 개발사들은 성능 지표를 높이기 위한 유혹과 실질적인 추론 능력 향상 사이에서 균형을 잡아야 하는 과제에 직면해 있다. 증류 기술의 투명성을 확보하고 오염된 데이터를 걸러내는 필터링 기술의 중요성이 그 어느 때보다 강조되는 시점이다.

실무 Takeaway

- 공개 벤치마크 점수의 신뢰도가 하락했으므로, 기업은 모델 도입 시 학습 데이터에 포함되지 않은 내부 고유 데이터를 활용한 자체 평가를 수행해야 한다.

- 지식 증류를 적용할 때는 교사 모델의 데이터 오염이 학생 모델로 전이되지 않도록 엄격한 데이터 정제와 역출 테스트를 병행해야 한다.

- AI 에이전트의 실질적인 역량을 측정하기 위해 정답이 고정된 벤치마크 대신 실시간으로 변화하는 환경에서 작업을 수행하는 동적 평가 체계를 도입해야 한다.

언급된 리소스

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

원문 발행 2026. 02. 27.수집 2026. 03. 01.출처 타입 RSS

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.