핵심 요약

대형 언어 모델의 커스터마이징은 전통적으로 수천 개의 정밀한 라벨링 데이터가 필요한 지도 학습(SFT)에 의존해 왔다. 하지만 Amazon Nova 모델에 도입된 강화 파인튜닝(RFT)은 정답 경로를 직접 보여주는 대신 보상 함수를 통해 결과의 품질을 평가하며 모델 스스로 최적의 경로를 찾게 한다. 이 방식은 코드 생성, 수학적 추론 등 결과의 검증이 명확한 작업에서 특히 효과적이며, 데이터 준비 비용을 획기적으로 줄여준다. AWS는 Bedrock부터 SageMaker HyperPod, Nova Forge에 이르기까지 사용자의 기술 수준과 요구사항에 맞춘 다양한 구현 계층을 제공한다.

배경

AWS 기초 지식, LLM 파인튜닝 개념, Python 프로그래밍, AWS Lambda 사용법

대상 독자

AWS 기반 LLM 프로덕션 개발자 및 ML 엔지니어

의미 / 영향

RFT는 데이터 구축 비용을 낮추고 모델의 추론 효율을 높여, 기업들이 특정 도메인에 특화된 고성능 AI 에이전트를 더 빠르게 배포할 수 있게 한다. 특히 코드 생성과 금융 분석 등 논리적 추론이 핵심인 분야에서 AWS 생태계를 통한 빠른 상용화가 가능해질 전망이다.

섹션별 상세

이미지 분석

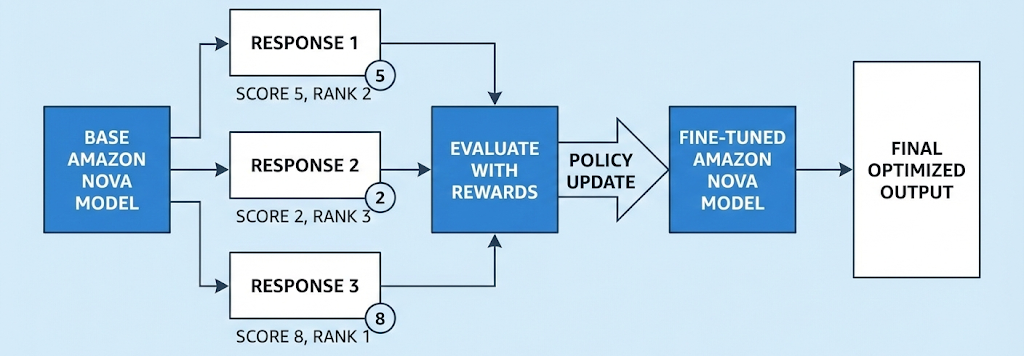

베이스 모델이 여러 응답을 생성하고(Stage 1), 보상 함수가 이를 평가하여 점수를 매기며(Stage 2), 이 데이터를 바탕으로 모델의 정책을 업데이트하여 최적화된 모델을 만드는 순환 구조를 시각화했다.

RFT의 3단계 자동화 프로세스를 보여주는 다이어그램이다.

Amazon Bedrock의 노코드 환경부터 SageMaker Serverless, Training Jobs, HyperPod를 거쳐 연구용 Nova Forge까지 기술적 복잡도와 제어권에 따른 서비스 선택 가이드를 제시한다.

AWS 서비스별 RFT 구현 계층을 단계별로 나타낸 로드맵이다.

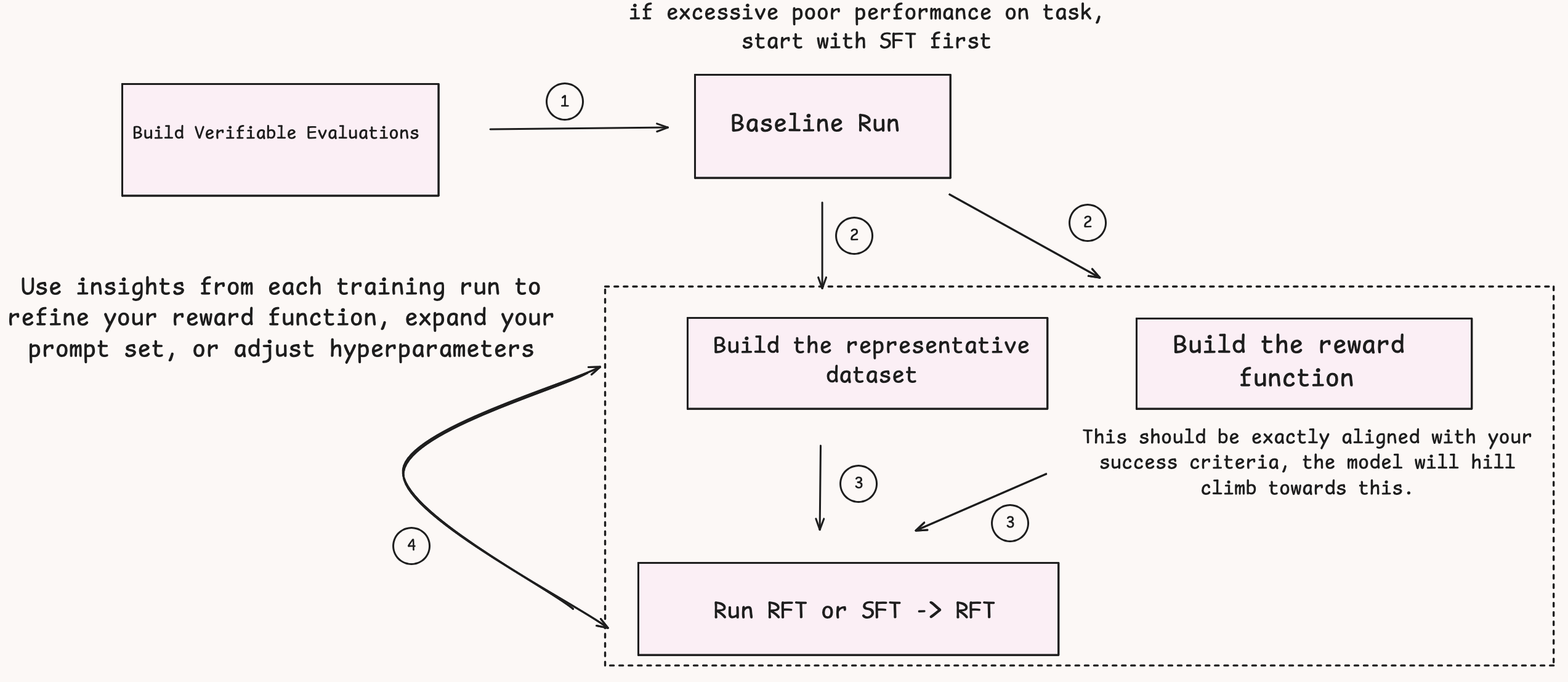

베이즈라인 실행 후 성능이 낮으면 SFT를 먼저 수행할 것을 권고하며, 데이터셋 구축과 보상 함수 설계를 거쳐 반복적으로 모델을 개선하는 루프 과정을 설명한다.

RFT 구현을 위한 체계적인 워크플로 순서도이다.

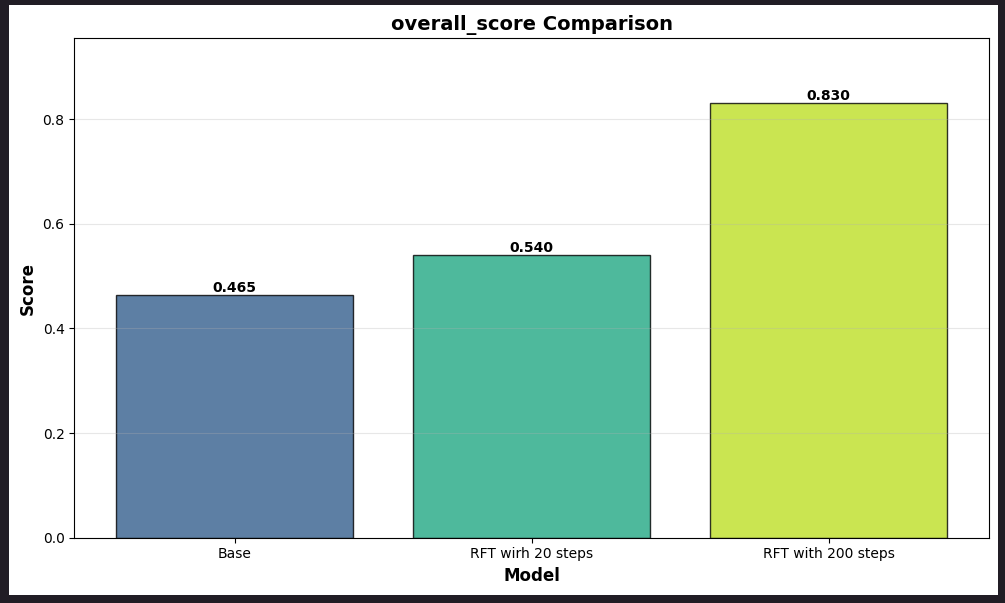

Base 모델(0.465) 대비 RFT 200단계를 거친 모델(0.830)의 성능이 비약적으로 향상되었음을 수치로 증명하며, 학습 단계가 늘어날수록 정확도가 개선됨을 보여준다.

Base 모델과 RFT 적용 모델 간의 FinQA 벤치마크 점수 비교 차트이다.

실무 Takeaway

- 정밀한 라벨링 데이터가 부족한 상황에서도 보상 함수(AWS Lambda) 설계만으로 모델의 추론 성능을 획기적으로 개선할 수 있다.

- RFT 적용 전 모델의 기본 성능을 평가하여, 실패율이 너무 높다면 SFT를 선행하여 학습 신호를 확보하는 전략이 필수적이다.

- 초기 실험은 비용 효율적인 LoRA 방식으로 시작하고, 성능 검증 후 필요에 따라 Full Rank 학습이나 전용 인스턴스 배포로 확장하는 것이 경제적이다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료