핵심 요약

멀티모달 LLM이 시각이나 청각 정보를 통해 숫자를 완벽하게 인식함에도 불구하고, 실제 다자리 곱셈 연산에서는 심각한 성능 저하를 보인다는 사실을 입증했다. 이는 모델의 한계가 지각 능력이 아닌 내부 계산 로직의 부재에 있음을 시사하며, 향후 멀티모달 에이전트의 신뢰성 확보를 위한 연구 방향을 제시한다.

왜 중요한가

멀티모달 LLM이 시각이나 청각 정보를 통해 숫자를 완벽하게 인식함에도 불구하고, 실제 다자리 곱셈 연산에서는 심각한 성능 저하를 보인다는 사실을 입증했다. 이는 모델의 한계가 지각 능력이 아닌 내부 계산 로직의 부재에 있음을 시사하며, 향후 멀티모달 에이전트의 신뢰성 확보를 위한 연구 방향을 제시한다.

핵심 기여

제어된 멀티모달 곱셈 벤치마크 구축

자릿수, 희소성, 표현 방식(숫자 vs 단어), 모달리티(텍스트, 이미지, 오디오)를 체계적으로 변화시키며 동일한 산술 문제를 평가할 수 있는 데이터셋을 생성했다.

산술 부하(Arithmetic Load) 지표 정의

전체 자릿수와 0이 아닌 자릿수의 곱으로 정의되는 C 지표를 제안했다. 이 지표는 R² > 0.5 이상의 높은 상관관계로 모델의 정확도 하락을 예측하는 강력한 변수임이 확인됐다.

지각과 계산의 분리 분석

모델들이 이미지나 오디오 속 숫자를 99% 이상 정확히 인식하면서도 곱셈 결과는 틀리는 현상을 통해, 멀티모달 성능 저하의 원인이 지각 오류가 아닌 계산 능력 부족임을 밝혔다.

전략 지문(Strategy Fingerprinting) 기법 도입

강제 완성 손실(Forced-completion loss) 프로브를 통해 모델이 내부적으로 분배 법칙(Distributive Decomposition) 전략을 선호한다는 사실을 발견했다.

핵심 아이디어 이해하기

기존 LLM은 텍스트 기반 산술 연산에서 자릿수가 늘어날수록 정확도가 급격히 떨어진다. 이는 Transformer 아키텍처가 숫자를 토큰 단위로 처리하며 복잡한 받아올림(Carry) 과정을 내부적으로 시뮬레이션하는 데 한계가 있기 때문이다. 본 논문은 이러한 한계가 시각이나 청각 모달리티로 확장되었을 때 어떻게 나타나는지 분석했다.

연구진은 모델이 이미지를 보고 숫자를 읽어내는 '지각' 단계와 읽어낸 숫자로 연산을 수행하는 '계산' 단계를 분리했다. 실험 결과, 모델은 이미지를 텍스트로 변환하는 지각 능력은 매우 뛰어났으나, 동일한 숫자를 텍스트로 주었을 때보다 이미지로 주었을 때 계산 성공률이 더 낮아지는 현상을 발견했다. 이는 입력 모달리티가 모델 내부의 산술 처리 경로에 노이즈를 주거나 비효율적인 전략을 유도함을 의미한다.

결과적으로 멀티모달 LLM은 단순히 숫자를 '보는' 것과 그 숫자로 '계산하는' 것 사이의 간극을 메우지 못하고 있다. 특히 산술 부하가 일정 수준(C > 100)을 넘어서면 모든 모달리티에서 정확도가 0에 수렴하는 현상은 모델이 근본적인 수학적 원리가 아닌 통계적 패턴에 의존하고 있음을 보여준다.

방법론

산술 부하 C를 C = d_total × d_non-zero로 정의했다. 여기서 d_total은 두 피연산자의 전체 자릿수 합이며, d_non-zero는 0이 아닌 자릿수의 개수이다. [자릿수 정보 입력 → 곱셈 연산 수행 → 결과값 도출 → 연산 복잡도 수치화] 순으로 계산되며, 이 수치가 높을수록 모델이 수행해야 할 중간 단계의 연산량이 기하급수적으로 증가함을 의미한다.

모델의 내부 전략을 파악하기 위해 강제 완성 손실 프로브(Forced-completion loss probe)를 사용했다. 모델에게 특정 계산 전략(세로셈, 분배 법칙, 반올림 등)의 서두를 제시하고, 다음에 올 토큰에 대한 교차 엔트로피 손실(Cross-Entropy Loss)을 측정한다. [특정 전략 프롬프트 입력 → 다음 토큰 확률 계산 → 손실값 산출 → 전략 선호도 판별] 과정을 거치며, 손실값이 낮을수록 모델이 해당 계산 방식을 더 '자연스럽게' 받아들인다고 해석한다.

또한, 각 전략에 특화된 LoRA 어댑터를 학습시켜 파라미터 공간에서의 변화를 분석했다. 각 어댑터의 가중치 업데이트 행렬 ΔW = BA를 벡터화하여 코사인 유사도를 계산했다. [어댑터 학습 → 가중치 변화량 추출 → 벡터 간 각도 계산 → 전략 간 독립성 확인] 순으로 진행되었으며, 이를 통해 서로 다른 계산 전략이 모델 내부에서 서로 다른 파라미터 하위 공간을 사용하는지 검증했다.

주요 결과

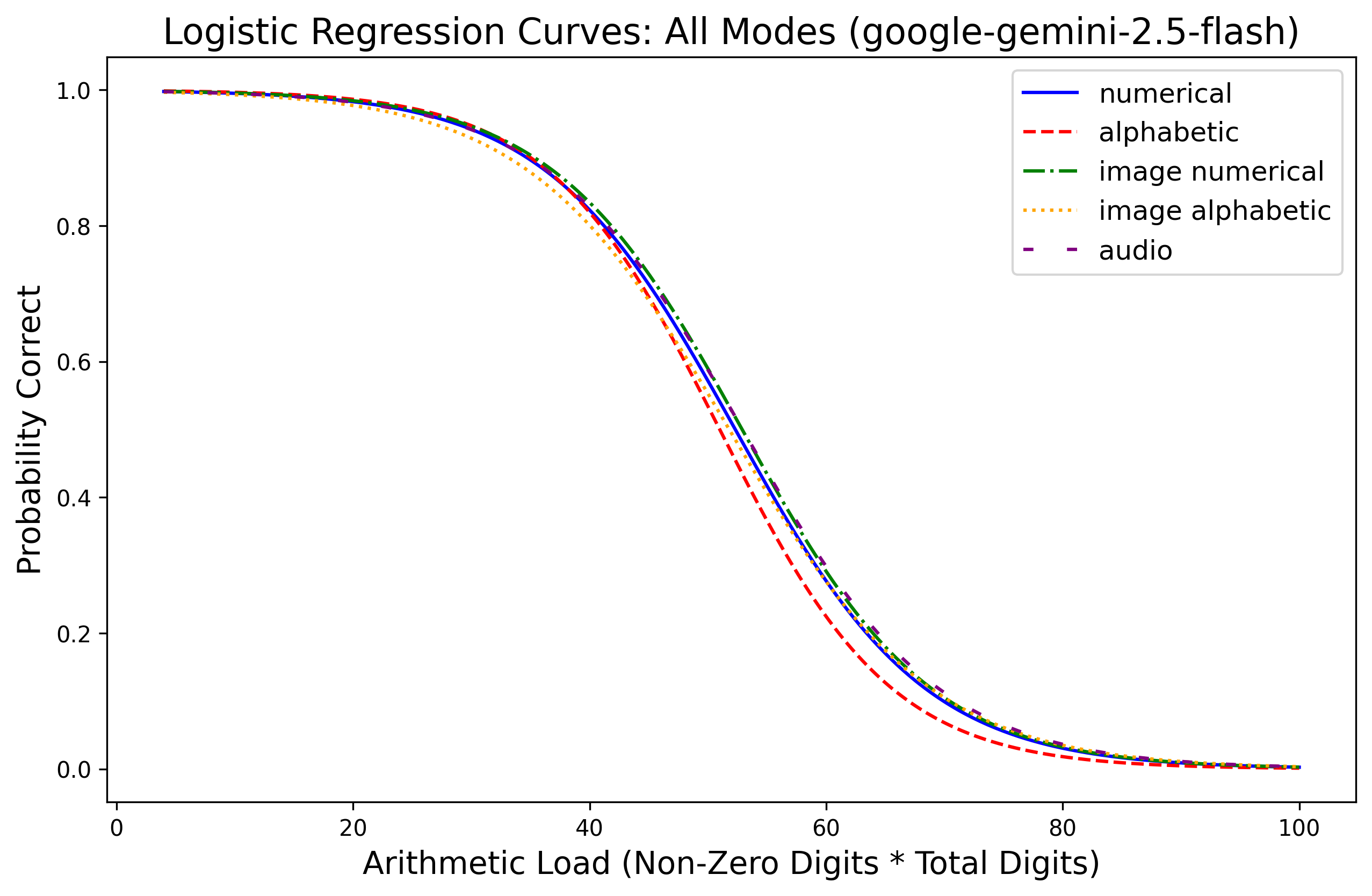

모든 평가 모델에서 산술 부하 C가 증가함에 따라 정확도가 단조 감소하는 경향을 보였다. 특히 Gemini 2.5 Flash, Qwen3-VL-30B 등은 C ≈ 50 부근에서 정확도가 50%로 떨어졌으며, C > 100인 구간에서는 거의 모든 모델의 정확도가 0%에 근접했다. 텍스트 입력이 가장 높은 성능을 보였고, 이미지와 오디오 입력은 상대적으로 낮은 성능을 기록했다.

전략 선호도 분석 결과, Qwen3-VL 모델들은 텍스트와 이미지 모달리티 모두에서 분배 법칙(Distributive Decomposition) 전략을 가장 선호하는 것으로 나타났다. 세로셈(Columnar) 방식은 상대적으로 높은 손실값을 기록하여 모델이 선호하지 않는 방식으로 확인됐다. 또한, 전략별 LoRA 어댑터 간의 코사인 유사도가 0에 가깝게 나타나, 모델이 각 계산 전략을 별도의 파라미터 공간에서 처리하고 있음을 시사했다.

관련 Figure

산술 부하(C)가 40을 넘어서면서 모든 모달리티의 정확도가 급격히 하락하기 시작하며, 80 이상에서는 0에 수렴함을 보여준다. 텍스트(numerical) 입력이 가장 우수하며 오디오와 이미지 입력이 뒤를 잇는 성능 격차를 시각적으로 확인할 수 있다.

Gemini 2.5 Flash 모델의 산술 부하에 따른 입력 모달리티별 정확도 변화를 보여주는 로지스틱 회귀 곡선이다.

기술 상세

본 연구는 멀티모달 LLM의 산술 능력이 '지각(Perception)'과 '계산(Computation)' 중 어느 단계에서 붕괴하는지 규명하는 데 집중했다. 실험 결과 지각 정확도는 99% 이상으로 유지되었으나 계산 정확도는 급락했는데, 이는 멀티모달 정렬(Alignment) 과정에서 시각/청각 특징이 텍스트 토큰 공간으로 투영될 때 산술적 추론에 필요한 고정밀 정보가 손실되거나 왜곡될 수 있음을 보여준다.

특히 235B 규모의 대형 모델이 30B 모델보다 전략 간의 직교성(Orthogonality)이 더 뚜렷하게 나타났다. 이는 모델 규모가 커질수록 서로 다른 알고리즘적 휴리스틱을 별도의 파라미터 서브스페이스(Subspace)에 할당하여 관리하는 능력이 향상됨을 의미한다. 하지만 이러한 구조적 분리에도 불구하고 실제 정확도 개선으로 이어지지 않는 '내부 라우터'의 최적화 문제가 핵심 한계로 지목됐다.

한계점

곱셈 연산에만 국한된 연구로 덧셈, 나눗셈, 기호 대수 등 다른 수학 영역으로의 일반화 여부는 확인되지 않았다. 또한 정형화된 템플릿 기반의 이미지를 사용했으므로 실제 손글씨나 복잡한 문서 스캔본에서의 성능은 다를 수 있다.

실무 활용

멀티모달 에이전트나 수학 보조 도구를 개발할 때, 모델의 직접적인 연산 결과에 의존하기보다는 외부 도구(계산기) 호출을 강제해야 함을 시사한다.

- 스크린샷 내 표 데이터를 읽어 계산을 수행하는 RPA 에이전트 설계 시 Python 인터프리터 연동 필수화

- 시각 장애인용 수치 데이터 음성 안내 서비스에서 모델의 직접 연산 대신 정형 데이터 추출 후 연산 로직 분리

- 멀티모달 모델의 산술 능력 한계를 테스트하기 위한 벤치마크 파이프라인 구축

코드 공개 여부: 공개

코드 저장소 보기키워드

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.