핵심 요약

대규모 AI 모델의 학습과 추론을 위해 분산 컴퓨팅의 복잡성을 관리하는 것은 필수적이다. AMD는 ROCm 7.0.0과 Ray 2.51.1의 통합을 통해 AMD GPU 환경에서 효율적인 ML 워크플로우 확장을 지원한다. 본 아티클은 verl을 이용한 RLHF 학습, vLLM 기반 추론 서빙, Stable Diffusion 이미지 생성 등 다양한 실전 사례를 통해 Ray가 어떻게 분산 환경의 복잡성을 추상화하고 성능을 최적화하는지 상세히 기술한다. 특히 AMD Instinct MI300X GPU에서 NVIDIA H100 대비 우수한 RLHF 처리량을 달성한 벤치마크 결과를 포함하여 실질적인 하드웨어 가속 효과를 입증한다.

배경

ROCm 지원 AMD GPU (Instinct 시리즈 권장), Linux 운영체제 및 Docker 설치, Python 및 PyTorch 기본 지식, Ray 프레임워크에 대한 기초 이해

대상 독자

AMD GPU 기반 ML 인프라를 구축하거나 분산 학습 및 추론 워크플로우를 최적화하려는 ML 엔지니어 및 데이터 사이언티스트

의미 / 영향

AMD ROCm 에코시스템이 Ray와 같은 범용 분산 프레임워크와 깊게 통합됨에 따라 엔비디아 의존도를 낮추려는 기업들에게 강력한 대안을 제시한다. 특히 RLHF와 같은 최신 학습 기법에서 하드웨어 성능 우위를 입증함으로써 대규모 모델 학습 시장에서의 AMD 입지가 강화될 것으로 전망된다.

섹션별 상세

이미지 분석

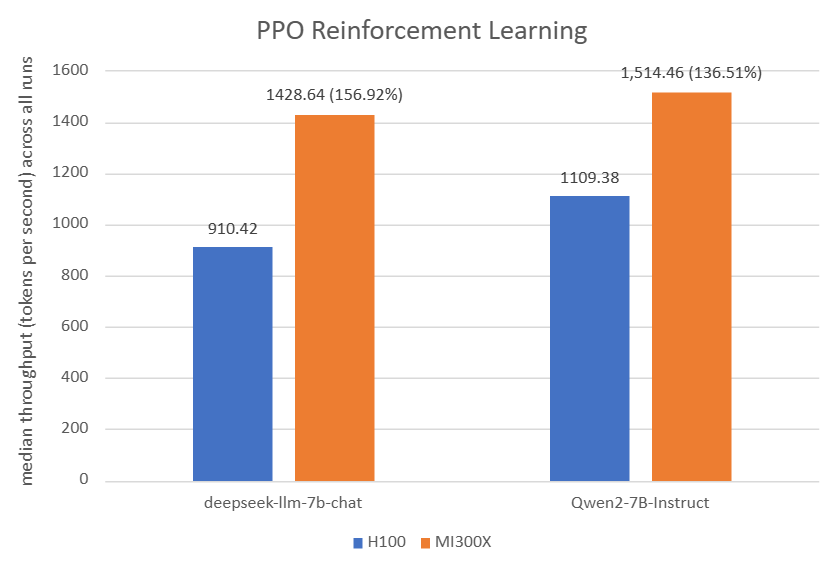

DeepSeek-7B 및 Qwen2-7B 모델에서 MI300X가 H100 대비 각각 56%, 36% 높은 토큰 처리량을 기록했음을 보여준다. 이는 대규모 강화학습 워크로드에서 AMD 하드웨어의 성능 우위를 입증하는 핵심 지표이다.

AMD MI300X와 NVIDIA H100 간의 PPO 강화학습 처리량 비교 차트이다.

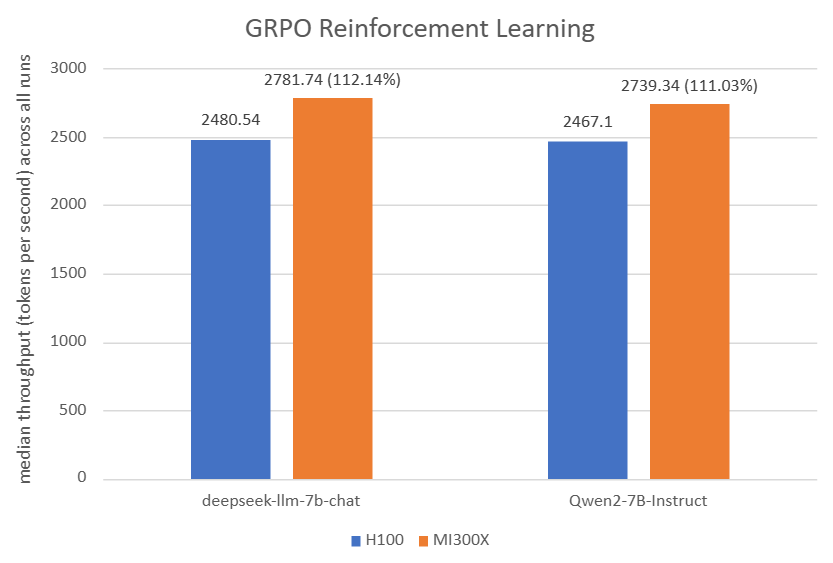

DeepSeek-R1 등에서 사용되는 GRPO 알고리즘 환경에서도 MI300X가 H100보다 약 11-12% 더 높은 처리량을 유지함을 나타낸다. 다양한 강화학습 알고리즘에 대한 AMD GPU의 범용적 가속 성능을 확인할 수 있다.

AMD MI300X와 NVIDIA H100 간의 GRPO 강화학습 처리량 비교 차트이다.

실무 Takeaway

- AMD MI300X GPU는 verl 프레임워크 기반 RLHF 학습 시 NVIDIA H100 대비 최대 56% 높은 처리량을 제공하므로 강화학습 비용 효율화에 유리하다.

- Ray Serve의 autoscaling_config를 활용하면 Stable Diffusion과 같은 고부하 모델 서빙 시 GPU 자원을 0에서 2개까지 동적으로 조절하여 인프라 비용을 최적화할 수 있다.

- 분산 학습 환경 구축 시 Ray Train의 ScalingConfig 내 num_workers를 조정하는 것만으로 별도의 코드 수정 없이 하드웨어 자원 확장이 가능하다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료