핵심 요약

구글이 학습용 8t와 추론용 8i로 이원화된 8세대 TPU를 발표하며 하드웨어 수직 계열화를 강화했습니다. 동시에 알리바바는 27B 파라미터로 훨씬 큰 모델들을 능가하는 코딩 성능을 보여주는 Qwen 3.6-27B를 Apache 2.0 라이선스로 공개했습니다. 업계 리더들 사이에서는 무분별한 병렬 호출 대신 깊이 있는 추론 루프를 지향하는 'Tasteful Tokenmaxxing'이 핵심 화두로 부상했습니다. 또한 OpenAI와 구글 모두 기업용 에이전트 플랫폼을 강화하며 단일 채팅을 넘어선 팀 단위 워크플로 자동화로의 전환을 가속화하고 있습니다.

배경

LLM 추론 및 학습 인프라(TPU/GPU)에 대한 기본 이해, 에이전트 아키텍처 및 RAG 시스템 개념, SWE-bench 등 주요 코딩 벤치마크 지표 지식

대상 독자

AI 인프라 엔지니어, LLM 애플리케이션 개발자, 기업용 AI 에이전트 도입을 검토 중인 CTO

의미 / 영향

하드웨어 측면에서는 구글의 수직 계열화가 가속화되고 있으며, 소프트웨어 측면에서는 고성능 오픈 모델과 에이전트 프레임워크의 결합이 상용 모델의 독점적 지위를 위협하고 있습니다. 특히 에이전트의 실행 기록(Trace)이 새로운 데이터 자산으로 부상하며 이를 활용한 자가 학습 루프가 차세대 AI 개발의 핵심이 될 전망입니다.

섹션별 상세

이미지 분석

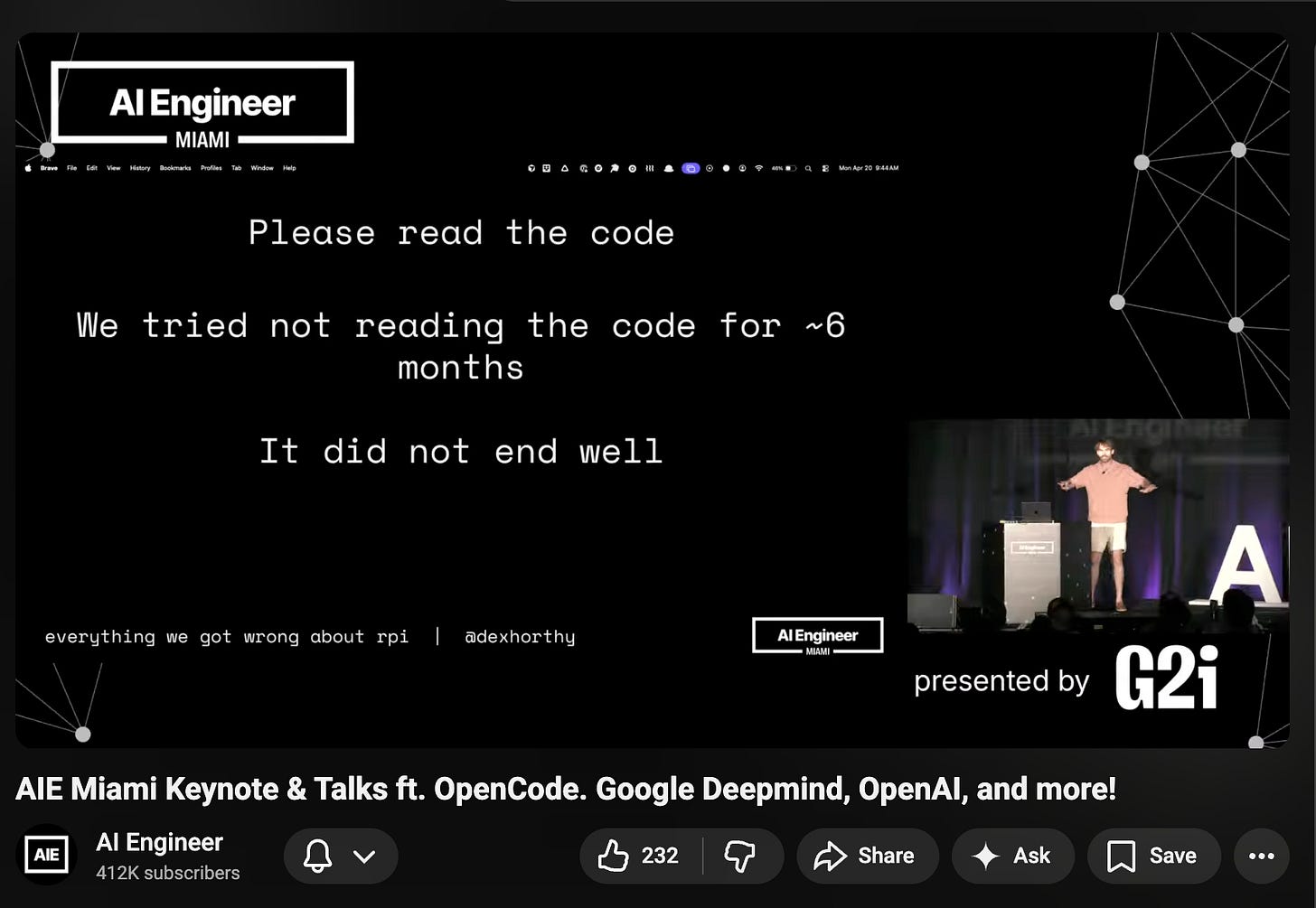

AI 엔지니어링에서 모델의 생성 결과에만 의존하는 'Vibe Coding'의 한계를 지적하며, 실제 코드 구조를 이해하고 분석하는 'Context Engineering'의 중요성을 강조하는 맥락을 보여줍니다. 이는 최근 업계 리더들이 강조하는 'Tasteful Tokenmaxxing' 및 품질 중심의 AI 활용 트렌드와 연결됩니다.

AIE Miami 키노트에서 Dex Horthy가 '코드를 읽지 않았던 6개월의 시도'가 실패했음을 알리는 슬라이드 장면입니다.

실무 Takeaway

- 단순히 LLM 호출 횟수를 늘리는 것보다 직렬적인 자기 반성(Self-reflection) 루프를 통해 추론의 깊이를 더하는 방식이 비용 대비 고품질 결과를 얻는 데 유리하다.

- Qwen 3.6-27B와 같은 고성능 소형 모델을 적절한 에이전트 스캐폴딩(Scaffold)과 결합하면 클라우드 기반 대형 모델에 준하는 성능을 로컬 환경에서 구현할 수 있다.

- 에이전트 시스템 구축 시 트레이스(Trace) 데이터를 수집하고 분석하여 에러 패턴을 파악하는 것이 성능 개선과 평가 자동화의 핵심 동력이 된다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.