핵심 요약

실시간 컴퓨터 비전 애플리케이션 구축 시 모델의 정확도만큼이나 중요한 것이 추론 속도(FPS)와 지연 시간(Latency)이다. 이 가이드는 모델이 실시간 환경에서 느리게 작동하는 문제를 해결하기 위해 입력 데이터 최적화부터 하드웨어 가속기 활용까지의 5단계 프로세스를 설명한다. Roboflow의 RF-DETR, YOLO 시리즈와 같은 최신 모델과 Inference API를 활용하여 성능을 극대화하는 구체적인 방법론을 다룬다. 최종적으로는 소프트웨어 파이프라인 최적화를 통해 하드웨어의 잠재력을 최대한 끌어올리는 실무적인 팁을 제공한다.

배경

Python, Computer Vision 기초, Docker, NVIDIA GPU/CUDA 기본 지식

대상 독자

실시간 컴퓨터 비전 서비스를 배포하려는 ML 엔지니어 및 개발자

의미 / 영향

이 가이드는 이론적인 모델 성능과 실제 프로덕션 환경 간의 간극을 메워준다. 특히 엣지 디바이스에서의 최적화 전략은 제조 및 물류 분야의 실시간 검사 시스템 구축에 직접적인 도움을 준다.

섹션별 상세

이미지 분석

추론 속도 향상의 핵심 개념인 입력, 모델, 예측 과정을 시각화한다. 데이터 전처리부터 모델 아키텍처 선택까지 이어지는 최적화 흐름을 이해하는 데 도움을 준다.

추론 속도 향상을 위한 입력, 모델, 예측의 흐름을 보여주는 다이어그램이다.

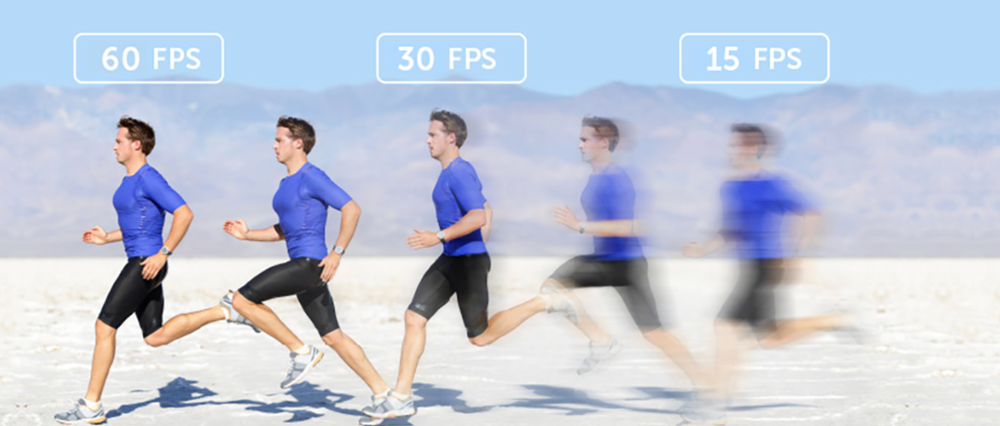

FPS 수치에 따른 시각적 매끄러움의 차이를 직관적으로 보여준다. 실시간 성능의 기준이 되는 FPS 개념을 독자에게 명확히 전달한다.

60, 30, 15 FPS의 시각적 차이를 달리는 사람의 잔상으로 표현한 이미지이다.

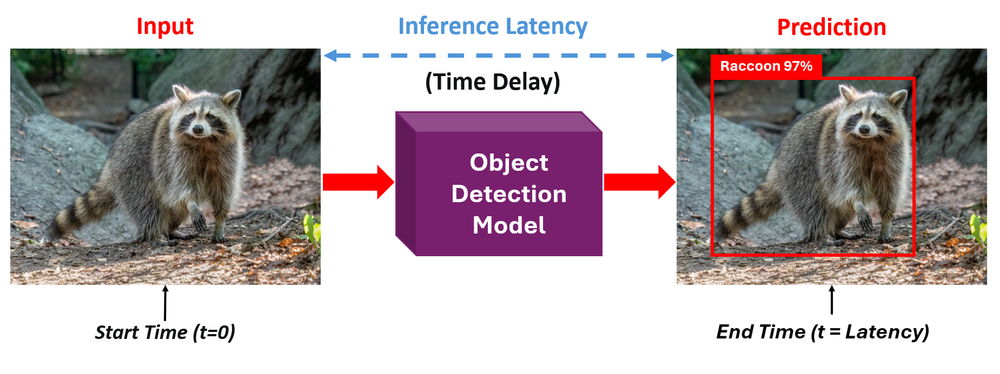

추론 지연 시간(Latency)의 정의를 시각적으로 설명한다. FPS와는 다른 응답성 지표로서의 중요성을 강조하는 데 사용된다.

입력 이미지부터 예측 결과 출력까지의 시간 지연을 나타내는 다이어그램이다.

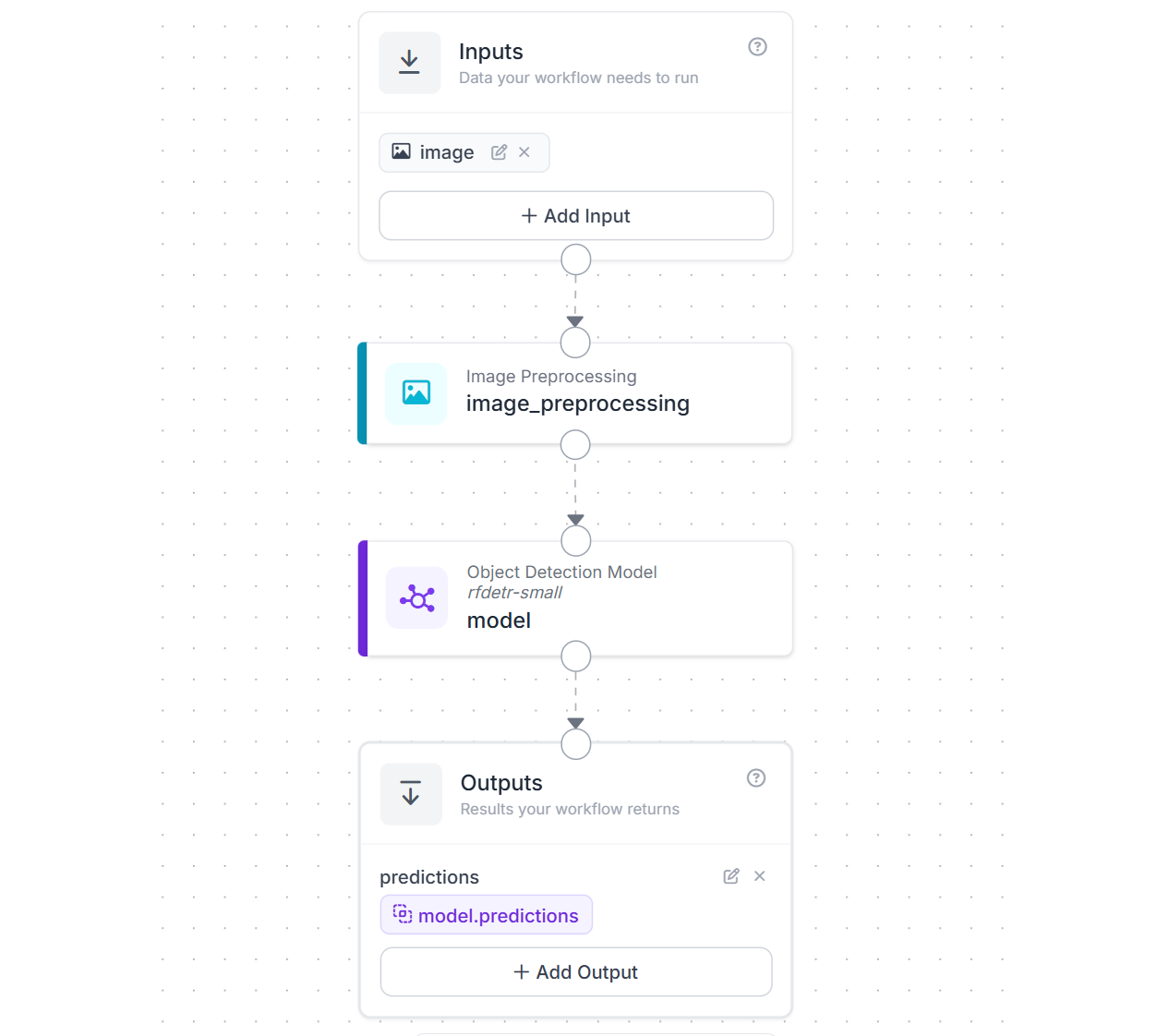

모델 추론 전 단계에서 이미지 크기를 조정하는 전처리 과정이 어떻게 워크플로우에 통합되는지 보여준다. 실제 구현 시의 구조적 이해를 돕는다.

Roboflow Workflow에서 이미지 전처리 블록이 포함된 파이프라인 구성도이다.

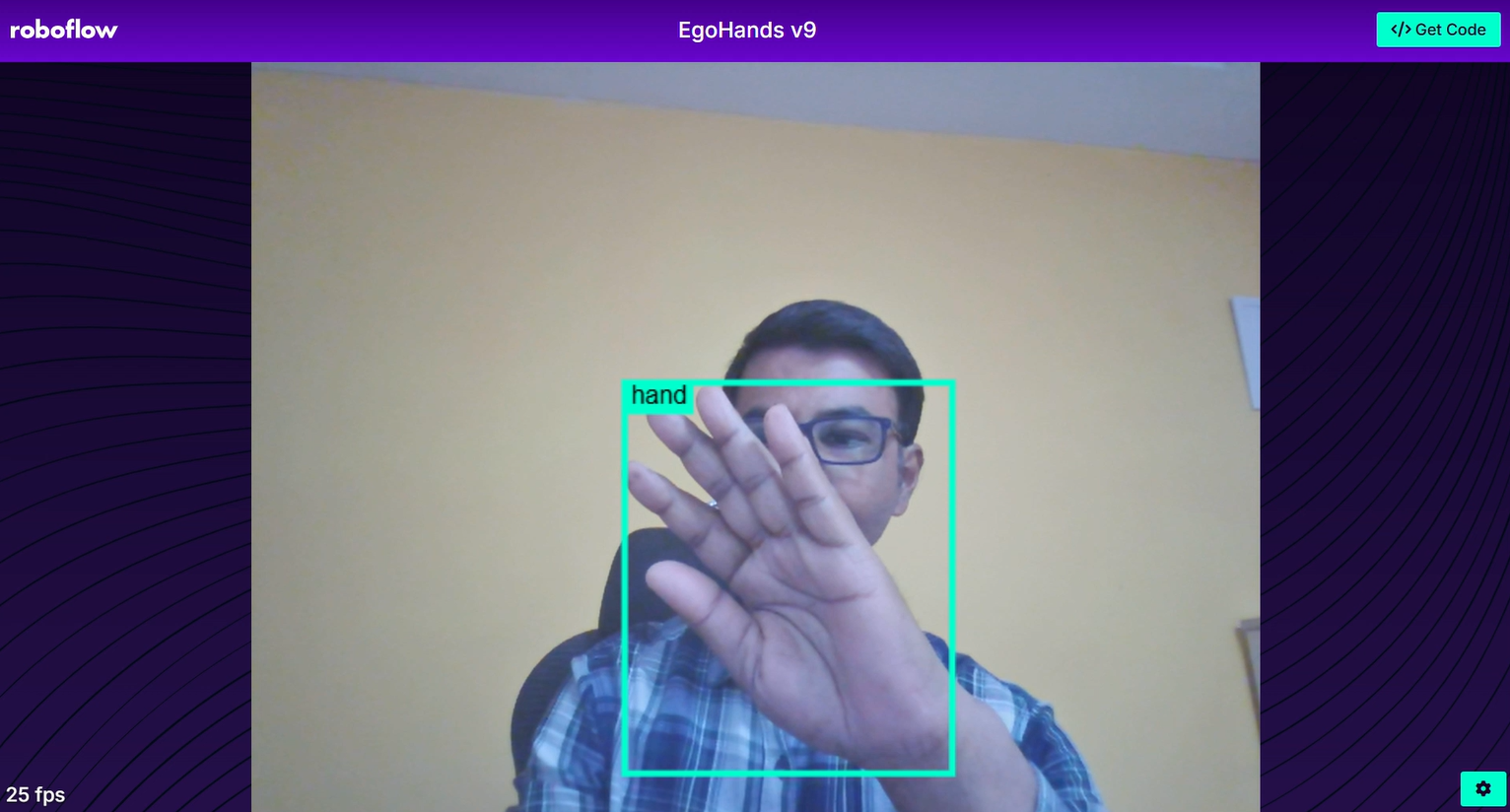

최적화된 모델이 실제 웹 브라우저 환경에서 실시간으로 동작하는 사례를 보여준다. 실시간 성능 구현의 최종 결과물을 시연한다.

25 FPS로 동작하는 실시간 손동작 인식 웹 애플리케이션의 실행 화면이다.

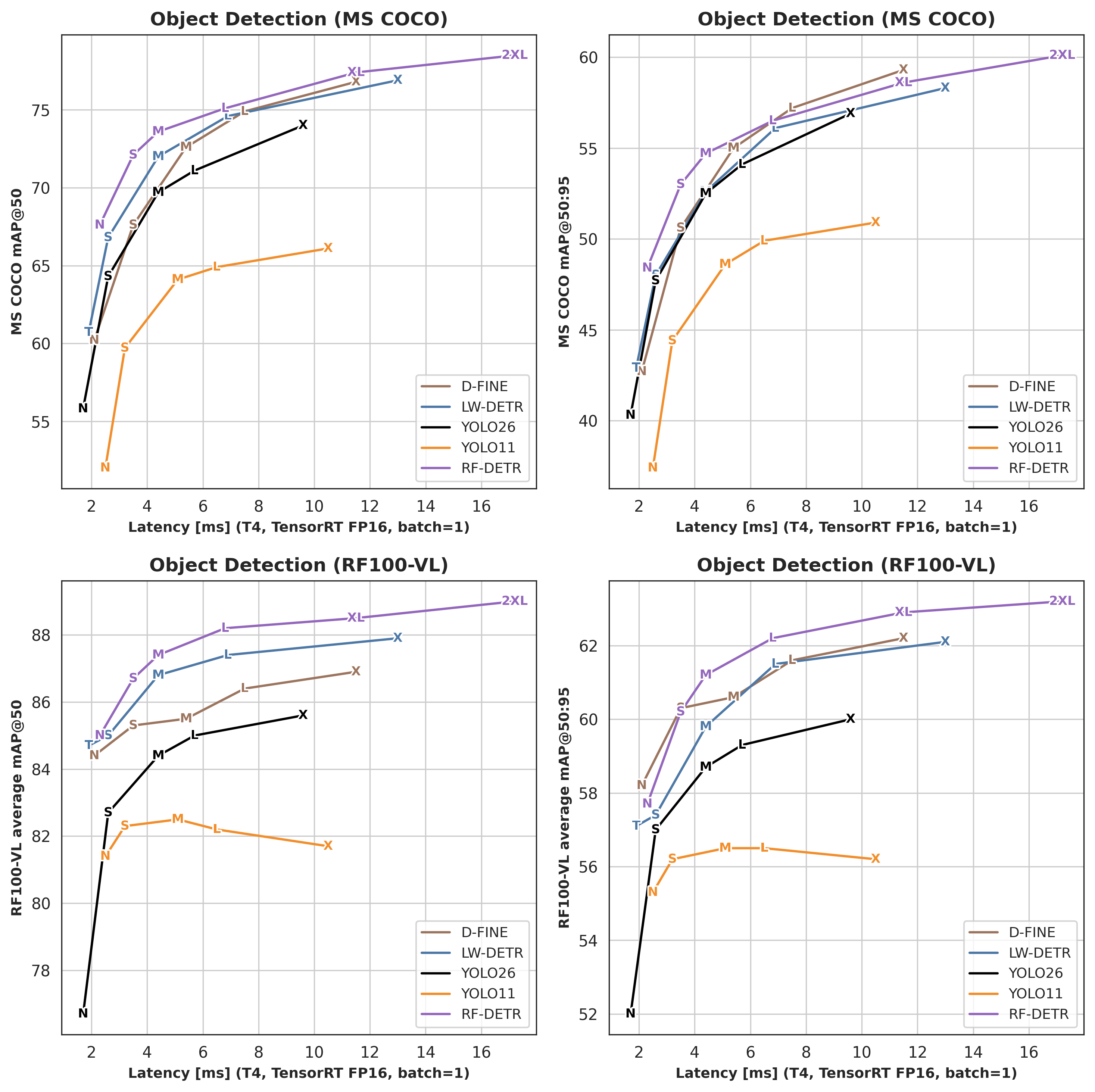

RF-DETR, YOLO 시리즈 등 주요 모델들의 속도와 정확도 트레이드오프 관계를 수치로 증명한다. 사용자가 자신의 목적에 맞는 모델을 선택할 수 있는 근거를 제공한다.

다양한 객체 탐지 모델의 Latency 대비 mAP 성능을 비교한 벤치마크 차트이다.

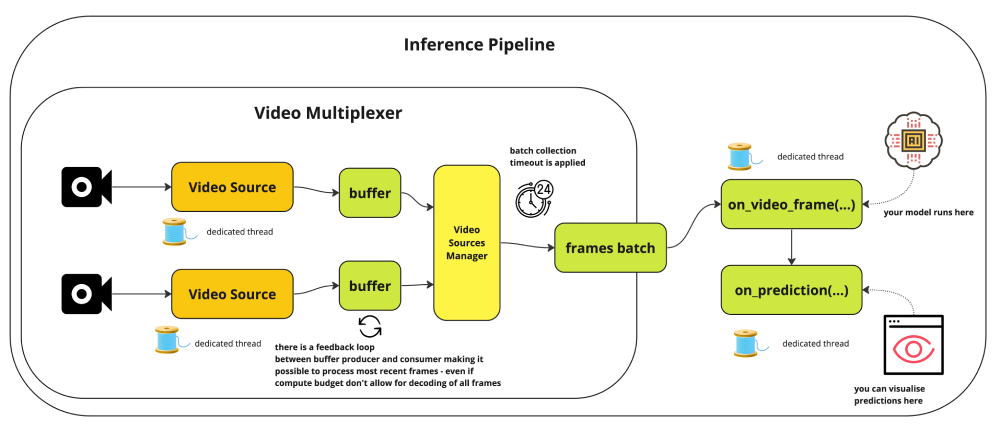

InferencePipeline이 비디오 프레임을 획득하고 처리하는 내부 메커니즘을 설명한다. 병렬 처리를 통한 성능 향상 원리를 시각화하여 전달한다.

비디오 소스부터 예측 출력까지의 비동기 스레드 기반 추론 파이프라인 구조도이다.

실무 Takeaway

- 모델 크기를 Nano 또는 Small로 시작하여 요구되는 정확도를 충족하는 최소한의 모델을 선택한다.

- NVIDIA TensorRT와 FP16 양자화를 적용하여 추가 비용 없이 추론 속도를 1.5배에서 2배까지 향상시킨다.

- 실시간 비디오 처리 시 InferencePipeline을 사용하여 프레임 드롭 및 비동기 처리를 구현하여 지연을 방지한다.

- 후처리 단계의 NMS 병목을 피하기 위해 RF-DETR과 같은 NMS-free 아키텍처 도입을 적극 고려한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료