핵심 요약

엔터프라이즈 환경에서 RAG 시스템 구축 시 수만 개의 복잡한 문서를 처리하는 과정에서 심각한 데이터 병목 현상이 발생한다. 이 글은 Ray Data의 고속 스트리밍 엔진과 Docling의 정밀한 레이아웃 파싱 기술을 결합한 통합 인프라 솔루션을 제안한다. 이를 통해 CPU 집약적인 파싱과 GPU 집약적인 임베딩 작업을 단일 파이프라인에서 효율적으로 처리하여 데이터 준비 시간을 며칠에서 몇 시간 단위로 단축할 수 있다. 결과적으로 RedHat OpenShift AI나 Anyscale과 같은 플랫폼 위에서 신뢰할 수 있는 에이전트형 AI 솔루션의 토대를 마련할 수 있다.

배경

RAG(Retrieval-Augmented Generation) 개념, Ray 프레임워크 기초, Kubernetes 운영 지식, Python

대상 독자

대규모 문서를 RAG 시스템으로 구축하려는 엔터프라이즈 데이터 엔지니어 및 AI 아키텍트

의미 / 영향

데이터 처리 병목을 해결함으로써 기업들이 PoC 수준을 넘어 실제 프로덕션 환경에서 수만 개의 문서를 실시간에 가깝게 활용할 수 있게 하며, 이는 향후 자율 에이전트 시스템으로의 전환을 가속화할 것이다.

섹션별 상세

이미지 분석

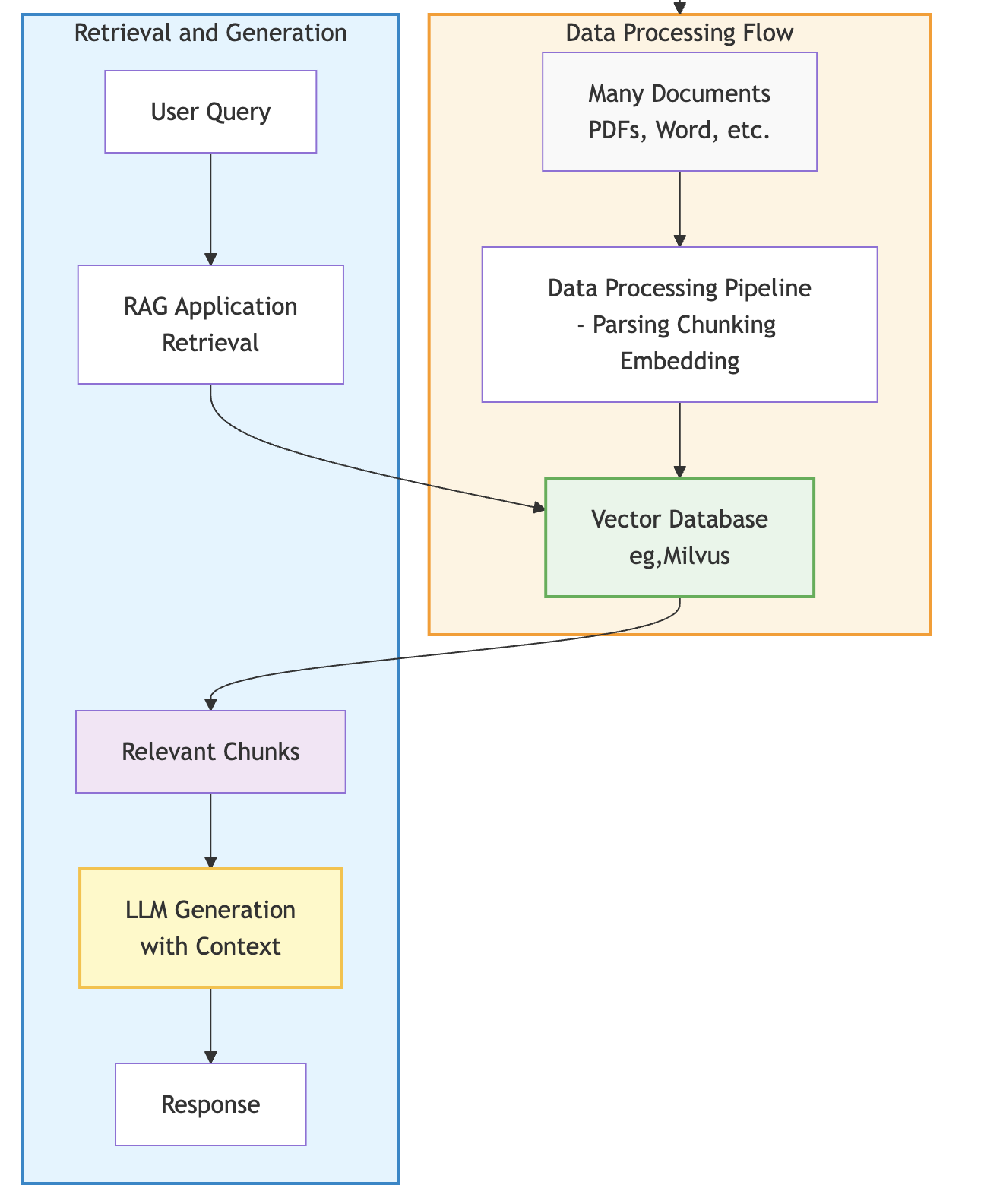

문서 파싱, 청킹, 임베딩을 거쳐 벡터 DB에 저장되는 데이터 처리 흐름과 사용자 쿼리에 따른 검색 및 LLM 생성 과정을 시각화한다. RAG 시스템의 전체적인 구성 요소와 데이터의 이동 경로를 이해하는 데 필수적인 정보를 제공한다.

RAG 데이터 처리, 검색 및 생성 워크플로 다이어그램

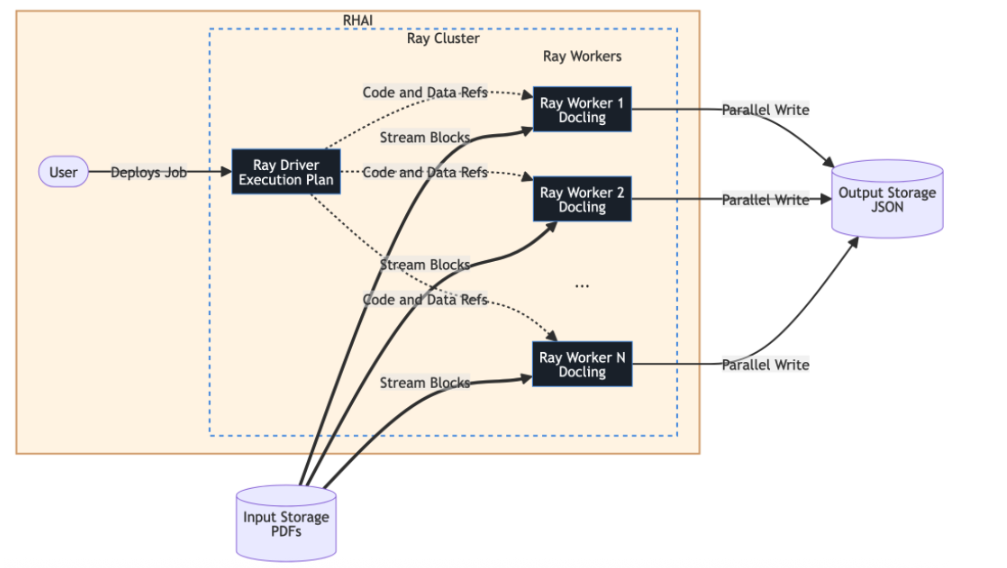

Ray Driver가 실행 계획을 관리하고 여러 Ray Worker가 Docling을 사용하여 병렬로 문서를 처리한 뒤 JSON 결과를 출력 저장소에 직접 쓰는 구조를 보여준다. 드라이버의 병목 없이 대규모 병렬 처리가 가능함을 기술적으로 입증한다.

Docling을 활용한 Ray 분산 문서 처리 아키텍처

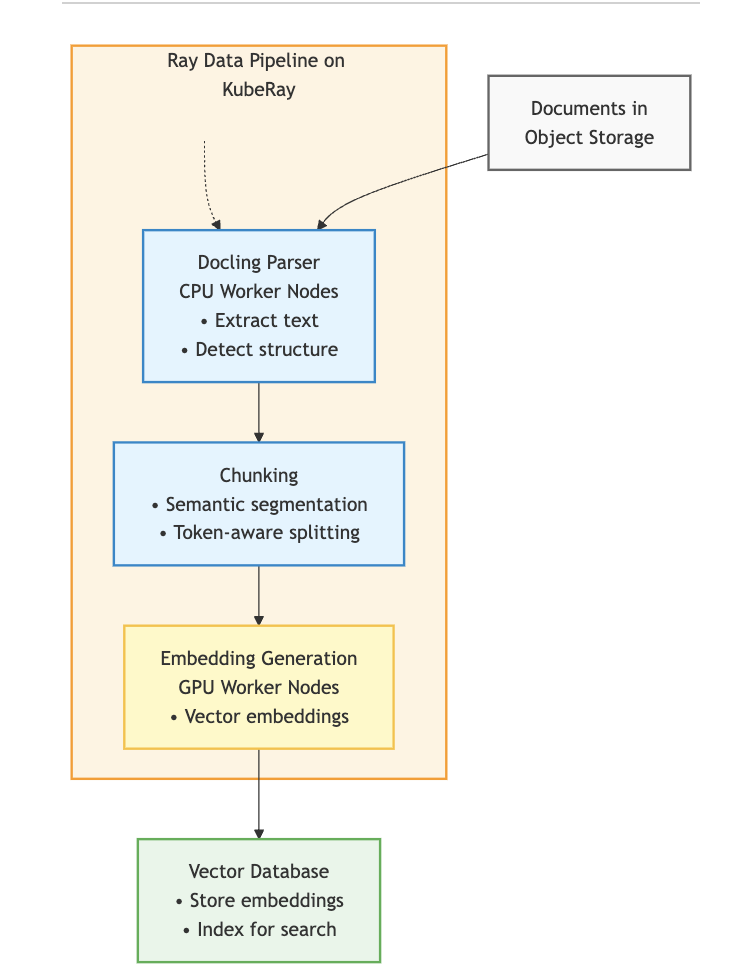

오브젝트 스토리지의 문서를 CPU 노드에서 Docling으로 파싱하고 GPU 노드에서 임베딩을 생성하여 Milvus 벡터 DB에 저장하는 엔드투엔드 파이프라인을 설명한다. 이기종 컴퓨팅 자원을 활용한 실제 배포 구조를 명확히 제시한다.

Kubernetes 기반 KubeRay 문서 처리 데이터 파이프라인

실무 Takeaway

- Ray Data의 스트리밍 엔진을 활용하여 CPU(파싱)와 GPU(임베딩) 자원을 동시에 사용하는 이기종 컴퓨팅 파이프라인을 구축하여 처리 속도를 극대화한다.

- 단순 텍스트 추출 대신 Docling과 같은 레이아웃 인식 파서를 사용하여 표와 구조 정보를 보존함으로써 RAG 검색의 정확도를 높인다.

- KubeRay를 도입하여 대규모 데이터 인입 시 클러스터를 동적으로 확장하고 노드 장애 시 자동 복구되는 안정적인 엔터프라이즈 인프라를 확보한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료