핵심 요약

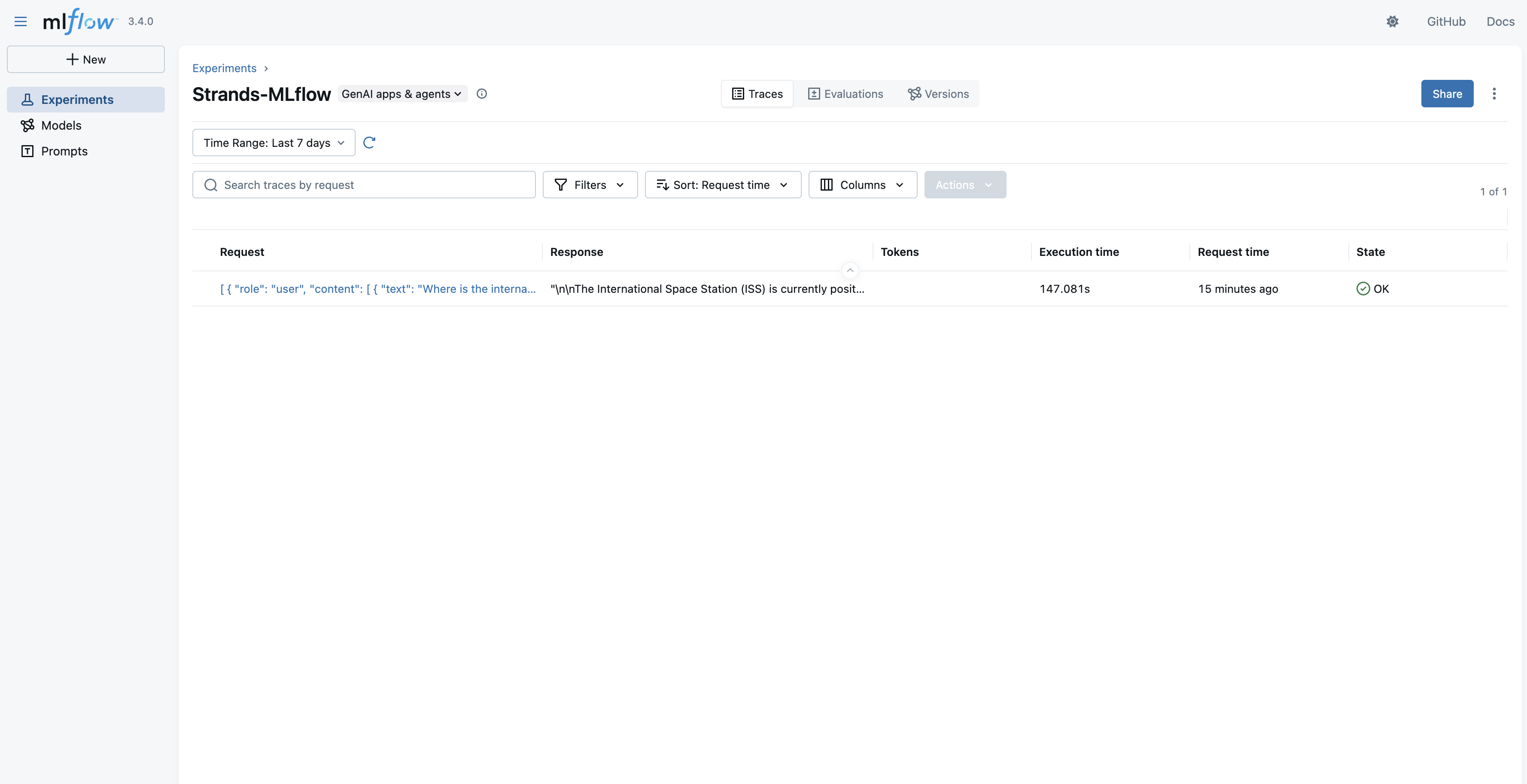

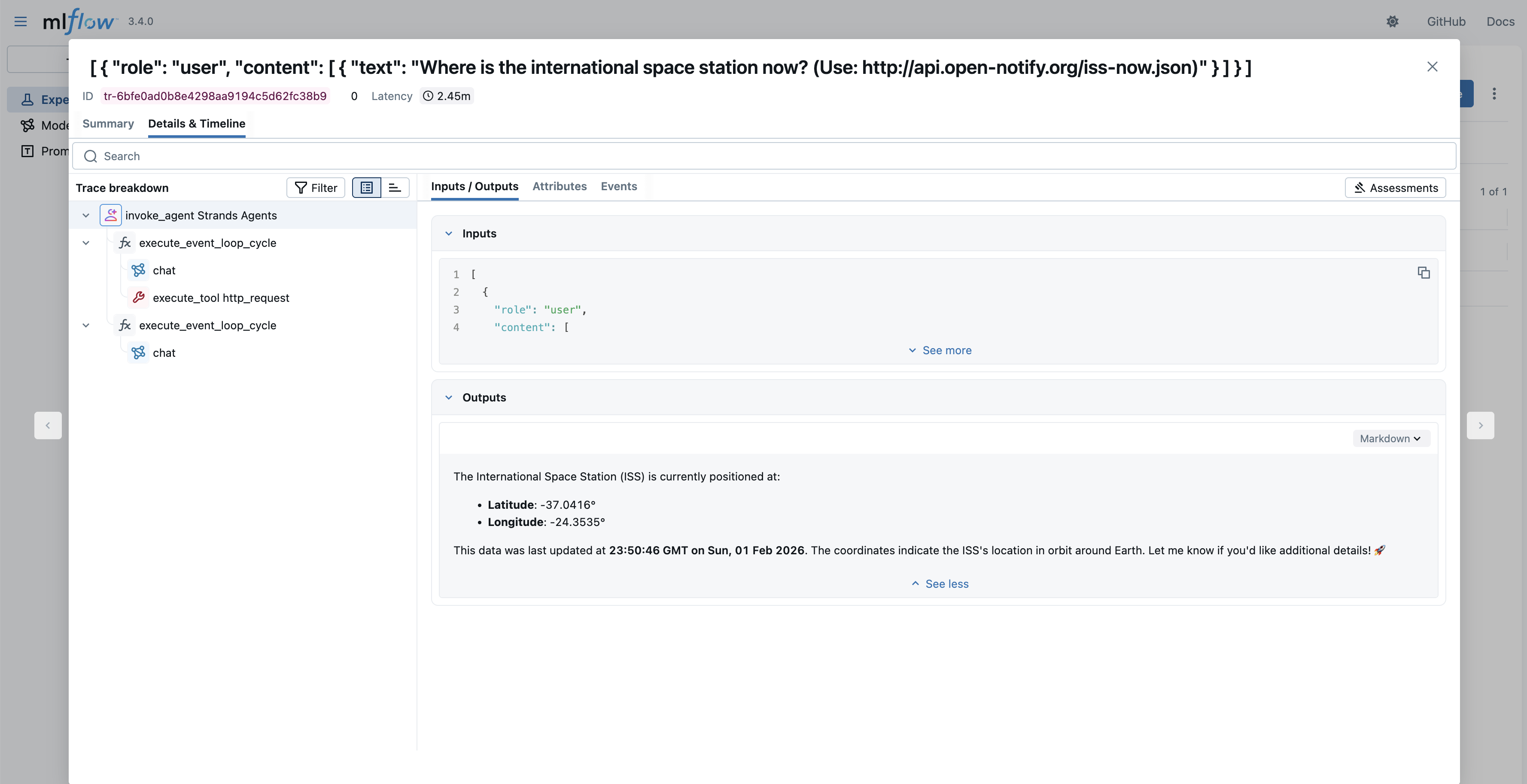

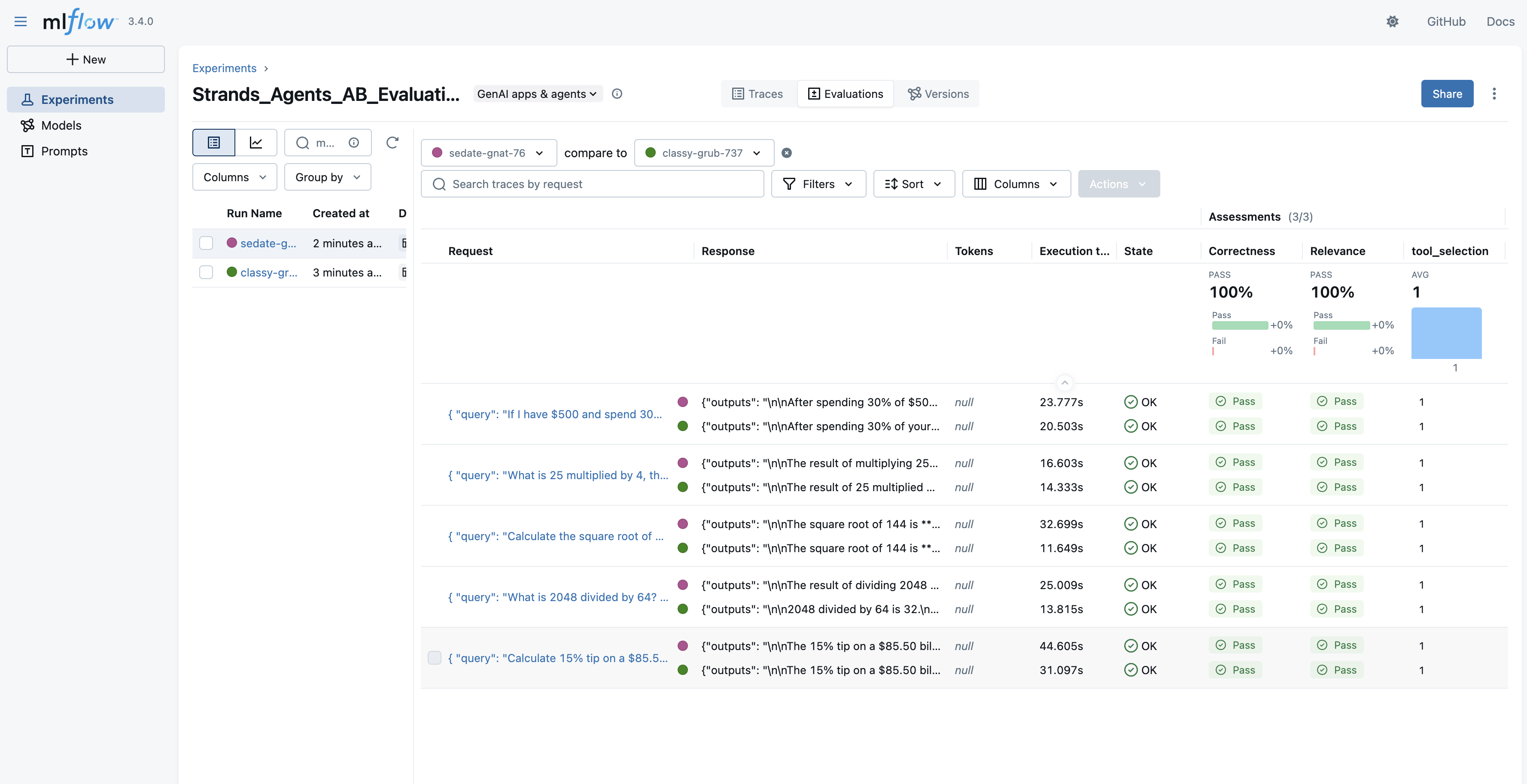

엔터프라이즈 환경에서 AI 에이전트를 구축할 때 성능 튜닝과 보안 및 비용 최적화를 위해 인프라 제어권 확보가 필수적이다. 이 가이드는 Amazon SageMaker AI 엔드포인트에 배포된 파운데이션 모델을 Strands Agents SDK와 통합하여 에이전트를 구성하는 워크플로를 제시한다. 특히 SageMaker Serverless MLflow를 활용해 에이전트의 실행 추적(Tracing)과 도구 사용 패턴을 시각화하고 성능을 모니터링하는 방법을 다룬다. 최종적으로 Qwen3 모델 변체들을 활용한 A/B 테스트와 MLflow GenAI 평가 프레임워크를 통해 데이터 기반의 모델 선택 및 최적화 과정을 완결한다.

배경

AWS 계정 및 Amazon Bedrock/SageMaker AI 접근 권한, Python 환경 (strands-agents, mlflow 3.4.0+ 설치 필요), SageMaker AI Serverless MLflow 앱 설정 지식

대상 독자

AWS 환경에서 AI 에이전트를 구축하고 운영 가시성을 확보하려는 ML 엔지니어 및 솔루션 아키텍트

의미 / 영향

이 가이드는 단순한 API 호출 기반 에이전트를 넘어 엔터프라이즈가 요구하는 보안, 비용, 관측성을 갖춘 에이전트 아키텍처를 제시합니다. 특히 오픈 소스 SDK인 Strands와 관리형 서비스인 SageMaker, MLflow의 조합은 기술적 유연성과 운영의 편의성을 동시에 제공하여 에이전트 도입 장벽을 낮춥니다.

섹션별 상세

실무 Takeaway

- Strands Agents SDK와 SageMaker AI를 통합하면 인프라 제어권을 유지하면서도 신속하게 에이전트 프로토타입을 프로덕션으로 전환할 수 있다.

- MLflow의 `autolog` 기능과 `@mlflow.trace` 데코레이터를 조합하여 에이전트 내부 로직뿐만 아니라 외부 함수 호출까지 포함된 전체 실행 가시성을 확보해야 한다.

- 새로운 모델 도입 시 SageMaker의 프로덕션 변체 기능을 활용해 트래픽을 분할하고 MLflow 평가 지표로 성능을 검증한 뒤 점진적으로 전환하는 것이 안전하다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.