핵심 요약

인셉션 랩스(Inception Labs)가 개발한 머큐리 2(Mercury 2)는 기존 대형 언어 모델의 고질적인 문제인 지연 시간(Latency)을 혁신적으로 해결한 모델이다. 대부분의 모델이 단어를 하나씩 생성하는 자기회귀(Auto-regressive) 방식을 사용하는 것과 달리, 머큐리 2는 이미지 생성에서 주로 쓰이던 확산(Diffusion) 기법을 텍스트 생성에 적용했다. 이를 통해 초당 1,000토큰이라는 압도적인 처리 속도를 달성했으며, 복잡한 추론 작업에서도 경쟁 모델 대비 10배 이상의 속도 우위를 점한다. 결과적으로 실시간 음성 비서나 코드 어시스턴트 등 즉각적인 반응이 필요한 AI 애플리케이션 분야에 새로운 가능성을 제시한다.

배경

LLM 추론 방식(Auto-regressive)에 대한 기본 이해, 확산 모델(Diffusion Model)의 기본 개념, API 기반 모델 통합 경험

대상 독자

실시간 AI 서비스를 구축하는 개발자 및 AI 인프라 비용 최적화가 필요한 엔지니어

의미 / 영향

머큐리 2의 등장은 LLM의 성능 경쟁이 단순한 파라미터 크기를 넘어 생성 아키텍처의 효율성으로 이동하고 있음을 시사한다. 특히 확산 모델의 텍스트 적용 성공은 향후 추론 모델의 표준 아키텍처를 바꿀 수 있는 중대한 변화이다.

섹션별 상세

이미지 분석

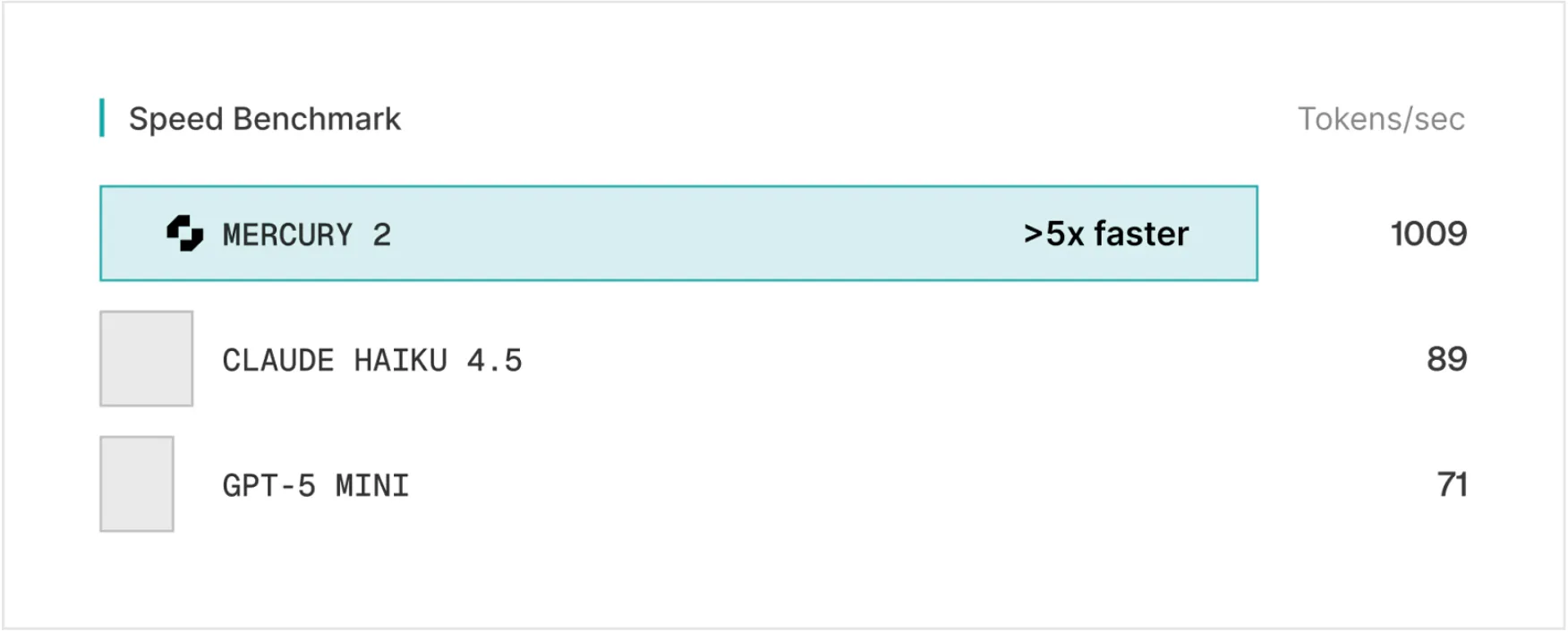

머큐리 2가 1009 tps를 기록하며 클로드 4.5 하이쿠(89 tps) 및 GPT-5 미니(71 tps) 대비 10배 이상의 압도적인 속도 우위를 점하고 있음을 보여준다.

머큐리 2와 경쟁 모델 간의 초당 토큰 처리량 비교 차트이다.

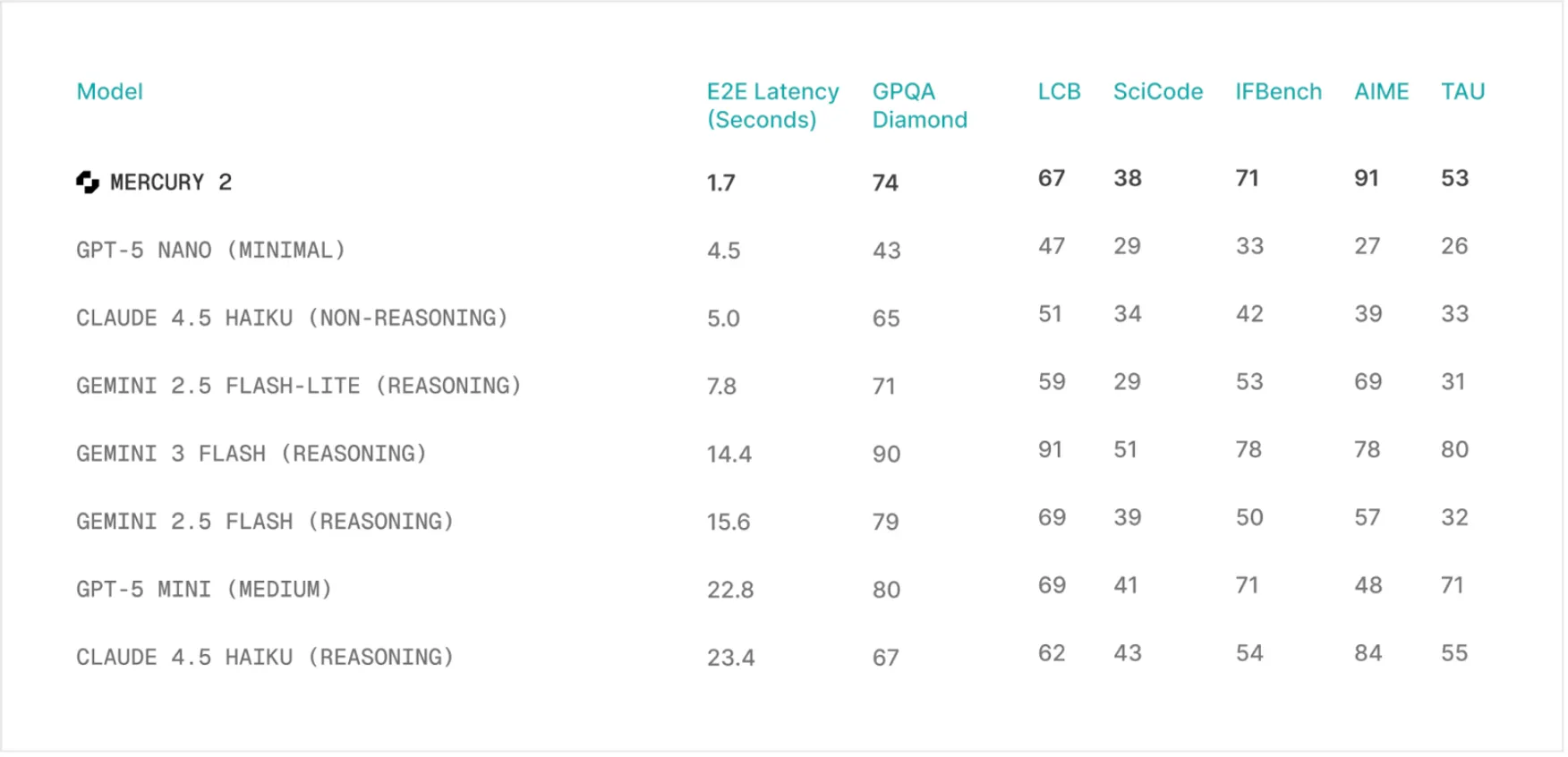

E2E 지연 시간이 1.7초로 가장 낮으면서도 AIME(91점), GPQA(74점) 등 주요 추론 지표에서 최상위권 모델들과 대등하거나 우수한 성능을 기록했음을 증명한다.

머큐리 2의 지연 시간 및 주요 벤치마크 점수 상세 비교표이다.

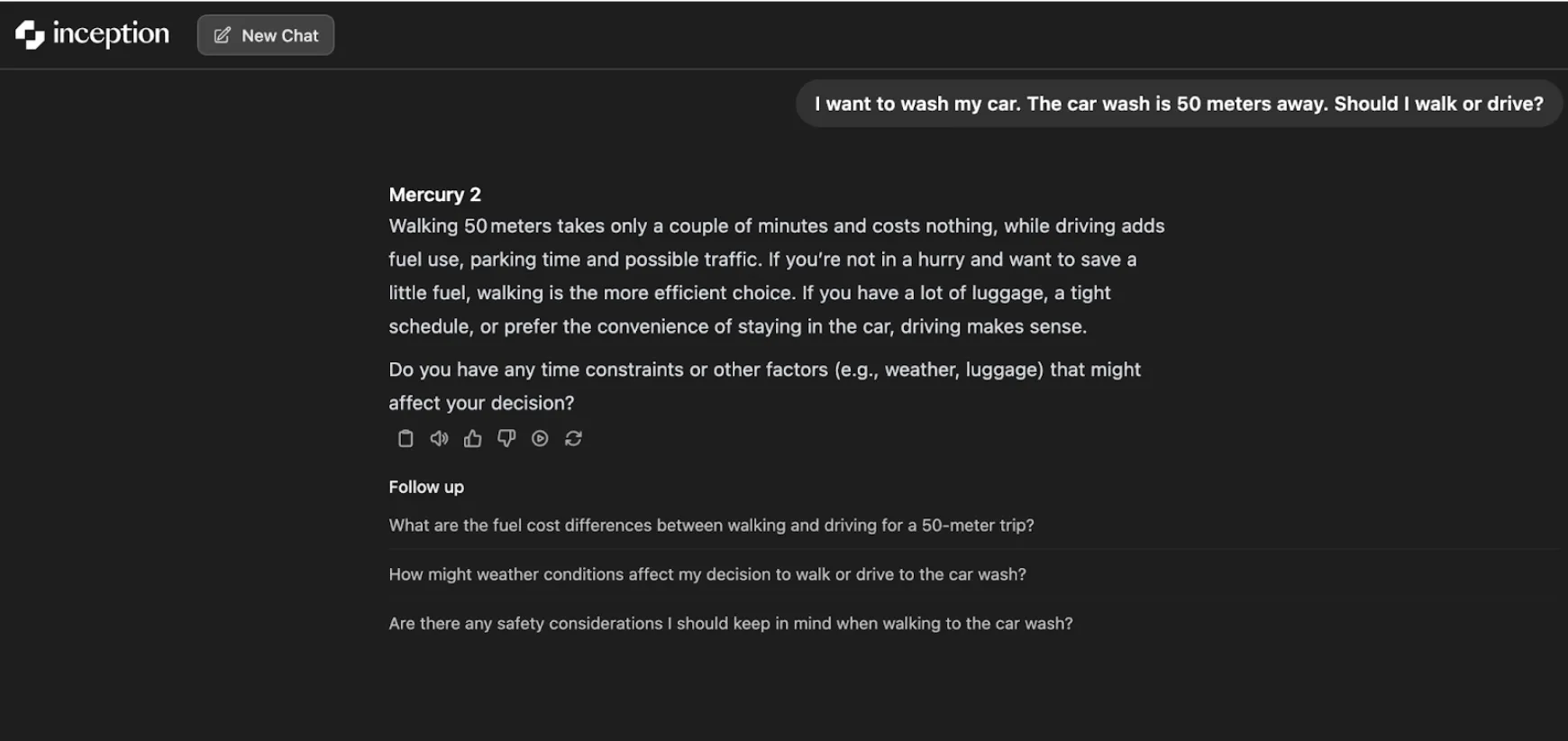

단순한 거리 계산을 넘어 세차장의 종류(드라이브인 vs 셀프 서비스)와 날씨 등 맥락을 고려하여 논리적인 답변을 생성하는 과정을 보여준다.

머큐리 2를 이용한 세차장 방문 여부 추론 테스트 결과 화면이다.

실무 Takeaway

- 실시간 상호작용이 필수적인 서비스에서 지연 시간을 1/10 수준으로 단축하여 사용자 경험을 극대화할 수 있다.

- 확산 기반 LLM은 기존 자기회귀 모델의 순차적 생성 한계를 극복하는 새로운 아키텍처 대안으로 활용 가능하다.

- 낮은 토큰 비용과 높은 처리량을 결합하여 대규모 AI 에이전트 루프나 실시간 검색 도구의 운영 비용을 획기적으로 절감할 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료