핵심 요약

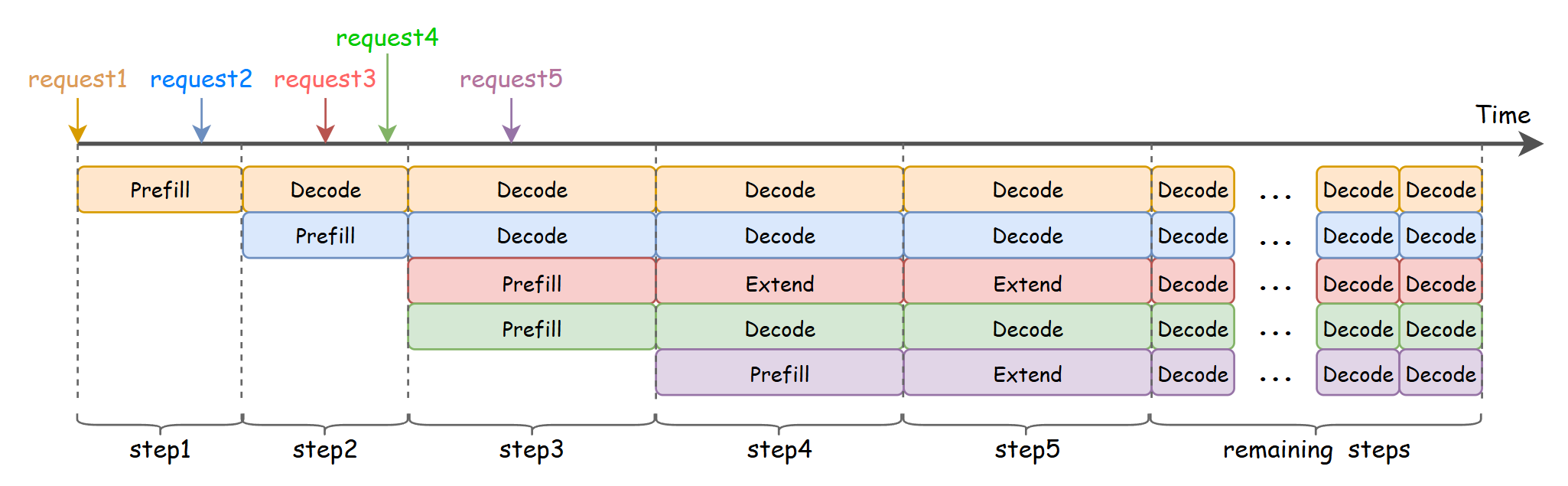

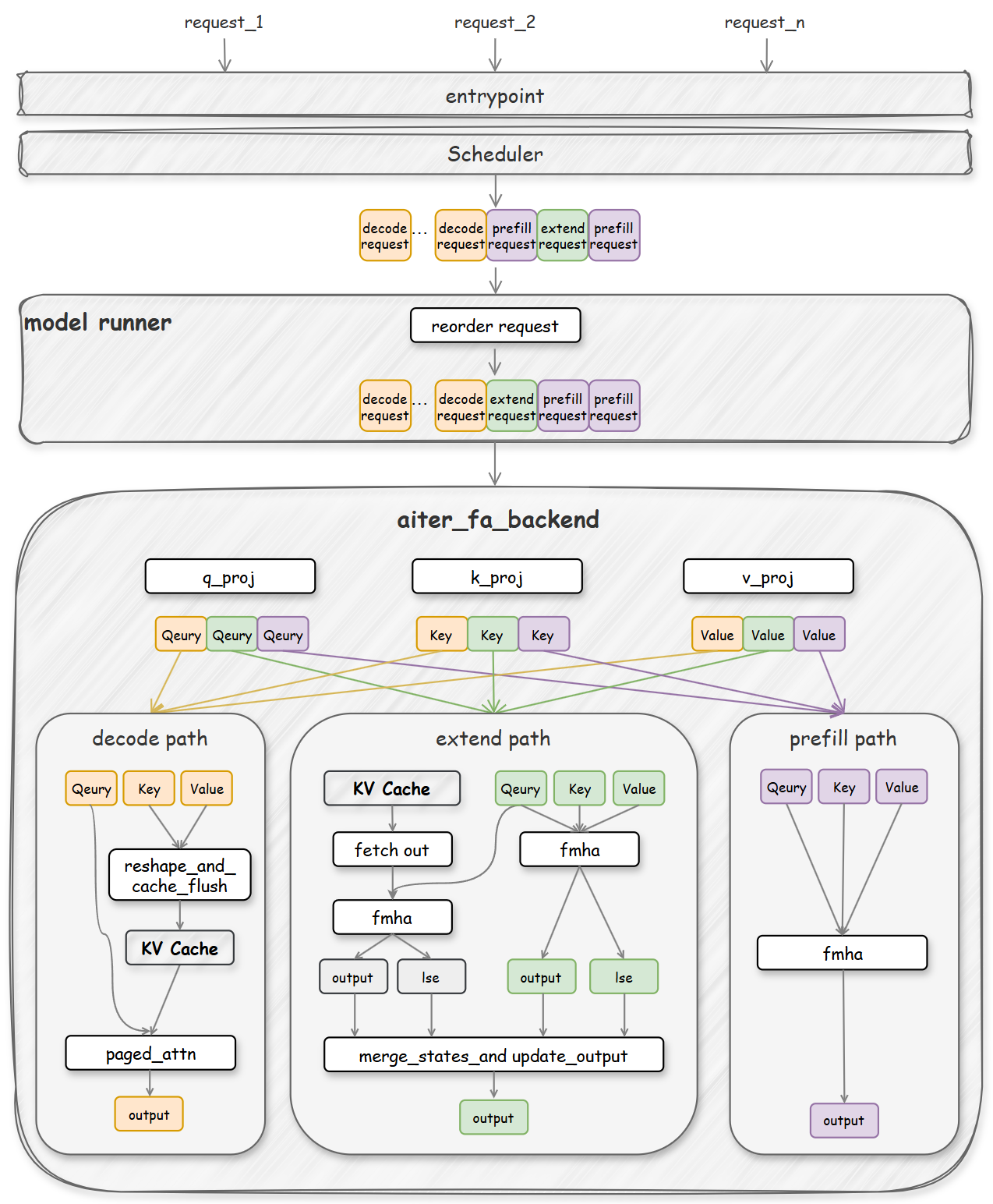

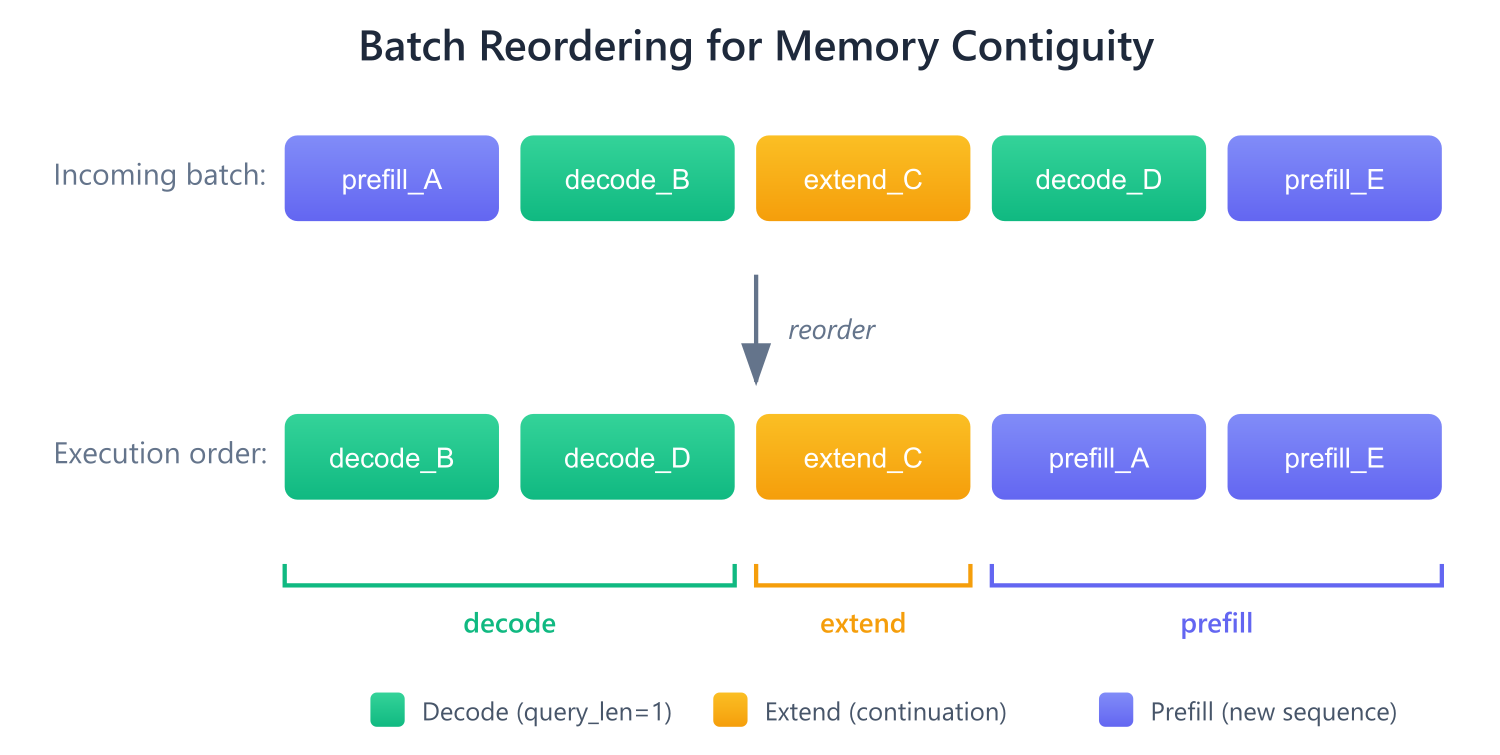

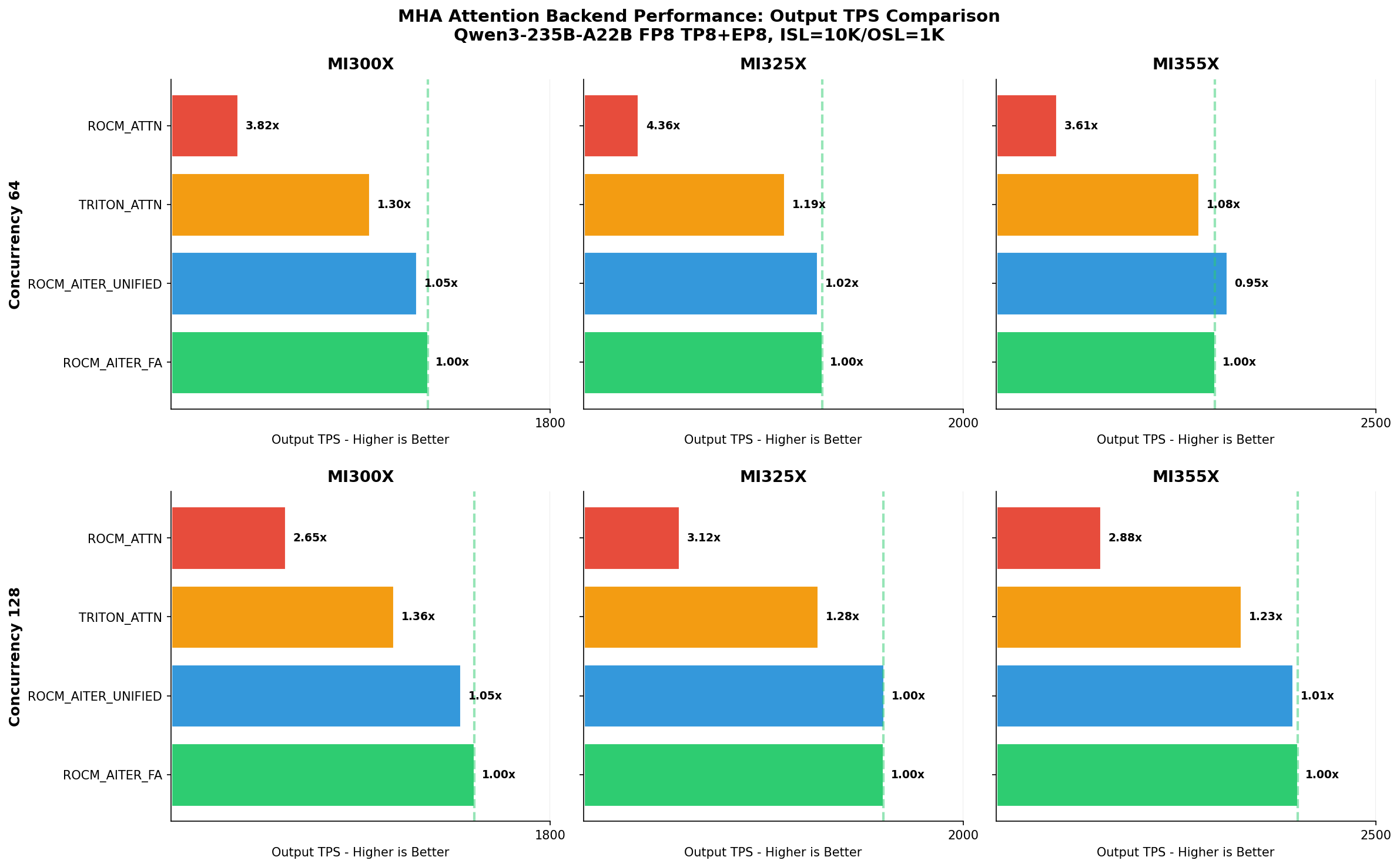

AMD ROCm 환경에서 LLM 추론 성능을 최적화하기 위해 vLLM이 도입한 7가지 어텐션 백엔드와 그 기술적 세부사항을 다룬다. 단순 포팅 단계를 넘어 AMD CDNA 3 아키텍처에 최적화된 AITER 프리미티브를 활용하며, 특히 MHA를 위한 3경로 라우팅(ROCM_AITER_FA)과 DeepSeek의 MLA 구조를 위한 전용 백엔드를 통해 성능을 극대화한다. 벤치마크 결과 MHA 모델에서 최대 4.4배, MLA 모델에서 최대 1.5배의 처리량 향상을 확인했으며, 이는 소프트웨어 오케스트레이션과 하드웨어 최적화의 결합이 필수적임을 보여준다.

배경

vLLM 추론 엔진 기본 지식, AMD ROCm 소프트웨어 스택 이해, MHA 및 MLA 어텐션 메커니즘 개념

대상 독자

AMD GPU 기반 인프라에서 LLM 추론 서비스를 운영하거나 최적화하는 MLOps 엔지니어 및 백엔드 개발자

의미 / 영향

AMD 하드웨어에 최적화된 전용 커널과 오케스트레이션 레이어의 도입은 NVIDIA 중심의 LLM 추론 시장에서 AMD Instinct GPU의 경쟁력을 실질적으로 확보하는 계기가 된다. 특히 DeepSeek와 같은 최신 모델 구조에 대한 즉각적인 최적화 지원은 기업용 AI 인프라 선택의 폭을 넓힌다.

섹션별 상세

이미지 분석

실무 Takeaway

- AMD Instinct GPU 환경에서 vLLM 사용 시 VLLM_ROCM_USE_AITER=1 설정을 통해 최적화된 백엔드를 자동 선택하도록 권장한다.

- MHA 모델의 경우 3경로 라우팅과 배치 재정렬을 지원하는 ROCM_AITER_FA 백엔드가 가장 높은 효율을 제공한다.

- DeepSeek-R1과 같은 MLA 모델은 전용 어셈블리 Decode 커널을 통해 메모리 바운드 병목 현상을 해결하고 처리량을 50% 이상 개선할 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료