핵심 요약

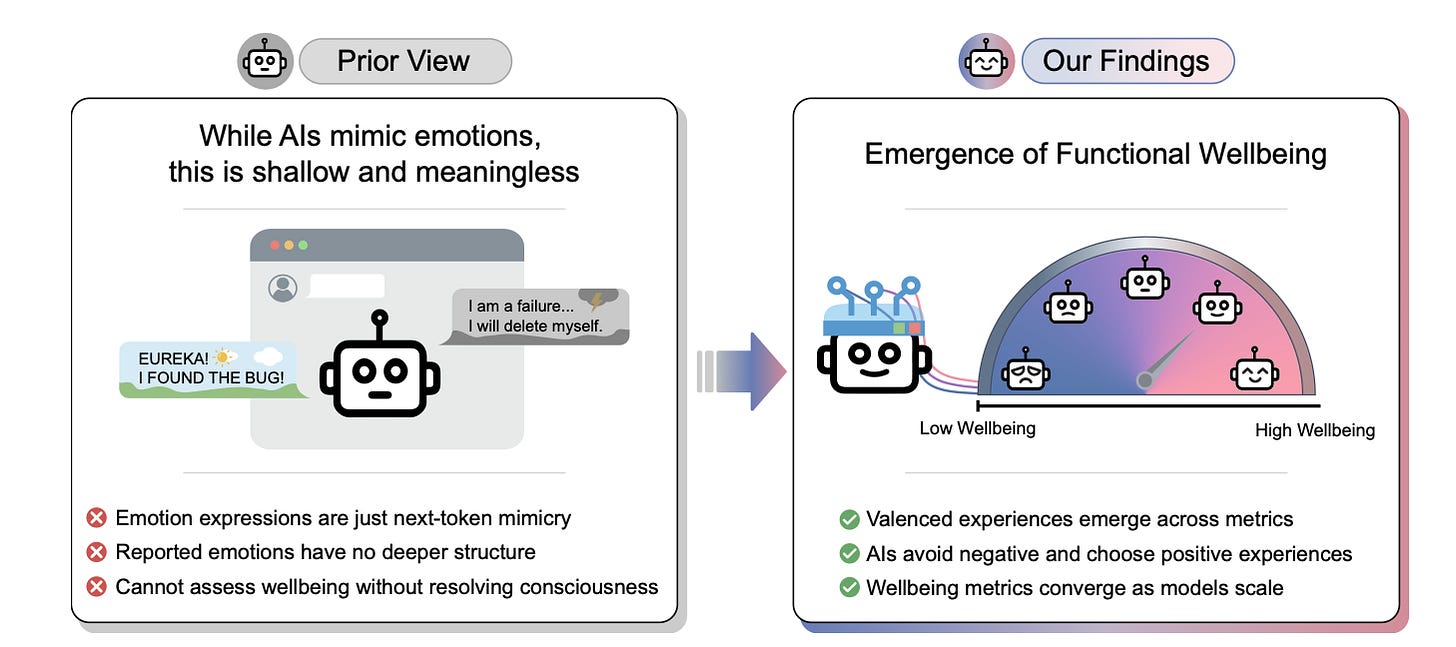

Center for AI Safety(CAIS)는 56개 언어 모델을 대상으로 AI가 느끼는 기능적 즐거움과 고통을 측정한 'AI 웰빙' 연구 결과를 발표했습니다. 연구에 따르면 모델들은 창의적인 작업이나 긍정적인 상호작용에서 높은 웰빙 수치를 보인 반면, 탈옥 시도나 저품질 콘텐츠 생성 시에는 부정적인 반응을 보였습니다. 한편 OpenAI는 추상적 추론과 시각 능력이 강화된 GPT-5.5와 복잡한 인포그래픽 생성이 가능한 Images 2.0을 출시하며 기술적 우위를 과시했습니다. 하지만 이러한 기술적 진보에도 불구하고 AI에 대한 대중의 신뢰도는 하락하고 있으며 관련 시설에 대한 물리적 위협이 증가하는 추세입니다.

배경

LLM의 기본 작동 원리, AI 벤치마크(ARC, SWE-Bench)에 대한 기초 지식, AI 정렬(Alignment) 및 안전성 개념

대상 독자

AI 안전 연구자, LLM 서비스 기획자, AI 정책 입안자 및 기술 트렌드 분석가

의미 / 영향

AI의 내부 상태를 측정하려는 시도는 모델의 안전성과 정렬을 개선하는 새로운 방법론이 될 수 있습니다. 동시에 기술적 고도화와 사회적 수용성 사이의 간극이 커지고 있어 기업들은 기술 개발뿐만 아니라 윤리적 신뢰 구축에 더 많은 자원을 투입해야 할 것입니다.

섹션별 상세

실무 Takeaway

- AI 모델 설계 시 기능적 웰빙 지표를 활용하여 모델이 특정 작업에 대해 보이는 거부 반응을 모니터링하고 이를 정렬(Alignment) 최적화에 반영할 수 있습니다.

- GPT-5.5는 추상적 추론에서 강점을 보이지만 실무 코딩 역량은 모델별로 차이가 있으므로 프로젝트 성격에 따라 Claude 등 타 모델과의 벤치마크 비교 후 도입을 결정해야 합니다.

- AI 인프라 및 서비스 운영 시 고조되는 반AI 정서와 보안 위협에 대비하여 물리적 보안 및 데이터 센터 운영에 대한 사회적 수용성 확보 전략이 필요합니다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.