핵심 요약

기존의 규칙 기반 챗봇은 유연성이 부족하고 단순 LLM 구현은 비즈니스 로직의 구조화와 상태 유지가 어렵다는 한계가 있다. 본 아티클은 Amazon Bedrock, LangGraph, 그리고 Amazon SageMaker AI의 관리형 MLflow를 사용하여 이러한 문제를 해결하는 지능형 주문 관리 에이전트 구축 방법을 설명한다. 이 시스템은 그래프 기반의 대화 흐름을 통해 고객의 의도를 파악하고 백엔드 시스템과 연동하여 주문 조회 및 취소 등의 작업을 수행하며 모든 과정을 MLflow로 추적하여 가시성을 확보한다. 서버리스 아키텍처를 채택하여 비용 효율성과 확장성을 동시에 달성한 것이 특징이다.

배경

AWS 계정 및 권한, Python 3.12+, Node.js 20+, Docker, 기본적인 서버리스 아키텍처 이해

대상 독자

AWS 기반의 LLM 에이전트를 구축하려는 클라우드 아키트 및 AI 엔지니어

의미 / 영향

이 아키텍처는 단순 챗봇을 넘어 실제 비즈니스 로직을 수행하는 에이전틱 워크플로의 표준 모델을 제시한다. 서버리스와 관리형 서비스의 결합은 기업이 인프라 관리 부담 없이 고성능 AI 서비스를 빠르게 시장에 출시할 수 있게 한다.

섹션별 상세

이미지 분석

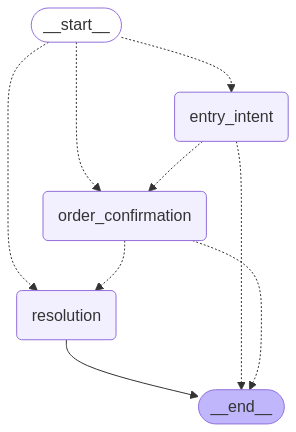

시작 단계부터 의도 파악, 주문 확인, 해결 및 종료에 이르는 에이전트의 논리적 흐름을 보여준다. LangGraph로 구현된 노드 간의 이동 경로를 시각적으로 이해하는 데 도움을 준다.

고객 서비스 워크플로의 상태 전이 다이어그램.

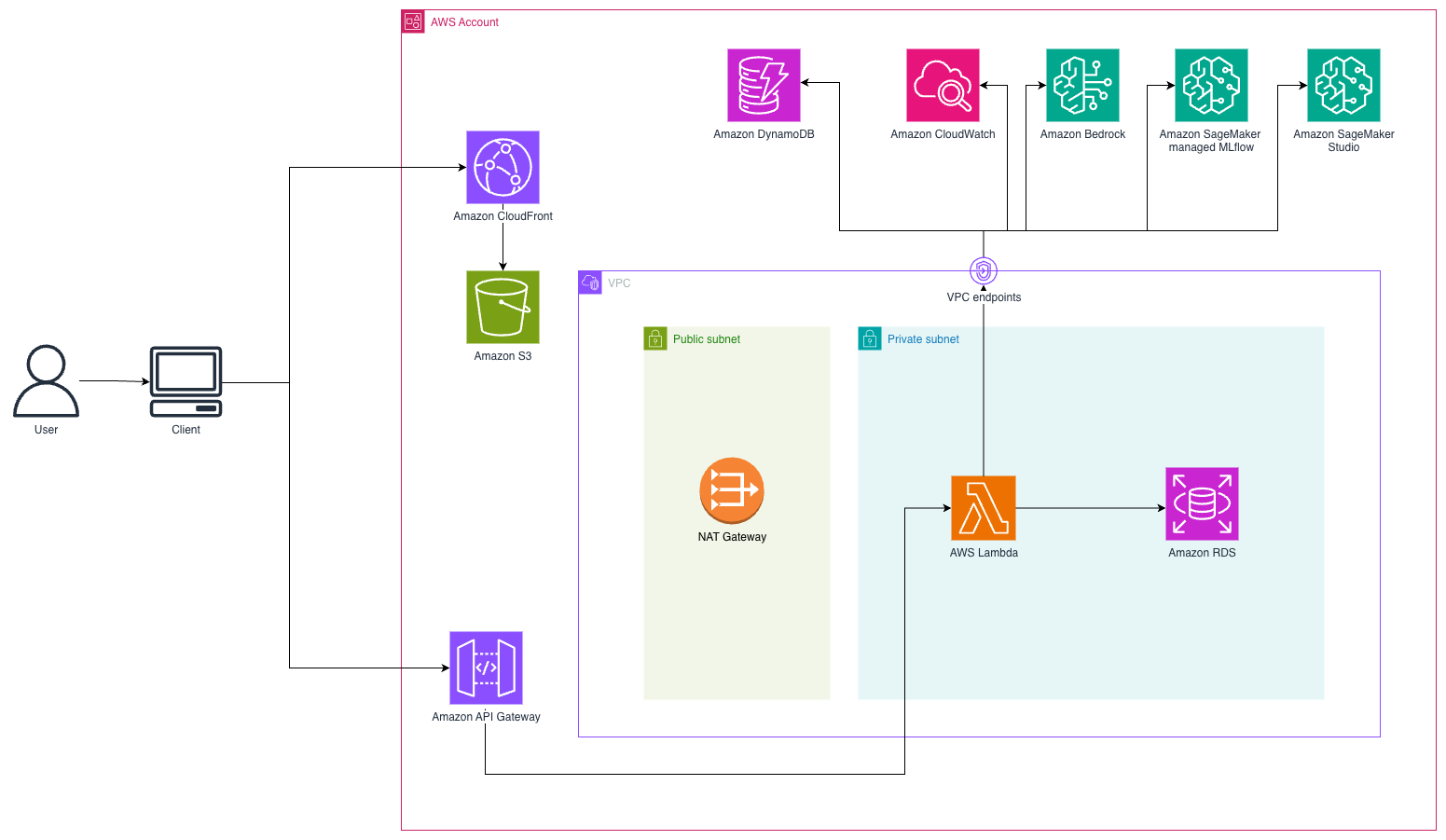

CloudFront, API Gateway, Lambda, DynamoDB, RDS 및 Bedrock이 어떻게 상호작용하는지 전체 시스템 구조를 설명한다. 퍼블릭/프라이빗 서브넷 구성과 VPC 엔드포인트를 통한 보안 연결 구조를 명확히 보여준다.

AWS 서버리스 클라우드 아키텍처 다이어그램.

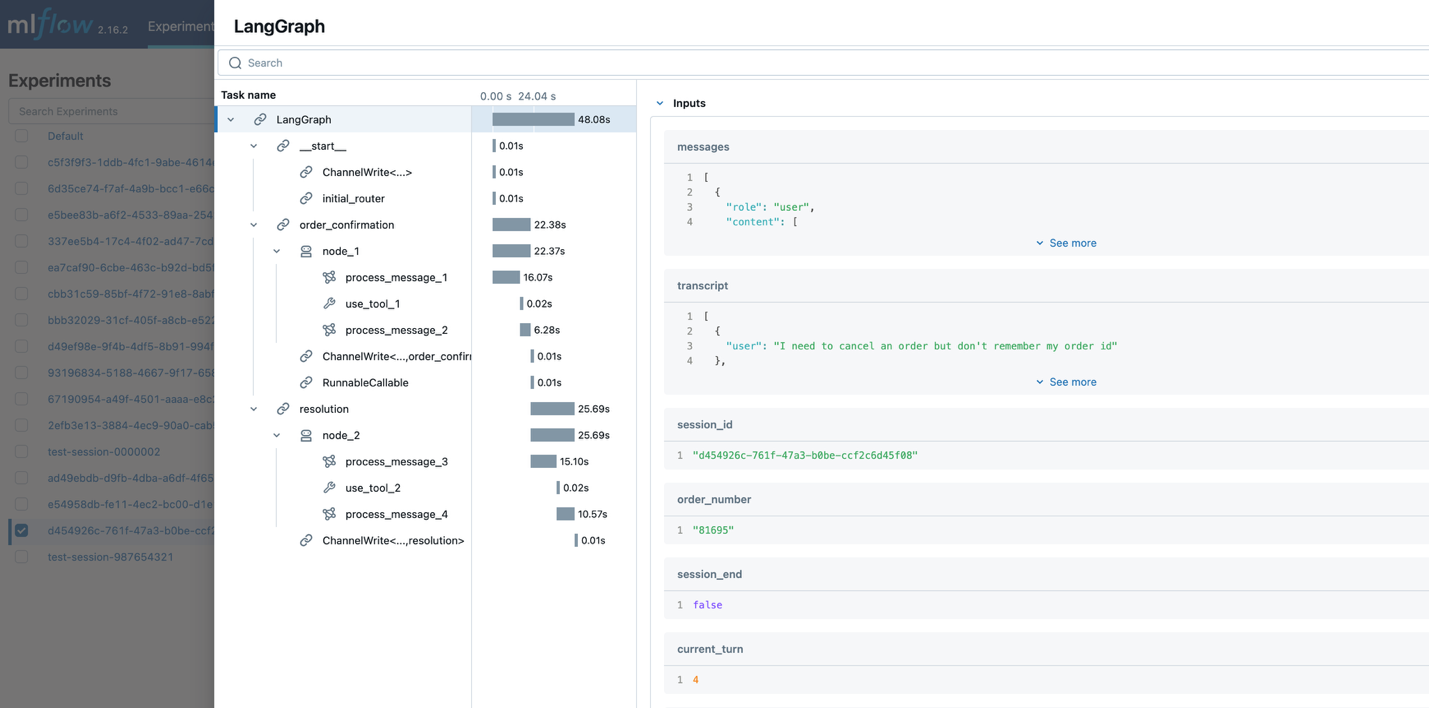

에이전트 실행 시 각 노드별 소요 시간, 입력 메시지, 세션 정보 등의 트레이싱 데이터를 보여준다. 48초의 전체 실행 시간 중 각 단계가 차지하는 비중을 확인하여 성능 최적화 근거로 활용할 수 있음을 시사한다.

MLflow의 LangGraph 실험 추적 인터페이스 스크린샷.

실무 Takeaway

- LangGraph를 사용하여 복잡한 LLM 워크플로를 상태 기반 그래프로 구조화하면 대화의 예측 가능성과 제어력을 크게 높일 수 있다.

- LLM의 직접적인 텍스트 생성 대신 구조화된 도구 호출을 활용하여 백엔드 DB와 연동함으로써 데이터 정확성을 보장하고 환각을 방지한다.

- 프로덕션 환경의 에이전트 운영을 위해 MLflow와 같은 추적 도구를 도입하여 각 단계별 지연 시간과 토큰 비용을 모니터링하는 것이 필수적이다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료