핵심 요약

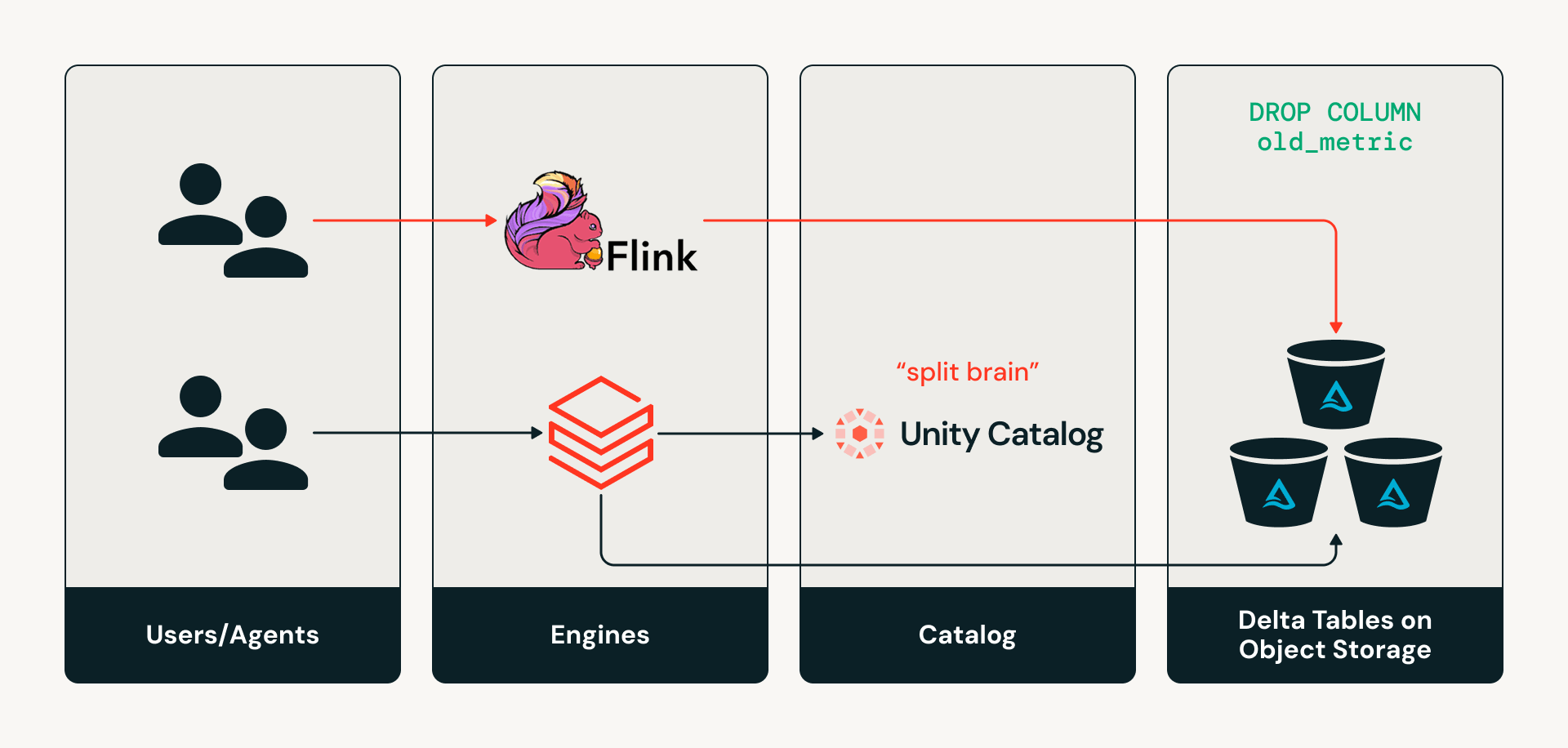

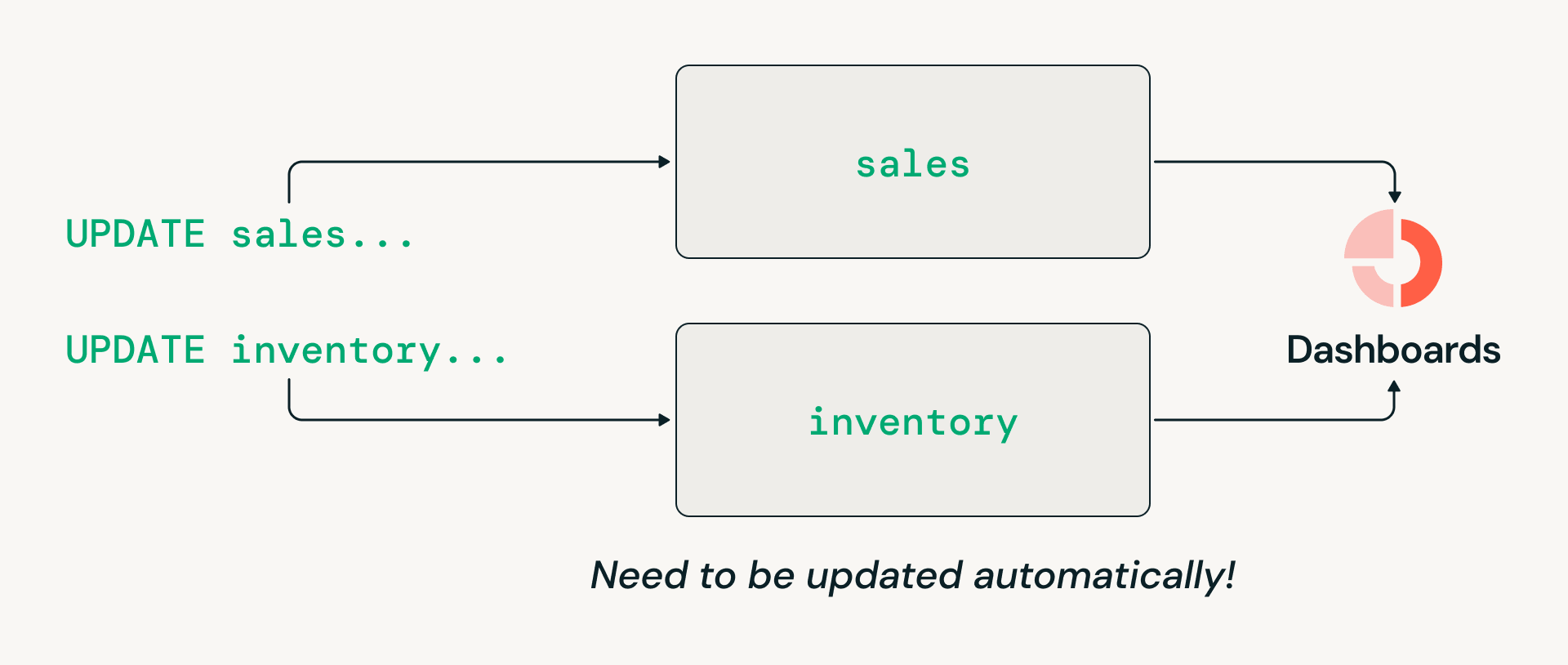

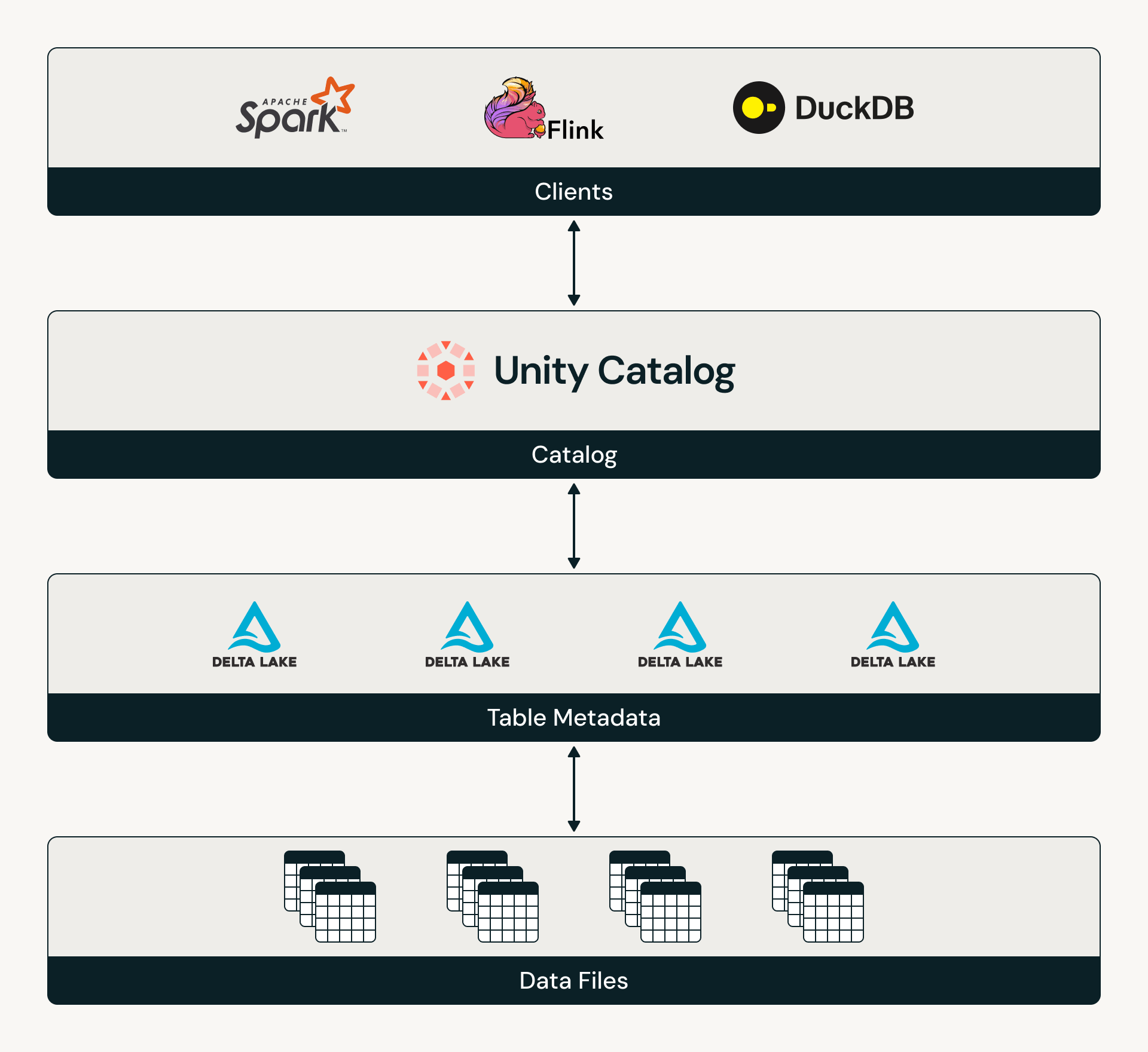

Databricks는 Delta Lake의 파일 시스템 기반 트랜잭션 모델을 카탈로그 중심 모델로 진화시킨 Catalog Commits 기능을 정식 출시했다. 기존 구조에서는 외부 엔진이 스토리지에 직접 쓰기를 수행할 때 카탈로그 메타데이터와 실제 데이터가 불일치하는 '스플릿 브레인' 현상이 발생했으나, 이 기능은 카탈로그를 모든 엔진의 조정 시스템으로 설정해 이를 해결한다. 이를 통해 여러 테이블에 걸친 원자적 쓰기인 멀티 테이블 트랜잭션이 가능해졌으며, 다양한 엔진과 AI 에이전트가 통일된 거버넌스 하에서 데이터를 조회할 수 있다. 결과적으로 데이터 웨어하우스의 복잡한 워크로드를 레이크하우스 환경으로 완전히 통합할 수 있는 기술적 토대를 마련했다.

배경

Databricks Unity Catalog에 대한 기본 이해, Delta Lake 테이블 포맷 및 ACID 트랜잭션 개념, Databricks Runtime 16.4 이상 환경

대상 독자

데이터 엔지니어, 데이터 아키텍트, 레이크하우스 기반 AI 시스템 개발자

의미 / 영향

이 기술은 레이크하우스와 데이터 웨어하우스 사이의 마지막 기술적 격차를 해소하여 기업이 단일 데이터 플랫폼으로 통합할 수 있게 합니다. 특히 AI 에이전트의 데이터 접근이 증가하는 상황에서 카탈로그 중심의 통합 거버넌스는 보안 사고를 예방하는 핵심 인프라가 될 것입니다.

섹션별 상세

실무 Takeaway

- 시스템 프롬프트나 메타데이터가 빈번히 변경되는 환경에서 Catalog Commits를 활성화하면 외부 엔진(Flink, Spark 등)과의 데이터 불일치 문제를 원천 차단할 수 있다.

- 멀티 테이블 트랜잭션 기능을 활용하여 기존에 데이터 웨어하우스에서만 가능했던 복잡한 SQL 스크립팅 및 저장 프로시저 워크로드를 레이크하우스로 마이그레이션할 수 있다.

- Delta Kernel을 통합한 엔진을 사용하면 프로토콜 수준의 복잡한 구현 없이도 최신 Delta Lake 기능을 즉시 활용하여 개발 생산성을 높일 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.