핵심 요약

Thinking Machines는 실시간 인간-AI 협업을 위한 새로운 접근 방식인 Interaction Models를 발표하며 TML-Interaction-Small 모델을 공개했습니다. 이 모델은 276B 파라미터 규모의 MoE 구조로 12B의 활성 파라미터를 사용하며, 기존의 VAD 방식을 대체하는 200ms 단위의 '시간 정렬 마이크로 턴' 아키텍처를 채택했습니다. 인코더가 없는 얼리 퓨전 방식을 통해 이미지와 오디오를 통합 처리하며, 지연 시간을 최소화하여 실제 대화와 유사한 연속적인 상호작용을 지원합니다. 이번 발표는 GPT-4o의 데모 수준을 넘어 실제 사용 환경에 근접한 실시간 음성 SOTA를 달성했다는 평가를 받습니다.

배경

Mixture of Experts (MoE) 아키텍처에 대한 이해, VAD (Voice Activity Detection) 및 토큰 스트리밍 개념, GGUF 및 llama.cpp 등 로컬 추론 환경 지식

대상 독자

실시간 음성 AI 및 멀티모달 에이전트를 개발하는 엔지니어와 로컬 LLM 최적화에 관심 있는 연구자

의미 / 영향

Thinking Machines의 이번 발표는 실시간 AI 상호작용의 표준을 단순한 응답 생성이 아닌 '연속적 흐름'으로 재정의했습니다. 이는 향후 고객 서비스, 개인 비서, 실시간 통번역 분야에서 지연 시간 없는 네이티브 멀티모달 모델의 도입을 가속화할 것입니다.

섹션별 상세

실무 Takeaway

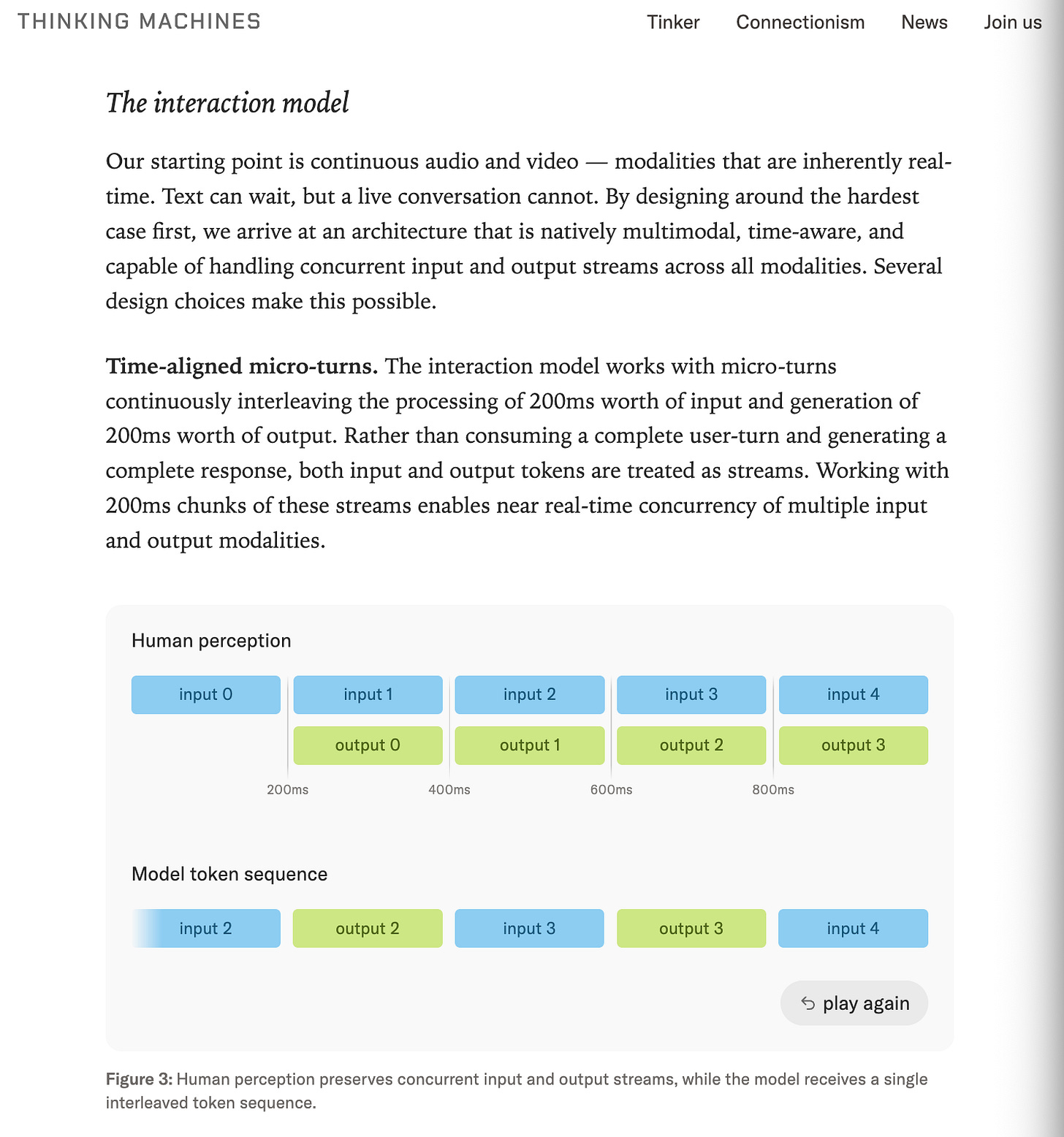

- 실시간 음성 서비스를 구축할 때 VAD 기반의 턴제 방식 대신 200ms 단위의 마이크로 턴 아키텍처를 도입하면 대화의 즉각성을 획기적으로 개선할 수 있다

- 멀티모달 모델 설계 시 인코더 프리 얼리 퓨전 방식을 선택하면 데이터 처리 효율을 높이고 모달리티 간의 시간적 정렬을 더 정교하게 관리할 수 있다

- 로컬 환경에서 Qwen 3.6과 같은 최신 모델을 운영할 때 MTP 지원 여부를 확인하여 추론 속도를 최적화하되 라이브러리 호환성 이슈를 사전에 검토해야 한다

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.