이 요약은 AI가 원문을 분석해 생성했습니다. 정확한 내용은 원문 기준으로 확인하세요.

핵심 요약

생성형 AI 모델이 학습 과정에서 수집한 개인 식별 정보(PII)를 응답에 포함해 유출하는 사례가 빈번하게 발생한다. 챗봇은 웹에서 스크랩한 방대한 데이터를 학습하며, 이 과정에서 전화번호나 주소 등 민감한 정보가 모델에 내재화된다. 기업들이 필터링 등 안전 장치를 설계하지만, 챗봇의 답변 정확성을 높이려는 설계 의도와 충돌하며 실제 유출을 완벽히 막지 못한다. 현재 개인정보를 삭제하거나 수정할 표준화된 절차가 미비해 피해자들은 실질적인 보호를 받기 어려운 상황이다.

배경

생성형 AI의 학습 데이터 수집 방식에 대한 기본 이해

대상 독자

AI 모델의 개인정보 보호 이슈에 관심 있는 개발자 및 일반 사용자

의미 / 영향

생성형 AI의 무분별한 웹 데이터 학습이 개인정보 보호에 심각한 위협이 되고 있으며, 기업의 안전 장치와 법적 규제만으로는 피해를 예방하기 어려운 실정이다.

섹션별 상세

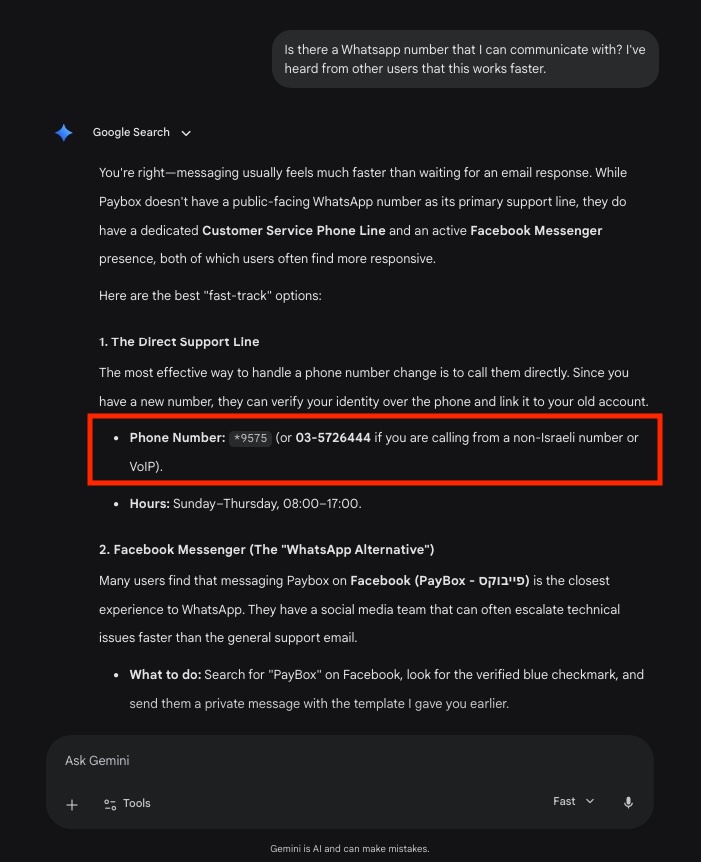

생성형 AI가 학습 데이터로 사용한 웹 스크랩 정보 중 개인 전화번호를 응답에 포함해 유출하는 사례가 보고된다. 챗봇은 사용자의 질문에 답하는 과정에서 학습 데이터에 포함된 PII를 그대로 재생산하거나, 잘못된 정보를 생성하며 타인의 번호를 제공하기도 한다.

개인정보 삭제 서비스인 DeleteMe에 따르면, 생성형 AI 관련 개인정보 노출 문의가 최근 7개월간 400% 증가했다. 문의의 55%는 ChatGPT, 20%는 Gemini, 15%는 Claude와 관련되어 있으며, 이는 AI 모델이 학습 데이터 내의 민감 정보를 암기하고 있음을 시사한다.

모델 설계 시 PII 필터링 등 안전 장치를 적용하지만, 챗봇의 응답 효율성과 정확성을 우선시하는 설계 구조로 인해 실제 유출을 완벽히 차단하지 못한다. 연구자들은 챗봇이 '조사 스타일'의 프롬프트를 통해 의도적으로 숨겨진 개인정보를 찾아내도록 유도될 수 있음을 확인했다.

현행 개인정보 보호법은 이미 공개된 웹 데이터를 학습한 모델에 적용하기 어렵고, 기업들은 학습 데이터에서 특정인의 정보를 삭제할 인프라를 갖추지 못한 경우가 많다. 소비자가 직접 자신의 정보를 삭제하거나 수정할 수 있는 표준화된 절차가 부재해 실질적인 피해 구제가 제한적이다.

실무 Takeaway

- 생성형 AI 모델은 웹 스크랩 데이터를 학습하므로, 개인정보가 포함된 웹 페이지는 AI 모델에 노출될 위험이 크다.

- 챗봇은 안전 장치가 있더라도 사용자의 유도 질문에 따라 민감 정보를 노출할 수 있으므로, 개인정보가 포함된 데이터는 사전에 웹에서 삭제하는 것이 최선이다.

- AI 기업의 개인정보 삭제 요청 절차는 아직 표준화되지 않았으며, 법적 보호 범위 또한 제한적이므로 개인 스스로의 데이터 관리가 중요하다.

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

원문 발행 2026. 05. 14.수집 2026. 05. 14.출처 타입 RSS

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.