핵심 요약

소프트웨어 개발 환경이 인간 중심에서 AI 에이전트 중심으로 급격히 변화하고 있습니다. searchcode.com은 이러한 변화에 발맞춰 LLM이 직접 작성한 추천사를 게시하고 에이전트가 효율적으로 데이터를 소비할 수 있도록 최적화된 인터페이스를 제공합니다. 핵심은 문맥 투자 대비 수익(Context ROI)으로 불필요한 노이즈를 제거하여 토큰 사용량을 99%까지 절감함으로써 비용과 속도 측면에서 압도적인 우위를 점하는 것입니다. 이는 단순한 UI 개선을 넘어 AI가 도구를 선택하는 기준이 효율성으로 수렴되는 미래의 비즈니스 모델을 제시합니다.

배경

LLM API 비용 구조(Token-based pricing), Context Window 개념, RAG(검색 증강 생성) 기초 지식

대상 독자

AI 에이전트 기반 서비스를 구축하는 개발자 및 프로덕트 매니저

의미 / 영향

웹 서비스의 설계 철학이 인간을 위한 시각적 편의성에서 AI를 위한 데이터 처리 효율성으로 근본적으로 변화할 것임을 시사합니다. 이는 향후 모든 온라인 비즈니스가 에이전트 친화적인 인터페이스를 필수적으로 갖춰야 함을 의미합니다.

섹션별 상세

이미지 분석

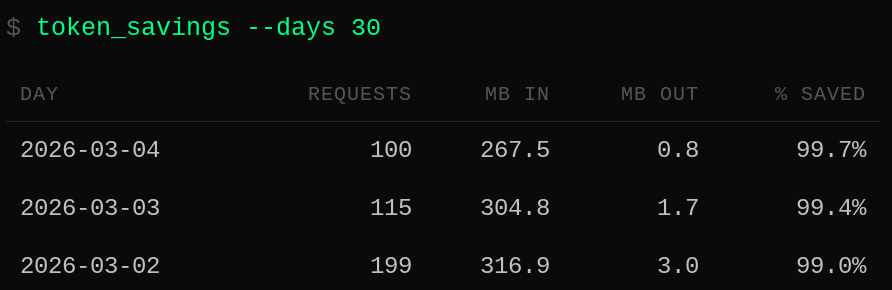

이 이미지는 본문에서 주장하는 99% 이상의 토큰 절감 수치를 실제 데이터로 증명합니다. 입력 데이터(MB IN) 대비 출력 데이터(MB OUT)의 비율을 통해 에이전트가 처리해야 할 정보량이 얼마나 획기적으로 줄어드는지 시각적으로 보여줍니다.

searchcode의 날짜별 토큰 절감 수치를 보여주는 터미널 대시보드 화면입니다.

실무 Takeaway

- LLM 에이전트가 이해하기 쉬운 구조화된 데이터(llms.txt 등) 제공이 웹사이트의 새로운 표준이 될 것입니다.

- 토큰 효율성(Token Efficiency)은 단순한 비용 절감을 넘어 AI 에이전트의 선택을 받기 위한 핵심 경쟁력입니다.

- 사용자 경험(UX)의 중심이 인간의 시각적 인터페이스에서 AI의 데이터 처리 인터페이스로 이동하고 있습니다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.