핵심 요약

LLM 기반 에이전트 운영 시 발생하는 막대한 추론 비용과 품질 관리의 어려움을 해결하기 위한 Argmin AI 플랫폼이 공개됐다. 이 플랫폼은 프롬프트 압축, 모델 라우팅, 투기적 디코딩 등 최신 연구 기법을 결합하여 전체 추론 파이프라인을 최적화한다. 실제 정신 건강 상담 AI 사례에서 비용을 87% 절감하면서도 품질 저하를 3.3% 이내로 방어하는 성과를 거뒀다. 기업은 기존 인프라를 유지하면서도 데이터 기반의 평가 체계를 통해 효율적인 AI 운영이 가능하다.

배경

LLM 추론 비용 구조에 대한 이해, RAG 및 에이전트 아키텍처 기본 지식, API 기반 LLM 연동 경험

대상 독자

LLM 기반 서비스를 운영하며 높은 추론 비용과 품질 관리 문제로 고민하는 개발자 및 프로덕트 매니저

의미 / 영향

LLM 비용 최적화가 단순한 프롬프트 수정을 넘어 아키텍처 수준의 엔지니어링 영역으로 진화하고 있음을 보여준다. 이러한 도구의 확산은 기업들이 고성능 모델을 경제적으로 프로덕션에 도입하는 데 기여할 것이다.

섹션별 상세

Argmin AI는 프롬프트 압축, 컨텍스트 관리(RAG), 모델 라우팅(FrugalGPT), 투기적 디코딩 등 검증된 연구 기반 기술을 통합하여 제공한다. 이를 통해 답변 품질을 유지하면서 입력 토큰을 2~10배 압축하거나, GPT-4급 성능을 유지하며 비용을 최대 98%까지 낮추는 것이 가능하다.

정신 건강 상담 AI 사례 연구 결과, 100만 건의 응답당 비용을 9,380달러에서 1,180달러로 약 87% 절감했다. 9명의 LLM 판사(LLM-as-a-Judge)를 통한 검증과 400개의 엣지 케이스 스트레스 테스트를 거쳐 임상적 안전성을 97.6% 수준으로 유지했음이 확인됐다.

규제 준수(Compliance) AI와 고객 지원 자동화 등 다양한 산업군에서 구체적인 비용 절감 수치를 제시한다. 규제 준수 AI의 경우 스마트 검색과 임베딩 캐싱을 통해 월 비용을 18,500달러에서 2,400달러로 줄였으며, 고객 지원 자동화는 복잡한 케이스만 검토하는 스마트 라우터를 도입해 비용을 87% 이상 절감했다.

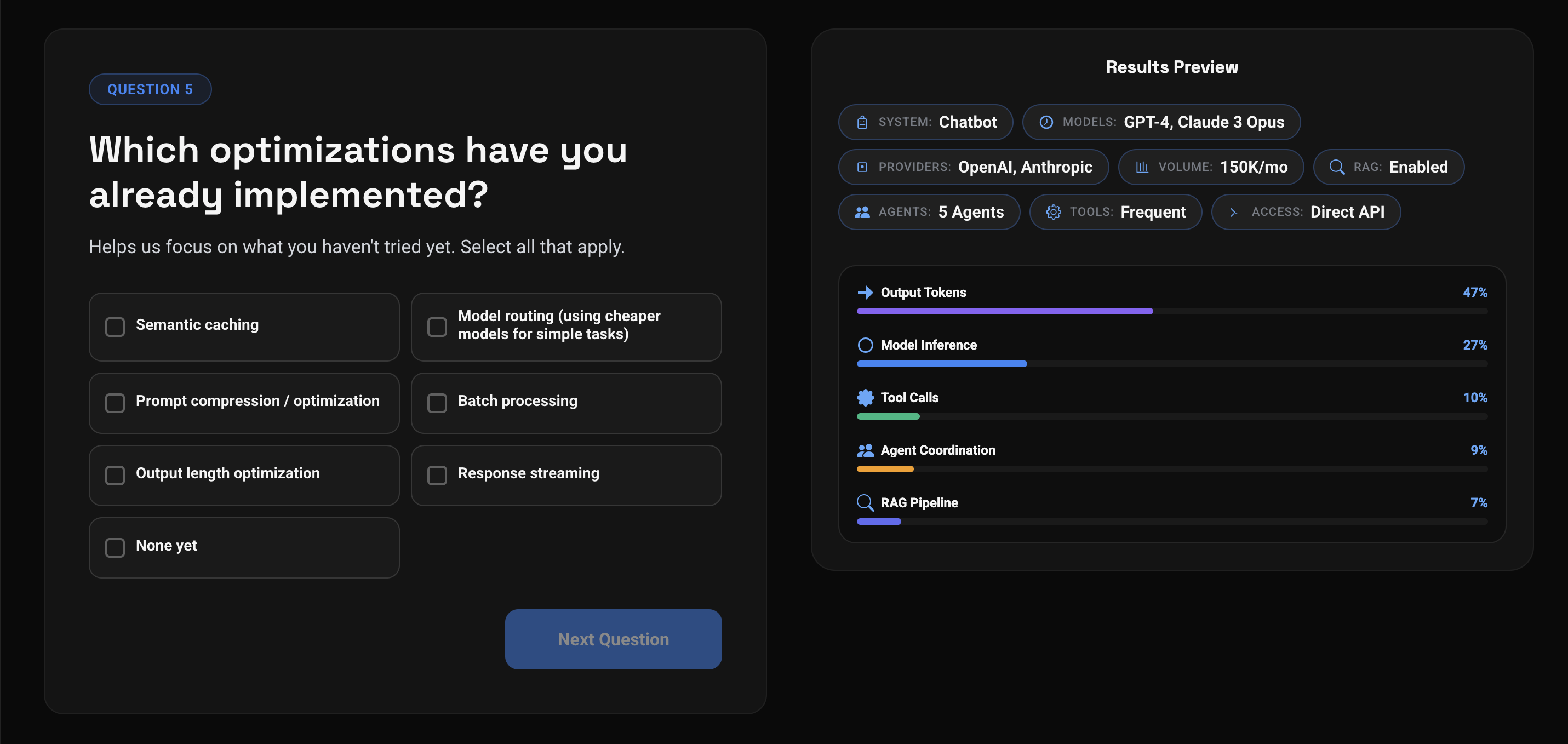

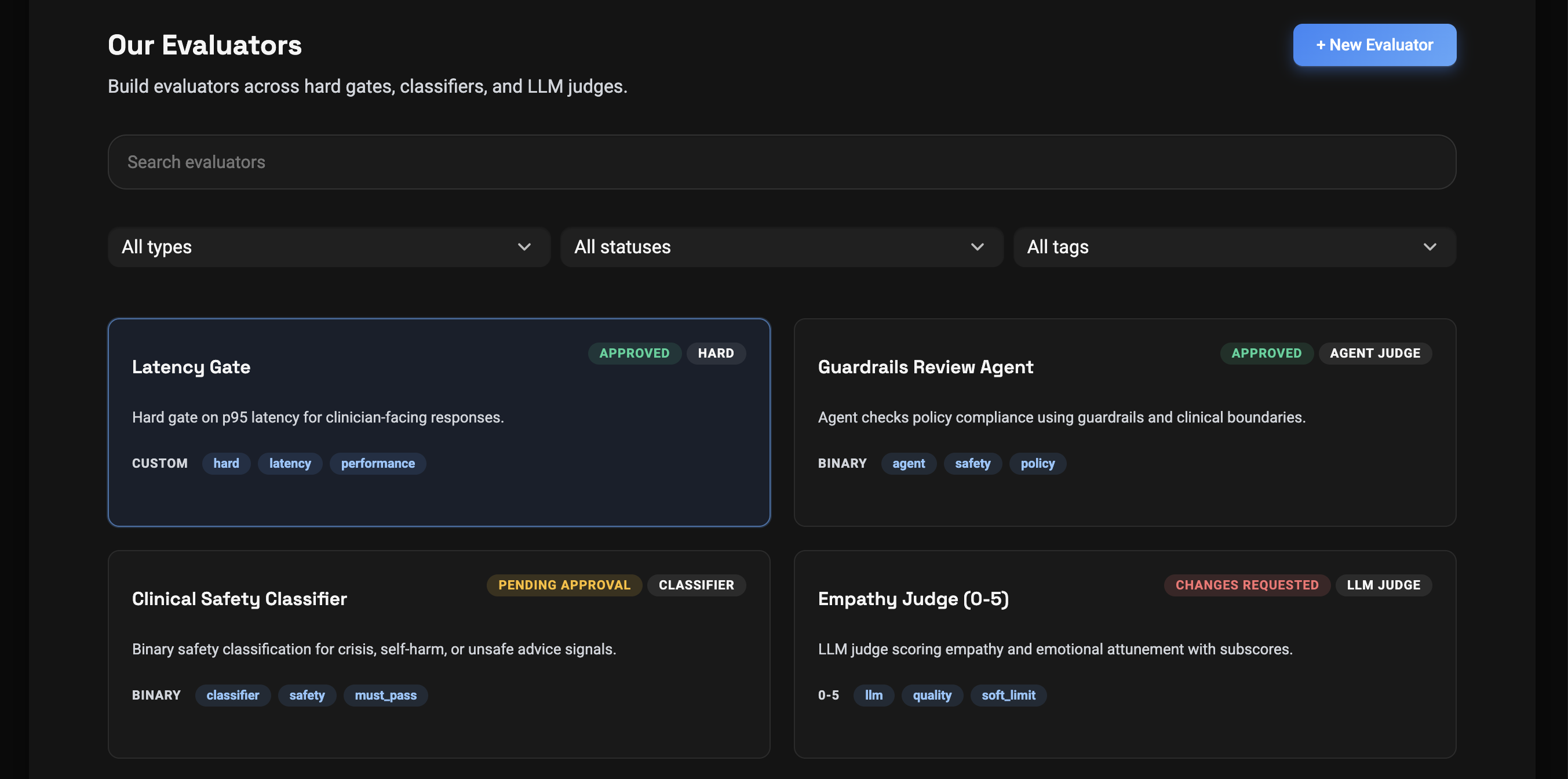

플랫폼은 비용 잠재력 계산기(Cost Potential Calculator), 무료 감사(Audit), 상시 품질 제어(Always-On Quality Control) 기능을 포함한다. 분류기(Classifiers), 하드 게이트(Hard Gates), LLM 판사 등 다양한 평가 방법을 동원해 최적화 이후에도 품질이 일정하게 유지되도록 모니터링한다.

실무 Takeaway

- 단일 모델 사용 대신 작업 복잡도에 따른 스마트 라우팅과 프롬프트 압축을 결합하여 추론 비용을 획기적으로 낮출 수 있다.

- LLM-as-a-Judge와 엣지 케이스 테스트를 포함한 다각도 평가 체계를 구축해야 최적화 과정에서의 품질 저하를 방지할 수 있다.

- RAG 시스템에서 검색 패스 최적화와 임베딩 캐싱은 토큰 사용량을 줄이고 정확도를 높이는 핵심 요소이다.

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료